- OpenAI se ha asociado con Broadcom y TSMC para diseñar su primer chip de inteligencia artificial.

- La compañía ha abandonado sus planes de construir fábricas propias debido a los altos costes.

- El chip estará centrado en la inferencia de IA y se espera que se produzca en 2026.

- OpenAI también diversifica su suministro con chips de Nvidia y AMD para evitar la escasez.

OpenAI, la empresa detrás del famoso ChatGPT, está colaborando con Broadcom y TSMC para desarrollar su propio chip de inteligencia artificial. Esta decisión es parte de una nueva estrategia que busca reducir su dependencia de proveedores externos como Nvidia y diversificar su suministro de chips, particularmente ante la creciente demanda de infraestructura tecnológica.

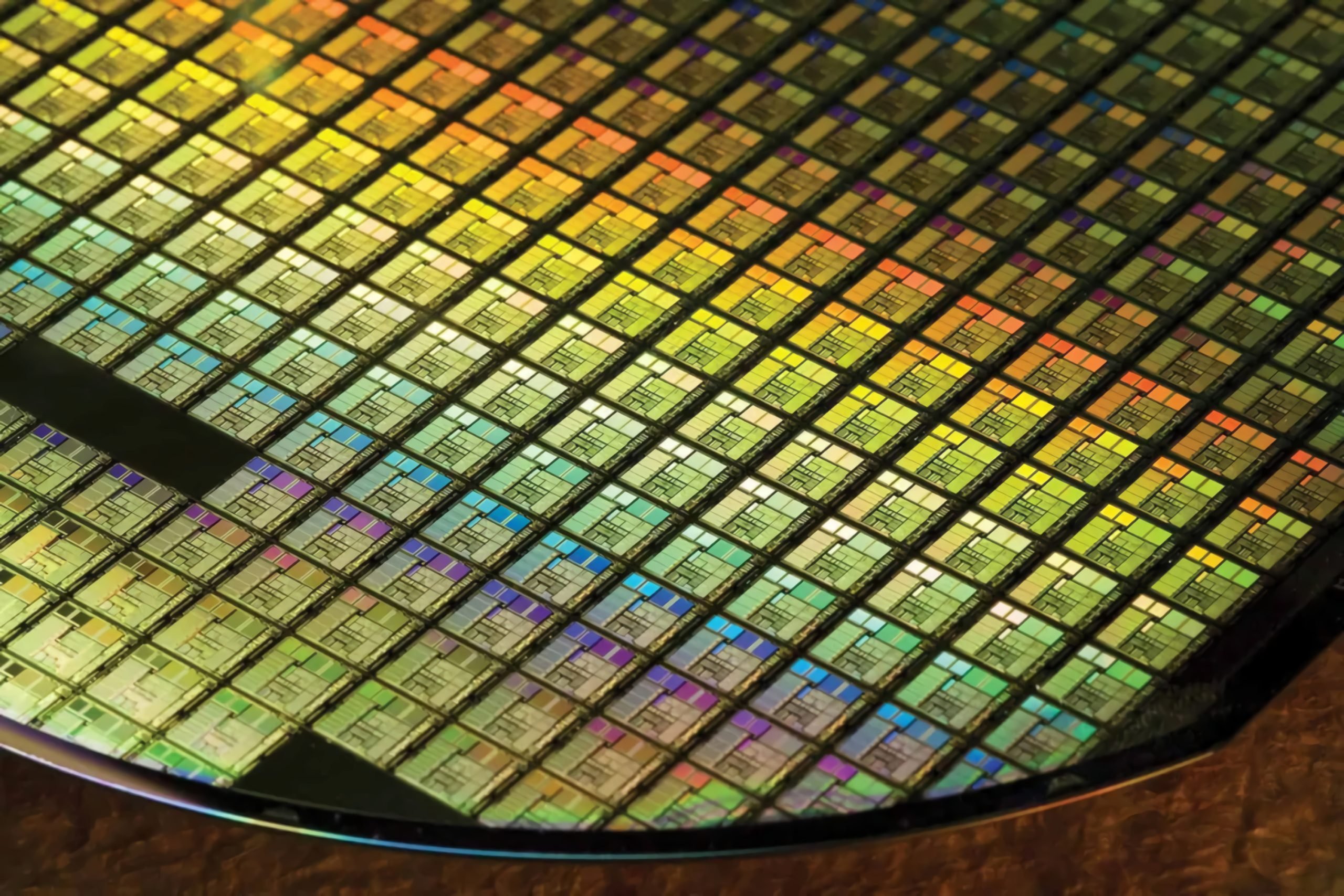

La compañía había considerado inicialmente construir una red de fábricas (fundiciones) para producir sus propios chips, pero al final optó por descartar estos costosos planes. En su lugar, OpenAI ha decidido centrarse en el diseño interno de sus chips, confiando en terceros como Broadcom para la fabricación y utilizando las instalaciones de TSMC, uno de los gigantes de la producción de semiconductores.

Abandono de la fabricación propia

El ambicioso plan de OpenAI de construir sus propias fábricas ha quedado en segundo plano. Según fuentes cercanas a la empresa, la decisión se tomó debido a los costes extremadamente elevados que implicaría montar una infraestructura de este calibre. La inversión inicial para crear esta red de fundiciones se estimaba en varios miles de millones de dólares, lo que resultaba poco rentable en un momento donde la demanda de chips está en constante cambio.

Por tanto, la compañía ha optado por un enfoque más pragmático: centrarse en el diseño de chips personalizados para sus necesidades internas, mientras utiliza los servicios de fabricantes externos para la producción. Este nuevo enfoque hará que OpenAI tenga más control sobre sus necesidades tecnológicas sin tener que asumir todo el proceso de producción.

El chip de inferencia: un proyecto prioritario

El primer chip de OpenAI estará enfocado en la inferencia de inteligencia artificial, un área que, según los analistas, cobrará cada vez más importancia en los próximos años. La inferencia es el proceso en el que un modelo de IA, tras ser entrenado, emplea los datos para hacer predicciones o tomar decisiones en tiempo real. Con cada vez más aplicaciones de IA desplegándose en diferentes sectores, las empresas tecnológicas, como OpenAI, necesitan herramientas más eficientes para procesar grandes cantidades de datos de manera rápida y optimizada.

Por ahora, el trabajo entre Broadcom y OpenAI lleva meses en marcha, y se espera que el primer chip esté disponible en 2026. La producción del mismo se llevará a cabo en las plantas de TSMC. Además, OpenAI ha formado un equipo especializado con unos 20 ingenieros, algunos de los cuales provienen de empresas como Google, donde participaron en el desarrollo de las Unidades de Procesamiento Tensor (TPU), siendo Thomas Norrie y Richard Ho nombres destacados en este equipo.

Relación con Nvidia y AMD

Aunque OpenAI está avanzando en la creación de su propio chip, la compañía no ha abandonado su relación con otros gigantes de la fabricación de chips. Nvidia, conocida por sus GPUs especializadas en IA, sigue siendo un socio clave. Eso sí, OpenAI ha empezado a diversificar su suministro incorporando chips como los de AMD, que serán utilizados a través de los servidores de Azure en la nube de Microsoft.

La relación con Nvidia sigue siendo estratégica para OpenAI, ya que Nvidia lidera el mercado con más del 80% de cuota en unidades de procesamiento gráfico (GPU). Sin embargo, debido a la actual escasez de chips y los elevados costes, OpenAI está explorando alternativas. AMD, por su parte, ha proyectado ganar terreno en este mercado con su nueva línea de chips MI300X, cuyo lanzamiento está previsto para finales de 2023.

La estrategia de OpenAI de «apostar a varios caballos» le permitirá gestionar de manera más eficiente los costes y evitar posibles cuellos de botella en el suministro de chips, que son un recurso crucial para entrenar y ejecutar sus modelos de IA.

Costes operativos y expectativas

A día de hoy, los gastos de OpenAI son elevados, con proyecciones que indican pérdidas de 5.000 millones de dólares frente a unos ingresos de 3.700 millones para este año. El principal motivo de estos costes radica en las necesidades de cómputo que conlleva el entrenamiento de grandes modelos de IA como ChatGPT. Optimizar el uso de los recursos y encontrar proveedores que ayuden a reducir estos costes es una prioridad para la compañía.

Pese a esta situación, OpenAI mantiene una relación relativamente buena con Nvidia, ya que todavía necesita acceder a las nuevas generaciones de chips de este gigante, como la serie Blackwell, que se espera revolucionen el mercado de la IA.

Aunque por el momento OpenAI no ha hecho comentarios oficiales acerca de su nuevo chip, los acuerdos con Broadcom y TSMC son claros indicadores de que la compañía está avanzando en este proyecto a largo plazo. Si todo marcha según lo previsto, en algún punto de 2026 podríamos tener el primer chip especialmente diseñado por OpenAI para la inferencia de IA, marcando un hito en la independencia tecnológica de la empresa.

Soy Alberto Navarro y soy un apasionado de todo lo relativo a la tecnología, desde gadgets de vanguardia hasta software y videojuegos de todo tipo. Mi interés por lo digital comenzó con los videojuegos y continuó en el mundo del marketing digital. Llevo desde 2019 escribiendo sobre el mundo digital en diferentes plataformas compartiendo las últimas novedades del sector. Además trato de escribir de una forma original para que tú puedas estar al día al mismo tiempo que te entretienes.

Estudié la carrera de Sociología en la universidad y seguí completando mis estudios con un master en Marketing Digital. Así que si tienes cualquier duda, compartiré contigo toda mi experiencia en el mundo del marketing digital, de tecnología y de videojuegos.