- Los mismos prompts producen resultados distintos en Gemini, Copilot y ChatGPT por diferencias de modelo, integración y diseño de producto.

- La precisión, actualización y fiabilidad de las respuestas dependen de cómo formules el contexto, el formato y el nivel de rigor en cada asistente.

- Elegir bien el tipo de modelo (rápido o de razonamiento) y la herramienta adecuada para cada tarea es tan importante como el propio prompt.

- La mejor estrategia es probar el mismo prompt en varios asistentes, comparar claridad, accionabilidad y coherencia, y asignar a cada uno los casos de uso donde más rinde.

La forma de escribir un prompt no funciona igual en ChatGPT, Gemini y Copilot. Por debajo comparten la idea de “modelo de lenguaje”, pero cada uno tiene su propia lógica, memoria, integraciones y hasta manías. Por eso, un mensaje que saca oro de uno puede dar una respuesta floja o confusa en otro.

Si te dedicas a crear contenido, programar, estudiar o simplemente quieres sacarles más jugo, entender cómo cambia el comportamiento del modelo según el asistente es clave. Aquí vas a ver, con mucho detalle, qué diferencias hay entre prompts para Gemini, Copilot y ChatGPT, qué hace cada uno “por dentro”, cómo compararlos de forma justa y qué tipo de instrucciones funcionan mejor en cada caso.

¿Qué diferencia hay entre ChatGPT, Gemini y Copilot a nivel de modelo?

No es lo mismo el asistente que usas que el modelo que responde. Esta distinción es importante para entender por qué un mismo prompt se comporta distinto según la herramienta.

ChatGPT es el producto de OpenAI y se apoya en la familia de modelos GPT (hasta GPT‑5 en las versiones más avanzadas). Su enfoque es generalista: conversación, redacción, código, explicación de conceptos, creatividad, etc. En la versión de pago puedes elegir diferentes modos de GPT‑5 con más o menos “pensamiento” interno, lo que afecta a la profundidad del razonamiento y al tiempo de respuesta.

Gemini, de Google, utiliza modelos de la serie Gemini 2.5 (Flash y Pro) y, además, puedes aprender más rápido con Gemini Gems. Flash está pensado para ser muy rápido y ligero, mientras que Pro prioriza razonamiento, matemáticas, programación y tareas complejas. Además, Gemini se lleva especialmente bien con texto, imágenes y otros formatos (multimodalidad), y se integra de forma directa con Google Workspace y Google Search.

Microsoft Copilot no tiene un modelo propio en sentido estricto: usa modelos de OpenAI (GPT‑4 o GPT‑5) y añade una capa de orquestación llamada Prometheus. Esa capa conecta el modelo con Bing, con tus datos empresariales en Microsoft 365 (correos, OneDrive, SharePoint, Teams) y con otras señales del ecosistema de Microsoft, lo que condiciona bastante el tipo de prompt que más le favorece.

Además de estos tres, existen otros asistentes como Claude, Perplexity o Grok, que también influyen en la manera de diseñar prompts cuando trabajas en paralelo con varias herramientas. Pero si nos centramos en Gemini, Copilot y ChatGPT, la idea clave es que cada uno combina: modelo, integración y capa de producto distinta, y por eso la misma instrucción no siempre rinde igual.

Cómo entienden tu consulta: búsqueda clásica vs IA conversacional

Cuando comparas “buscar en Google” con “preguntar a un chatbot”, en realidad estás comparando dos formas radicalmente distintas de procesar tu texto. Eso impacta de lleno en cómo debes redactar el prompt.

Un buscador clásico como Google Search rastrea e indexa páginas web y, cuando haces una consulta, alinea tus palabras clave con documentos que ya conoce. No interpreta a fondo tu intención, simplemente empareja términos y te devuelve enlaces. Luego eres tú quien tiene que entrar en varias páginas, esquivar anuncios y contrastar información para sacar tus propias conclusiones.

En cambio, ChatGPT, Gemini y Copilot son modelos de lenguaje conversacionales. Su objetivo no es mostrarte una lista de resultados, sino generar directamente una respuesta. Primero tratan de entender tu intención, luego detectan las palabras clave y, según el caso, combinan conocimiento entrenado con búsqueda en la web para construir un texto nuevo que responda a lo que pides.

Por eso, con IA generativa tiene mucho más sentido usar prompts en lenguaje natural, con contexto y objetivos claros. En lugar de “mejor móvil 2024”, funciona mejor algo como “actúa como experto en smartphones, compárame 5 modelos actuales para fotografía nocturna y presupuesto máximo de 500 €”. Esa forma de hablar encaja mucho mejor con ChatGPT, Gemini o Copilot que con el buscador clásico.

Además, estos asistentes no se quedan solo en texto: pueden devolverte tablas, listas de pasos, resúmenes largos o guiones de vídeo, algo que un buscador tradicional no hace de forma directa. la estructura de lo que generen dependerá mucho de lo bien que estructures tu prompt.

Actualización de información y precisión según la IA

Uno de los grandes miedos al usar IA es si lo que dice está actualizado. Aquí hay matices importantes entre Gemini, Copilot y ChatGPT, y eso condiciona cuánto debes especificar en el prompt.

Cuando navegas con Google, la actualización depende de cada web: si el sitio está al día, verás la versión más reciente; si no, da igual que el buscador sea muy moderno, la información estará desfasada igual. Tu prompt en un buscador se reduce en la práctica a elegir buenas palabras clave.

En los asistentes de IA la cosa cambia. Si el modelo se conecta a Internet en tiempo real, puede recuperar contenido reciente, pero no siempre minuto a minuto. Gemini y Copilot tienden a tirar mucho de web actualizada, mientras que ChatGPT ha ido incorporando poco a poco la navegación al modelo, cerrando la brecha que tenía cuando solo usaba datos de entrenamiento antiguos.

¿Qué implica esto para tus prompts? Que tiene sentido pedir explícitamente datos recientes. Frases como “con información actualizada a 2024”, “usa fuentes recientes y añádeme enlaces” o “indica si no estás seguro de la fecha de los datos” ayudan a que la IA oriente mejor la búsqueda y sea honesta con sus límites temporales.

Además, todos estos sistemas pueden sufrir alucinaciones: respuestas incorrectas pero expresadas con mucha seguridad. Por eso, un buen prompt en Gemini, Copilot o ChatGPT suele incluir peticiones explícitas de citas o referencias, del tipo “indica las URLs de las que sacas la información” o “separa claramente hechos contrastados de hipótesis o suposiciones”.

Diferencias en facilidad de uso y experiencia al redactar prompts

La “facilidad de uso” de cada asistente no es solo diseño de interfaz: también afecta a cuánto esfuerzo tienes que poner en el prompt para conseguir lo que quieres.

En un buscador tradicional, tú controlas la navegación: eliges en qué página entras, qué pestañas abres y cómo combinas las fuentes. El “prompt” se limita a pocas palabras y atajos como comillas, operadores booleanos, etc. Es un proceso más manual y a menudo más lento, pero con más control fino sobre los resultados.

Con las IA conversacionales, por contra, eliminas pasos intermedios: haces una pregunta y te devuelven una síntesis ya digerida. Eso es fantástico cuando aciertas con el prompt, pero te obliga a ser más claro con tu objetivo: longitud deseada, formato, tono, idioma, público objetivo, etc. Un error habitual es hacer preguntas vagas y luego culpar al modelo cuando responde algo demasiado genérico.

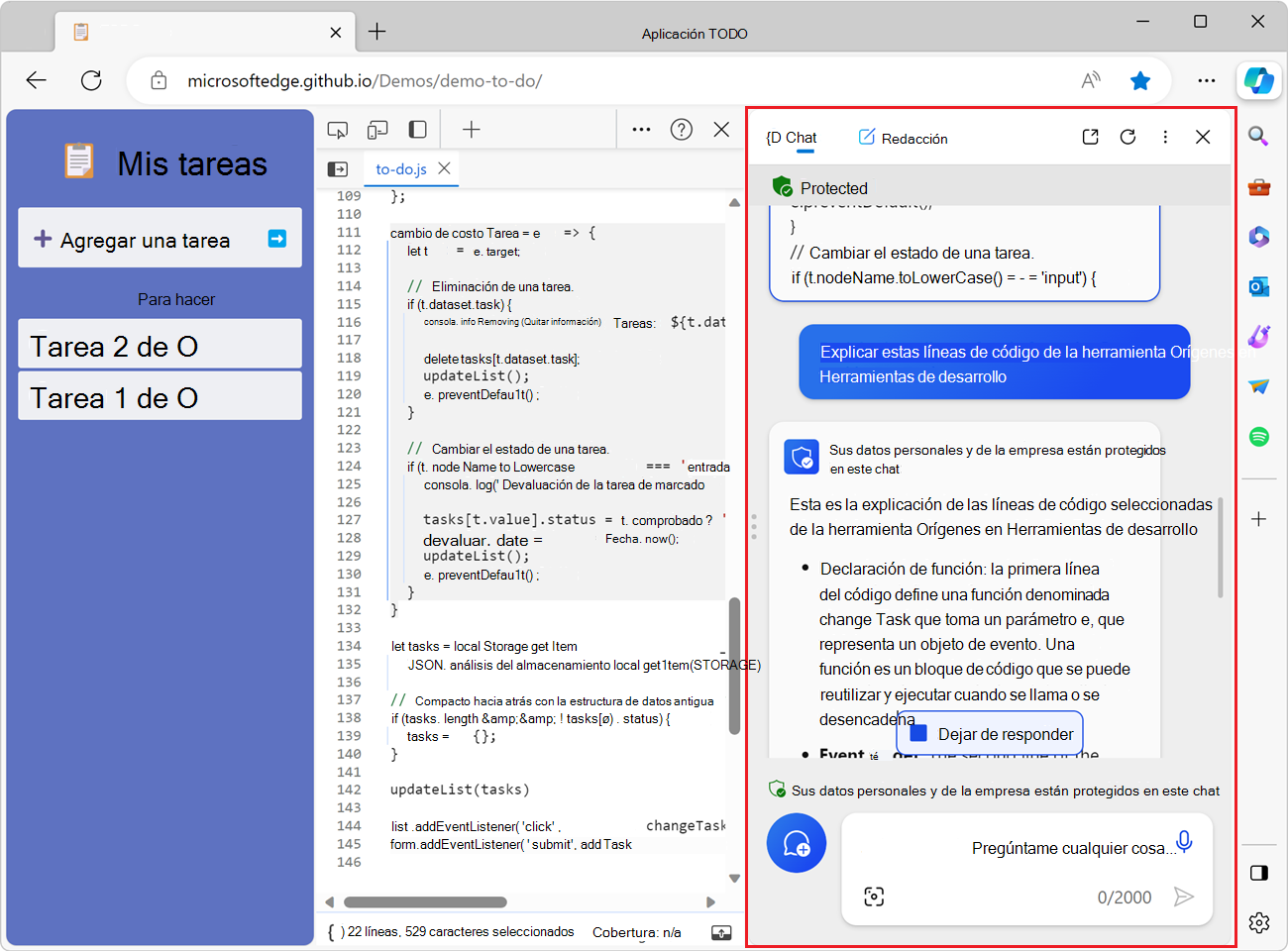

En este punto, hay matices entre herramientas. Copilot brilla cuando lo usas dentro de Word, Excel, Outlook o Teams en Microsoft 365. El prompt puede ser muy corto (“resume esta reunión”, “haz un informe con estos datos”) porque el contexto lo obtiene de los propios documentos. Gemini hace algo similar dentro de Google Workspace, entendiendo mejor tus Docs, Sheets y Gmail. ChatGPT, en cambio, suele necesitar que le pegues tú mismo el contexto (o que subas archivos), pero a cambio ofrece mucha flexibilidad en el estilo y formato de la respuesta.

Al final, la facilidad para escribir prompts depende también de cómo pienses tú: si estás acostumbrado a redactar instrucciones largas y estructuradas, ChatGPT y Gemini premian ese esfuerzo; si prefieres pedir cosas rápidas sobre lo que ya tienes abierto en Word o Excel, Copilot simplifica mucho el trabajo.

Fiabilidad de las respuestas y cómo protegerte con buenos prompts

La fiabilidad es donde más se nota que un buen prompt puede marcar la diferencia entre un texto útil y una metedura de pata elegante. Aquí se mezclan las limitaciones técnicas del modelo con la forma en que tú formulas la petición.

Con Google Search, la responsabilidad recae sobre ti: eliges fuentes, comparas versiones, detectas páginas poco fiables. Google aplica algoritmos de autoridad y relevancia, pero aun así se cuelan webs dudosas que han “engañado” al algoritmo. Tu habilidad crítica vale más que cualquier palabra clave.

Con ChatGPT, Gemini y Copilot, la IA hace ese filtrado por ti: rasca información de varias fuentes y la reescribe en una respuesta unificada. El problema es que puede mezclar datos correctos con errores o quedarse solo con una versión parcial. Eso es lo que llamamos alucinaciones: respuestas erróneas que el modelo da como si fuesen totalmente válidas.

Para reducir el riesgo, es buena idea añadir a tus prompts frases del tipo “si no estás seguro, dilo”, “cita al menos 3 fuentes contrastadas”, “marca con un aviso todo lo que sea especulativo” o “no inventes datos, limita la respuesta a lo que puedas respaldar con fuentes”. No lo elimina por completo, pero empuja al modelo a ser algo más conservador.

También ayuda mucho especificar el nivel de rigor que quieres. No es lo mismo pedirle “explícame la computación cuántica como si fuera un niño de 10 años” que “dame una explicación académica con referencias a papers”. Si el prompt se queda a medias, la respuesta irá al terreno cómodo de lo generalista, donde es más fácil que se cuele un dato impreciso sin que tú lo notes.

Ejemplos prácticos: cómo cambian las respuestas con el mismo prompt

Cuando pones a ChatGPT, Gemini y Copilot frente al mismo prompt, aparecen diferencias claras en profundidad, formato, creatividad y capacidad de síntesis. Varios análisis comparativos y experimentos reproducibles muestran patrones bastante consistentes.

Por ejemplo, si pides “Explícame qué es la computación cuántica en exactamente 100 palabras”, estás midiendo claridad, capacidad de síntesis y respeto a restricciones. Algunos modelos cumplen al milímetro, otros se pasan por un par de palabras o recortan demasiado el contenido. Aquí suelen destacar los modelos más recientes de ChatGPT y Gemini, mientras que Copilot, dependiendo de la versión, puede ser algo más laxo con el conteo.

En tareas de resumen y reformulación, como pedir “hazme un resumen en 3 puntos clave de este texto” o “reescribe este párrafo en tono académico sin cambiar el significado”, los tres se desenvuelven bien, pero con matices. ChatGPT tiende a ofrecer resúmenes muy legibles, Gemini suele respetar más la estructura lógica original y Copilot prioriza el estilo corporativo cuando se usa dentro de Microsoft 365.

Cuando les encargas revisión de correos o reescritura profesional, prompts del tipo “arregla este correo corrigiendo ortografía y gramática” o “hazlo más educado pero muy asertivo y profesional, pidiendo confirmación de lectura” sirven para medir sensibilidad lingüística. ChatGPT y Claude (cuando se compara con ellos) brillan en matices de tono; Gemini y Copilot tienden a resultar algo más formales, lo que puede ser perfecto para entorno empresarial.

En creatividad pura, por ejemplo “dame 10 ideas originales para usar tecnología en el aula de primaria sin recurrir a tópicos como usar tablets”, ChatGPT y Copilot suelen generar propuestas con más textura narrativa y referencias emocionales, mientras que Gemini, en muchos casos, ofrece algo más básico: género, ambiente y un par de elementos, pero deja el detalle en tus manos.

Memoria del hilo y coherencia en cadenas de prompts

Otro punto donde se ven diferencias es en la memoria conversacional y la coherencia en varias rondas. Si encadenas varias instrucciones, no todas las herramientas sostienen igual de bien el contexto.

Imagina esta secuencia en el mismo chat: “explícame las capas de la atmósfera”, luego “compáralas con las plantas de un edificio”, después “haz 5 preguntas de examen sobre esto” y, por último, “convierte todo en un guion de TikTok para niños”. Un modelo con buena memoria deberá mantener la metáfora, el contenido científico y adaptarlo al nuevo formato sin contradecirse.

En este tipo de pruebas, ChatGPT y Claude suelen mostrar una continuidad muy sólida, mientras que Gemini y Copilot pueden perder algún matiz de la metáfora en los últimos pasos si la conversación se alarga o se vuelve muy compleja. Esto no significa que sean malos, pero sí que tu prompt debe recordar de vez en cuando el contexto: “usa la comparación edificio‑atmósfera que hemos creado antes”.

Cuando haces prompts de transformación estructural, como “convierte este texto en una tabla con tres columnas: problema, causa, solución”, los tres asistentes se defienden bien. Aquí lo importante es que el prompt indique con claridad el formato y las columnas; si lo haces, tanto Gemini como ChatGPT y Copilot suelen generar tablas coherentes y fáciles de exportar.

En tareas de productividad personal y profesional, como “replantea este correo para que sea educado pero firme, pidiendo confirmación de lectura”, se aprecia también el carácter de cada herramienta: Copilot tiende a sonar muy corporativo, Gemini bastante neutro y ChatGPT algo más flexible en el tono, sobre todo si le das ejemplos previos.

Herramientas, modelos y razonamiento: por qué importa para tus prompts

Detrás de lo que ves en pantalla hay otra capa más: el tipo de modelo que eliges dentro de cada asistente y si está optimizado para velocidad o para razonamiento profundo. Esto influye directamente en cómo conviene escribir el prompt.

En Gemini puedes alternar entre 2.5 Flash y 2.5 Pro. Flash va como un tiro y es ideal para consultas rápidas, resúmenes y tareas sencillas. Pro, en cambio, dedica más tiempo interno a planificar la respuesta, lo que se nota en análisis complejos, matemáticas o código. Si tu prompt requiere varios pasos lógicos (“piensa paso a paso”), es mejor usar Pro.

En ChatGPT de pago puedes escoger modos dentro de GPT‑5 con diferente nivel de “pensamiento”. Los modos de razonamiento hacen más trabajo interno antes de contestar, lo que mejora la calidad en problemas complejos pero aumenta la latencia. Si quieres sacar partido, tiene sentido que el prompt pida explícitamente desgloses, evaluación de alternativas y justificación y, en caso de duda, te ayude a elegir qué IA usar.

Copilot te deja moverte entre GPT‑4 y GPT‑5, y además combina el modelo con la capa Prometheus para cruzar datos de tu entorno Microsoft. En preguntas sobre documentos internos, reuniones o archivos de OneDrive, un prompt que haga referencia precisa a esos recursos (“usa el último informe de ventas de este canal”) puede sacar mucho más provecho que una consulta genérica sin contexto. También existen prompts de Copilot para tareas concretas de gestión en entornos Windows.

Una forma práctica de decidir es preguntarte: ¿mi problema necesita un plan paso a paso o basta con una respuesta directa? Si es lo segundo (definiciones sencillas, conceptos básicos, pequeñas correcciones), un modelo rápido suele sobrar. Si hay que cruzar datos, comparar alternativas o diseñar procesos, entonces te interesa un modelo de razonamiento y un prompt más elaborado.

Multimodalidad e imágenes: cómo varía la respuesta según el prompt

Otra diferencia grande entre asistentes está en cómo gestionan imágenes y otros formatos, tanto para analizarlos como para generarlos. Aquí los prompts también cambian bastante de una herramienta a otra.

Si le pides a ChatGPT, Copilot o Gemini que describan una foto (“describe esta imagen y explica qué pasa en ella”), estás midiendo su capacidad de visión + lenguaje. También puedes usar MAI‑Image para este tipo de tareas y comparar resultados.

En generación de imágenes, prompts como “genera una ilustración estilo flat design, colores pastel, de una persona estudiando con un portátil, fondo suave y sombras minimalistas” muestran cómo el modelo interpreta estilo, composición y coherencia. Gemini suele destacar en control sobre el estilo y la combinación con texto, mientras que Copilot y ChatGPT (según la versión) tienen fortalezas distintas en detalle visual y fidelidad a las instrucciones. Si usas Midjourney, consulta Midjourney comandos avanzados.

Hay pruebas especialmente útiles, por ejemplo: pedir una imagen con varios elementos muy concretos (“persona leyendo, planta a la derecha, estantería al fondo, luz cálida, estilo acuarela suave”) y luego preguntar al propio modelo si ha cumplido cada requisito. Eso revela su capacidad de autoevaluación, algo clave si quieres prompts consistentes para marcas o proyectos de diseño.

También son interesantes los prompts que exigen consistencia de identidad, como “genera el retrato de una persona con estas características y, después, tres variaciones manteniendo la misma cara pero con cambios de pose y luz”. Aquí muchos modelos fallan, lo que te obliga a afinar el prompt (“mantén exactamente los rasgos faciales anteriores”) o a usar herramientas específicas.

Casos de uso típicos y en qué destaca cada asistente

Más allá del modelo, importa mucho para qué estás usando la IA. ChatGPT, Gemini y Copilot se pisan en muchas cosas, pero cada uno tiene terreno donde se siente especialmente cómodo y eso influye en el tipo de prompt que rinde mejor.

ChatGPT se ha convertido en la opción más versátil para tareas diarias: redacción, brainstorming, aprendizaje, explicación de conceptos, ayuda básica con código, etc. Sus prompts funcionan muy bien cuando incluyes rol, contexto, objetivo y formato: “actúa como profesor de física, explícame esto en 5 pasos, con ejemplos sencillos y luego haz un mini test”.

Gemini brilla en multimodalidad y ecosistema Google. Si trabajas con Google Docs, Sheets, Gmail o Drive, los prompts que aprovechan esos recursos (“resume este documento de Drive y crea una tabla con los datos clave”) ahorran muchísimo tiempo. También es muy interesante para tareas que mezclan texto e imagen o que necesitan apoyo del buscador en tiempo real.

Copilot está muy orientado a productividad empresarial y código. Dentro de Word o Excel, prompts del tipo “genera un informe de una página con estos datos, listo para enviar al director financiero” o “crea una tabla comparativa con los KPIs clave a partir de esta hoja” funcionan especialmente bien. Y en GitHub Copilot, los prompts se centran más en el contexto del código: comentarios claros dentro del archivo, descripciones de la función que quieres, etc.

En paralelo, asistentes como Perplexity se especializan en búsqueda de conocimiento en tiempo real con citas, Claude apuesta por precisión y seguridad en entornos regulados y Grok se mueve mejor en conversaciones rápidas en redes sociales. Si combinas varios, tus prompts pueden repartir tareas: uno para investigar con referencias, otro para redactar bonito y otro para integrarlo en tu suite ofimática.

Al final, elegir dónde lanzar el prompt es casi tan importante como cómo lo escribes. Un buen hábito es asignar cada tipo de problema al asistente que mejor lo resuelve y no intentar que uno solo haga todo, sobre todo en entornos profesionales.

Después de ver cómo piensan, qué modelos usan, cómo se integran con tus herramientas y cómo responden a distintos tipos de prompts, se ve claro que no existe un “mejor” asistente universal, sino combinaciones de herramienta + modelo + forma de preguntar que encajan mejor o peor con lo que tú haces cada día; la clave está en experimentar con prompts iguales en Gemini, Copilot y ChatGPT, anotar quién te entiende mejor en cada tipo de tarea y quedarte con el que “hable tu idioma” para estudiar, trabajar o crear, usando el resto como apoyo cuando su especialidad te venga mejor.

Redactor apasionado del mundo de los bytes y la tecnología en general. Me encanta compartir mis conocimientos a través de la escritura, y eso es lo que haré en este blog, mostrarte todo lo más interesante sobre gadgets, software, hardware, tendencias tecnológicas, y más. Mi objetivo es ayudarte a navegar por el mundo digital de forma sencilla y entretenida.