- ONLYOFFICE para Linux integra un plugin de IA flexible que conecta modelos en la nube y locales, sin activarse por defecto.

- El plugin permite usar proveedores como Mistral, Claude, Gemini, LocalAI, Ollama o LM Studio, configurando cada modelo para tareas concretas.

- Las funciones actuales se centran en chat, resumen, traducción y análisis de texto, aplicables a documentos, hojas y presentaciones.

- Se priorizan la privacidad, el control del usuario y la futura personalización avanzada del agente de IA dentro del entorno de ONLYOFFICE.

Si usas Linux y te pasas el día entre documentos, hojas de cálculo y presentaciones, te interesa tener un buen asistente de inteligencia artificial siempre a mano. ONLYOFFICE se ha puesto las pilas y ofrece un sistema muy flexible que te deja conectar desde los grandes modelos en la nube hasta soluciones locales que corren en tu propio PC.

En esta guía vas a ver, con todo lujo de detalles y sin rodeos, cómo usar una IA en ONLYOFFICE para Linux, qué proveedores puedes conectar (Mistral, Claude, Gemini, LocalAI, Ollama, LM Studio y muchos más), qué hardware necesitas, cómo se configura el plugin y qué puedes hacer luego con él en documentos, hojas y diapositivas.

Cómo funciona la IA en ONLYOFFICE para Linux

El corazón de todo es un plugin de IA que se instala como cualquier otra extensión dentro de ONLYOFFICE. No viene activado por defecto, así que tú decides si quieres usarlo o prefieres seguir con la edición clásica de toda la vida sin ningún tipo de asistente.

Este plugin funciona como un puente entre tus editores y distintos proveedores y modelos de IA: puedes usar servicios en la nube (OpenAI, Anthropic, Mistral, Google Gemini, DeepSeek, Groq, Together AI, Stability AI, Zhipu, etc.) o modelos que tengas montados en local (LocalAI, Ollama, LM Studio, GPT4All…). El sistema es totalmente modular: añades, cambias o borras modelos cuando quieras.

En la versión actual, el plugin ya no te ata a un único proveedor. Puedes combinar varios modelos a la vez y asignar cada uno a una tarea: uno para el chat, otro para resumir, otro para traducir, otro para análisis de texto… y cambiarlos sobre la marcha desde la ventana de configuración.

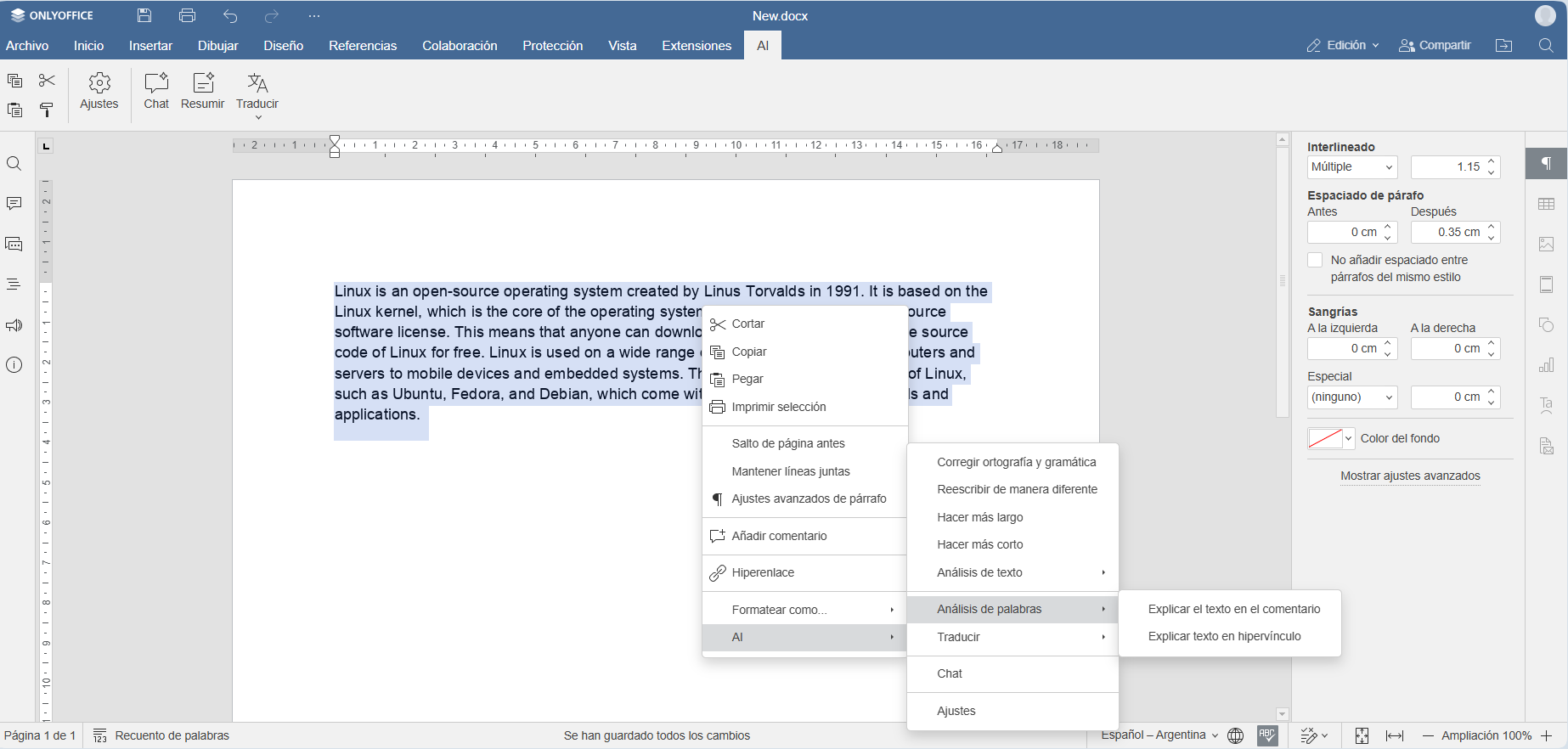

Una vez configurados los modelos, accedes a la IA desde la pestaña “IA” en la barra superior o desde el menú contextual al seleccionar texto con el botón derecho. Desde ahí puedes chatear con el asistente, reescribir párrafos, generar contenido nuevo, corregir gramática y ortografía, traducir, resumir, analizar palabras o frases y mucho más.

Instalación y activación del plugin de IA en ONLYOFFICE

El primer paso para disfrutar de la IA en Linux es instalar y activar el plugin de IA desde los editores ONLYOFFICE. Da igual que estés usando ONLYOFFICE Desktop Editors o ONLYOFFICE Docs integrado en una plataforma como Nextcloud, ownCloud, Moodle, WordPress, Odoo o similares: el procedimiento es prácticamente el mismo.

Abre cualquier editor (documento, hoja de cálculo o presentación) y ve a la pestaña “Extensiones” de la barra de herramientas superior. Desde ahí lanza el Administrador de plugins, localiza el plugin llamado “IA” y pulsa en “Instalar”. En unos segundos quedará añadido a tu suite.

Después de instalarlo, hay que activarlo. Para ello vuelve a la pestaña “Extensiones” y entra en “Plugins de fondo”. Dentro de esa lista verás el plugin de IA con un interruptor; actívalo y, si todo está correcto, aparecerá una nueva pestaña llamada “IA” en la parte superior del editor.

En este punto ya tienes el componente clave funcionando, pero todavía falta lo más importante: añadir tus modelos de IA y decidir para qué quieres usar cada uno. Eso se hace desde el panel de Ajustes, que veremos con calma en los siguientes apartados para distintos proveedores.

Claves de API, proveedores locales y privacidad

Para todos los modelos en la nube, ONLYOFFICE funciona con claves de API que debes obtener tú directamente del proveedor. La suite no te da claves propias ni actúa como intermediaria en el pago; eres tú quien se registra, configura la cuenta y genera las credenciales.

Cada proveedor tiene sus normas: algunos ofrecen planes gratuitos con límites, otros son directamente de pago desde el primer momento. Por eso es importante revisar las condiciones de uso y precios en la web oficial del servicio que vayas a usar (OpenAI, Anthropic, Mistral, Google Gemini, etc.). El plugin es gratuito, pero el consumo del modelo se factura según lo que marque el proveedor.

Si no quieres depender de terceros ni enviar tus datos fuera, puedes apostar por modelos locales que corren en tu propio equipo o servidor Linux. En este escenario, no necesitas conexión a Internet para usar la IA (solo para descargar los modelos al principio o actualizarlos), y mantienes el control sobre la privacidad porque todo el procesamiento se hace en casa.

Entre las opciones locales más interesantes para Linux están LocalAI, Ollama y LM Studio. Todas ellas se integran con el plugin de IA mediante una API compatible, y te permiten cargar modelos de código abierto (por ejemplo, variantes basadas en Llama, Mistral u otros LLMs) para tareas de texto, imágenes o incluso audio.

Requisitos de hardware para usar IA en local en Linux

Si optas por un modelo local, conviene tener en cuenta el hardware para evitar cuellos de botella. Aunque puedes arrancar algunos modelos ligeros en máquinas modestas, para una experiencia fluida es recomendable cumplir ciertos mínimos de CPU, RAM y almacenamiento.

En procesador, lo ideal es contar con una CPU multinúcleo, cuanto más moderna mejor. Los modelos grandes agradecen tener varios hilos de ejecución para poder responder en tiempos razonables, sobre todo si vas a hacer varias peticiones o trabajar con documentos largos.

En memoria, el punto sensible está en la RAM disponible para el modelo y para ONLYOFFICE. Para tareas básicas, se recomienda un mínimo de 8 GB, pero si quieres manejar modelos más pesados con cierta soltura y sin que el sistema se ahogue, lo ideal es moverse en el rango de 16 GB o más.

En cuanto al almacenamiento, es muy recomendable usar un SSD con al menos 20 GB libres para guardar los modelos y gestionar archivos temporales. Los modelos de lenguaje modernos ocupan varios gigas cada uno, así que mejor no quedarse corto, sobre todo si piensas probar distintas variantes.

Respecto a la red, las soluciones como LocalAI funcionan sin conexión a Internet una vez instaladas, pero necesitas una conexión estable para descargar los modelos y aplicar futuras actualizaciones. Una vez hecho esto, puedes trabajar perfectamente en modo offline con ONLYOFFICE y tu IA local.

Conectar LocalAI en Linux con ONLYOFFICE

LocalAI es una opción muy potente si quieres ejecutar modelos de IA de forma totalmente local en Linux y aprovecharlos directamente desde ONLYOFFICE. La idea es sencilla: instalas LocalAI, descargas un modelo, lo lanzas con CORS habilitado y luego lo agregas como proveedor en el plugin de IA.

Paso 1: instalar LocalAI en Linux

Para empezar, puedes instalar LocalAI con un único comando en la terminal, lo que simplifica bastante el proceso. Basta con ejecutar:

curl https://localai.io/install.sh | sh

Este script se encarga de descargar e instalar LocalAI de forma automática. Si lo prefieres, también puedes seguir las instrucciones oficiales y usar Docker, lo cual es muy útil si quieres aislar el servicio o moverlo fácilmente entre máquinas.

Paso 2: descargar un modelo para LocalAI

Con LocalAI ya instalado, el siguiente paso es añadir al menos un modelo de lenguaje compatible. Por ejemplo, podrías instalar uno como este:

local-ai models install hermes-2-theta-llama-3-8b

Este comando descarga y registra el modelo en LocalAI para que luego pueda ser detectado automáticamente por el plugin de IA en ONLYOFFICE cuando configures el proveedor local.

Paso 3: lanzar LocalAI con CORS habilitado

Para que ONLYOFFICE pueda hablar con LocalAI desde el navegador o desde el editor de escritorio, necesitas permitir peticiones CORS. La forma rápida es arrancar el servidor con:

local-ai run --cors

Como alternativa, puedes editar el archivo de configuración /etc/localai.env y añadir una línea como esta:

CORSALLOWEDORIGINS="*"

Con esto indicas que cualquier origen está permitido, lo que facilita la integración con ONLYOFFICE. A partir de aquí, LocalAI quedará escuchando, por defecto, en http://127.0.0.1:8080, aunque puedes personalizar la URL y el puerto si lo necesitas.

Paso 4: configurar LocalAI en el plugin de IA

Ahora toca conectar todo con ONLYOFFICE. Abre cualquier editor web de tu solución ONLYOFFICE (Docs, DocSpace, etc.), ve a Extensiones → Administrador de plugins e instala el plugin de IA si no lo tenías ya. Actívalo desde Plugins de fondo y asegúrate de que la pestaña IA aparece arriba.

Dentro de la pestaña IA, entra en Ajustes y pulsa en “Editar modelos de IA”. Ahí verás la lista de modelos (que inicialmente estará vacía) y un botón para Añadir un nuevo modelo.

En el formulario, pon como nombre del proveedor algo descriptivo, por ejemplo “LocalAI”, e introduce la URL http://127.0.0.1:8080 si no has cambiado la configuración por defecto al lanzar el servicio.

Los modelos disponibles en LocalAI se cargarán automáticamente; solo tienes que seleccionar “hermes-2-theta-llama-3-8b” u otro que hayas instalado y guardar con OK. A partir de ese momento, puedes asignar este modelo local a las tareas de chat, resumen, traducción o análisis desde el menú principal de Ajustes.

Conectar Claude y Anthropic con ONLYOFFICE en Linux

Si prefieres apostar por un proveedor en la nube con mucho enfoque en la seguridad y el uso responsable, Anthropic y su chatbot Claude son una opción muy potente. ONLYOFFICE es compatible con Claude 3.7 Sonnet y otros modelos de la familia a través del plugin de IA.

Anthropic se centra en desarrollar modelos de lenguaje grandes que sean fiables y seguros, con capacidades muy avanzadas en razonamiento paso a paso, análisis de información, generación de contenido creativo y comprensión de imágenes. Esto convierte a Claude en un asistente ideal para tareas ofimáticas complejas.

Para usar Claude desde Linux, el flujo es similar: instalas y activas el plugin, conectas Anthropic como proveedor, introduces tu clave de API obtenida en su web oficial y seleccionas el modelo que prefieras desde la lista.

Instalar y activar el plugin para Anthropic

Abre un documento en ONLYOFFICE, ve a Extensiones → Administrador de Plugins y localiza el plugin de IA. Pulsa en Instalar y espera unos segundos. Luego, desde Extensiones → Plugins en segundo plano, activa el control deslizante del plugin para que aparezca la pestaña IA.

Conectar Anthropic y elegir modelos Claude

En la pestaña IA, pulsa en Ajustes para entrar en la configuración. Haz clic en Editar modelos de IA y luego en el botón + para añadir un nuevo modelo. Se abrirá la lista de proveedores disponibles: elige Anthropic.

En la ventana de edición, pega tu clave de API de Anthropic en el campo correspondiente. Si aún no la tienes, debes crear una cuenta en la web oficial de Anthropic y generar las credenciales allí. ONLYOFFICE no proporciona claves ni se responsabiliza de los costes asociados al uso.

Tras introducir la clave, pulsa el botón “Actualizar lista de modelos”. Se desplegarán las distintas variantes de Claude soportadas, incluyendo Claude 3.7 Sonnet como modelo estrella. Selecciona el que quieras usar y confirma con OK.

Asignar tareas a Claude dentro de ONLYOFFICE

Vuelve a la pantalla principal de Ajustes de IA. Desde ahí puedes elegir, en cada lista desplegable, qué modelo se usará para cada función: Preguntar a la IA, Resumir, Traducir y Análisis de texto. Si quieres que Claude sea tu asistente principal, asígnalo a todas las tareas o solo a aquellas donde realmente marque la diferencia.

A partir de este momento podrás utilizar Claude directamente desde la pestaña IA o haciendo clic derecho sobre un texto seleccionado en tu documento. El chatbot te ayudará con ensayos, informes, análisis de datos, programación, planificación, servicios lingüísticos y casi cualquier tarea de texto que se te ocurra.

Conectar Mistral AI en ONLYOFFICE para Linux

Mistral AI es una empresa francesa que ha ganado mucha fuerza en poco tiempo gracias a sus modelos de código abierto y su enfoque europeo. Para muchos usuarios preocupados por la soberanía de datos y las alternativas a los gigantes norteamericanos, Mistral es la elección natural.

ONLYOFFICE permite conectar distintos modelos de Mistral, tanto para uso en la nube como en entornos autoalojados, y aprovecharlos en Linux para editar documentos, hojas de cálculo, presentaciones y PDFs. La integración está disponible tanto en ONLYOFFICE Docs como en ONLYOFFICE Desktop Editors y DocSpace.

El requisito clave es disponer de una instancia de ONLYOFFICE funcionando en Linux (ya sea integrada en otra plataforma o como app de escritorio) y una clave de API de Mistral, que se obtiene registrando una cuenta gratuita en su web.

Paso 1: instalar el plugin de IA

Abre cualquier editor de ONLYOFFICE, accede a la pestaña “Extensiones” y abre el Administrador de complementos. Busca el plugin de IA y haz clic en Instalar. Cuando el proceso termine, ve a Plugins de fondo y activa el plugin de IA para que aparezca la pestaña IA en la barra superior.

Paso 2: añadir un modelo de Mistral

Con la pestaña IA ya visible, entra en Ajustes y pulsa en Editar modelos de IA. Como todavía no tendrás ninguno, la lista estará vacía. Haz clic en el botón Añadir para crear un nuevo modelo.

En el menú de Añadir modelo de IA, selecciona Mistral en la lista de proveedores predeterminados, donde también aparecen OpenAI, Together AI, Anthropic, DeepSeek, Google Gemini y otros. A continuación, introduce tu clave de API de Mistral en el campo correspondiente.

En algunas versiones, basta con introducir la clave y elegir un modelo de la lista desplegable; en otras, conviene pulsar el botón “Actualizar lista de modelos” para refrescar las opciones disponibles en tu plan. Podrás escoger entre modelos generales, modelos orientados a código (Codestral) o modelos multimodales como Pixtral, según lo que te interese.

Cuando tengas claro cuál quieres usar, selecciónalo y confirma con OK. El modelo quedará guardado en la lista de modelos del plugin, listo para asignarse a tareas concretas.

Paso 3: configurar el uso del modelo de Mistral

Vuelve a la ventana de Ajustes de IA. Desde ahí puedes decidir qué modelo va a usarse para cada una de las funciones disponibles en la versión actual del plugin:

- Preguntar a la IA para mantener conversaciones y hacerle todo tipo de consultas al chatbot.

- Resumen para comprimir textos largos en unas pocas frases claras.

- Traducción para pasar texto de un idioma a otro.

- Análisis de texto para desglosar significados, matices, definiciones y otros aspectos lingüísticos.

Selecciona el modelo de Mistral que acabas de añadir en las tareas donde quieras que intervenga. Una vez guardada la configuración, podrás usarlo directamente desde la pestaña IA o desde el menú contextual al seleccionar texto, tal y como ocurre con el resto de proveedores.

Otros proveedores compatibles: Gemini, DeepSeek, Groq, Ollama, LM Studio y más

El plugin de IA de ONLYOFFICE se ha diseñado para ser lo más agnóstico posible en cuanto a proveedores. Por eso, además de Mistral, Anthropic y LocalAI, puedes conectar sin problemas una larga lista de servicios y modelos.

Entre los proveedores preconfigurados encontrarás OpenAI, Together AI, Mistral, Groq, GPT4All, Anthropic, Google Gemini, DeepSeek, Ollama, Stability AI, LM Studio y Zhipu AI. Además, a partir de la versión 2.2.2 del plugin, se añadió soporte para proveedores personalizados, lo que significa que puedes integrar prácticamente cualquier servicio compatible con la API adecuada.

Por ejemplo, si quieres usar Google Gemini, bastará con generar una clave válida desde tu cuenta de Google AI Studio y seguir la guía paso a paso para configurarlo en el plugin. Gemini aparece como proveedor predefinido, así que la integración es bastante directa.

Si buscas soluciones europeas, además de Mistral puedes estudiar otras opciones de IA alojadas en la UE y conectarlas como proveedores personalizados, siempre que ofrezcan una API compatible. Si quieres evitar por completo proveedores extracomunitarios, el plugin no te impone ninguno: tú eliges con quién trabajas.

En el caso de plataformas como Ollama o LM Studio, la idea es similar a LocalAI: levantas el servicio local en tu máquina Linux (o en un servidor), seleccionas o descargas el modelo que quieras (por ejemplo, un Llama 3 optimizado, GPT-OSS u otro LLM compatible) y luego apuntas el plugin de ONLYOFFICE a la URL local de esa API.

Qué puedes hacer con la IA en documentos, hojas y presentaciones

Una vez que tengas la IA integrada, es cuando realmente se nota el salto de productividad. La combinación de ONLYOFFICE con uno o varios modelos te permite automatizar una gran cantidad de tareas de contenido, desde lo más básico hasta cosas bastante avanzadas.

En el editor de documentos, puedes pedirle al asistente que genere borradores de artículos, informes, cartas, correos profesionales, publicaciones para blogs o textos educativos. También es capaz de reescribir secciones enteras para ajustarlas a otro tono, nivel de formalidad o tipo de audiencia.

Para la parte más analítica, muchos modelos permiten resumir bloques de texto muy largos, extraer ideas clave, comparar información, explicar tendencias o ayudar a resolver problemas paso a paso (algo especialmente útil si trabajas con informes técnicos o académicos).

Si programas, algunos modelos (como los orientados a código de Mistral, o los de OpenAI y otros proveedores) te ayudan a generar fragmentos de código, explicar funciones, revisar scripts y localizar errores. No sustituye a un IDE, pero es un apoyo muy cómodo mientras redactas documentación o incluyes ejemplos en un informe.

En el terreno de la planificación, la IA puede crear esquemas de proyectos, cronogramas, listas de tareas o plantillas que luego tú adaptas. Esto acelera la fase de arranque de muchos documentos, sobre todo si los tienes que preparar con frecuencia (propuestas, actas, checklists, etc.).

En cuanto a servicios lingüísticos, todos los modelos compatibles con texto pueden traducir, corregir gramática y ortografía, mejorar el estilo, parafrasear y explicar vocabulario. Para documentos multilingües o para usuarios que no dominan un idioma, esto es un plus enorme.

Uso de la IA en presentaciones y colaboración con DocSpace

En el editor de presentaciones, la IA te permite ir mucho más rápido cuando estás preparando diapositivas. Puedes pedirle que genere el texto para cada slide, que lo acorte, lo alargue, lo haga más informal o más corporativo, o que corrija errores ortográficos y gramaticales sobre la marcha.

Con la función “Preguntar a la IA” dentro de las presentaciones, es posible pedir una estructura ideal para una charla, títulos sugerentes para cada sección, ejemplos que hagan más ameno el contenido o incluso consejos sobre cómo exponer el tema frente a una audiencia grande.

En entornos colaborativos, ONLYOFFICE DocSpace está en proceso de recibir una integración más profunda con la IA. La idea es que el asistente pueda aprovechar el contexto de los documentos almacenados en las salas de colaboración para ofrecer sugerencias más inteligentes, aunque siempre manteniendo el foco en la seguridad y la privacidad.

El equipo de desarrollo ya ha adelantado que pretenden ampliar la interacción del chat con el contenido del documento, para que no tengas que estar copiando y pegando manualmente entre la ventana de IA y el fichero que estás editando, y para permitir operaciones más directas sobre el texto seleccionado.

Limitaciones actuales, personalización y futuras mejoras

Ahora mismo, las funciones principales del plugin están centradas en cuatro bloques: chat con la IA, resumen, traducción y análisis de texto. Con eso se cubre buena parte de los casos de uso, pero los desarrolladores han anunciado que quieren ir bastante más allá.

Una de las peticiones más repetidas por la comunidad es la posibilidad de personalizar a fondo las funcionalidades del plugin: definir plantillas de prompts, cambiar el comportamiento de las acciones por defecto, decidir si el texto generado reemplaza al seleccionado, se inserta debajo, se copia al portapapeles, etc.

También se está trabajando en la interfaz. Hoy en día, el plugin aparece como una ventana emergente flotante, pero está en la hoja de ruta permitir usarlo como un panel lateral fijo en la parte izquierda, de forma que la experiencia se parezca más a la de otros asistentes incrustados en suites ofimáticas.

En cuanto a actualizaciones, el plugin de IA no se actualiza de forma automática. Esto tiene su lado bueno y su lado malo: tú controlas cuándo instalar una nueva versión (y así evitas cambios inesperados), pero a la vez tienes que acordarte de revisar de vez en cuando el marketplace para no quedarte atrás.

Respecto a la precisión de las respuestas, ONLYOFFICE deja claro que no asume ninguna responsabilidad sobre la exactitud o fiabilidad de la información generada por los modelos de IA conectados. Al final, la calidad depende del proveedor y del modelo concreto que utilices, así que conviene revisar siempre lo que te devuelve el asistente.

Por último, de momento no puedes definir funciones personalizadas dentro del propio plugin, pero esta característica está prevista para futuras versiones. La idea es que cada usuario pueda adaptar el agente de IA a su flujo de trabajo, con sus propios comandos y herramientas.

Usar ONLYOFFICE sin IA o con otras IAs adicionales

Si eres de los que prefiere evitar la inteligencia artificial siempre que pueda, ONLYOFFICE también piensa en ti. La suite no incluye ningún asistente de IA activado por defecto: si no instalas el plugin desde el marketplace, la IA simplemente no existe en tu entorno de trabajo.

Si cambias de opinión, solo tienes que instalar y configurar el plugin. Y si después de probarlo decides que no es para ti, basta con desinstalarlo o desactivarlo desde el administrador de plugins y volver a la edición tradicional de siempre.

Además del plugin general de IA, en el marketplace de ONLYOFFICE encontrarás otros complementos específicos, como ZhiPu Copilot, basado en el modelo ChatGLM de ZhiPu AI. Este asistente ofrece herramientas similares (resumen, traducción, explicaciones, análisis de texto, prompts personalizados, etc.), pero centradas en el ecosistema de ese proveedor en particular.

En cualquier caso, la filosofía es la misma: tú eliges qué agentes de IA quieres integrar, cómo los configuras y cuándo los usas. No hay funciones de IA impuestas de serie, algo que muchos usuarios valoran frente a otras suites donde la integración viene activada por defecto.

Con todo este ecosistema, usar una IA en ONLYOFFICE para Linux se convierte en algo extremadamente flexible: puedes montar un LLM local con LocalAI, Ollama o LM Studio, tirar de Claude, Mistral o Gemini en la nube, combinar varios modelos según la tarea y, aun así, seguir teniendo el control total sobre tu entorno, tus datos y tu forma de trabajar día a día con documentos, hojas y presentaciones.

Redactor apasionado del mundo de los bytes y la tecnología en general. Me encanta compartir mis conocimientos a través de la escritura, y eso es lo que haré en este blog, mostrarte todo lo más interesante sobre gadgets, software, hardware, tendencias tecnológicas, y más. Mi objetivo es ayudarte a navegar por el mundo digital de forma sencilla y entretenida.