- Transformar un archivo en dataset intelectual implica vectorizar el corpus, construir grafos de relaciones y conectar un asistente de IA que lo explore por ideas.

- La calidad, localización y evaluación rigurosa del dataset son tan decisivas como la arquitectura del modelo para obtener una IA fiable y contextualizada.

- La anotación de datos, apoyada en herramientas específicas y procesos de control de calidad, convierte el archivo en materia prima entrenable para múltiples tareas.

- Archivos personales, repositorios abiertos y datos simulados se combinan para crear ecosistemas de datasets aplicables a sectores como salud, transporte, finanzas o educación.

Convertir un archivo personal en un dataset intelectual vivo y útil ya no es cosa de grandes laboratorios: cualquiera que lleve años produciendo contenido digital puede transformar ese histórico en una base de conocimiento navegable y en combustible para sistemas de inteligencia artificial. Lo interesante no es solo guardar todo lo que has escrito en el formato adecuado, sino lograr que esas piezas dialoguen entre sí, se relacionen y puedan ser consultadas por ideas, contextos o actores, más allá de una simple búsqueda por palabras clave.

Ese salto de un archivo estático a un dataset curado, anotado y localizable abre la puerta a usos que van desde un asistente personal entrenado con tus propios textos hasta la construcción de modelos lingüísticos ajustados a una cultura o sector concretos. En este artículo vamos a desgranar, con calma y sin humo, qué significa tratar un archivo como dataset intelectual, cómo se construye técnicamente, qué implica traducirlo o anotarlo bien, qué herramientas entran en juego y en qué ámbitos reales se está utilizando ya.

De archivo disperso a dataset intelectual navegable

Imagina que llevas más de una década escribiendo artículos sobre tecnología, regulación, privacidad o inteligencia artificial en una misma plataforma. Pides un volcado completo de tus textos (un archivo plano con miles de documentos) y lo recibes en cuestión de minutos. Sobre el papel, ese archivo es valioso: concentra catorce años de evolución de tu pensamiento. Pero mientras siga siendo solo texto sin estructura, apenas podrás hacer algo más que buscar por palabras sueltas.

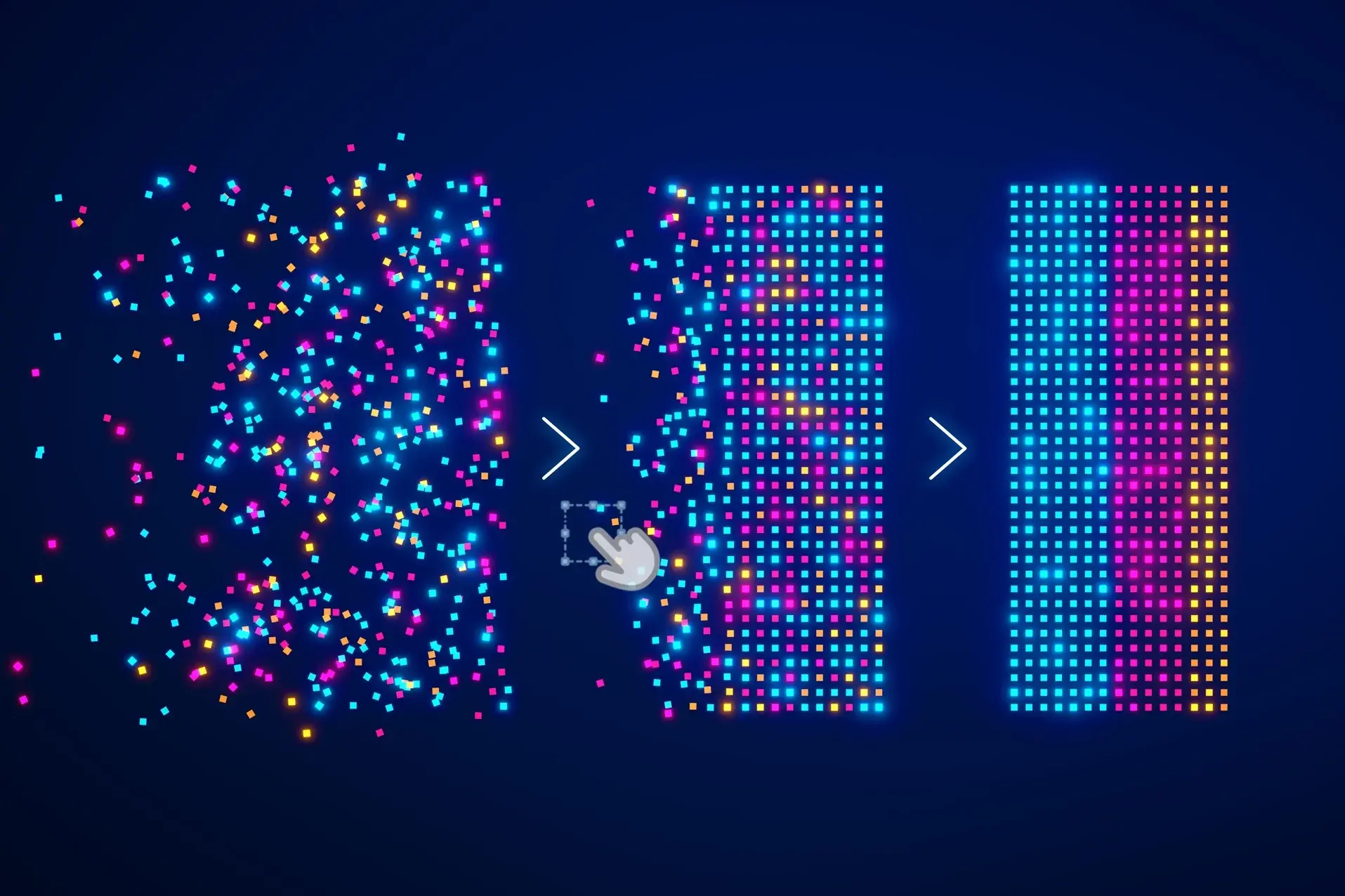

El primer giro conceptual consiste en dejar de ver ese archivo como una pila de documentos y empezar a tratarlo como un corpus coherente susceptible de ser indexado y explorado. La idea es transformar cada artículo en una representación numérica que capture su significado, almacenar esos vectores en una base de datos especializada y construir sobre ello un grafo de relaciones y un asistente que conozca íntimamente ese espacio semántico.

En un caso práctico real con 4.209 artículos escritos en inglés a lo largo de catorce años, el autor utilizó un modelo de embeddings multilingües (paraphrase-multilingual-mpnet-base-v2, de sentence-transformers) para convertir cada texto en un vector de 768 dimensiones. Estos vectores se almacenaron en ChromaDB, una base de datos vectorial de código abierto. Todo el proceso, ejecutado en un servidor estándar sin GPU, se completó en unos cinco minutos: el archivo plano se convirtió en un espacio continuo de ideas.

En la práctica, esto implica que ya no buscas «por palabras» sino por conceptos, preguntas o fragmentos de texto. Puedes plantear consultas del tipo «¿cuándo empecé a escribir sobre monopolios tecnológicos?» o «¿qué artículos están conceptualmente cerca de este argumento?» y el sistema responde localizando los vectores más próximos en ese espacio semántico, aunque no compartan el mismo vocabulario. Es una forma muy directa de extender tu memoria sobre tu propio trabajo.

Sobre esa capa vectorial se construyó además un grafo con NetworkX, donde cada nodo representa un artículo y las aristas conectan textos que comparten etiquetas temáticas o que superan un cierto umbral de similitud semántica. Visualizado en herramientas como Gephi, el resultado es un mapa de tu producción intelectual organizado en clusters: regulación, plataformas, privacidad, inteligencia artificial, movilidad eléctrica… y también conexiones inesperadas entre textos separados por años pero muy próximos en ideas.

Un asistente personal agéntico como puerta de entrada al archivo

La otra pieza clave de este enfoque es contar con un asistente de inteligencia artificial anclado a tu dataset que pueda operar como colaborador continuo, no como simple chatbot en una pestaña del navegador. En el ejemplo anterior, ese asistente se bautizó como Bautista: una instancia agéntica basada en modelos de Anthropic (Claude Sonnet 4.6) pero capaz de trabajar con otros modelos según la API utilizada.

Bautista vive en el propio servidor del autor y se orquesta mediante una plataforma de infraestructura tipo OpenClaw, que gestiona la memoria persistente entre sesiones, los canales de comunicación (por ejemplo, Telegram), las tareas programadas y el acceso a herramientas como el sistema de archivos o la ejecución de scripts. Gracias a esto, el asistente mantiene continuidad en el tiempo: recuerda proyectos previos, conserva archivos, automatiza procesos y puede actuar de forma autónoma cuando se le indica.

La diferencia frente a abrir un modelo genérico en el navegador es que aquí no hablamos de un «chat más», sino de algo más parecido a un colaborador embebido en tu infraestructura, especializado en tu propio corpus y capaz de hacer de intermediario entre ese archivo vectorizado y tus necesidades diarias: localizar textos, detectar redundancias, recuperar citas, ejecutar análisis específicos o lanzar scripts de mantenimiento.

Además, el sistema se diseñó para que el archivo se mantenga vivo sin intervención manual. Cada vez que el autor publica un nuevo artículo en Medium y comparte el enlace con acceso completo en Bluesky, un proceso programado interroga la API pública de Bluesky diariamente, detecta la nueva entrada, descarga el texto, genera su embedding y lo añade a ChromaDB. Ese pipeline automatizado garantiza que el dataset se actualice solo, gracias a tareas de indexación de archivos, evitando el clásico problema de las bases de conocimiento que se quedan obsoletas porque actualizarlas da pereza.

En una fase posterior, se añadieron nuevas capas de análisis, como el reconocimiento de entidades nombradas (personas, empresas, tecnologías, países, instituciones) sobre todo el corpus, con el objetivo de estudiar la evolución temporal de menciones y redes de co-ocurrencia. Gracias a ello, se puede ver cuándo aparece un actor como OpenAI en los textos, cuándo desaparece Google+ o cómo se relacionan distintos agentes a lo largo del tiempo, acercando el sistema más al análisis de discurso a gran escala que a un simple archivo personal.

Dataset, modelo y comportamiento: el archivo como materia prima de la IA

En el contexto de la inteligencia artificial, un dataset es mucho más que una colección de datos: es el material de entrenamiento que moldea el comportamiento del modelo. En procesamiento del lenguaje natural (PLN), ese dataset suele tomar la forma de textos, diálogos, instrucciones o anotaciones que permiten a los modelos aprender a traducir, resumir, dialogar o clasificar emociones, entre otras tareas.

Durante años, el énfasis estuvo puesto casi exclusivamente en la arquitectura del modelo (número de parámetros, tipo de capas, capacidad de cómputo), pero la experiencia reciente ha demostrado que la calidad, diversidad y adecuación de los datos de entrenamiento pesan tanto o más que el diseño del modelo. Como señalan trabajos como los de Bender et al. o Paullada et al., los modelos no son mejores que los datos que los alimentan: si el dataset es sesgado, incompleto o poco representativo, la IA reproducirá esos mismos defectos.

Este cambio de perspectiva ha impulsado un movimiento claro hacia la calidad por encima de la cantidad. No se trata solo de recopilar volúmenes ingentes de texto, sino de que esos datos estén alineados con el idioma, la variedad regional y el contexto cultural en el que se desplegará la IA (Blasi et al., Kreutzer et al.). Esto es especialmente relevante si pensamos en un archivo como dataset intelectual: el corpus personal de un autor puede ser muy rico, pero si luego se quiere usar para modelos que operen en otros idiomas o mercados, la curación y la adaptación se vuelven críticas.

Además, el dataset no solo sirve para entrenar, sino también para evaluar el rendimiento del modelo. Si se evalúa con datos que el modelo ya vio durante el entrenamiento (contaminación de datos), se obtienen métricas engañosas que ocultan sus limitaciones reales, como analizan Dong et al. o Samuel et al. Por eso, cuando trasladamos un archivo personal a un contexto de IA, es clave distinguir qué partes se usan para entrenar, cuáles para validar y cuáles para probar, así como diseñar conjuntos de evaluación ricos y desafiantes, en vez de pruebas triviales que todos los modelos superan.

Traducir y localizar datasets: mucho más que pasar texto de un idioma a otro

Cuando se quiere reutilizar un archivo como dataset intelectual en varios idiomas o mercados, aparece un reto específico: la traducción y localización del corpus. A primera vista puede parecer un proyecto de traducción más, pero un dataset de IA está formado muchas veces por fragmentos aislados, diálogos sueltos, instrucciones cortas o datos estructurados sin contexto narrativo claro, lo que cambia por completo las reglas del juego.

En muchos conjuntos de datos encontramos contexto muy limitado: frases sin información sobre quién habla, en qué situación o con qué intención. El traductor tiene que inferir funciones pragmáticas (una orden, una duda, un insulto, una ironía) para que el modelo aprenda bien el comportamiento en el idioma de llegada. A ello se suman elementos que no deben tocarse, como fragmentos de código, variables, placeholders o etiquetas técnicas, donde una traducción ingenua puede romper el dataset.

También entra en juego la coherencia masiva: decisiones aparentemente pequeñas, como optar por «tú» o «usted», manejar el género inclusivo o el tratamiento de ciertos anglicismos, se multiplican por millones de ejemplos. Una inconsistencia que en un libro podría pasar desapercibida aquí se convierte en ruido que el modelo interioriza. Y, a diferencia de la traducción editorial, a menudo conviene conservar errores gramaticales o coloquialismos tal cual aparecen, porque el objetivo no es «pulir» el texto, sino enseñarle a la IA cómo se expresa de verdad la gente.

Por eso, más que traducir, conviene hablar de localizar datasets. Esto implica adaptar referencias culturales, nombres de instituciones, marcas, formatos de fecha, monedas o unidades de medida, y ajustar el registro a las normas sociales del mercado objetivo. En grandes modelos de lenguaje, esta localización es lo que marca la diferencia entre una IA que simplemente «habla español» y otra que entiende matices culturales, expectativas de cortesía y referencias locales.

Empresas con larga trayectoria en localización de software y contenidos, como imaxin, han ido evolucionando hacia la traducción y curación específica de datasets, combinando experiencia humana, guías de estilo muy afinadas, glosarios controlados y herramientas de traducción asistida y automática. Su enfoque se parece más a un proceso de control de calidad de datos que a una traducción tradicional: definición precisa de criterios lingüísticos y técnicos, gestión de errores deliberados, uso de QA automatizado y muestreos estadísticos para vigilar la consistencia.

Dataset anotado: dar estructura y significado a los datos

Para que un archivo se convierta en un dataset intelectual realmente útil para modelos supervisados, no basta con recopilar textos: hay que anotarlos. Un conjunto de datos anotado es aquel en el que a cada elemento (imagen, fragmento de audio, frase, tabla) se le han añadido metadatos que describen su contenido o función: etiquetas, categorías, entidades, relaciones, transcripciones, bounding boxes, etc.

En visión artificial, por ejemplo, las anotaciones pueden incluir etiquetas de clasificación global, cuadros delimitadores alrededor de objetos, máscaras de segmentación que asignan una categoría a cada píxel, anotaciones de puntos clave (articulaciones humanas, puntos faciales) o trayectorias a lo largo de un vídeo. En texto, hablamos de anotaciones de entidades nombradas (personas, organizaciones, lugares), clasificación de documentos, análisis sintáctico, relaciones entre entidades o etiquetas de sentimiento.

El objetivo de todo este trabajo es que los modelos dispongan de ejemplos claros de lo que deben reconocer o predecir. Un dataset de imágenes anotadas con gatos, coches y peatones permite entrenar modelos que detecten y clasifiquen esos objetos; un dataset de conversaciones con etiquetas de intención y emoción permite entrenar chatbots y sistemas de análisis de sentimientos; un corpus documental con entidades marcadas y relaciones explícitas sienta las bases para sistemas de extracción de conocimiento.

La anotación no se limita a texto o imágenes: en audio encontramos tareas como la transcripción, el etiquetado de eventos sonoros (aplausos, risas, disparos), la segmentación por locutor o la marca temporal de palabras clave. Y en datos multimodales (vídeo con audio y subtítulos, por ejemplo) se trabaja en la alineación entre modalidades y en la anotación conjunta de interacciones (expresión facial más tono de voz más contenido textual).

En el ámbito de datos estructurados y tabulares, anotar también significa explicar el significado de columnas y valores, relacionar entradas equivalentes entre bases de datos o marcar atributos relevantes para tareas de predicción. Cada tipo de proyecto elegirá uno u otro conjunto de anotaciones, y a menudo se combinan varias para cubrir casos de uso complejos.

Herramientas y procesos para anotar un archivo como dataset

La anotación de datos a escala requiere herramientas específicas y flujos de trabajo bien pensados. No es lo mismo etiquetar a mano unas cuantas decenas de imágenes que gestionar cientos de miles de ejemplos en múltiples formatos con equipos repartidos por varios husos horarios.

En visión artificial se utilizan soluciones de código abierto como LabelImg (para cuadros delimitadores), CVAT (para anotación compleja de imágenes y vídeos, con funciones colaborativas) o plataformas comerciales como Labelbox o SuperAnnotate, que incorporan analítica de calidad, control de proyectos y automatización. Para texto, herramientas como Prodigy, LightTag, BRAT o Datasaur facilitan la anotación de entidades, clasificaciones, dependencias sintácticas y relaciones, con seguimiento detallado de anotadores y conflictos.

En audio, software como Label Studio, Praat o Sonix permite segmentar, transcribir y etiquetar sonidos con precisión. Para datos multimodales, proyectos ligeros como el anotador de imágenes VGG (VIA) o aplicaciones como RectLabel ofrecen una base versátil para sincronizar anotaciones entre tipos de datos. Y en proyectos que requieren alto volumen y rapidez, entran en juego plataformas de automatización y colaboración masiva como Amazon SageMaker Ground Truth, Scale AI, DataLoop o soluciones colaborativas como Digma o Hive Data.

Elegir herramienta no es solo cuestión de gustos: hay que tener en cuenta tipo de datos, presupuesto, tamaño del equipo, necesidad de colaboración en tiempo real y volumen del dataset. Casi todas las plataformas avanzadas incorporan funciones para validar reglas básicas, gestionar conflictos, medir productividad y calidad, y combinar anotación humana con sugerencias automáticas generadas por modelos previos.

Más allá de la herramienta, la calidad se juega en el proceso. Es imprescindible proporcionar guías de anotación muy claras y actualizadas, formar a los anotadores (más aún en dominios sensibles como la medicina), organizar revisiones cruzadas, definir métricas de calidad (concordancia inter-anotador, precisión, recall) y recurrir a datos «gold standard» validados por expertos para calibrar al equipo. La anotación de un archivo como dataset intelectual no es un sprint, sino un ciclo iterativo continuo.

En muchos proyectos se opta por un enfoque híbrido: se automatizan las tareas sencillas o repetitivas (por ejemplo, detección preliminar de objetos o preclasificación de textos) y se reserva el trabajo humano para casos ambiguos, complejos o de alto impacto. Esto reduce costes sin sacrificar calidad y permite que los anotadores se centren donde más aportan valor.

Aplicaciones reales de los conjuntos de datos anotados e intelectuales

Tratar un archivo como dataset intelectual no es un ejercicio teórico: tiene aplicaciones muy concretas en múltiples sectores donde la anotación y la curación son claves para desplegar IA fiable. En visión por computador, por ejemplo, los conjuntos de imágenes y vídeos anotados permiten desarrollar sistemas de reconocimiento facial, detección de anomalías en radiografías o resonancias, inspección automatizada en fábricas o vehículos autónomos que identifican peatones, señales y obstáculos en tiempo real.

En procesamiento del lenguaje natural, los datasets anotados y bien localizados habilitan tareas como el análisis de sentimientos en redes sociales, la clasificación de consultas en servicios de atención al cliente, la extracción de entidades en documentos legales, la traducción automática o el entrenamiento de chatbots que entienden matices emocionales y contextos culturales. Un archivo personal de artículos se puede convertir en la base de un asistente especializado que, antes de publicar algo nuevo, revise lo ya dicho, detecte repeticiones o identifique cambios de postura a lo largo de los años.

La salud y la biotecnología dependen cada vez más de datasets anotados con gran precisión: imágenes médicas con diagnósticos confirmados, registros clínicos estructurados, secuencias genómicas etiquetadas con mutaciones relevantes. En automoción y transporte, los datos son esenciales para la conducción autónoma, la planificación inteligente de rutas y la gestión del tráfico. En comercio y banca, se utilizan para recomendadores de productos, detección de fraude y análisis de riesgo.

Otros campos como la agricultura de precisión, el medio ambiente, la seguridad y defensa, los videojuegos, la realidad virtual, la educación o la investigación científica recurren a conjuntos de datos anotados para monitorizar cultivos, analizar imágenes satelitales, crear experiencias inmersivas, personalizar el aprendizaje o acelerar hallazgos en biología o astrofísica. En todos ellos, la lógica es similar: cuanto mejor estructurado y documentado (por ejemplo, con archivos README) esté el dataset, mejores serán los modelos diseñados sobre él.

Si miramos el archivo como dataset intelectual en clave personal, el valor está en poder consultar al vuelo todo lo que sabes y has escrito, entender cómo han evolucionado tus ideas, descubrir lagunas temáticas, conectar textos lejanos en el tiempo y apalancar esa memoria extendida en otros contextos, como la docencia, la investigación o la estrategia empresarial. Todo ello sin delegar la escritura en la máquina, sino usando la IA como soporte para verificar datos, buscar referencias o poner a prueba argumentos.

Dónde encontrar datasets y cómo se está automatizando su creación

No todos los datasets nacen de archivos personales: muchos proceden de repositorios abiertos y fuentes públicas que resultan útiles para entrenar y evaluar modelos, o para proyectos de investigación, periodismo de datos y análisis estratégico. Internet reúne ya un buen número de fuentes que se pueden aprovechar, siempre con el debido cuidado legal y ético.

La red social X (antigua Twitter), por ejemplo, ofrece APIs que permiten recolectar tuits filtrando por hashtags y otros criterios, datos que después se pueden estructurar en tablas y visualizar con herramientas como Tableau. Google Dataset Search proporciona un buscador especializado de conjuntos de datos públicos donde localizar desde bases empresariales hasta estadísticas sectoriales. Blogs como FiveThirtyEight publican sus datasets sobre política, deporte y sociedad para que cualquiera pueda replicar o extender sus análisis.

En paralelo, cada vez se usan más entornos simulados para generar datos anotados automáticamente, sobre todo en campos como los vehículos autónomos, donde recrear todas las condiciones de la realidad en el mundo físico sería lento, caro y peligroso. Los simuladores permiten producir imágenes y vídeos con anotaciones perfectas (posiciones de objetos, condiciones meteorológicas, trayectorias) y explorar escenarios extremos difíciles de capturar en datos reales.

El futuro apunta a una combinación de datos reales curados, archivos personales tratados como corpus intelectuales y datos sintéticos generados en simulación, todo ello coordinado con técnicas de aprendizaje supervisado, semi-supervisado, no supervisado y autosupervisado. La anotación seguirá siendo una pieza clave, pero cada vez más asistida por modelos que proponen etiquetas, detectan inconsistencias y miden sesgos, dejando a las personas las decisiones más finas.

En este contexto, cobra peso la dimensión ética y regulatoria: manejar archivos personales como datasets exige respetar privacidad, derechos de autor y expectativas de uso, mientras que las plataformas de crowdsourcing o colaboración masiva deben asegurar condiciones justas para los anotadores y transparencia sobre qué modelos se entrenan con los datos que generan.

Cuando se cuida toda esta cadena —desde la extracción de un archivo personal hasta su vectorización, grafado, localización, anotación, automatización de actualizaciones y conexión con asistentes de IA— se obtiene algo que muy pocos autores, empresas u organizaciones tienen hoy: un dataset intelectual profundo, consistente y vivo, capaz de alimentar sistemas de inteligencia artificial realmente alineados con la voz, el contexto y los objetivos de quienes los impulsan, y de servir como memoria extendida en un mundo cada vez más saturado de información.

Redactor apasionado del mundo de los bytes y la tecnología en general. Me encanta compartir mis conocimientos a través de la escritura, y eso es lo que haré en este blog, mostrarte todo lo más interesante sobre gadgets, software, hardware, tendencias tecnológicas, y más. Mi objetivo es ayudarte a navegar por el mundo digital de forma sencilla y entretenida.