- Parte de los vídeos captados con las gafas Ray-Ban Meta se envía a empresas como Sama en Kenia, donde trabajadores humanos los revisan y etiquetan para entrenar la IA.

- Los revisores aseguran ver escenas íntimas, datos bancarios y momentos privados, pese a que Meta afirma anonimizar y filtrar el contenido antes de su análisis.

- Las condiciones de Meta AI permiten la revisión manual y el uso de datos para entrenar modelos, algo que choca con la percepción y el consentimiento real de muchos usuarios.

- Autoridades europeas de protección de datos investigan el tratamiento y la transferencia internacional de estas grabaciones, poniendo el foco en el cumplimiento del GDPR.

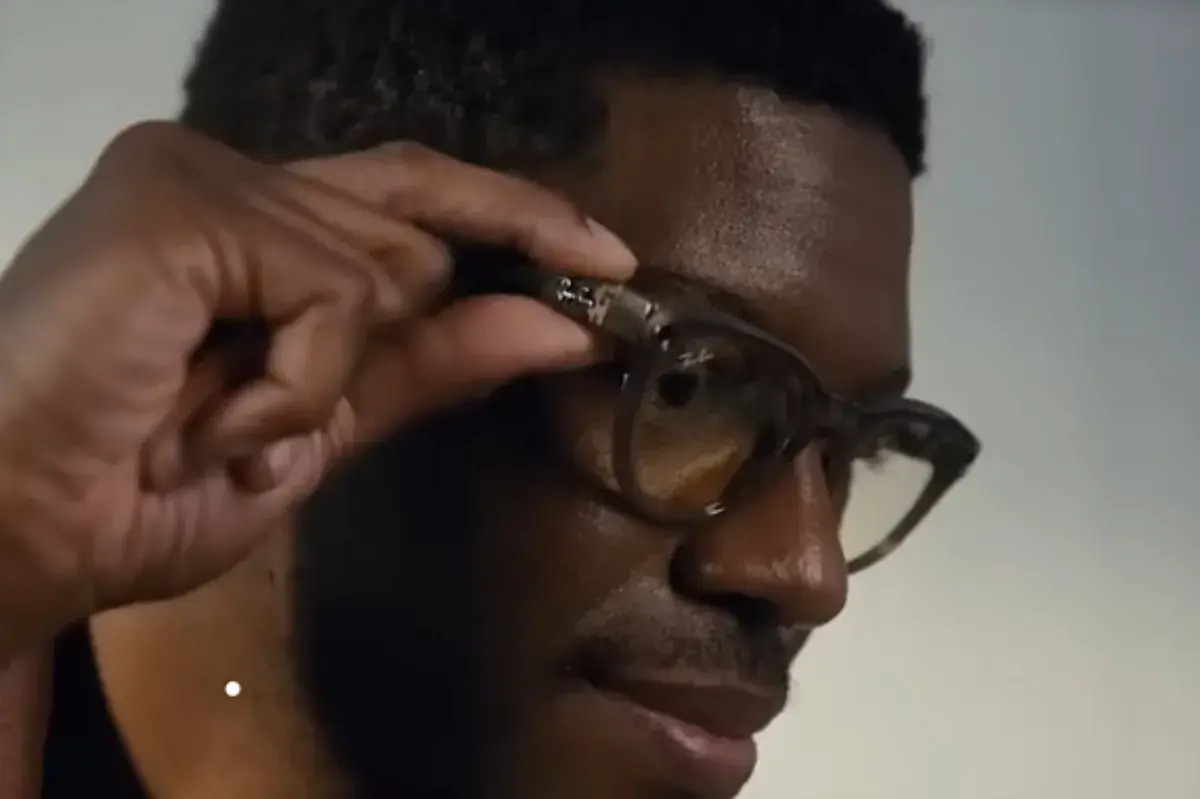

Las gafas Ray-Ban Meta con cámara e inteligencia artificial se han convertido en uno de los gadgets de moda: graban lo que ves, responden a la voz y permiten compartir contenido en segundos. Pero tras ese discurso de tecnología cool y futurista, varias investigaciones periodísticas han destapado una realidad mucho menos glamurosa: los vídeos grabados pueden acabar siendo vistos por personas reales al otro lado del mundo, incluidos momentos extremadamente privados.

En los últimos meses, medios suecos como Svenska Dagbladet y Göteborgs-Posten, así como múltiples análisis posteriores, han sacado a la luz cómo Meta se apoya en empresas subcontratadas en Kenia para revisar y etiquetar parte de las grabaciones de estas gafas. Esa práctica, recogida en la letra pequeña de las condiciones de Meta AI, ha encendido todas las alarmas sobre privacidad, transparencia y protección de datos, especialmente en Europa.

Cómo funcionan las Ray-Ban Meta y qué graban realmente

Las Ray-Ban Meta son, en apariencia, unas gafas de sol o de vista “normales” con cámara, micrófonos y conexión a internet. Integran un asistente de inteligencia artificial capaz de hacer fotos, grabar vídeo, traducir conversaciones, reconocer objetos y responder a comandos de voz con solo decir “Ey Meta”.

Para muchas personas, esto supone una forma muy cómoda de crear contenido “en la vida real” (IRL) sin tener que sacar el móvil del bolsillo: pulsas un botón físico en la montura o activas la orden por voz y las gafas empiezan a grabar desde tu propio punto de vista. Esa facilidad elimina la fricción a la hora de grabar y hace que se filmen escenas cotidianas que antes nunca se habrían registrado.

Según explica Meta, las grabaciones quedan almacenadas en el dispositivo y se sincronizan con el móvil a través de la aplicación correspondiente. Hasta aquí, nada muy distinto a una cámara tradicional. El matiz clave llega cuando el usuario utiliza funciones vinculadas a Meta AI, el asistente integrado: en ese momento, parte de esos datos se envían a los servidores de la compañía para ser procesados en la nube.

La propia empresa reconoce en sus términos de uso que, para que la IA funcione, es necesario procesar voz, texto, imágenes y, en ocasiones, vídeo en sus sistemas. El Usuario puede tener la sensación de que todo se gestiona de forma local en el móvil, pero las investigaciones técnicas han mostrado tráfico constante hacia infraestructuras de Meta en Europa, incluso cuando se rechaza compartir “datos extra” para mejorar productos.

Esto significa que el asistente no es un simple software que corre en tu teléfono: gran parte de la magia de la IA se apoya en servidores remotos, y ahí es donde entra en juego la revisión, tanto automática como humana, de ciertos contenidos.

Los “anotadores” en Kenia: personas que ven lo que graban las gafas

La clave del escándalo es el trabajo de los llamados “anotadores de datos” o data annotators, empleados por empresas como Sama, con sede en Nairobi (Kenia), que prestan servicios a gigantes tecnológicos como Meta. Su labor consiste en ver, uno por uno, fragmentos de vídeo, imágenes y audio para etiquetar todo lo que aparece en ellos.

Estos trabajadores describen que su día a día pasa por marcar objetos (“lámpara”, “coche”, “ordenador”), personas, acciones y señales en miles de fotogramas. Dibujan contornos, asignan etiquetas, validan descripciones generadas por la IA y corrigen posibles errores. Gracias a ese etiquetado manual, los algoritmos aprenden a reconocer mejor el entorno y a responder con más precisión cuando el usuario pregunta algo con las gafas puestas.

El problema es el tipo de material al que acceden. Según varios testimonios recogidos por los periódicos suecos y repetidos en diferentes medios, los revisores ven desde escenas de un salón cualquiera hasta cuerpos desnudos, gente saliendo del baño, parejas manteniendo relaciones sexuales o tarjetas bancarias en primer plano. Uno de ellos resumía su experiencia con una frase demoledora: “Vemos de todo, desde salones hasta cuerpos desnudos”.

Los propios empleados reconocen que, muchas veces, las personas grabadas ni siquiera son conscientes de que están siendo filmadas. Puede ser alguien que pasa por detrás mientras se habla con la IA, una pareja que sale de la ducha mientras las gafas siguen encendidas o una persona que se cambia de ropa pensando que no hay ninguna cámara activa. Para los anotadores, la sensación es la de estar mirando “dentro de casas ajenas” por obligación laboral.

Además de imágenes, estos equipos también trabajan con transcripciones de audio y consultas que los usuarios hacen al asistente. Ahí aparece otra dimensión complicada: hay preguntas sobre temas delicados, protestas, posibles delitos o lo que un empleado definió como “cosas muy oscuras”. Todo eso pasa por ojos y oídos humanos como parte del proceso de verificación y entrenamiento de la IA.

Qué dice Meta: letra pequeña, legalidad y límites difusos

Meta no niega que exista revisión humana de contenidos vinculados a Meta AI. De hecho, lo recoge claramente en la documentación de privacidad: algunas interacciones pueden revisarse de forma automatizada o manual por terceros colaboradores con el fin de mejorar los servicios y la experiencia del usuario.

La compañía sostiene que los vídeos grabados permanecen en las gafas o en el móvil salvo que el usuario decida compartirlos con la IA o utilice funciones que impliquen procesamiento en la nube. Es en ese momento cuando determinados fragmentos pueden enviarse a empresas como Sama para su análisis y etiquetado, exactamente igual que hacen otras tecnológicas con sus asistentes y modelos de IA.

En cuanto a la privacidad, Meta asegura aplicar mecanismos de “anonimización” y filtrado antes de que el contenido llegue a los anotadores: difuminado de caras, ocultación de datos sensibles y eliminación de elementos claramente identificables. En teoría, el material ya no debería permitir reconocer personas o situaciones concretas, al menos no con facilidad.

Sin embargo, antiguos empleados y revisores actuales apuntan a que los algoritmos de anonimización fallan con cierta frecuencia, especialmente en escenas con mala iluminación o ángulos complicados. Resultado: en muchos clips, las caras, cuerpos y detalles confidenciales se ven con total nitidez. Esa brecha entre el discurso oficial y lo que se vive en los centros de etiquetado es lo que ha encendido todas las alarmas.

Desde el punto de vista legal, Meta se cubre señalando en sus términos que el usuario no debe compartir información que no quiera que la IA use o conserve, incluyendo datos sobre temas delicados. También deja claro que, si no se acepta ese marco, no se pueden utilizar ciertas funciones de Meta AI. En la práctica, esto plantea un dilema: para disfrutar del producto tal y como se anuncia, el usuario acaba aceptando un nivel de tratamiento de datos que quizá no comprende del todo.

Escenas íntimas, datos bancarios y otras situaciones sensibles

Los testimonios de trabajadores de Sama y otras subcontratas dibujan un panorama especialmente incómodo. Algunos describen haber visto personas usando el baño, quitándose la ropa, saliendo desnudas de la ducha o manteniendo relaciones sexuales mientras las gafas seguían grabando. No se trata de contadas excepciones, sino de un material que aparece de forma recurrente entre los vídeos que deben etiquetar.

Otros empleados cuentan que han llegado a visualizar tarjetas de crédito, cuentas bancarias en pantalla, contraseñas introducidas en el móvil u otros documentos que, de filtrarse, podrían causar un daño considerable a la reputación o al bolsillo de los afectados. Aunque los revisores están sujetos a acuerdos de confidencialidad muy estrictos, la inquietud existe: si esos clips salieran a la luz, el escándalo sería enorme.

Los centros de trabajo donde se realiza este etiquetado están fuertemente vigilados: hay cámaras de seguridad, se prohíbe llevar móvil u otros dispositivos capaces de grabar y se monitoriza a los empleados. Las penalizaciones por romper el contrato de confidencialidad pueden significar el despido en un contexto económico complicado, lo que actúa como elemento disuasorio potente.

Pero el hecho de que haya tantos controles no elimina la cuestión de fondo: ¿son realmente conscientes los usuarios y las personas grabadas de que sus escenas más privadas pueden acabar en una pantalla a miles de kilómetros? La respuesta que se repite es que no. Ni los compradores, ni mucho menos quienes aparecen en segundo plano, tienen una comprensión real de hasta qué punto sus datos pueden circular.

Las propias investigaciones periodísticas muestran que muchos dependientes que venden las gafas en tiendas físicas no saben explicar con claridad qué ocurre con los datos. Algunos aseguran que “todo se ejecuta de manera local”, otros dicen que “no se comparte nada con Meta” o simplemente reconocen que no lo tienen claro. Esa falta de información en el punto de venta alimenta aún más la sensación de opacidad.

Consentimiento, GDPR y el foco de las autoridades europeas

En Europa, el tema no se queda solo en el debate mediático. La normativa de protección de datos, especialmente el Reglamento General de Protección de Datos (RGPD/GDPR), exige que las empresas expliquen de forma clara y comprensible qué datos recogen, cómo los usan y con quién los comparten.

Tras las revelaciones del reportaje sueco, la autoridad irlandesa de protección de datos, responsable principal de supervisar a Meta en la UE, ha pedido explicaciones a la compañía. Quiere saber, entre otras cosas, si las grabaciones de usuarios europeos realizadas con las Ray-Ban Meta se envían a Kenia u otros países sin “decisión de adecuación” y bajo qué garantías se producen esas transferencias internacionales.

En paralelo, la Oficina del Comisionado de Información del Reino Unido (ICO) ha manifestado su preocupación y ha señalado que Meta debe detallar claramente a los consumidores qué se recopila y cómo se utiliza. También han empezado a surgir demandas y advertencias legales sobre si el consentimiento que se obtiene al aceptar las condiciones de Meta AI es realmente válido en un contexto tan complejo.

Expertos de organizaciones como NOYB, muy activa en litigios contra grandes tecnológicas, apuntan a un problema de transparencia: los usuarios pueden no percibir en qué momento exacto las gafas empiezan a grabar para alimentar la IA y qué implicaciones tiene eso para el tratamiento posterior de los datos. Reclaman, además, un consentimiento explícito y separado para el uso de esas grabaciones en el entrenamiento de modelos.

Otro punto sensible es que, una vez que los vídeos entran en el ecosistema de Meta AI y se incorporan a grandes conjuntos de entrenamiento, el control práctico del usuario sobre usos posteriores se diluye. Aunque formalmente existan políticas de borrado o limitación, revertir el impacto real de esos datos en modelos entrenados es técnicamente muy complicado, cuando no imposible.

El riesgo de ser grabado sin saberlo y el papel de la luz LED

Desde que se lanzaron las primeras gafas inteligentes de Meta, especialistas en privacidad vienen avisando del riesgo de grabaciones no consentidas en espacios públicos y privados. Las Ray-Ban Meta incluyen una pequeña luz LED que se enciende cuando la cámara está activa, precisamente como medida para advertir a quienes están alrededor.

Sin embargo, varios críticos sostienen que esa luz puede pasar totalmente desapercibida en ambientes muy iluminados, en la calle a plena luz del día o en locales con muchos focos. También existe el temor de que algunos usuarios tapen deliberadamente el LED, anulando de facto la única señal visible de grabación.

La facilidad para pulsar un botón en la patilla o activar un comando de voz hace que, en la práctica, la línea entre “estoy grabando algo para mí” y “estoy generando datos para una empresa de IA” sea muy fina. El usuario puede creer que simplemente está registrando un momento para su archivo personal, pero si en algún punto pide a la IA que reconozca un objeto, traduzca una conversación o describa la escena, parte de ese contenido puede terminar en circuitos de revisión.

Las investigaciones suecas también han puesto el foco en que no existe una opción realmente clara para excluirse completamente de esa recopilación si se quieren utilizar todas las funciones inteligentes de las gafas. Se puede limitar algo el uso de datos “adicionales”, pero el núcleo del servicio sigue dependiendo de procesar un volumen significativo de información.

Todo esto plantea un nuevo escenario social: en cafeterías, transportes públicos o reuniones, puede haber personas con gafas inteligentes grabando sin que los demás se enteren. Y no solo eso: lo que graben puede acabar siendo visto por terceros lejanos en otro continente, más allá de cualquier relación directa con quienes aparecen en la imagen.

Nearby Glasses y otras respuestas para protegerse

Ante este panorama, han empezado a surgir iniciativas para que la gente pueda defenderse de las grabaciones silenciosas de gafas inteligentes. Una de las más llamativas es la app Nearby Glasses, creada por el desarrollador Yves Jeanrenaud.

Esta aplicación intenta detectar la presencia de gafas Ray-Ban Meta activas a través de las señales Bluetooth que emiten. Cuando las identifica, envía una notificación al móvil del usuario para alertar de que puede haber un dispositivo de este tipo cerca. No es perfecta: a veces confunde esas gafas con otros productos de Meta, como los visores de realidad virtual Quest, generando falsos positivos.

Aun así, el mero hecho de que exista una herramienta así ilustra bien el momento que vivimos: ya no solo debatimos sobre lo que pueden hacer las gafas inteligentes, sino también sobre cómo protegernos de ellas cuando su presencia empieza a ser habitual.

Al mismo tiempo, el revuelo en torno a las Ray-Ban Meta se suma a un historial nada pequeño de polémicas sobre moderación de contenidos y revisión manual en el ecosistema de Meta. Moderadores externos de Facebook e Instagram han denunciado durante años la exposición constante a violencia extrema, abusos y pornografía infantil, con consecuencias graves para su salud mental.

En ese contexto, el trabajo en centros como Sama se percibe como una extensión del mismo modelo: tareas esenciales para el funcionamiento de la IA y las plataformas, pero realizadas por personas en condiciones precarias, a menudo en países en desarrollo como Kenia, India o Filipinas, donde los salarios son mucho más bajos que en Europa o Estados Unidos.

El lado oculto de la IA: trabajo precario y datos de la vida cotidiana

Detrás del discurso de “IA mágica que lo entiende todo” hay una realidad que cada vez se hace más visible: modelos como los de Meta se alimentan de datos reales generados por usuarios y limpiados por trabajadores humanos mal pagados. Sin ese proceso de etiquetado minucioso, la IA no “aprende” a reconocer señales de tráfico, muebles del salón o gestos cotidianos.

Reportajes sobre empresas como Sama han mostrado cómo Kenia se está convirtiendo en un hub de “trabajo sucio digital”: revisión de contenidos traumáticos para moderar redes sociales, etiquetado masivo para modelos de lenguaje y visión, o apoyo remoto a sistemas como los taxis autónomos de Waymo. Todo ello con plantillas sometidas a gran presión psicológica y sueldos muy modestos según estándares occidentales.

Más allá de lo laboral, el valor de todo este proceso está en que los datos que se extraen de la vida diaria permiten perfilar y dirigir servicios y publicidad con enorme precisión. La forma en la que caminamos por la casa, los objetos que nos rodean, lo que vemos en la tele o las conversaciones que mantenemos son, desde el punto de vista de las grandes tecnológicas, oro puro para afinar sus productos.

Fuentes que han trabajado en Meta explican que, teóricamente, los datos especialmente sensibles no deberían entrar en los circuitos de revisión para entrenamiento. La realidad que describen los anotadores en Kenia, con desnudos, sexo o datos bancarios a la vista, muestra que esa barrera no funciona tan bien como se promete.

Al final, la combinación de gafas discretas, funciones de IA atractivas y un modelo de negocio basado en procesar grandes cantidades de información personal convierte a dispositivos como las Ray-Ban Meta en el ejemplo perfecto de la tensión actual entre innovación tecnológica y derechos fundamentales.

Todo esto deja un escenario complejo en el que las gafas de Meta representan a la vez un avance espectacular y un aviso claro: la comodidad de grabar y tener un asistente siempre disponible tiene un precio en forma de datos que viajan, se revisan y se usan para entrenar IA, muchas veces sin que usuarios ni personas grabadas tengan una idea clara de lo que ocurre entre bambalinas. La reacción de reguladores, el escrutinio público y las futuras decisiones legales marcarán hasta qué punto este modelo se corrige, se limita o se normaliza como parte de nuestra vida digital cotidiana.

Redactor apasionado del mundo de los bytes y la tecnología en general. Me encanta compartir mis conocimientos a través de la escritura, y eso es lo que haré en este blog, mostrarte todo lo más interesante sobre gadgets, software, hardware, tendencias tecnológicas, y más. Mi objetivo es ayudarte a navegar por el mundo digital de forma sencilla y entretenida.