- La Raspberry Pi 5 se ha consolidado como plataforma accesible para ejecutar modelos de IA ligeros y agentes que coordinan servicios en la nube, con especial foco en la privacidad y el aislamiento del sistema.

- Los modelos destilados y compactos (DeepSeek, Llama 3.2, Qwen, etc.) permiten chat, traducción y asistencia de código en hardware modesto, aunque con claras limitaciones frente a los grandes LLM comerciales.

- Los aceleradores dedicados como los módulos Hailo (Hailo-8L y Hailo-10H en AI HAT+ 2) impulsan el rendimiento de inferencia, habilitando visión por ordenador y LLM locales en Raspberry Pi 5 con baja latencia.

- La combinación de modelos pequeños, hardware dedicado y domótica convierte a Raspberry Pi en un nodo ideal de IA en el borde, capaz de interpretar comandos y automatizar tareas sin depender de la nube.

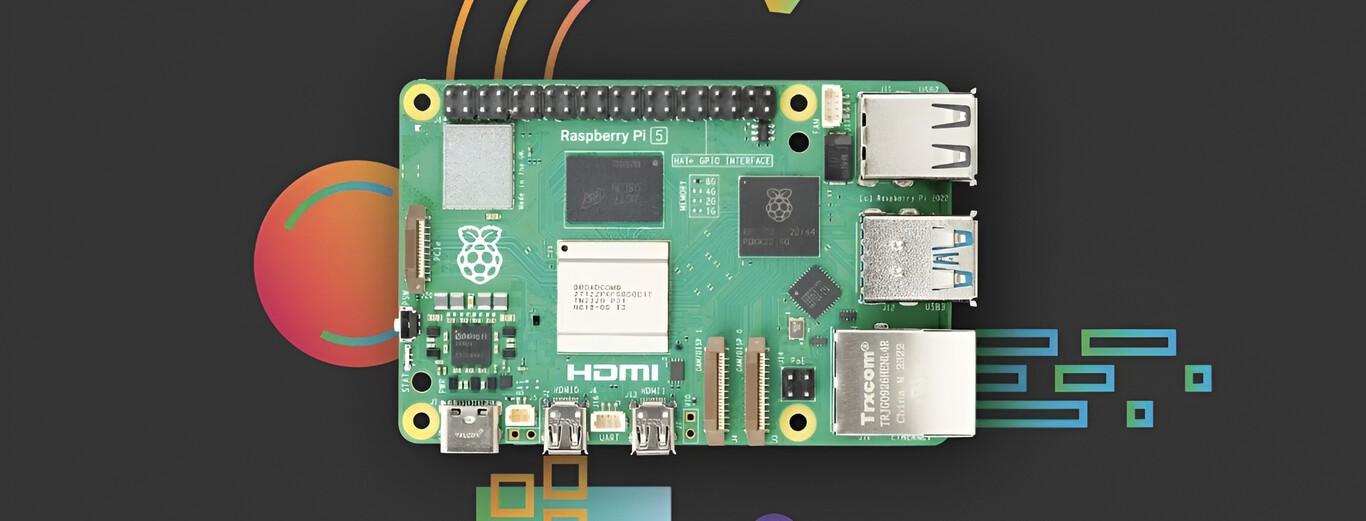

La inteligencia artificial en la Raspberry Pi está viviendo un momento bastante especial. Hasta hace nada, cuando pensábamos en IA imaginábamos o bien un gran chatbot en la nube por suscripción, o bien un ordenador carísimo lleno de GPUs para mover modelos enormes en local. Ahora el panorama ha cambiado: la llegada de agentes como OpenClaw, los modelos destilados tipo DeepSeek y los nuevos aceleradores como AI HAT+ 2 han puesto a la pequeña placa en el centro de la conversación.

Este cambio no es solo una moda pasajera: la combinación de Raspberry Pi 5, modelos ligeros y hardware dedicado de IA permite ejecutar chatbots, traductores, asistentes de código o sistemas de visión por ordenador sin depender de la nube. Todo ello con más control sobre la seguridad, el coste y la privacidad de los datos, aunque también con limitaciones claras que conviene conocer para no llevarse decepciones.

El auge de los agentes de IA y el papel de Raspberry Pi

En los últimos meses se ha hablado mucho de agentes de IA capaces de actuar por su cuenta, y uno de los nombres que más ruido ha generado es OpenClaw. A diferencia de un chatbot clásico que solo responde a mensajes, un agente es un sistema que puede tomar decisiones y ejecutar acciones: lanzar scripts, llamar a APIs, interactuar con servicios externos o manipular archivos dentro de un entorno informático concreto.

Lo interesante es que este tipo de agentes no necesita que el “cerebro” esté en la propia Raspberry Pi. Lo habitual es que el modelo grande corra en la nube, mientras que la placa funciona como orquestador: mantiene la conversación, gestiona el contexto del usuario, lanza comandos en el sistema y actúa como puente entre el mundo físico (sensores, actuadores, domótica) y la IA remota.

Al mismo tiempo, han ido apareciendo configuraciones pensadas para ejecutar modelos más pequeños directamente en el hardware de la Raspberry Pi. Herramientas como Ollama o llama.cpp permiten cargar LLM reducidos y ajustados a la arquitectura ARM, especialmente en modelos como Raspberry Pi 4 o 5 con suficiente memoria RAM. No es magia: se sacrifican capacidades y velocidad, pero para ciertos usos el resultado es perfectamente aprovechable.

Este nuevo escenario ha provocado incluso movimientos en el mercado financiero alrededor de Raspberry Pi, con subidas notables de sus acciones vinculadas al entusiasmo por agentes de IA accesibles. Al final, la idea que se está consolidando es la de pequeños dispositivos físicos dedicados a ejecutar o coordinar IA, en lugar de depender exclusivamente de grandes centros de datos o de ordenadores de sobremesa de gama alta.

Seguridad, aislamiento y dudas sobre el enfoque

Dar a un agente de IA acceso profundo a un sistema no es ninguna broma: un agente con permisos amplios puede leer archivos, mover datos, rellenar formularios web o tocar servicios críticos. Desde el propio ecosistema de Raspberry Pi se remarca que esto implica riesgos reales, porque estos algoritmos no son infalibles y pueden cometer errores o comportarse de forma inesperada; por eso conviene seguir buenas prácticas de seguridad informática.

Aquí entra en juego una de las grandes ventajas de la placa: usar una Raspberry Pi como entorno aislado reduce el impacto de posibles fallos. En lugar de darle control directo a tu ordenador principal, puedes montar un sistema dedicado donde el agente solo tenga acceso a los recursos estrictamente necesarios. Ese “sandbox” físico ayuda a contener daños y a experimentar con algo más de tranquilidad.

No todos están convencidos de que este enfoque sea la panacea. Medios especializados han señalado que la Raspberry Pi ha ido perdiendo parte de su atractivo como opción ultrabarata, sobre todo en configuraciones avanzadas con mucha RAM. Un modelo de Raspberry Pi 5 con 16 GB puede acercarse o superar los 200 dólares, lo que para algunos desvirtúa la idea original de un ordenador de bajo coste para todo el mundo.

En ese sentido, hay voces escépticas que consideran que usar una Raspberry Pi como base para agentes complejos tipo OpenClaw puede no ser la decisión ideal si el presupuesto es ajustado. Entre el coste de la placa, la memoria y los posibles aceleradores de IA, la factura puede subir mucho y acercarse a alternativas más potentes o flexibles.

Aun así, el enfoque de dispositivo dedicado con aislamiento de riesgos sigue siendo muy atractivo: quien valora la seguridad, la privacidad y la experimentación controlada encuentra en la Raspberry Pi un “laboratorio” perfecto donde probar agentes y modelos sin comprometer máquinas de trabajo críticas.

Raspberry Pi 5 como plataforma para modelos de IA locales

Más allá de la parte de agentes, la Raspberry Pi 5 se ha consolidado como una herramienta tremendamente versátil. Sigue siendo fantástica para robótica, electrónica, domótica o multimedia, pero su hardware actual permite ir un paso más allá y usarla como base para proyectos reales de inteligencia artificial en local.

Gracias a su CPU más rápida, sus mejoras en GPU y la posibilidad de montar configuraciones con bastante RAM, la Raspberry Pi 5 es capaz de mover modelos de IA ligeros de forma razonable. No va a sustituir a un servidor lleno de GPUs, pero sí permite experimentar con visión por ordenador, reconocimiento de voz, modelos de lenguaje compactos o asistentes específicos para tareas muy concretas.

Una estrategia habitual consiste en apostar por modelos de código abierto optimizados para hardware limitado. Entre los ejemplos que suelen manejarse están Mistral 7B, algunas variantes pequeñas de Orca o modelos compactos como Microsoft Phi-2, siempre que existan versiones adaptadas y, sobre todo, reducidas con técnicas de cuantización o destilación para caber en memoria.

Es importante entender que estos LLM pequeños no juegan en la misma liga que gigantes como GPT-4. Pierden profundidad, contexto y calidad de respuesta, especialmente en temas muy generales o complejos. A cambio, ofrecen latencias aceptables, menor consumo y la ventaja de no depender de conexiones externas, algo clave cuando se quiere que todo el procesamiento ocurra dentro de la propia placa.

Esta combinación convierte a la Raspberry Pi 5 en una especie de “caja de arena” ideal para aprender, prototipar y desplegar soluciones de IA que no exigen un conocimiento técnico extremo ni inversiones disparatadas, siempre que se tenga muy claro qué se puede esperar y qué no de estos modelos reducidos.

Pasos básicos para poner en marcha IA en una Raspberry Pi 5

Para montar un proyecto que ejecute IA localmente en la Raspberry Pi 5, resulta útil seguir una serie de pasos generales. No es una receta cerrada, pero sí una guía mental de lo que te vas a encontrar cuando empieces a trastear.

El primer punto es elegir un modelo compatible con la arquitectura ARM y con los recursos de la placa. Aquí entran en juego modelos como los mencionados Mistral 7B en versiones muy comprimidas, algunos Orca pequeños o Phi-2 reducidos, además de otros LLM de 1B a 7B parámetros preparados para funcionar en dispositivos modestos. Cuanto más pequeño sea el modelo, más fácil será moverlo, pero también más limitado será.

Después toca la parte de instalar el software de soporte para trabajar con redes neuronales. Dependiendo de lo que busques, puedes tirar de TensorFlow Lite para proyectos de visión, PyTorch si vas a usar determinados repositorios o runtimes específicos como Edge TPU cuando vayas a tirar de aceleradores externos. En el caso de LLM, herramientas como llama.cpp u Ollama facilitan mucho la vida.

Una vez tienes el software, toca configurar el entorno de ejecución en la Raspberry Pi. Eso implica ajustar opciones del sistema, instalar dependencias adicionales, asegurarse de que el modelo está optimizado para ARM y, a menudo, jugar con parámetros como el tamaño de contexto, el nivel de cuantización o el número de hilos para equilibrar rendimiento y consumo de memoria.

Con todo montado, puedes pasar a ejecutar el modelo y empezar a hacer inferencias. Aquí es donde se ve si la combinación hardware-software aguanta. Tendrás que cargar datos, enviar consultas, revisar latencias y ver hasta qué punto la calidad de las respuestas encaja con lo que tenías en mente. Es frecuente tener que ajustar mil detalles hasta que el sistema queda fino. Es aconsejable revisar el espacio en disco con herramientas para analizar y limpiar tu disco.

Si el rendimiento se queda corto, tienes la opción de añadir un acelerador externo para quitarle trabajo a la CPU. Dispositivos como USB Coral con Edge TPU o las nuevas tarjetas basadas en chips Hailo permiten ejecutar redes neuronales a mucha más velocidad y con un consumo energético contenido, lo que cambia por completo la experiencia en muchos casos.

Privacidad, seguridad y ventajas de procesar todo en local

Uno de los argumentos más potentes a favor de usar IA en una Raspberry Pi es la posibilidad de mantener los datos dentro de tu red. Cuando ejecutas un modelo localmente, no estás enviando información personal o sensible a un servidor de terceros, algo especialmente relevante en entornos profesionales, educativos o de domótica avanzada. También conviene aplicar técnicas de backup cifrado a tus copias.

Esto significa que tienes mucho más control sobre quién puede acceder a lo que procesas. Si tu asistente local analiza documentos internos, controla cámaras de seguridad o gestiona historiales de uso de tu vivienda, todo se queda en tu infraestructura. No dependes de políticas cambiantes de privacidad ni de posibles brechas en servicios externos.

En paralelo, la Raspberry Pi funciona casi como un “cortafuegos físico” para tus experimentos de IA. Puedes montar un sistema separado de tu red principal, limitarle el acceso a ciertos recursos y asegurarte de que, aunque el modelo cometa errores extraños o el agente se ponga demasiado creativo, el daño posible esté acotado.

Por supuesto, esto no anula la necesidad de configurar bien permisos, usuarios y reglas de red. Un agente con demasiada libertad en una Pi mal protegida puede seguir siendo un problema. La diferencia es que, al ser un entorno dedicado y barato, es mucho más sencillo auditarlo, rehacerlo desde cero o incluso desconectarlo físicamente si algo se va de madre.

En resumen, para quienes valoran la protección de datos y la capacidad de auditar todo el flujo de información, usar una Raspberry Pi como nodo local de IA ofrece una tranquilidad difícil de conseguir cuando todo depende de servicios en la nube que se gestionan desde fuera de tu organización o de tu hogar.

DeepSeek y la realidad de ejecutar grandes modelos en hardware modesto

Otro nombre que ha sacudido el panorama es DeepSeek, en particular el modelo DeepSeek R1, pensado para razonamiento y con un enfoque muy ambicioso. Muchos titulares han destacado que supera a algunos de los modelos comerciales más avanzados y que se puede ejecutar en local, lo que ha alimentado la idea de tener “un ChatGPT casero” en cualquier máquina.

Conviene poner las cosas en su sitio: la versión completa DeepSeek R1 671B es un monstruo de más de 400 GB y requiere varias GPUs de gama muy alta para funcionar con soltura. Esa es la variante que compite realmente con los grandes modelos de OpenAI o similares, y está totalmente fuera del alcance de una Raspberry Pi o de un PC normalito.

La gran diferencia respecto a otros proveedores cerrados es que, si dispones del hardware, puedes descargar el modelo, montarlo con herramientas como Ollama y ejecutarlo en casa, y en muchos casos necesitarás conectar un disco externo para almacenar los pesos. Pero hablamos de configuraciones de varios miles de euros, con tarjetas tipo RTX 4090, A100 o equivalentes de centro de datos; nada que ver con un microordenador de bajo consumo.

Para que el común de los mortales pueda jugar con DeepSeek en máquinas estándar o en dispositivos como la Raspberry Pi, se recurre a modelos destilados y reducidos. Básicamente son versiones comprimidas del original que retienen parte de su comportamiento a cambio de perder capacidad y conocimiento. Es ahí donde entran variantes de 14B, 7B o incluso 1.5B parámetros.

La pregunta clave es cuánto se pierde en el camino. La relación entre tamaño del modelo, memoria y calidad de la respuesta es muy evidente: si el modelo de referencia son más de 400 GB y la Wikipedia ya ocupa cerca de 100 GB, no es realista esperar que una versión de poco más de 1 GB tenga todo ese conocimiento disponible de forma detallada.

Pruebas reales de DeepSeek en diferentes dispositivos

Para ver estas diferencias en la práctica, resulta útil comparar el comportamiento de las distintas variantes de DeepSeek en hardware variado. En una estación de trabajo con una GPU RTX 3060 de 12 GB de VRAM se puede ejecutar razonablemente bien la versión de 14B parámetros, e incluso forzar la de 32B tirando de RAM del sistema, aunque las velocidades caen de forma notable.

Si se prueba la versión en la nube de DeepSeek, sin limitaciones de hardware locales, el modelo grande funciona con soltura y demuestra claramente por qué compite con los gigantes del sector. La diferencia se nota tanto en la velocidad como en la coherencia de las respuestas y su capacidad para manejar instrucciones complejas.

Cuando se baja al terreno de una Raspberry Pi con 8 GB de RAM, el escenario cambia radicalmente. En este caso, el modelo más grande que se puede llegar a ejecutar de manera funcional es el de 7B parámetros, y aun así la velocidad se sitúa en torno a 1 token por segundo. Esto, para mantener una conversación fluida, se hace casi insufrible.

Al evaluar la calidad de las respuestas, se ve todavía más clara la diferencia. Ante una pregunta de conocimiento general sencillo, como quién es un personaje muy conocido de una serie popular, el modelo de 14B acierta, mientras que el de 7B empieza a dar respuestas extrañas. El de 1.5B directamente ofrece resultados que recuerdan más a un texto inventado sin base sólida.

Con consultas más genéricas se repite el patrón: las variantes pequeñas tienden a dar respuestas raras, incompletas o claramente erróneas. Es lógico: al reducir tanto el tamaño del modelo, se recorta brutalmente su capacidad de representación y su “memoria” implícita del mundo, de modo que no se le puede exigir que se comporte como un modelo tope de gama.

Para qué sirven realmente los modelos destilados en Raspberry Pi

Pese a estas limitaciones, los modelos destilados y compactos tienen usos muy interesantes en dispositivos como la Raspberry Pi. No están pensados para sustituir a los grandes chatbots generalistas, sino para resolver tareas bien acotadas donde la creatividad y el conocimiento enciclopédico no son el punto principal.

Uno de los campos donde funcionan razonablemente bien es en ayuda matemática básica y revisión de código. Para detectar errores simples en scripts, proponer pequeñas funciones o sugerir mejoras en trozos de código Python, un modelo de 7B o 14B suele dar respuestas útiles siempre que no se le pida algo extremadamente específico o rebuscado.

También pueden ser muy útiles para generar y corregir fragmentos de código aplicados a domótica, automatización o pequeños proyectos. Por ejemplo, un modelo de 14B puede proponer una automatización para Home Assistant con cierta coherencia, mientras que la versión de 1.5B tenderá a inventarse partes o a ofrecer algo que no compila ni tiene sentido.

Donde fallan de manera sistemática es en preguntas de cultura general, datos factuales detallados o tareas que exigen mucho contexto. Además, el sentido del humor y la capacidad para mantener conversaciones largas y naturales brillan por su ausencia incluso en modelos relativamente grandes, por lo que no son la mejor opción para usarlos como “amigos virtuales”.

Un ejemplo curioso es pedirles que generen una página web compleja, como una landing para vender un curso. Todos los modelos pueden producir una estructura HTML funcional, pero cuanto más destilada y pequeña es la variante, más simple, fea y pobre en contenido resulta la web generada, perdiendo detalles y matices por el camino.

En definitiva, los modelos pequeños montados en una Raspberry Pi son ideales para asistir en tareas técnicas acotadas, automatización doméstica, pequeños asistentes de desarrollo o clasificación ligera de datos, pero no para sustituir a un servicio en la nube de última generación cuando lo que quieres es un asistente general polivalente.

Raspberry Pi, domótica e inteligencia artificial ligera

Una de las aplicaciones más prometedoras de la IA en Raspberry Pi es la domótica inteligente con modelos ligeros. La idea es usar la placa como cerebro local que interpreta comandos, conecta con sensores y actuadores, y toma decisiones sencillas sin necesidad de mandar nada a la nube.

Por ejemplo, se puede montar un sistema donde un pequeño modelo de lenguaje se encargue de entender órdenes de voz, incluyendo pasos de preprocesado como limpiar el ruido del micrófono, del tipo “baja la persiana del salón cuando el sol dé de frente” o “enciende la calefacción solo si hay alguien en casa y la temperatura baja de cierto umbral”. El modelo no necesita saber quién es un personaje histórico ni escribir poesía: solo debe traducir peticiones a acciones concretas.

Con este enfoque, incluso un LLM de 1.5B o 3B parámetros puede tener sentido, porque su función no es dar respuestas brillantes, sino mapear lenguaje natural a comandos estructurados. Si se entrena o ajusta específicamente para ese dominio (domótica, sensores, rutinas), los resultados pueden ser sorprendentemente buenos para lo ligero que es el sistema.

Este tipo de soluciones permite crear casas inteligentes mucho más respetuosas con la privacidad, donde ni las órdenes de voz ni los patrones de uso de dispositivos salen de la red local. Además, al no depender de servicios externos, se evita que todo deje de funcionar porque un proveedor cambia de API, cae un servidor o decide cerrar el servicio.

Aunque todavía queda mucho por pulir y probar, el potencial de combinar modelos pequeños con plataformas domóticas como Home Assistant o sistemas propios en Raspberry Pi es enorme, y todo apunta a que veremos cada vez más experimentos y proyectos reales en esta línea.

Aceleradores de IA para Raspberry Pi: Hailo, AI HAT+ y otros módulos

Para superar las limitaciones de la CPU de la Raspberry Pi, han aparecido aceleradores de IA específicos que se integran directamente con la placa. Su objetivo es procesar redes neuronales de forma mucho más rápida y eficiente que la CPU o, en algunos casos, que una GPU convencional.

Frente a los procesadores generalistas, estos aceleradores están diseñados para ejecutar en paralelo las operaciones matemáticas típicas del aprendizaje automático. Eso reduce el tiempo de inferencia y también el consumo de energía, lo que es clave en dispositivos embebidos o en situaciones donde no se puede permitir un gran gasto energético continuo.

Un ejemplo muy extendido es el uso de una tarjeta M.2 HAT+ conectada a Raspberry Pi 5 junto con un módulo M.2 2242 que integra un chip Hailo-8L. Este tipo de kit añade una unidad dedicada de procesamiento neural que se encarga de acelerar tareas de visión, detección de objetos o incluso algunos modelos generativos optimizados para su arquitectura.

El chip Hailo se centra en procesar operaciones complejas en paralelo con una gran eficiencia energética. En comparación con soluciones basadas solo en CPU o GPU, esto se traduce en menos calor, menor necesidad de refrigeración y mejor autonomía si el sistema se alimenta por batería, algo muy apreciado en proyectos industriales, robótica o sensores inteligentes distribuidos.

Gracias a estos módulos, la Raspberry Pi puede pasar de ser un simple coordinador a convertirse en un nodo de inferencia realmente capaz, ejecutando redes neuronales sofisticadas directamente en el borde de la red sin saturar la placa y manteniendo una latencia muy baja.

AI HAT+ 2 y el salto a LLM locales en Raspberry Pi 5

Uno de los lanzamientos más llamativos en este terreno es la Raspberry Pi AI HAT+ 2, una placa de expansión diseñada para Raspberry Pi 5 que incorpora el chip Hailo-10H. Este coprocesador ofrece un rendimiento de inferencia de alrededor de 40 TOPS, suficiente para manejar modelos de IA generativa ligera de forma local.

Con este hardware, la Raspberry Pi 5 puede ejecutar modelos de lenguaje relativamente compactos con baja latencia, sin que la CPU principal se vea saturada. El procesamiento se delega al Hailo-10H, que se encarga de las operaciones intensivas mientras la placa gestiona la lógica de la aplicación, la entrada de usuario y la integración con otros sistemas.

Entre los modelos compatibles que se han mencionado oficialmente se incluyen DeepSeek-R1-Distill, Llama 3.2, Qwen2.5-Coder, Qwen2.5-Instruct y Qwen2. La mayoría rondan los 1.500 millones de parámetros, mientras que Llama 3.2 se queda aproximadamente en 1.000 millones, todos ellos pensados para ofrecer un equilibrio razonable entre capacidad y consumo de recursos.

Las pruebas públicas muestran que estos modelos se pueden usar para tareas de chat básico, traducción de texto, generación de fragmentos de código o descripción de escenas cuando se combinan con entradas de visión. La latencia es baja y la experiencia de uso se acerca mucho más a lo que la gente espera de una IA interactiva moderna.

Eso sí, hay que tener claro que AI HAT+ 2 no permite correr de manera local modelos masivos como ChatGPT, Claude o los LLM más grandes de Meta. Estos sistemas cuentan con cientos de miles de millones o billones de parámetros, muy por encima de lo que puede manejar de forma razonable un coprocesador de este tipo en una Raspberry Pi 5.

El gran atractivo del AI HAT+ 2 es que, por un precio que ronda los 130 dólares, permite convertir una Raspberry Pi 5 en una pequeña estación de IA local muy capaz, con acceso a un repositorio de ejemplos y frameworks de Hailo orientados tanto a visión como a IA generativa. Es una pieza clave para quienes quieran ir más allá de los modelos puramente simbólicos y jugar realmente con redes neuronales modernas en el borde.

El panorama que se está dibujando alrededor de la inteligencia artificial en Raspberry Pi es bastante potente: entre agentes que usan la nube, modelos ligeros en local, aceleradores dedicados y nuevas placas como AI HAT+ 2, la pequeña placa se ha convertido en un laboratorio ideal para explorar cómo será la IA distribuida en dispositivos cotidianos, siempre que se asuman las limitaciones de potencia y se diseñen los proyectos con cabeza.

Redactor apasionado del mundo de los bytes y la tecnología en general. Me encanta compartir mis conocimientos a través de la escritura, y eso es lo que haré en este blog, mostrarte todo lo más interesante sobre gadgets, software, hardware, tendencias tecnológicas, y más. Mi objetivo es ayudarte a navegar por el mundo digital de forma sencilla y entretenida.