- Los agentes de acción de IA son sistemas autónomos que perciben su entorno, razonan y actúan para cumplir objetivos concretos.

- Su arquitectura combina entradas, memoria, modelos cognitivos, planificadores, actuadores y políticas de seguridad o guardrails.

- Ofrecen grandes ventajas en automatización, eficiencia y personalización, pero plantean riesgos en privacidad, sesgos, seguridad y empleo.

- Su adopción responsable exige supervisión humana, gobernanza de datos, trazabilidad y programas de formación y reskilling.

Los agentes de acción de IA están pasando de ser un concepto casi de ciencia ficción a convertirse en piezas clave de muchas herramientas que usamos a diario. Aunque suene muy grandilocuente, en realidad ya convivimos con ellos cuando pedimos al móvil la mejor ruta a casa, cuando una plataforma de vídeo nos sugiere qué ver o cuando un sistema detecta un posible fraude en una compra online.

Si te estás preguntando qué son exactamente estos agentes, cómo funcionan, qué tipos hay y hasta dónde pueden llegar, estás en el sitio adecuado. Vamos a desgranar el concepto con calma: desde su definición más técnica hasta ejemplos cotidianos, pasando por sus ventajas, sus riesgos, su relación con la ciberseguridad y el papel que jugarán en el empleo y la formación de los próximos años. También veremos qué tipos de modelos y arquitecturas suelen usarse.

Qué es un agente de IA y qué lo hace especial

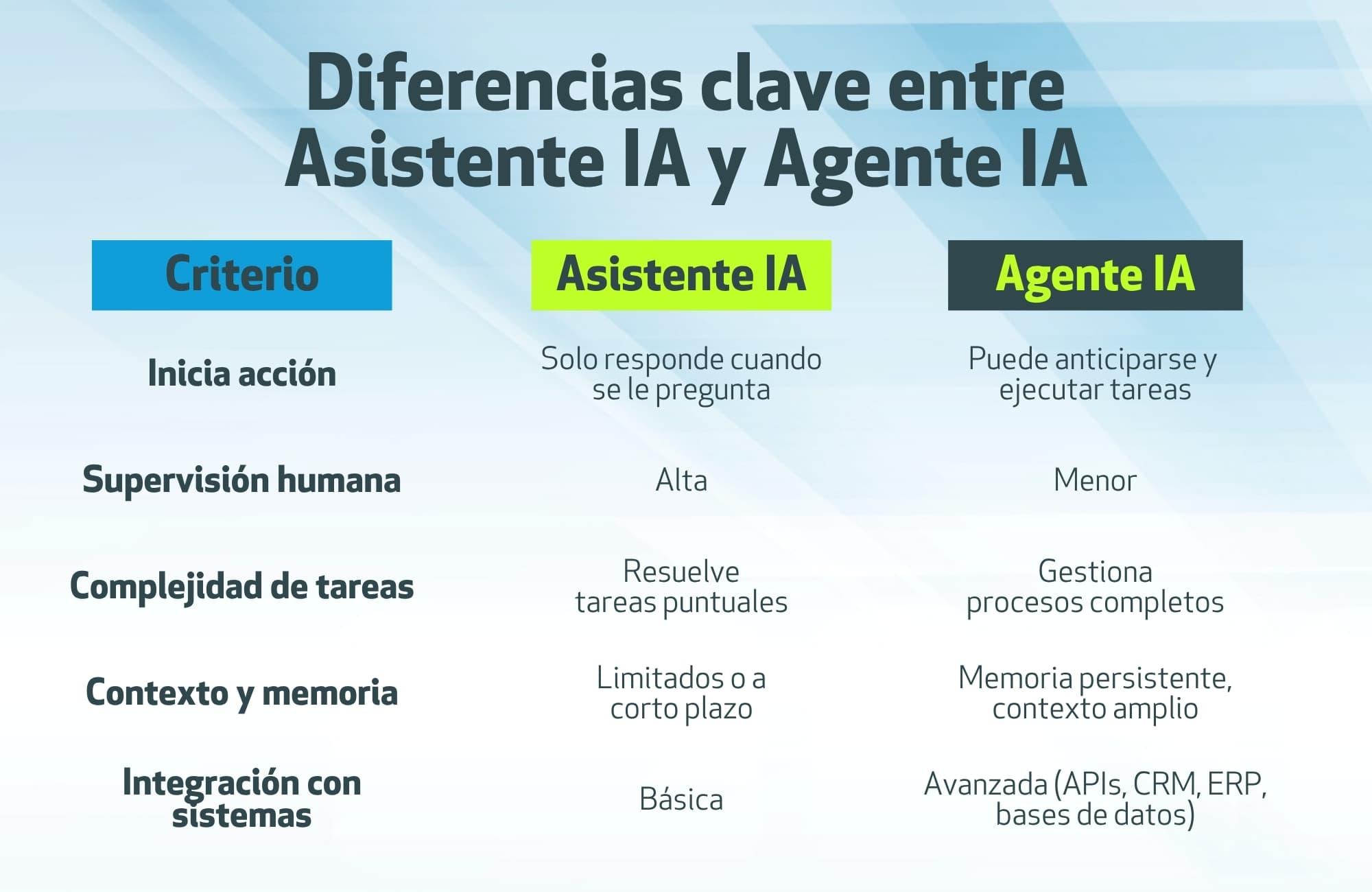

En términos sencillos, un agente de inteligencia artificial es un sistema de software (o software más hardware) que percibe su entorno, razona sobre lo que ve y actúa de forma autónoma para alcanzar uno o varios objetivos. No es solo un programa que sigue una lista rígida de instrucciones, sino una entidad capaz de decidir cuál es el siguiente paso adecuado en cada momento.

Un agente de IA puede vivir dentro de un robot físico, incrustado en una aplicación de negocio o ser un “compañero digital” que se conecta a múltiples servicios y API. En todos los casos, comparte la misma esencia: observa, procesa, decide y ejecuta acciones sin necesitar que una persona le diga cada micro‑paso.

La gran diferencia frente al software tradicional es que un programa clásico se limita a seguir reglas predefinidas paso a paso. Si algo cambia en el entorno y no estaba previsto en el código, el sistema se bloquea o falla. Un agente de IA, en cambio, puede replantear su plan de actuación, buscar información adicional y reajustar su estrategia. Esta distinción queda clara si se comparan las capacidades con las de software tradicional.

Por eso muchos expertos los describen como algoritmos o modelos impulsados por IA que ayudan a las personas a tomar decisiones o hacer predicciones sobre el futuro, hasta el punto de verlos como “empleados” o “compañeros” digitales que ejecutan trabajo de forma bastante independiente.

Cómo razonan y actúan los agentes de acción de IA

Los agentes de acción de IA destacan porque son capaces de cerrar la brecha entre lo que el modelo sabe “de fábrica” y la información que necesita para cumplir un objetivo complejo. Para ello, tiran de todo tipo de herramientas externas: bases de datos, buscadores web, API de terceros e incluso otros agentes especializados.

Imagina el caso de una persona que quiere planear unas vacaciones de surf en Grecia y pide a un agente de IA que le diga qué semana del año que viene tendrá las mejores condiciones. El modelo de lenguaje que hay en el núcleo del agente no está especializado en meteorología, así que, por sí solo, no puede responder con precisión; en muchos casos se recurre a modelos más avanzados como Gemini o LLM específicos para suplir esas lagunas.

Ante ese límite, el agente lanza una serie de acciones: consulta una base de datos con registros de clima diarios de los últimos años en Grecia, analiza patrones de temperaturas, precipitaciones y oleaje y, aun así, detecta que le falta conocimiento experto sobre qué condiciones son ideales para surfear.

En ese momento crea una subtarea y consulta a otro agente especializado en navegación y deportes acuáticos. Este segundo agente aporta criterios clave: mareas altas, sol, poca lluvia y determinadas condiciones de viento. Con esa nueva información, el agente principal combina los datos históricos y el conocimiento experto, identifica patrones y predice qué semana concreta del próximo año ofrece la mejor ventana para el viaje de surf. Finalmente, presenta al usuario las fechas recomendadas y el razonamiento detrás de la sugerencia.

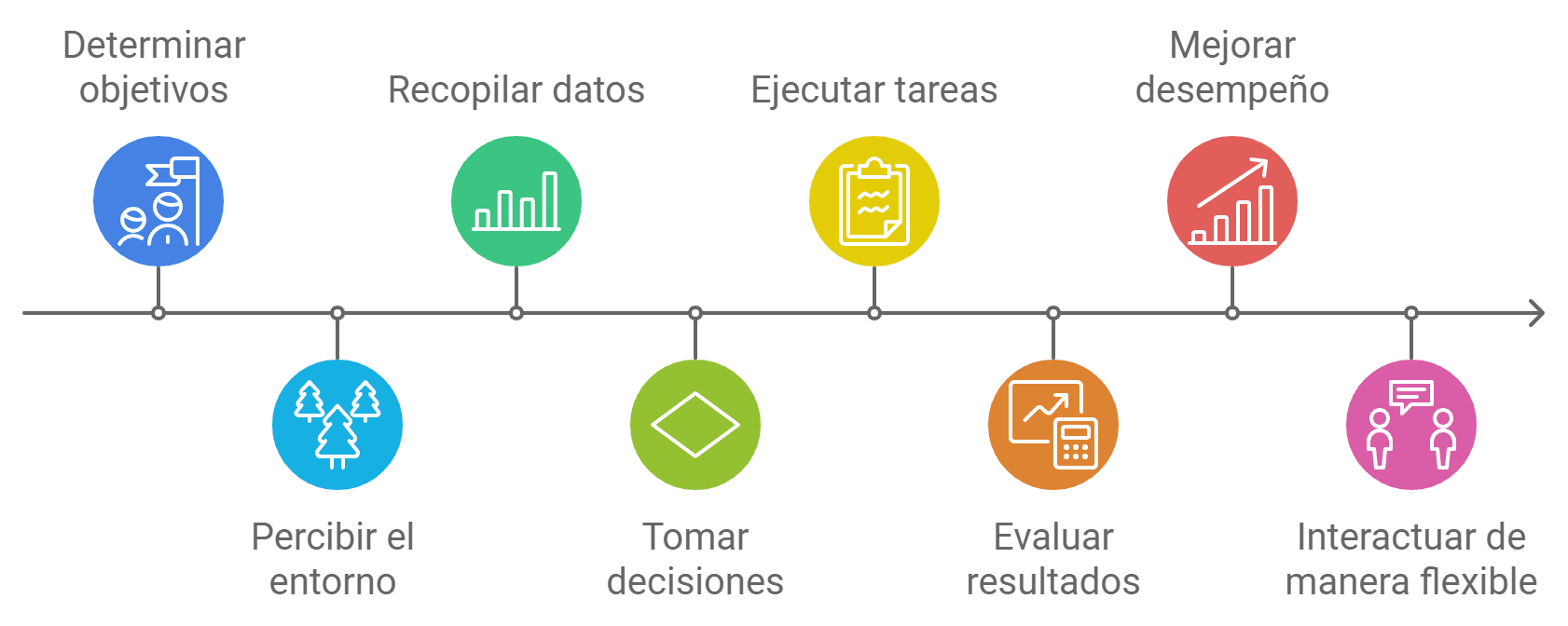

Este ciclo de percepción, búsqueda de información, actualización de la base de conocimientos y razonamiento iterativo es lo que se conoce como razonamiento agéntico. El agente revisa su plan de acción constantemente, se autocorrige cuando encuentra datos nuevos y ajusta sus decisiones para ser cada vez más preciso y útil.

Características clave que diferencian a los agentes de IA

Más allá de la definición general, los agentes de IA se reconocen por una serie de propiedades que, combinadas, marcan distancias claras frente al software de toda la vida.

Autonomía para decidir y actuar

La primera seña de identidad es la autonomía operativa. Un agente de IA no necesita supervisión humana constante para dar el siguiente paso. Parte de unos objetivos marcados y de un conjunto de reglas y limitaciones, pero dentro de ese marco decide por su cuenta cómo proceder.

Por ejemplo, un agente de contabilidad puede detectar que falta un dato de facturación en una compra, enviar un recordatorio automático al proveedor, revisar si llega la información y actualizar los registros, todo sin que nadie tenga que estar pendiente del proceso.

Comportamiento guiado por objetivos

Los agentes de IA funcionan orientados a metas. No se limitan a ejecutar tareas sueltas, sino que evalúan sus acciones en función de una función de utilidad o de métricas de rendimiento. Es decir, persiguen maximizar el “éxito” tal y como se haya definido para ellos.

Un sistema logístico impulsado por un conjunto de agentes, por ejemplo, puede optimizar rutas de reparto buscando a la vez velocidad, menor coste y menor consumo de combustible. El agente valora distintas alternativas y selecciona aquella que mejor equilibra todos esos factores.

Percepción del entorno digital o físico

Otra característica esencial es la capacidad de percibir el entorno en tiempo casi real. Un agente puede recibir datos de sensores físicos (cámaras, radares, micrófonos, LIDAR), de sistemas informáticos (logs, métricas, estados de servicio) o de fuentes externas vía API.

Con esa información, el agente mantiene actualizado su estado interno y sabe si el contexto ha cambiado. Pensemos en un agente de ciberseguridad que monitoriza eventos de múltiples sistemas y, además, se alimenta de bases de datos públicas y comerciales con los últimos incidentes y vulnerabilidades para ajustar sus reglas de detección.

Racionalidad y toma de decisiones informada

Un agente de IA no actúa al azar. Combina datos del entorno, conocimiento del dominio y contexto histórico para calcular qué acción es más razonable en cada situación. Su objetivo es maximizar la probabilidad de obtener resultados deseados o, al menos, de evitar resultados claramente negativos.

Un robot que se mueve por un almacén, por ejemplo, fusiona las lecturas de sus sensores con un mapa interno del espacio y con registros de desplazamientos anteriores para elegir rutas que eviten obstáculos y minimicen tiempos. Un chatbot, por su parte, analiza las consultas del usuario, el historial de la conversación y la base de conocimientos de la empresa para ofrecer una respuesta adecuada y decidir si debe escalar el caso a un humano.

Proactividad: no solo reaccionan, también se anticipan

A diferencia de muchos sistemas clásicos, los agentes de IA pueden adelantarse a lo que va a pasar. Utilizan modelos predictivos y simulaciones de estados futuros para tomar la iniciativa, sin esperar necesariamente a que llegue una petición explícita.

Aprendizaje continuo a partir de la experiencia

Otra pieza importante del puzzle es la capacidad de aprender de la experiencia y mejorar con el tiempo. Un agente puede analizar los resultados de sus acciones, incorporar feedback (explícito o implícito) y reajustar sus modelos internos.

Los agentes de mantenimiento predictivo, por ejemplo, van refinando sus algoritmos conforme se producen fallos y averías reales. Así, sus predicciones sobre cuándo conviene revisar una máquina o sustituir una pieza se vuelven cada vez más ajustadas, reduciendo tiempos de inactividad y costes.

Adaptabilidad ante cambios e incertidumbre

La realidad es cambiante y está llena de lagunas de información. Un agente de IA bien diseñado es capaz de modificar su estrategia cuando el entorno se vuelve inestable o surgen datos inesperados.

Un agente que opera en mercados financieros puede variar su comportamiento en una fuerte caída bursátil, reduciendo el riesgo o cerrando posiciones en función de objetivos y límites de riesgo predefinidos. En el terreno de los videojuegos, agentes como los que se usan en sistemas tipo AlphaZero descubren tácticas novedosas a partir del autojuego, sin depender de estrategias humanas previas.

Colaboración entre agentes y con personas

Los agentes no tienen por qué trabajar solos. En muchos sistemas complejos se emplean arquitecturas multiagente donde distintas entidades se encargan de tareas especializadas y colaboran entre sí y con humanos.

En sanidad, por ejemplo, puede haber agentes centrados en diagnóstico, prevención, gestión de citas, seguimiento de medicación y coordinación entre departamentos. Cada uno ejecuta sus funciones, pero se comunican para ofrecer una atención más integral al paciente, compartiendo información y coordinando acciones.

Componentes funcionales de un agente de IA

Para entender en detalle qué pueden hacer estos sistemas, conviene revisar las piezas que suelen componer un agente de IA moderno.

Entradas y sensores

La capa de entrada permite al agente recibir información del mundo físico o digital. Pueden ser textos, audios, imágenes, datos estructurados, flujos de eventos de sistemas, resultados de consultas a API, etc.

En un robot, esto se materializa en cámaras, sensores de proximidad, acelerómetros o GPS. En un entorno puramente software, serían logs de aplicaciones, consultas a buscadores, respuestas de servicios web o formularios que rellena el usuario.

Memorias y bases de datos

Los agentes no solo procesan lo que ven en cada instante, también pueden almacenar lo aprendido. Para ello utilizan bases de datos tradicionales, memorias vectoriales y memorias episódicas que guardan información sobre interacciones pasadas y estados anteriores.

Gracias a estas memorias, un agente puede recuperar rápidamente fragmentos de experiencia relevantes y usarlos para comprender mejor el contexto actual o para no repetir errores. Esto es clave en agentes de aprendizaje y en sistemas de recomendación personalizados.

Modelo cognitivo y de razonamiento

En el “cerebro” del agente se encuentran los modelos cognitivos: redes neuronales, modelos de lenguaje, motores de planificación y algoritmos de decisión. Esta capa interpreta las entradas, construye representaciones internas del problema, realiza inferencias y genera posibles cursos de acción.

Por ejemplo, un modelo de lenguaje puede entender una petición en texto libre, un motor de planificación puede descomponer un objetivo complejo en subtareas y un algoritmo de aprendizaje por refuerzo puede valorar qué acción es más prometedora en cada estado.

Controlador o planificador

El controlador es el módulo que decide qué acción ejecutar, en qué momento y en qué orden. Suele apoyarse en árboles de decisión, motores de reglas, políticas aprendidas por refuerzo o flujos orquestados que coordinan múltiples llamadas a servicios o herramientas.

En la práctica, este componente permite que el agente encadene acciones en secuencia (“actuar en cadena”): desde recibir una orden del usuario hasta llevarla a término pasando por varios pasos intermedios.

Actuadores y acciones

Los actuadores son los elementos que permiten al agente intervenir en el mundo. En un robot, serán motores, brazos articulados o señales a otros sistemas físicos. En el ámbito digital, suelen ser llamadas a API, ejecución de scripts, envío de correos, actualización de registros o interacción con otras aplicaciones.

Un agente capaz de construir un sitio web, por ejemplo, puede escribir código, generar contenidos, diseñar elementos visuales y lanzar pruebas automáticas de rendimiento y adaptabilidad, todo ello encadenado desde una sola instrucción del usuario. Para ello hay guías y recursos específicos sobre cómo construir agentes que automatizan flujos completos.

Políticas, guardrails y límites

Para que estos sistemas sean utilizables en entornos reales, es imprescindible incorporar políticas de seguridad, reglas de negocio y filtros que definan qué está permitido y qué no. Estos “guardrails” marcan la personalidad del agente y acotan su margen de maniobra.

Se implementan mediante prompts bien diseñados, restricciones lógicas, validaciones de entrada y salida y mecanismos de supervisión que bloquean acciones peligrosas, antiéticas o contrarias a la normativa vigente. Además, conviene formarse en prevención frente a ingeniería social para reducir riesgos derivados de manipulaciones externas.

Generación de respuestas

Por último, el agente necesita una forma de devolver resultados comprensibles. Puede hacerlo en forma de texto natural, visualizaciones, informes, alertas, actualizaciones en paneles o acciones directas sobre sistemas externos.

En muchos casos, esta capa se apoya en modelos de lenguaje natural para explicar lo que ha hecho y por qué, algo esencial para la transparencia y para que los usuarios confíen en sus decisiones.

Tipos de agentes de IA más habituales

Dentro del paraguas de los agentes de IA podemos distinguir varias familias, ordenadas de menor a mayor complejidad cognitiva.

Agentes de reflejo simples

Son la versión más básica: responden únicamente a la percepción actual sin memoria ni aprendizaje. Están programados con reglas del tipo “si pasa X, haz Y”.

Un ejemplo sencillo sería un dispositivo de climatización que se enciende o apaga a determinada hora o al superar una temperatura, sin tener en cuenta nada más. Cumple su función, pero no evoluciona ni se adapta más allá de lo que ya se codificó.

Agentes reactivos basados en modelos

Estos agentes añaden un modelo interno del mundo y cierta memoria. Con eso pueden razonar un poco más allá del instante puntual y actualizar su representación del entorno a medida que reciben información nueva.

Las aspiradoras robot son un ejemplo muy gráfico: detectan obstáculos, recuerdan las zonas ya limpiadas y ajustan su ruta para no repetir áreas inútilmente. Aunque siguen límites preestablecidos, su comportamiento es más flexible que el de un sistema puramente reactivo.

Agentes basados en objetivos

Para este tipo de agentes, lo importante no es tanto el estado actual como el objetivo que quieren conseguir. Son capaces de buscar secuencias de acciones que los acerquen a esa meta, evaluando alternativas antes de ejecutarlas.

El caso clásico es el de los sistemas de navegación que calculan una ruta desde un origen hasta un destino, teniendo en cuenta distancias, tráfico y posibles restricciones. El agente explora diferentes caminos y elige el que mejor cumple el objetivo (llegar en el menor tiempo o con el menor coste).

Agentes basados en la utilidad

Estos agentes también persiguen un objetivo, pero además miden la “utilidad” o recompensa de distintos caminos posibles. Cuando hay varias formas de lograr la meta, seleccionan la que maximiza algún criterio cuantificable.

Siguiendo con el ejemplo de la navegación, un agente de este tipo podría recomendar la ruta que minimice consumo de combustible y peajes, incluso aunque no sea la más rápida, porque el criterio de utilidad esté definido como “coste total del desplazamiento”.

Agentes de aprendizaje

Son los más potentes desde el punto de vista adaptativo: aprenden de la experiencia y mejoran según interactúan con el entorno. Usan técnicas de aprendizaje automático y profundo para actualizar sus estrategias, modelos de predicción y políticas de decisión.

Los sistemas de recomendaciones personalizadas en e‑commerce, plataformas de vídeo o música son ejemplos muy claros: registran la actividad de cada usuario, captan sus gustos y afinan las propuestas con el tiempo, volviéndose cada vez más acertados.

Ejemplos cotidianos y empresariales de agentes de IA

Los agentes de IA ya están integrados en muchos servicios sin que nos demos demasiada cuenta. Algunos ejemplos muy extendidos son los siguientes:

- Sistemas de recomendación en plataformas como Netflix o Spotify, que sugieren contenido según tu historial y el de usuarios similares.

- Asistentes virtuales y chatbots que resuelven dudas frecuentes, gestionan reservas o ayudan en procesos de soporte.

- Motores de búsqueda que ajustan los resultados según tu contexto, idioma, ubicación e historial previo.

- Herramientas de productividad que reorganizan el calendario, priorizan tareas o proponen tiempos de concentración y descanso.

- Agentes de análisis de datos y detección de fraude que rastrean operaciones financieras en busca de patrones sospechosos y lanzan alertas automáticas.

En el ámbito industrial y empresarial, además, empiezan a ser habituales agentes que coordinan cadenas de suministro, planifican mantenimiento, ajustan precios dinámicamente o ayudan a la dirección a tomar decisiones complejas basadas en grandes volúmenes de datos.

Ventajas e impacto económico de los agentes de IA

La expansión de los agentes de IA no es casualidad: aportan beneficios muy tangibles en productividad, eficiencia y calidad de las decisiones. Entre las ventajas más destacadas están:

- Automatización de tareas repetitivas que libera tiempo de las personas para labores más creativas o estratégicas.

- Mejora de la eficiencia en sectores como logística, salud, finanzas o manufactura.

- Personalización a gran escala, ofreciendo experiencias adaptadas a cada individuo sin necesidad de intervención manual.

- Toma de decisiones en entornos complejos, donde la cantidad de datos supera lo que un equipo humano puede procesar con soltura.

Informes recientes estiman que la adopción de sistemas basados en inteligencia artificial, muchos de ellos de tipo agéntico, podría aportar varios billones de dólares al año a la economía global, gracias sobre todo a la automatización inteligente y al mejor aprovechamiento de los datos.

Riesgos, desafíos y límites actuales de los agentes de IA

Como cualquier tecnología potente, los agentes de IA traen consigo una buena lista de desafíos que conviene tener muy presentes si se quiere usarlos de forma responsable.

Privacidad y seguridad de los datos

Los agentes suelen manejar grandes cantidades de información sensible, lo que los convierte en objetivos atractivos para atacantes y también en posibles vectores de fuga involuntaria de datos.

Es imprescindible diseñar marcos sólidos de gobernanza de datos, controles estrictos de acceso y políticas claras sobre qué información puede consultar cada agente y con qué fines. Además, conviene registrar detalladamente sus acciones para poder auditar qué datos han sido utilizados y cómo.

Sesgos y cuestiones éticas

Si los datos con los que se entrena o alimenta a un agente contienen sesgos, el sistema puede reproducir e incluso amplificar esos sesgos, dando lugar a decisiones injustas o discriminatorias, especialmente delicadas en ámbitos como la contratación, la concesión de créditos o la justicia.

Por eso es crucial mantener una supervisión humana activa en decisiones de alto impacto, auditar periódicamente el comportamiento de los agentes y validar sus resultados con criterios de equidad y transparencia.

Complejidad técnica e integración

Crear e integrar agentes de IA avanzados no es un paseo. Requiere conocimientos de aprendizaje automático, ingeniería de datos, arquitectura de sistemas y seguridad. Además, hay que pensar en su vida útil: actualización de modelos, mantenimiento, monitorización y depuración.

Una buena práctica es diseñar mecanismos claros de supervisión e intervención humana, mantener registros exhaustivos de actividad y empezar con despliegues acotados antes de escalar a toda la organización.

Costes computacionales e infraestructura

Algunos agentes, sobre todo los que se basan en modelos muy grandes o en procesamiento intensivo en tiempo real, requieren una potencia de cálculo considerable. Esto se traduce en costes de hardware, energía y servicios en la nube.

La mitigación pasa por optimizar modelos, usar técnicas de compresión, aprovechar hardware especializado y diseñar arquitecturas eficientes que equilibren prestaciones y coste.

Retos en sistemas multiagente

Cuando entran en juego múltiples agentes interactuando entre sí, aparecen problemas adicionales: gestión de dependencias, orquestación de acciones, coordinación y prevención de efectos colaterales no deseados.

Es recomendable dotar a cada agente de identificadores únicos, trazabilidad completa de sus decisiones e interacciones y reglas claras de coordinación, de modo que siempre se pueda reconstruir quién hizo qué y por qué.

Bucles de retroalimentación y errores acumulativos

Un riesgo particular de los sistemas autónomos es que sus propias acciones refuercen comportamientos problemáticos. Por ejemplo, un agente de recomendación que solo muestre cierto tipo de contenido puede ir estrechando el campo de visión del usuario sin que nadie lo detecte.

Para evitarlo, conviene incorporar puntos de corte e intervención humana, revisiones periódicas del comportamiento global del agente y mecanismos que introduzcan diversidad o exploración en las decisiones.

Tareas que requieren inteligencia emocional

Pese a sus avances, los agentes de IA siguen teniendo dificultades serias en tareas que exigen empatía y comprensión emocional profunda. Pueden simular cierto tono, pero no sustituyen la sensibilidad humana en contextos delicados.

En estas situaciones, lo más prudente es reservar para el agente las partes rutinarias o analíticas del proceso (recopilar información, elaborar borradores, proponer opciones) y dejar la interacción crítica a profesionales humanos.

Aumento del impacto de los errores

Cuanta más autonomía se concede a un agente, mayores son las consecuencias de un fallo en su lógica, en los datos de entrada o en la configuración de sus límites. Un pequeño error en un agente que gestiona cadenas de suministro o infraestructuras críticas puede escalar rápidamente.

Por eso es vital establecer tasas de error objetivo muy bajas, sistemas de detección temprana de anomalías, planes de contingencia y capacidad de “botón rojo” para parar o modificar el comportamiento si algo se tuerce.

Dependencia excesiva y pérdida de habilidades

Si una organización descarga tareas cruciales en agentes de IA sin conservar conocimientos internos y capacidad de reacción humana, puede quedarse desarmada si el sistema falla o se comporta de forma extraña.

Lo sano es mantener equilibrios claros entre automatización y pericia humana, invertir en formación continua y definir cómo se actuará manualmente en caso de fallo de los agentes.

Responsabilidad y marco legal

Cuando un agente toma una decisión errónea, no siempre es evidente quién debe asumir la responsabilidad: el desarrollador, la empresa que lo desplegó, el proveedor del modelo base o nadie en concreto.

Para gestionar esta zona gris, es aconsejable definir marcos de supervisión, documentar claramente las capacidades y límites de los agentes e implementar mecanismos de trazabilidad que permitan atribuir responsabilidades de forma justa.

Impacto en el empleo y necesidad de reskilling

La progresiva capacidad de los agentes de IA para encargarse de tareas rutinarias y procesar información a gran velocidad genera preocupación por el desplazamiento de ciertos puestos de trabajo.

Más que un riesgo puramente técnico, es un desafío social y económico. La respuesta razonable pasa por invertir en reciclaje profesional y mejora de competencias, de forma que las personas puedan centrarse en funciones que exploten su creatividad, empatía y pensamiento estratégico, áreas donde la IA sigue siendo complementaria y no sustitutiva.

Agentes de IA y cibercrimen: el lado oscuro de la autonomía

Al igual que ocurre con cualquier tecnología poderosa, los agentes de IA pueden utilizarse con fines maliciosos. De hecho, diversos estudios apuntan a que veremos un aumento de ciberataques apoyados en este tipo de sistemas.

Un agente controlado por ciberdelincuentes podría automatizar campañas de phishing, aprender qué tipos de mensajes consiguen más víctimas, ajustar el contenido en tiempo real y dirigir los ataques hacia objetivos especialmente vulnerables.

Además, estos agentes podrían ocuparse de explorar sistemas en busca de fallos, aprovechar vulnerabilidades, escalar privilegios y exfiltrar datos, todo ello a un coste mucho menor que el de mantener un equipo humano especializado.

Este panorama obliga a reforzar las medidas de ciberseguridad, la detección temprana de comportamientos anómalos y la regulación del uso de agentes en contextos críticos, para reducir el margen de maniobra del cibercrimen.

Formación, innovación y cómo empezar a trabajar con agentes de IA

Comprender qué son y cómo funcionan los agentes de IA es solo el primer paso. Si quieres sacarles partido en tu vida profesional, será clave adquirir competencias en diseño, implementación y supervisión de estos sistemas.

En los próximos años, las empresas demandarán perfiles capaces de combinar conocimientos técnicos de IA con entendimiento del negocio y sensibilidad ética. Programas de formación especializados en inteligencia artificial e innovación ya están orientando sus contenidos hacia arquitecturas agénticas, integración con sistemas corporativos y gestión del cambio.

Si te interesa explorar este mundo, puedes empezar por identificar los agentes de IA que ya usas a diario (asistentes de voz, recomendaciones, sistemas de soporte), leer sobre los distintos tipos de agentes y probar herramientas abiertas que te permitan experimentar en proyectos pequeños.

Invertir tiempo en entender estas tecnologías y en desarrollar habilidades complementarias (como la formulación de objetivos, la evaluación de riesgos, la interpretación de resultados y la comunicación con equipos técnicos) es una buena forma de diferenciarse en un mercado laboral que se está moviendo muy deprisa.

Los agentes de acción de IA se están convirtiendo en una pieza central de la nueva ola de automatización inteligente: son capaces de percibir su entorno, razonar, aprender, colaborar y ejecutar acciones encadenadas para ayudarnos a tomar mejores decisiones y liberar tiempo de trabajo repetitivo. Su potencial para transformar sectores enteros es enorme, pero también lo son los retos en privacidad, seguridad, ética y empleo; por eso, el verdadero valor llegará cuando sepamos combinarlos con una sólida supervisión humana, marcos de responsabilidad claros y una apuesta seria por la formación y la innovación responsable.

Redactor apasionado del mundo de los bytes y la tecnología en general. Me encanta compartir mis conocimientos a través de la escritura, y eso es lo que haré en este blog, mostrarte todo lo más interesante sobre gadgets, software, hardware, tendencias tecnológicas, y más. Mi objetivo es ayudarte a navegar por el mundo digital de forma sencilla y entretenida.