- La virtualización introduce una sobrecarga inevitable que impacta especialmente en el rendimiento gráfico frente al host físico.

- Tecnologías como passthrough de GPU, SR-IOV, GVT-g o vGPU mejoran el rendimiento, pero no eliminan por completo las limitaciones de la virtualización.

- CPU, memoria y almacenamiento mal dimensionados pueden provocar lag gráfico incluso con buena GPU, por lo que es crítico equilibrar todos los recursos.

- Con una configuración cuidada, las VMs ofrecen un escritorio muy fluido para la mayoría de usos, reservando el bare-metal para cargas gráficas extremas.

Cuando montamos un entorno virtual moderno y empezamos a usarlo como si fuera un PC de escritorio real, una de las primeras sorpresas suele ser que, aunque la CPU y la RAM van finas, la experiencia gráfica en las máquinas virtuales se siente más torpe: ventanas que se arrastran con retardo, menús que se despliegan a trompicones o vídeos de YouTube que no van tan suaves como en el host. Todo ello incluso en equipos bastante decentes, con CPUs modernas y gráficas integradas potentes.

Este comportamiento no es casualidad. La virtualización introduce una capa extra entre el hardware y el sistema operativo invitado, y esa capa tiene un coste, sobre todo cuando hablamos de gráficos 2D/3D y aceleración por GPU. Al mismo tiempo, la industria ofrece múltiples tecnologías (passthrough de GPU, vGPU, SR-IOV, GVT-g, GRID, MxGPU, VirGL, etc.) que prometen mejorar la cosa, pero no siempre está claro qué se puede esperar de cada una, qué limitaciones tienen ni si realmente merece la pena complicarse la vida.

Por qué el rendimiento gráfico de una VM nunca es exactamente igual al del host

Una máquina virtual no deja de ser, a ojos del sistema anfitrión, un proceso de espacio de usuario. El hipervisor debe traducir continuamente llamadas del invitado hacia el hardware real, de modo que siempre hay una sobrecarga inevitable. Esa penalización se nota relativamente poco en CPU y RAM para muchas cargas, pero en gráficos y E/S (disco y red) suele ser más evidente.

En un escenario típico con KVM/QEMU y Debian o Ubuntu Server como host, las VMs de escritorio suelen usar un dispositivo gráfico virtual tipo Virtio-GPU (a menudo con un servidor VNC o SPICE para acceder al escritorio). Esta arquitectura hace que todo el renderizado de la VM pase por una capa adicional (el hipervisor, el protocolo remoto, el compositor del host, etc.), lo que se traduce en más latencia, menos FPS y una sensación general de fluidez peor que en el sistema físico.

Incluso cuando el hardware de base es potente (por ejemplo, un Ryzen 7 con una integrada Radeon Renoir capaz de mover sin despeinarse un escritorio 4K), la VM rara vez replica esa suavidad si se basa solo en gráficos virtuales estándar o en renderizado por software. Páginas web complejas, animaciones del escritorio y reproducción de vídeo en alto bitrate son los primeros escenarios donde se aprecia el bajón.

Además, hay que tener en cuenta la propia penalización general de la virtualización: en pruebas comparativas típicas, una VM bien configurada pierde alrededor de un 5-10 % de rendimiento de CPU, entre un 7-15 % de ancho de banda de RAM y un 15-25 % de IOPS de disco frente al bare-metal. En muchas cargas no es dramático, pero si encadenamos todo eso con la sobrecarga gráfica, la experiencia de escritorio puede resentirse bastante.

Por todo ello, la pregunta clave no es tanto si se puede llegar a rendimiento nativo (la respuesta honesta es que casi nunca al 100 %), sino qué mecanismos existen para acercarse lo máximo posible al comportamiento del host y qué compromisos implica cada uno.

Virtio-GPU, VirGL y gráficos 3D “por software” en KVM/QEMU

Virtio-GPU es hoy la opción por defecto en muchos entornos KVM cuando se busca algo mejor que los antiguos adaptadores VGA emulados. Permite compartir ciertas capacidades de aceleración entre host e invitado, y cuando se combina con SPICE o con un cliente que soporte esa pila, el rendimiento 2D suele ser razonable para ofimática ligera, navegación y entornos de desarrollo sin demasiadas florituras gráficas.

Sin embargo, cuando se activa VirGL para disponer de aceleración 3D en la VM, los resultados pueden variar mucho según la GPU física, los drivers y la carga. VirGL delega en el host la ejecución de comandos OpenGL de la VM, pero la traducción y el contexto añadido pueden hacer que, en hardware integrado modesto, el escritorio se vuelva incluso más lento que sin aceleración 3D: animaciones que se clavan, scroll menos fluido, vídeos que tiran de CPU en lugar de GPU, etc.

En máquinas con GPUs integradas tipo AMD Renoir o similares, no es raro que al habilitar VirGL el host simplemente no tenga suficiente margen para procesar toda esa capa extra, y la experiencia pase de “suficiente pero mejorable” a “directamente insufrible”. En ese contexto, esperar que VirGL convierta una VM en un clon perfecto del host gráficamente no es realista, sobre todo a resoluciones 4K con varios escritorios virtuales activos.

Por tanto, si lo que se busca es fluidez de escritorio tipo “PC real”, VirGL no suele ser la bala de plata. Es útil para ciertas pruebas 3D ligeras o aplicaciones que requieren algo de aceleración, pero no es equivalente a tener una GPU física dedicada en cada VM.

Passthrough de GPU: rendimiento casi nativo a cambio de rigidez

El enfoque más directo para lograr un rendimiento gráfico casi idéntico al del host es el passthrough (asignación directa) de GPU mediante IOMMU. Aquí, la VM ve la GPU física casi como si estuviera sola: se instalan los drivers nativos dentro del invitado y se obtiene un rendimiento muy cercano al bare-metal tanto en 2D como en 3D.

La contrapartida es que este esquema es bastante rígido: esa GPU queda “secuestrada” por la VM mientras está en marcha, y el host deja de poder utilizarla para su propio escritorio. En un servidor sin interfaz gráfica no es un problema, pero en un portátil o equipo donde se pretende tener host y VM compartiendo la misma pantalla y sesión, la cosa se complica.

Además, muchas configuraciones de passthrough pensadas para juegos o CAD requieren utilizar un monitor conectado físicamente a la salida de la GPU asignada a la VM. Esto implica cambiar de entrada en el monitor o tener dos pantallas, lo que rompe el objetivo de tener host e invitado “mezclados” en la misma experiencia visual.

Proyectos como Looking Glass permiten capturar el framebuffer de la VM (con GPU dedicada) y mostrarlo en el escritorio del host sin cambiar físicamente de monitor, pero es una solución que añade más dependencias, más pasos de configuración y más puntos de fallo. Para quien busca algo sencillo e integrado con Debian u otras distros, no siempre es la opción preferida.

En resumen, el passthrough clásico de GPU es ideal para escenarios donde se quiere la máxima potencia gráfica para una VM concreta (edición 3D, IA, juegos, CAD) y el host no necesita usar esa GPU para su propia interfaz. En cambio, para escritorios múltiples compartiendo la misma pantalla, su utilidad es más limitada a menos que se acepten compromisos de usabilidad.

SR-IOV, vGPU y GPU compartida por hardware: cómo funcionan y qué limitaciones tienen

Frente al modelo de “una GPU por VM”, las tecnologías de GPU compartida basada en hardware (vGPU) permiten que un único dispositivo físico se divida en varias instancias virtuales, de manera que cada VM obtenga una parte dedicada de la potencia gráfica sin tener que pagar una GPU por invitado.

Dentro de este paraguas encontramos varias familias: NVIDIA vGPU/GRID (RTX vWS, etc.), AMD MxGPU, Intel GVT-g y, en general, la virtualización basada en SR-IOV. En todas ellas, el objetivo es que los comandos gráficos de cada VM se pasen lo más directamente posible a la GPU, evitando la traducción costosa por parte del hipervisor y mejorando el rendimiento respecto a los gráficos emulados o paravirtualizados estándar.

La teoría suena perfecta, pero en la práctica hay varios matices importantes:

- No es una tecnología “mágica” ni completamente transparente. La VM sigue sabiendo que está hablando con un dispositivo especial, requiere drivers concretos y tiene restricciones en migraciones en caliente, snapshots y gestión de memoria dinámica.

- Muchas soluciones vGPU, especialmente en el caso de NVIDIA y AMD, están ligadas a tarjetas profesionales muy caras, con licenciamiento adicional y, en ocasiones, modelos de suscripción poco atractivos para usos domésticos o pequeños entornos on‑premise.

- El soporte oficial suele centrarse en hipervisores y sistemas operativos certificados (vSphere, Citrix Hypervisor, RHEL, etc.), de modo que en distros como Debian puede haber más fricción y menos documentación.

En definitiva, SR-IOV y vGPU mejoran claramente el rendimiento gráfico frente a Virtio/VirGL, pero no convierten la virtualización en algo indistinguible del bare-metal y exigen convivir con limitaciones técnicas y económicas que conviene valorar antes de lanzarse.

Intel GVT-g / KVMGT, Proxmox y la aceleración para escritorios ligeros

En el terreno de las GPUs integradas, especialmente de Intel, una de las tecnologías más interesantes ha sido Intel GVT-g (también llamado KVMGT). Su propósito es precisamente permitir que varias VMs compartan la iGPU del procesador, cada una con su propia “rebanada” acelerada, en lugar de tener que hacer passthrough exclusivo a una sola máquina virtual.

Para usos como navegar, ofimática, IDEs y aplicaciones 2D/3D ligeras, GVT-g puede suponer una mejora notable frente a los gráficos Virtio básicos, reduciendo el lag al arrastrar ventanas o abrir menús, y proporcionando aceleración por hardware para algunas operaciones que de otro modo recaerían entera en la CPU.

Ahora bien, su puesta en marcha manual sobre una instalación KVM/QEMU “a pelo” en Linux puede ser algo laboriosa: hay que toquetear la configuración de IOMMU, cargar módulos específicos, definir tipos de dispositivos vGPU, etc. Entornos como Proxmox VE simplifican este proceso, ofreciendo desde la interfaz web asistentes para configurar passthrough PCI y GPUs virtuales (como Intel KVMGT) sin pelearse tanto con los ficheros a bajo nivel.

Conviene aclarar varios puntos sobre qué se puede esperar realmente de GVT-g:

- La mejora gráfica existe, pero no hace milagros. Para las tareas típicas de escritorio que no exigen grandes cargas 3D, el salto de experiencia suele ser suficiente para que la VM se sienta más cercana a un equipo físico modesto, pero no es una solución para gaming exigente ni para render 3D pesado.

- No viene “pegado” al hipervisor por arte de magia. Es necesario que el kernel, la iGPU y el hipervisor soporten la tecnología, y aunque Proxmox lo expone mejor que una instalación manual, sigue habiendo requisitos de hardware y de versión.

- No todas las iGPU ni todas las plataformas Intel lo soportan igual. En generaciones más recientes la virtualización gráfica se está reorientando, y parte del foco se ha ido hacia productos móviles o de centro de datos.

Por tanto, si se cuenta con un procesador Intel compatible y se quiere sacar un plus de fluidez sin entrar en el mundo de las GPUs profesionales, GVT-g en un entorno como Proxmox es una opción razonable para mejorar la experiencia en escritorios ligeros dentro de VMs.

SR-IOV en GPUs modernas: qué ofrece y por qué no es la panacea

SR-IOV es una extensión de PCI Express que permite exponer un dispositivo físico como varias funciones virtuales, cada una asignable a una VM. Esta idea, muy madura en tarjetas de red, se ha ido aplicando también a algunas GPUs modernas, de forma que una única GPU puede proporcionar varias instancias vGPU con aislamiento razonable.

En el mundo de las integradas, una de las plataformas que más ruido ha hecho en este sentido es la de Intel Lunar Lake con gráficos Xe2, que en ciertos modelos admite SR-IOV en la iGPU. En teoría, esto permitiría que varias VMs Linux o Windows tuviesen acceso a capacidades gráficas aceleradas casi nativas, con mejor reparto de recursos que las aproximaciones puramente software.

Sin embargo, apoyarse exclusivamente en SR-IOV para decidir la compra de hardware es arriesgado por varios motivos:

- El soporte real de SR-IOV en GPUs aún es muy desigual entre fabricantes y modelos. En el caso de Intel, algunas integradas móviles lo ofrecen, mientras que las tarjetas discretas Xe2 de escritorio no, y las líneas de centro de datos Flex se orientan a otro segmento y tienen costes muy superiores.

- SR-IOV sigue exigiendo drivers específicos y mantenimiento, no es transparente para las VMs, y pueden aparecer incompatibilidades con determinadas versiones de kernel o hipervisor.

- La experiencia práctica muestra que, aunque la latencia y los FPS mejoran, no se elimina del todo la sobrecarga de la virtualización, ni se solucionan por sí solos otros cuellos de botella (CPU, memoria, disco, red).

Dicho de otra forma: SR-IOV ayuda, pero no es la “solución mágica” que convierte cualquier VM en un clon perfecto del host. Y, dado el estado actual del mercado, limitarse a buscar exclusivamente un portátil con Xe2 móvil solo por esta función puede ser innecesario si no se tienen cargas gráficas realmente exigentes.

Servidores físicos frente a entornos virtualizados: impacto global en CPU, RAM y disco

Más allá de la GPU, también es importante entender cómo se comportan CPU, memoria y almacenamiento en un entorno virtualizado comparado con un servidor físico, porque un cuello de botella en cualquiera de estos recursos puede agravar las sensaciones de “VM lenta”, incluso aunque la parte gráfica no sea el problema principal.

En términos generales, un servidor bare-metal ofrece el máximo rendimiento posible, ya que el sistema operativo se comunica directamente con el hardware sin la capa del hipervisor. En cambio, al introducir virtualización (KVM, Proxmox, VMware, Hyper‑V, etc.), el hipervisor debe arbitrar el acceso de varias VMs a los mismos recursos físicos, añadiendo cierta sobrecarga de gestión.

En benchmarks típicos se observa que:

- La CPU en VM suele rendir alrededor de un 5-8 % menos que en bare-metal, dependiendo del hipervisor.

- La RAM pierde algo de ancho de banda efectivo (del orden de un 7-13 %), por la traducción de direcciones y la contabilidad interna de memoria.

- El disco puede ver recortes de un 15-25 % en IOPS, especialmente cuando encima hay varias capas (storage remoto, almacenamiento en caché, etc.).

Esta penalización, aunque asumible, debe tenerse muy en mente cuando se evalúa si una aplicación con necesidades de latencia muy bajas (por ejemplo, bases de datos de altísimo rendimiento o motores de juego en tiempo real) se mantiene mejor en servidores físicos dedicados o se puede mover cómodamente a VMs sin sufrir.

Del mismo modo, en cargas intensivas en GPU (IA, renderizado 3D, CAD), un entorno bare‑metal con GPUs dedicadas mantendrá siempre una ligera ventaja frente a la virtualización, incluso con vGPU y passthrough, simplemente porque se ahorra toda la contabilidad adicional que realiza el hipervisor.

Qué tipo de cargas funcionan mejor en físico y cuáles en VMs

No todas las aplicaciones sufren igual en una VM. Algunas se adaptan estupendamente a la virtualización y otras siguen funcionando mejor sobre metal directo. Entender esa distinción ayuda mucho a decidir dónde tiene sentido invertir en GPU, en CPU o en ambos.

Entre los casos en los que un servidor físico dedicado suele ser la opción preferente se encuentran:

- Bases de datos de muy alto rendimiento (Oracle, SAP HANA, SQL Server Enterprise) que dependen de una latencia mínima y miles de IOPS constantes.

- Aplicaciones de renderizado y cómputo intensivo (Blender, AutoCAD, cargas de IA/ML pesadas) donde la GPU y el subsistema de disco trabajan al límite.

- Servidores de juego o streaming en tiempo real, donde una latencia baja y una respuesta consistente marcan la diferencia.

En cambio, la virtualización brilla con aplicaciones que se benefician de flexibilidad, escalabilidad y gestión centralizada, como:

- Servidores web, microservicios y APIs (Nginx, Apache, Kubernetes) que se ajustan bien a la lógica de escalar horizontalmente con múltiples VMs o contenedores.

- Escritorios virtuales y VDI (Windows 365, Citrix, etc.), donde el aislamiento y la administración central pesan más que el máximo FPS.

- Plataformas de desarrollo y pruebas (Jenkins, GitLab Runners, bancos de pruebas efímeros) que requieren clonación rápida, snapshots y facilidad de rollback.

Para el caso concreto de escritorios Linux o Windows usados para navegación web, ofimática y programación en un hipervisor como KVM o Proxmox, la virtualización es perfectamente viable. La clave está en dimensionar bien CPU, RAM y disco y en utilizar la mejor opción gráfica disponible para el hardware (Virtio-GPU con buena configuración, GVT‑g si se dispone de Intel compatible, o incluso passthrough/vGPU donde tenga sentido).

CPU, memoria y disco: cómo afectan a la sensación gráfica en la VM

A menudo se atribuye todo el “lag” de una VM al apartado gráfico, pero en muchos casos hay problemas previos de CPU, memoria o disco saturados que se traducen en una interfaz torpe, independientemente de la GPU.

Si la VM no tiene suficientes vCPU o la CPU física está sobrecargada (sobrecompromiso vCPU:pCPU muy alto), el hipervisor no consigue programar los procesos de la VM a tiempo. Métricas como CPU Ready en VMware o los contadores equivalentes en KVM/Proxmox ayudan a detectar este fenómeno: si el núcleo virtual pasa demasiado tiempo esperando turno (por encima de un 10 % del intervalo), la VM se vuelve lenta aunque la GPU esté infrautilizada.

Con la memoria ocurre algo parecido. Si se asigna poca RAM a la VM, el invitado empezará a usar swap, y cada cambio de ventana implicará lecturas y escrituras al disco. Si se sobreasigna memoria en el host y este mismo recurre a swap, tanto el sistema anfitrión como las VMs se verán penalizados. Aquí es crucial evitar el sobrecompromiso de memoria agresivo en producción.

En el apartado de almacenamiento, un subsistema de disco con latencias elevadas y pocas IOPS disponibles provocará cargas eternas de aplicaciones, tiempos de arranque largos y bloqueos frecuentes al escribir temporales. Las VMs que almacenan sus discos en HDD lentos o en cabinas saturadas notarán mucho más la penalización de la virtualización.

Por último, las instantáneas de disco acumuladas (por ejemplo, múltiples VMDK delta encadenados en VMware) añaden sobrecarga de lectura/escritura, ya que los datos se reparten entre varios ficheros. Mantener snapshots antiguos durante mucho tiempo es una forma segura de degradar el rendimiento de todas las VMs implicadas.

Buenas prácticas para mejorar el rendimiento gráfico (y general) de las VMs

Para sacar el máximo partido al hardware disponible y acercar la experiencia de las VMs a la de un equipo físico razonable, merece la pena tener en cuenta varias recomendaciones prácticas:

- Dimensionar bien CPU y memoria. No quedarse corto de vCPU ni de RAM, pero tampoco inflar núcleos y memoria “por si acaso”. Máquinas virtuales con demasiados vCPU pueden introducir problemas de co‑stop y planificación, empeorando el rendimiento en lugar de mejorarlo.

- Usar almacenamiento rápido. SSD, NVMe o storage de red con suficiente IOPS reducen drásticamente los tiempos de espera en arranque y carga de aplicaciones, lo que a su vez hace que el escritorio se sienta más fluido.

- Mantener actualizados drivers y herramientas de integración. En hipervisores comerciales, instalar VMware Tools, drivers de vGPU y similares mejora la gestión del ratón, resoluciones dinámicas y aceleración gráfica. En KVM/Proxmox, utilizar drivers Virtio y agentes invitados optimiza la comunicación Host‑VM.

- Evitar capas redundantes de virtualización. Ejecutar KVM dentro de otro hipervisor (o VMware sobre Hyper‑V, etc.) introduce más sobrecarga y puede reducir significativamente el rendimiento.

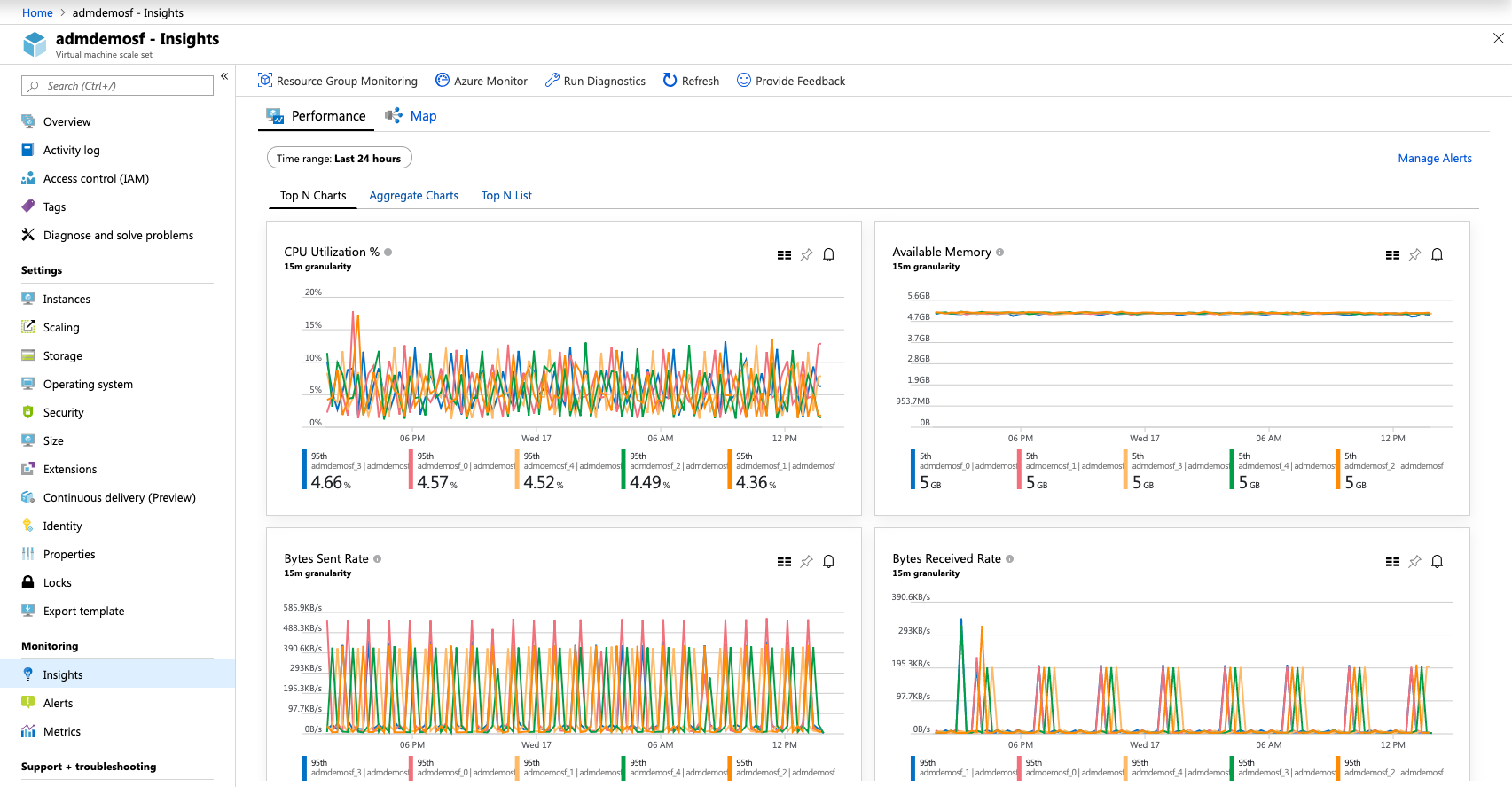

También es aconsejable monitorizar los recursos desde el host, no solo desde dentro de la VM. Herramientas como esxtop en ESXi, paneles avanzados en vCenter, o las métricas de Proxmox y RHEL para KVM permiten ver en qué medida cada VM consume CPU, RAM, disco y red, y detectar a tiempo las VMs “ruidosas” que deterioran la experiencia de las demás.

En conjunto, el rendimiento gráfico en máquinas virtuales modernas es el resultado de muchas piezas encajando: desde la elección entre Virtio-GPU, VirGL, passthrough o tecnologías de vGPU como SR-IOV o Intel GVT-g, hasta el tipo de almacenamiento, el sobrecompromiso de CPU y memoria, o la calidad de la red subyacente. Cuando todo se afina correctamente, las VMs pueden ofrecer una experiencia de escritorio muy cercana a la de un equipo físico para la mayoría de usos cotidianos, reservando los servidores bare-metal y las GPUs dedicadas para aquellas cargas excepcionales en las que cada milisegundo y cada frame por segundo marcan realmente la diferencia.

Redactor apasionado del mundo de los bytes y la tecnología en general. Me encanta compartir mis conocimientos a través de la escritura, y eso es lo que haré en este blog, mostrarte todo lo más interesante sobre gadgets, software, hardware, tendencias tecnológicas, y más. Mi objetivo es ayudarte a navegar por el mundo digital de forma sencilla y entretenida.