- Ang pagbabago ng isang file tungo sa isang intellectual dataset ay kinabibilangan ng pag-vectorize ng corpus, pagbuo ng mga relationship graph, at pagkonekta ng isang AI assistant upang galugarin ito para sa mga ideya.

- Ang kalidad, lokasyon, at masusing pagsusuri ng dataset ay kasinghalaga ng arkitektura ng modelo para sa pagkuha ng maaasahan at kontekstwal na AI.

- Ang anotasyon ng datos, na sinusuportahan ng mga partikular na kagamitan at proseso ng pagkontrol sa kalidad, ay nagbabago sa file tungo sa masasanayang hilaw na materyal para sa maraming gawain.

- Ang mga personal na file, bukas na repositoryo, at kunwang datos ay pinagsama upang lumikha ng mga ecosystem ng dataset na naaangkop sa mga sektor tulad ng kalusugan, transportasyon, pananalapi, o edukasyon.

I-convert ang isang personal na file sa isang buhay at kapaki-pakinabang na intelektuwal na dataset Hindi na ito para lamang sa malalaking laboratoryo: sinumang gumagawa ng digital na nilalaman sa loob ng maraming taon ay maaaring gawing isang knowledge base na maaaring gamitin sa paglalayag ang kasaysayang iyon at maging panggatong para sa mga sistema ng artificial intelligence. Ang interesante ay hindi lamang ang pag-save ng lahat ng iyong isinulat sa angkop na formatngunit upang ang mga piyesang iyon ay magkaugnay, magkaugnay, at maaaring konsultahin para sa mga ideya, konteksto, o aktor, na higit pa sa isang simpleng paghahanap gamit ang mga keyword.

Ang pagtalon mula sa isang static na file patungo sa isang dataset na may curated, annotated, at searchable Binubuksan nito ang pinto sa mga gamit mula sa isang personal na katulong na sinanay sa iyong sariling mga teksto hanggang sa pagbuo ng mga modelong lingguwistika na iniayon sa isang partikular na kultura o sektor. Sa artikulong ito, mahinahon at malinaw naming ipapaliwanag kung ano ang ibig sabihin ng pagtrato sa isang file bilang isang intelektuwal na dataset, kung paano ito teknikal na binuo, kung ano ang wastong kinakailangan sa pagsasalin o paglalagay ng anotasyon dito, kung anong mga kagamitan ang kasama, at sa anong mga konteksto sa totoong mundo ito ginagamit na.

Mula sa nakakalat na archive hanggang sa navigable na intellectual dataset

Isipin mong mahigit isang dekada ka nang nagsusulat ng mga artikulo tungkol sa [paksa/paksa] teknolohiya, regulasyon, privacy, o artificial intelligence sa iisang plataporma. Hihilingin mo ang kumpletong dump ng iyong mga teksto (isang plain text file na may libu-libong dokumento) at matatanggap mo ito sa loob lamang ng ilang minuto. Sa papel, mahalaga ang file na iyon: isinasama nito ang labing-apat na taon ng iyong proseso ng pag-iisip. Ngunit hangga't nananatili itong hindi nakabalangkas na teksto, wala ka nang magagawa pa kundi... maghanap ayon sa mga indibidwal na salita.

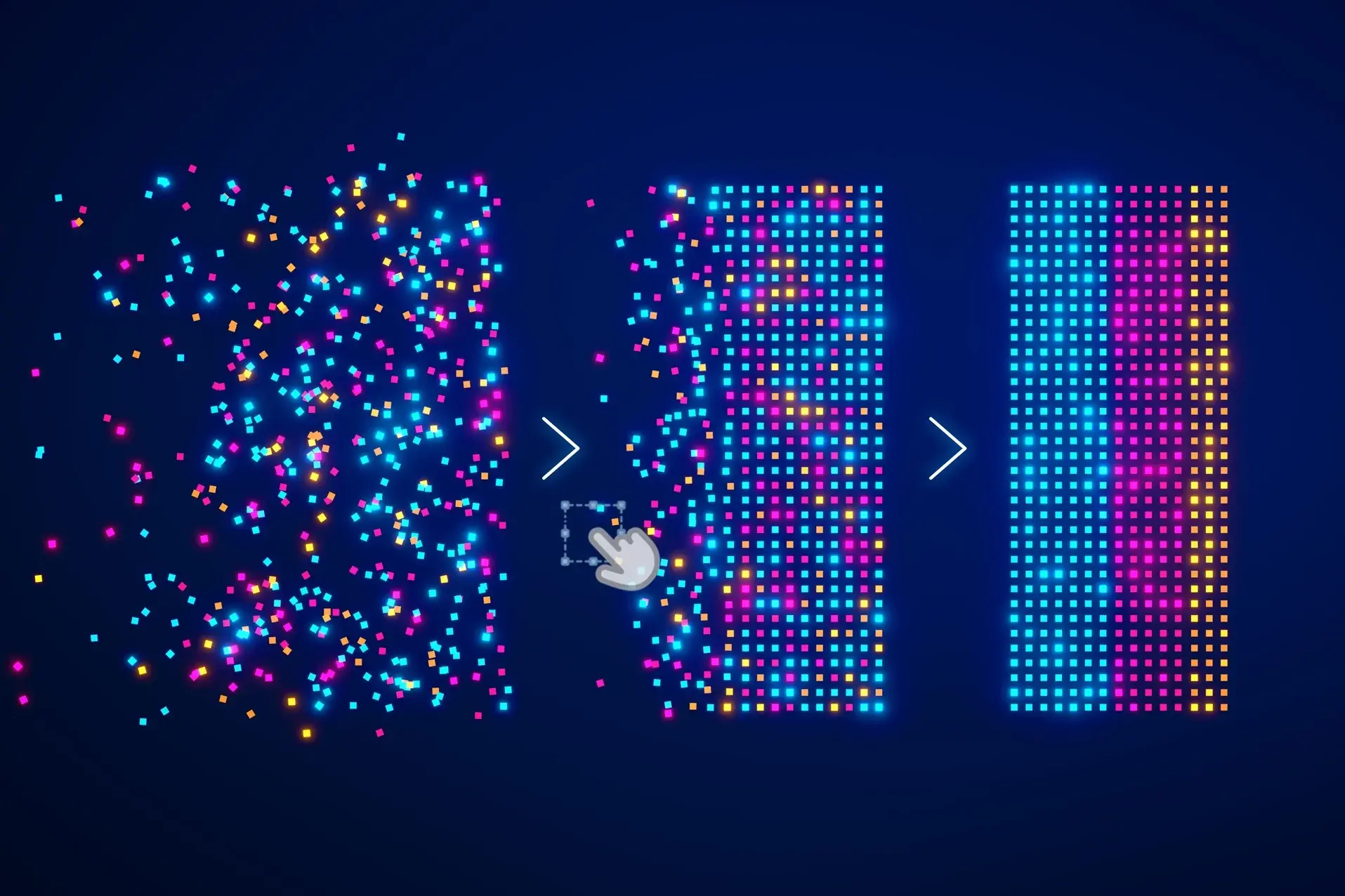

Ang unang konseptwal na pagbabago ay kinabibilangan ng pagtigil sa pagtingin sa file na iyon bilang isang tumpok ng mga dokumento at pagsisimulang ituring ito bilang isang magkakaugnay na corpus na maaaring i-index at tuklasinAng ideya ay baguhin ang bawat artikulo tungo sa isang numerikal na representasyon na kumukuha ng kahulugan nito, iimbak ang mga vector na iyon sa isang espesyalisadong database, at bumuo sa mga ito ng isang graph ng mga relasyon at isang katulong na lubos na nakakaintindi sa semantikong espasyong iyon.

Sa isang pag-aaral ng kaso sa totoong mundo na kinasasangkutan ng 4.209 na artikulong isinulat sa Ingles sa loob ng labing-apat na taon, gumamit ang may-akda ng isang modelo ng mga multilingual na pag-embed (paraphrase-multilingual-mpnet-base-v2, mula sa sentence-transformers) upang i-convert ang bawat teksto sa isang 768-dimensional na vector. Ang mga vector na ito ay nakaimbak sa ChromaDB, isang open-source vector database. Ang buong proseso, na pinapatakbo sa isang karaniwang server na walang GPU, ay natapos sa loob ng halos limang minuto: ang flat file ay binago sa isang tuluy-tuloy na espasyo ng mga ideya.

Sa pagsasagawa, nangangahulugan ito na hindi ka na maghahanap "ayon sa mga keyword" kundi sa pamamagitan ng mga konsepto, tanong, o mga piraso ng tekstoMaaari kang magtanong ng mga tanong tulad ng "Kailan ako nagsimulang magsulat tungkol sa mga monopolyo sa teknolohiya?" o "Aling mga artikulo ang konseptwal na malapit sa argumentong ito?" at tutugon ang sistema sa pamamagitan ng paghahanap ng pinakamalapit na mga vector sa semantikong espasyong iyon, kahit na hindi sila magkapareho ng bokabularyo. Ito ay isang direktang paraan upang mapalawak ang iyong memorya tungkol sa iyong sariling gawain.

Isang graph din ang binuo sa ibabaw ng vector layer na ito gamit ang NetworkX, kung saan ang bawat node ay kumakatawan sa isang artikulo at ang mga gilid ay nagdurugtong ng mga tekstong nagbabahagi ng mga thematic tag o lumalagpas sa isang tiyak na threshold ng semantic similarity. Kung isasalarawan sa mga tool tulad ng Gephi, ang resulta ay isang mapa ng iyong intelektwal na output na nakaayos sa mga kumpolRegulasyon, mga plataporma, privacy, artificial intelligence, electric mobility… at pati na rin ang mga hindi inaasahang koneksyon sa pagitan ng mga tekstong pinaghihiwalay ng mga taon ngunit magkalapit ang mga ideya.

Isang personal assistant ng ahente bilang daan patungo sa archive

Ang isa pang mahalagang elemento ng pamamaraang ito ay ang pagkakaroon ng katulong sa artificial intelligence na naka-angkla sa iyong dataset na maaaring gumana bilang isang patuloy na kolaborator, hindi lamang isang simpleng chatbot sa isang tab ng browser. Sa nakaraang halimbawa, ang assistant na iyon ay pinangalanang Bautista: isang agentic instance batay sa mga modelong Anthropic (Claude Sonnet 4.6) ngunit may kakayahang gumana sa iba pang mga modelo depende sa API na ginamit.

Si Bautista ay nasa sariling server ng awtor at inaayos gamit ang isang platform ng imprastraktura na parang OpenClaw, na namamahala sa persistent memory sa pagitan ng mga sesyon, mga channel ng komunikasyon (tulad ng Telegram), mga naka-iskedyul na gawain, at access sa mga tool tulad ng file system at pagpapatupad ng script. Dahil dito, ang assistant nagpapanatili ng pagpapatuloy sa paglipas ng panahonNaaalala nito ang mga nakaraang proyekto, pinapanatili ang mga file, awtomatiko ang mga proseso, at maaaring kumilos nang awtomatiko kapag inutusan.

Ang pagkakaiba kumpara sa pagbubukas ng generic na template sa browser ay hindi lang basta chat ang pinag-uusapan natin dito, kundi parang isang... naka-embed na collaborator sa iyong imprastraktura, dalubhasa sa sarili mong corpus at may kakayahang kumilos bilang tagapamagitan sa pagitan ng vectorized file na iyon at ng iyong pang-araw-araw na pangangailangan: paghahanap ng mga teksto, pagtukoy ng mga kalabisan, pagkuha ng mga sipi, pagpapatakbo ng mga partikular na pagsusuri o paglulunsad ng mga maintenance script.

Bukod pa rito, dinisenyo ang sistema upang mapanatiling buhay ang archive nang walang manu-manong interbensyon. Sa tuwing maglalathala ang may-akda ng isang bagong artikulo sa Medium at ibabahagi ang buong access link sa Bluesky, isang naka-iskedyul na proseso ang nagtatanong sa Bluesky public API araw-araw, tinutukoy ang bagong entry, dina-download ang teksto, binubuo ang embed code nito, at idinaragdag ito sa ChromaDB. Tinitiyak ng isang awtomatikong pipeline na ang dataset ay nag-a-update nang kusa., salamat sa mga gawain ng pag-index ng filepag-iwas sa klasikong problema ng pagiging lipas na ng mga knowledge base dahil ang pag-update ng mga ito ay isang mahirap na gawain.

Sa sumunod na yugto, idinagdag ang mga bagong patong ng pagsusuri, tulad ng pagkilala sa mga pinangalanang entidad (mga tao, kumpanya, teknolohiya, bansa, institusyon) sa buong corpus, na may layuning pag-aralan ang temporal na ebolusyon ng mga pagbanggit at mga network ng sabay na paglitawDahil dito, posibleng makita kung kailan lumilitaw ang isang aktor tulad ng OpenAI sa mga teksto, kung kailan nawawala ang Google+, o kung paano nauugnay ang iba't ibang ahente sa isa't isa sa paglipas ng panahon, na naglalapit sa sistema sa malawakang pagsusuri ng diskurso kaysa sa isang simpleng personal na archive.

Dataset, modelo at pag-uugali: ang file bilang hilaw na materyal para sa AI

Sa konteksto ng artipisyal na katalinuhan, ang isang Ang isang dataset ay higit pa sa isang koleksyon ng datosIto ang materyal sa pagsasanay na humuhubog sa pag-uugali ng modelo. Sa natural language processing (NLP), ang dataset na ito ay karaniwang nasa anyo ng mga teksto, diyalogo, tagubilin, o anotasyon na nagbibigay-daan sa mga modelo na matutong magsalin, magbuod, mag-usap, o mag-uri ng mga emosyon, bukod sa iba pang mga gawain.

Sa loob ng maraming taon, ang diin ay halos eksklusibong inilagay sa arkitektura ng modelo (bilang ng mga parameter, uri ng mga layer, kapasidad sa pag-compute), ngunit ipinakita ng kamakailang karanasan na ang kalidad, pagkakaiba-iba, at kaangkupan ng datos ng pagsasanay Ang bigat ng mga ito ay kasing bigat, o mas malaki pa nga, kaysa sa disenyo ng modelo. Gaya ng itinuturo ng mga pag-aaral tulad ng kina Bender et al. o Paullada et al., ang mga modelo ay hindi mas mahusay kaysa sa datos na nagpapakain sa kanila: kung ang dataset ay may kinikilingan, hindi kumpleto, o hindi representatibo, uulitin ng AI ang mga parehong depekto.

Ang pagbabagong ito sa pananaw ay nagtulak ng isang malinaw na kilusan tungo sa kalidad kaysa damiHindi lamang ito tungkol sa pagkolekta ng napakaraming teksto, kundi tungkol sa pagtiyak na ang datos na ito ay naaayon sa wika, rehiyonal na pagkakaiba-iba, at kontekstong kultural kung saan ilalapat ang AI (Blasi et al., Kreutzer et al.). Ito ay lalong mahalaga kung iisipin natin ang isang archive bilang isang intelektuwal na dataset: ang personal na corpus ng isang may-akda ay maaaring maging napakayaman, ngunit kung gagamitin ito para sa mga modelong gumagana sa ibang mga wika o merkado, ang curation at adaptation ay nagiging kritikal.

Bukod pa rito, ang dataset ay hindi lamang kapaki-pakinabang para sa pagsasanay, kundi pati na rin para sa suriin ang pagganap ng modeloKung ang isang modelo ay sinusuri gamit ang datos na nakita na nito sa panahon ng pagsasanay (kontaminasyon ng datos), makukuha ang mga nakaliligaw na sukatan na nagtatakip sa tunay nitong mga limitasyon, gaya ng sinuri nina Dong et al. at Samuel et al. Samakatuwid, kapag naglilipat ng isang personal na file sa isang konteksto ng AI, mahalagang matukoy kung aling mga bahagi ang ginagamit para sa pagsasanay, alin ang para sa pagpapatunay, at alin ang para sa pagsubok, pati na rin ang pagdisenyo ng mayaman at mapaghamong mga set ng pagsusuri, sa halip na mga walang kabuluhang pagsubok na lahat ng modelo ay pumasa.

Pagsasalin at pag-localize ng mga dataset: higit pa sa paglilipat lamang ng teksto mula sa isang wika patungo sa isa pa

Kapag gusto mong gamitin muli ang isang file tulad ng Intelektwal na datos sa iba't ibang wika o pamilihanIsang partikular na hamon ang lilitaw: ang pagsasalin at lokalisasyon ng corpus. Sa unang tingin, maaaring mukhang isa lamang itong proyekto sa pagsasalin, ngunit ang isang AI dataset ay kadalasang binubuo ng mga nakahiwalay na fragment, maluwag na diyalogo, maiikling tagubilin, o nakabalangkas na datos na walang malinaw na konteksto ng naratibo, na ganap na nagbabago sa mga patakaran ng laro.

Sa maraming dataset, makikita natin napakalimitadong kontekstoIto ay mga pariralang walang impormasyon tungkol sa kung sino ang nagsasalita, ang sitwasyon, o ang kanilang intensyon. Kailangang mahinuha ng tagasalin ang mga pragmatikong tungkulin (isang utos, isang pagdududa, isang insulto, isang ironiya) upang maayos na matutunan ng modelo ang kilos sa target na wika. Bukod pa rito, may mga elementong hindi dapat galawin, tulad ng mga snippet ng code, mga baryabol, mga placeholder, o mga teknikal na label, kung saan ang isang walang muwang na pagsasalin ay maaaring makasira sa dataset.

May kinalaman din ang malawakang pagkakapare-pareho: tila maliliit na desisyon, tulad ng pagpili sa pagitan ng "tú" o "usted," paghawak sa inklusibong kasarian, o ang pagtrato sa ilang partikular na Anglisismo, Pinarami ang mga ito ng milyun-milyong halimbawa.Ang isang hindi pagkakapare-pareho na maaaring hindi mapansin sa isang libro ay nagiging ingay dito na isinasapuso ng modelo. At, hindi tulad ng sa pagsasalin ng editoryal, kadalasan ay pinakamahusay na panatilihin ang mga pagkakamali sa gramatika o kolokyalismo ayon sa kanilang hitsura, dahil ang layunin ay hindi "pakintab" ang teksto, kundi turuan ang AI kung paano talaga ipinapahayag ng mga tao ang kanilang mga sarili.

Kaya naman, sa halip na isalin, mas angkop na pag-usapan ang hanapin ang mga datasetKabilang dito ang pag-aangkop ng mga sangguniang kultural, mga pangalan ng mga institusyon, mga tatak, mga format ng petsa, mga pera, at mga yunit ng pagsukat, at pagsasaayos ng rehistro sa mga pamantayang panlipunan ng target na merkado. Sa mga modelo ng malalaking wika, ang lokalisasyong ito ang nagpapaiba sa isang AI na "nagsasalita lamang ng Espanyol" mula sa isa na nakakaintindi ng mga kultural na nuances, mga inaasahan sa pagiging magalang, at mga lokal na sanggunian.

Ang mga kompanyang may mahabang kasaysayan sa software at content localization, tulad ng imaxin, ay umuunlad patungo sa pagsasalin at partikular na pag-uuri ng mga datasetPinagsasama ang kadalubhasaan ng tao, mga pinong-tuning gabay sa istilo, mga piling glosaryo, at mga kagamitan sa pagsasalin na tinutulungan ng computer at makina, ang kanilang pamamaraan ay higit na kahawig ng isang proseso ng pagkontrol sa kalidad ng datos kaysa sa tradisyonal na pagsasalin: tumpak na kahulugan ng mga pamantayang lingguwistiko at teknikal, pamamahala ng mga sinasadyang pagkakamali, paggamit ng awtomatikong QA, at statistical sampling upang masubaybayan ang pagkakapare-pareho.

Anotasyon ng datos: pagbibigay ng istruktura at kahulugan sa datos

Para maging isang file Isang tunay na kapaki-pakinabang na intelektwal na dataset para sa mga pinangangasiwaang modeloHindi sapat ang basta pagkolekta lamang ng mga teksto: dapat itong lagyan ng anotasyon. Ang isang dataset na may anotasyon ay isa kung saan ang bawat elemento (larawan, audio fragment, pangungusap, talahanayan) ay binigyan ng metadata na naglalarawan sa nilalaman o tungkulin nito: mga tag, kategorya, entity, relasyon, transcript, bounding box, atbp.

Halimbawa, sa computer vision, maaaring kabilang sa mga anotasyon ang mga pandaigdigang label ng klasipikasyon, mga bounding box sa paligid ng mga bagay, mga segmentation mask na nagtatalaga ng kategorya sa bawat pixel, mga anotasyon ng mga pangunahing punto (mga kasukasuan ng tao, mga punto sa mukha), o mga trajectory sa isang video. Sa teksto, pinag-uusapan natin ang tungkol sa mga entry ng mga pinangalanang entity (mga tao, organisasyon, lugar), klasipikasyon ng dokumento, sintaktikong pagsusuri, mga ugnayan sa pagitan ng mga entidad, o mga sentiment tag.

Ang layunin ng lahat ng gawaing ito ay para magkaroon ang mga modelo ng malinaw na mga halimbawa ng kung ano ang dapat nilang kilalanin o hulaanAng isang dataset ng mga larawang may anotasyon na may mga pusa, kotse, at mga naglalakad ay nagbibigay-daan sa mga modelo ng pagsasanay na nakakakita at nakakauri sa mga bagay na ito; ang isang dataset ng mga pag-uusap na may mga tag ng intent at emotion ay nagbibigay-daan sa pagsasanay ng mga chatbot at mga sistema ng pagsusuri ng sentimento; ang isang documentary corpus na may mga minarkahang entity at tahasang mga ugnayan ay naglalatag ng pundasyon para sa mga sistema ng pagkuha ng kaalaman.

Ang anotasyon ay hindi limitado sa teksto o mga imahe: sa audio, kabilang sa mga gawain ang transkripsyon, paglalagay ng tag sa mga pangyayari sa tunog (palakpakan, tawanan, putok ng baril), segmentasyon ayon sa tagapagsalita, at pagtatatak ng oras ng mga keyword. At sa multimodal na datos (halimbawa, video na may audio at mga subtitle), ginagawa ang trabaho sa pag-aayon ng mga modalidad at paglalagay ng anotasyon sa mga interaksyon (ekspresyon ng mukha kasama ang tono ng boses kasama ang nilalaman ng teksto).

Sa larangan ng nakabalangkas at tabular na datos, ang pagbibigay ng anotasyon ay nangangahulugan din ng Ipaliwanag ang kahulugan ng mga kolum at mga halagaKabilang dito ang pag-uugnay ng mga katumbas na entry sa mga database o pagmamarka ng mga kaugnay na katangian para sa mga gawain sa prediksyon. Ang bawat uri ng proyekto ay pipili ng isa o isa pang hanay ng mga anotasyon, at kadalasan ay marami ang pinagsama upang masakop ang mga kumplikadong kaso ng paggamit.

Mga tool at proseso para sa pag-annotate ng isang file bilang isang dataset

Ang pagtatala ng datos sa malawakang saklaw ay nangangailangan ng mga partikular na kagamitan at mahusay na pinag-isipang mga daloy ng trabahoHindi pareho ang manu-manong paglalagay ng label sa ilang dosenang larawan kumpara sa pamamahala ng daan-daang libong halimbawa sa iba't ibang format kasama ang mga pangkat na nakakalat sa iba't ibang time zone.

Sa computer vision, ginagamit ang mga open-source na solusyon tulad ng LabelImg (para sa mga bounding box), CVAT (para sa kumplikadong anotasyon ng imahe at video na may mga collaborative feature), o mga komersyal na platform tulad ng Labelbox o SuperAnnotate, na kinabibilangan ng quality analytics, pamamahala ng proyekto, at automation. Para sa teksto, pinapadali ng mga tool tulad ng Prodigy, LightTag, BRAT, o Datasaur ang anotasyon ng mga entity, klasipikasyon, syntactic dependencies, at mga relasyon, na may detalyadong pagsubaybay sa mga annotator at conflict.

Sa audio, ang software tulad ng Label Studio, Praat, o Sonix ay nagbibigay-daan para sa tumpak na segmentasyon, transkripsyon, at paglalagay ng label sa mga tunog. Para sa multimodal na datos, ang mga magaan na proyekto tulad ng VGG Image Annotator (VIA) o mga application tulad ng RectLabel ay nag-aalok ng maraming nalalaman na pundasyon para sa pag-synchronize ng mga anotasyon sa iba't ibang uri ng datos. At para sa mga proyektong nangangailangan ng mataas na volume at bilis, ang mga platform tulad ng automation at malawakang kolaborasyon tulad ng Amazon SageMaker Ground Truth, Scale AI, DataLoop o mga solusyong kolaboratibo tulad ng Digma o Hive Data.

Ang pagpili ng tool ay hindi lamang usapin ng personal na kagustuhan: kailangan mong isaalang-alang ang uri ng data, badyet, laki ng team, ang pangangailangan para sa real-time na kolaborasyon, at ang laki ng dataset. Halos lahat ng advanced platform ay may kasamang mga feature para sa pagpapatunay ng mga pangunahing panuntunan, pamamahala ng mga conflict, pagsukat ng produktibidad at kalidad, at pagsasama-sama ng human annotation sa mga automated na mungkahi na nabuo ng mga dati nang modelo.

Higit pa sa mismong kagamitan, ang kalidad ay natutukoy ng proseso. Nagbibigay ng napakalinaw at napapanahong mga gabay sa anotasyonKabilang dito ang pagsasanay sa mga annotator (lalo na sa mga sensitibong larangan tulad ng medisina), pag-oorganisa ng mga cross-review, pagtukoy sa mga sukatan ng kalidad (pagkakasundo, katumpakan, paggunita sa pagitan ng mga annotator), at paggamit ng datos na "gold standard" na napatunayan ng mga eksperto upang i-calibrate ang pangkat. Ang pag-annotate ng isang file bilang isang intellectual dataset ay hindi isang sprint, kundi isang tuluy-tuloy at paulit-ulit na siklo.

Maraming proyekto ang pumipili ng hybrid na pamamaraan: ang mga simple o paulit-ulit na gawain (hal., paunang pagtuklas ng bagay o paunang pag-uuri ng teksto) ay awtomatiko, at ang gawain ng tao ay nakalaan para sa mga kaso na hindi malinaw, kumplikado, o may malaking epektoBinabawasan nito ang mga gastos nang hindi isinasakripisyo ang kalidad at nagbibigay-daan sa mga tagasuri na tumuon kung saan sila nagdaragdag ng pinakamalaking halaga.

Mga aplikasyon sa totoong mundo ng mga annotated at intelektuwal na dataset

Ang pagtrato sa isang file bilang isang intelektuwal na dataset ay hindi isang teoretikal na pagsasanay: mayroon itong mga konkretong aplikasyon sa maraming sektor kung saan ang anotasyon at curation ay susi sa pag-deploy ng maaasahang AI. Sa computer vision, halimbawa, ang mga annotated na imahe at video set ay nagbibigay-daan sa pagbuo ng mga sistema ng pagkilala sa mukha, pagtukoy ng anomalya sa X-ray o MRI, mga automated na inspeksyon sa pabrika, o mga autonomous na sasakyan na Tinutukoy nila ang mga naglalakad, mga karatula, at mga balakid en tiempo real.

Sa natural language processing, ang mga well-localized at annotated datasets ay nagbibigay-daan sa mga gawain tulad ng sentiment analysis sa social media, pag-uuri ng mga query sa customer service, entity extraction sa mga legal na dokumento, machine translation, o pagsasanay ng mga chatbot na nakakaintindi ng... mga emosyonal na nuances at kontekstong kulturalAng isang personal na archive ng mga artikulo ay maaaring maging batayan ng isang dalubhasang katulong na, bago maglathala ng isang bagong bagay, ay sinusuri ang nasabi na, nakakakita ng mga pag-uulit, o natutukoy ang mga pagbabago sa postura sa paglipas ng mga taon.

Ang kalusugan at biotechnology ay lalong umaasa sa mga dataset na may mataas na anotasyon: mga medikal na larawan na may kumpirmadong diagnosis, nakabalangkas na mga klinikal na rekord, at mga genomic sequence na may label na may mga kaugnay na mutasyon. Sa automotive at transportasyon, ang data ay mahalaga para sa autonomous driving, matalinong pagpaplano ng ruta, at pamamahala ng trapiko. Sa komersyo at pagbabangko, ginagamit ito para sa Mga tagarekomenda ng produkto, pagtuklas ng pandaraya, at pagsusuri ng panganib.

Ang iba pang mga larangan tulad ng precision agriculture, kapaligiran, seguridad at depensa, mga video game, virtual reality, edukasyon, at siyentipikong pananaliksik ay gumagamit ng mga annotated dataset upang subaybayan ang mga pananim, suriin ang mga imahe ng satellite, lumikha ng mga nakaka-engganyong karanasan, gawing personal ang pagkatuto, o mapabilis ang mga pagtuklas sa biology o astrophysics. Sa lahat ng mga ito, ang lohika ay magkatulad: Ang mas maayos na istruktura at dokumentado (halimbawa, kasama ang Mga README file) Kung mas maganda ang dataset, mas maganda rin ang magiging mga modelong idinisenyo rito..

Kung titingnan natin ang file bilang isang intellectual dataset sa isang personal key, ang value ay nasa power kumonsulta agad sa lahat ng iyong nalalaman at naisulatPag-unawa kung paano umunlad ang iyong mga ideya, pagtuklas ng mga puwang sa tematika, pag-uugnay ng mga teksto mula sa mga sinaunang panahon, at paggamit ng malawak na memoryang iyon sa iba pang mga konteksto, tulad ng pagtuturo, pananaliksik, o estratehiya sa negosyo. Ang lahat ng ito ay hindi iniaatas ang pagsusulat sa makina, kundi ginagamit ang AI bilang isang kasangkapang pansuporta upang beripikahin ang datos, maghanap ng mga sanggunian, o subukan ang mga argumento.

Saan makakahanap ng mga dataset at kung paano awtomatiko ang paggawa ng mga ito

Hindi lahat ng dataset ay nagmumula sa mga personal na file: marami ang nagmumula sa mga bukas na repositoryo at pampublikong mapagkukunan Ang mga mapagkukunang ito ay kapaki-pakinabang para sa pagsasanay at pagsusuri ng mga modelo, o para sa mga proyektong pananaliksik, pamamahayag ng datos, at estratehikong pagsusuri. Ang internet ay nag-aalok na ng maraming mapagkukunan na maaaring magamit, palaging may angkop na legal at etikal na konsiderasyon.

Halimbawa, ang social network na X (dating Twitter) ay nag-aalok ng mga API na nagbibigay-daan sa mga user na mangolekta ng mga tweet na sinala ayon sa mga hashtag at iba pang pamantayan. Ang datos na ito ay maaaring ibalangkas sa mga talahanayan at i-visualize gamit ang mga tool tulad ng Tableau. Ang Google Dataset Search ay nagbibigay ng isang espesyalisadong search engine para sa mga pampublikong dataset, kung saan mahahanap ng mga user ang lahat mula sa mga database ng enterprise hanggang sa mga istatistika ng industriya. Ang mga blog tulad ng FiveThirtyEight ay naglalathala ng kanilang mga dataset tungkol sa politika, palakasan, at lipunan upang ang sinuman ay maaaring kopyahin o palawakin ang kanilang mga pagsusuri.

Kasabay nito, parami nang parami ang mga ito ay ginagamit mga kunwaring kapaligiran upang awtomatikong makabuo ng mga datos na may anotasyonLalo na sa mga larangan tulad ng mga autonomous na sasakyan, kung saan ang muling paglikha ng lahat ng mga kondisyon ng realidad sa pisikal na mundo ay magiging mabagal, magastos, at mapanganib. Pinapayagan ng mga simulator ang paggawa ng mga imahe at video na may perpektong mga anotasyon (mga posisyon ng mga bagay, kondisyon ng panahon, mga tilapon) at ang paggalugad ng mga matinding senaryo na mahirap makuha sa totoong datos.

Ang hinaharap ay tumutukoy sa isang kombinasyon ng mga napiling datos mula sa totoong mundo, mga personal na archive na itinuturing bilang intellectual corpora, at mga sintetikong datos na nabuo sa simulation, lahat ay kinoordina gamit ang mga supervised, semi-supervised, unsupervised, at self-supervised learning techniques. Ang anotasyon ay mananatiling isang mahalagang elemento, ngunit lalong tinutulungan ng mga modelo na Nagpapanukala sila ng mga etiketa, nakakakita ng mga hindi pagkakapare-pareho, at sumusukat ng mga pagkiling.iniiwan ang mas magagandang desisyon sa mga tao.

Sa kontekstong ito, nagiging mahalaga ang etikal at regulasyong dimensyon: ang paghawak ng mga personal na file bilang mga dataset ay nangangailangan ng paggalang sa privacy, copyright, at mga inaasahan sa paggamit, habang ang crowdsourcing o mga platform ng mass collaboration ay dapat tiyakin ang patas na mga kondisyon para sa mga annotator at transparency tungkol sa kung aling mga modelo ang sinanay gamit ang datos na kanilang nalilikha.

Kapag maingat na pinamamahalaan ang buong kadenang ito—mula sa pagkuha ng personal na file hanggang sa pag-vectorize, pag-graph, paghahanap, pag-annotate, pag-automate ng mga update, at pagkonekta nito sa mga AI assistant—may makukuha kang isang bagay na kakaunti lang ang mga awtor, kumpanya, o organisasyon ngayon: isang malalim, pare-pareho, at buhay na intelektuwal na datoskayang paganahin ang mga sistema ng artificial intelligence na tunay na naaayon sa boses, konteksto, at mga layunin ng mga nagpapatakbo sa mga ito, at magsilbing pinalawak na memorya sa isang mundong lalong puspos ng impormasyon.

Masigasig na manunulat tungkol sa mundo ng mga byte at teknolohiya sa pangkalahatan. Gustung-gusto kong ibahagi ang aking kaalaman sa pamamagitan ng pagsusulat, at iyon ang gagawin ko sa blog na ito, ipakita sa iyo ang lahat ng mga pinaka-kagiliw-giliw na bagay tungkol sa mga gadget, software, hardware, teknolohikal na uso, at higit pa. Ang layunin ko ay tulungan kang mag-navigate sa digital na mundo sa simple at nakakaaliw na paraan.