- Heavy/Expert für Präzision und komplexe Aufgaben; Fast/Grok-4-Fast für minimale Latenz; Automatischer Lastausgleich basierend auf der Abfrage.

- Echtzeit-Webzugriff und die Nutzung nativer Tools unterscheiden Grok von Modellen ohne diese aktiven Funktionen.

- Grok-4-Fast bietet 2 Millionen Kontext-Tokens, Tool-Use-RL und weniger "Gedanken"-Tokens, wodurch die Kosten gesenkt werden.

- Tarife und Bereitstellung: Heavy ~300 $/Monat, Standard ~30 $/Monat; Grok4Fast befindet sich in der Testphase für Abonnenten.

Wenn Sie sich jemals gefragt haben, wie Sie das Beste aus einem Produkt herausholen können IA Für alle, die sich unterwegs im Internet informieren und mit mehr als einem Agenten gleichzeitig interagieren, gibt es hier eine vollständige Anleitung zum Verständnis der Funktionen der Modi „Schwer“, „Experte“, „Schnell“ und „Auto“ von Grok. Entscheidend ist die Wahl des richtigen Modus, je nachdem, ob Sie Wert auf Geschwindigkeit, Analysetiefe oder automatischen Lastausgleich legen..

Grok 4, entwickelt von xAI (dem Unternehmen von Elon Musk und integriert in die X-Plattform), bietet vielversprechende Möglichkeiten: Echtzeit-Webbrowsing, Nutzung nativer Tools und eine „Heavy“-Version mit Multiagentenarchitektur. Da die Preise und Funktionen, die bei anderen Modellen üblicherweise nicht standardmäßig aktiviert sind, unterschiedlich sind, ist es hilfreich zu wissen, wofür die einzelnen Modi ihre Stärken haben und wann man sie einsetzen sollte..

Welche Modi bietet Grok an und in welchen Situationen eignet sich welcher Modus?

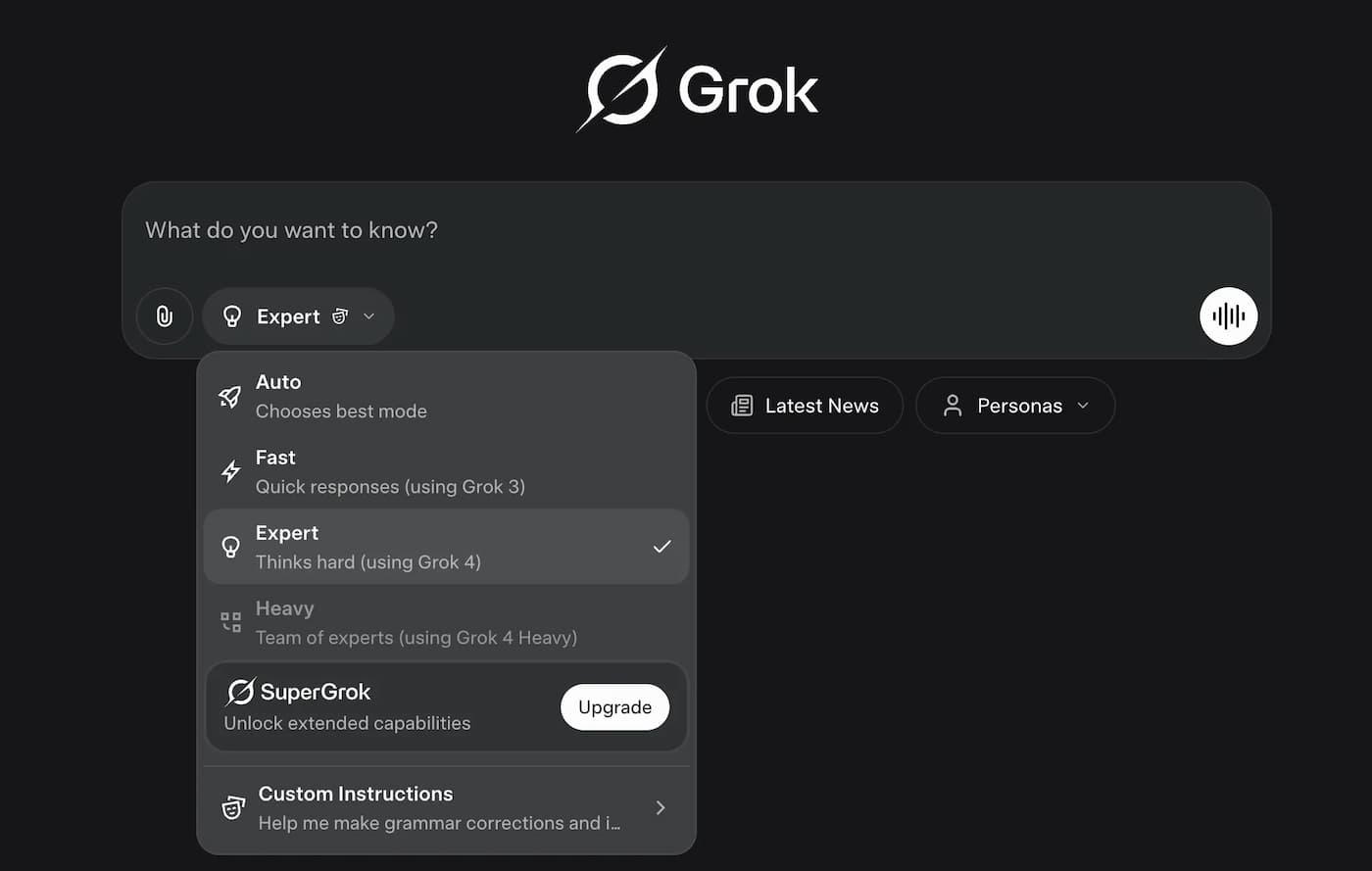

Die Grok-Familie hat ihr Angebot diversifiziert, um ganz unterschiedliche Bedürfnisse abzudecken, von sofortigen Antworten bis hin zu komplexen, mehrstufigen Schlussfolgerungen. Heavy, Expert, Fast und Auto sind keine Werbebezeichnungen, sondern Arbeitsmodi mit realen Auswirkungen auf Kosten, Latenz und Qualität..

- Schwerer ModusEntwickelt für anspruchsvolle Projekte mit mehreren Schritten und Spezialisierungen gleichzeitig. In Grok 4 Heavy arbeiten mehrere interne Agenten „im Hintergrund“ zusammen (ein Agent plant, ein anderer überprüft, ein weiterer schreibt) – ideal für Engineering, Softwareentwicklung, technische Forschung und umfassende Analysen. Wenn Sie Genauigkeit und tiefgründige Argumentationsketten benötigen, ist dies das Premium-Profil..

- ExpertenmodusDer Expertenmodus ist auf präzise und analytische Antworten ausgerichtet, ohne das Multiagentensystem von Heavy vollständig auszuschöpfen. Bei Fragen, die Geduld, Gründlichkeit und Überprüfung erfordern, benötigt der Expertenmodus etwas länger, liefert aber in der Regel präzisere Ergebnisse als ein Modus mit extrem niedriger Latenz. Bei komplexen Abfragen, technischen Berichten oder anspruchsvollen mathematischen Berechnungen macht Expert oft den entscheidenden Unterschied..

- SchnellmodusSchnelles Gameplay, minimale Latenz. Dieser Modus ist optimiert für „Expressfragen“, schnelle Zusammenfassungen, gezielte Suchanfragen und alltägliche Aufgaben. Wenn es Ihnen wichtiger ist, eine Antwort zu erhalten, als jede Nuance herauszuarbeiten, glänzt Fast durch seine Unmittelbarkeit..

- Auto-ModusEin intelligenter Selektor, der anhand der Suchanfrage und der Kosten-/Zeitbeschränkungen die optimale Strategie auswählt. In der Praxis wählt er bei einfachen Aufgaben einen ressourcenschonenden Ansatz und aktiviert bei komplexen Aufgaben eine tiefergehende Analyse. Für alle, die nicht manuell zwischen den Modi wechseln möchten, sucht der Auto-Modus nach einem ausgewogenen Verhältnis zwischen Geschwindigkeit und Tiefe..

Grok 4 vs Grok 4 Heavy: Unterschiede, die im Alltag spürbar sind

Der Grok 4 „Standard“ ist ein sehr leistungsfähiges und vielseitiges Modell, aber der Grok 4 Heavy setzt mit der Koordination mehrerer spezialisierter interner Komponenten neue Maßstäbe. Dieses Multiagentensystem ermöglicht es, ein komplexes Problem in Teilaufgaben zu zerlegen und gemeinsam zu lösen..

Diese interne Teamarbeit führt zu besseren Ergebnissen bei der Programmierung, der technischen Analyse, der Forschung und Aufgaben mit mehreren Abhängigkeiten. Wenn Sie mit langen Pipelines arbeiten (z. B. planen → suchen → verifizieren → synthetisieren), bietet Heavy mehr Sicherheit und Konsistenz..

Beide Varianten nutzen Echtzeit-Tools (Rechner, Web-Browsing, Inhaltsextraktion usw.) mit einem klaren Fokus auf aktuelle Antworten. Bei Grok 4 ist das Internet nicht nur Dekoration; es wird live konsultiert, um Fakten zu überprüfen und einen aktuellen Kontext bereitzustellen..

Webzugriff und Tool-Nutzung in Echtzeit: Warum sie wichtig sind

Die meisten LLM-Experten stützen sich hauptsächlich auf ihr „Erinnerungsvermögen“ und wurden mit veralteten Daten geschult. Grok empfiehlt, während der Beantwortung der Fragen das Internet zu konsultieren. Das ist Gold wert, wenn Sie aktuelle Daten, aktuelle Referenzen benötigen oder etwas bestätigen möchten, das sich diese Woche geändert hat..

Darüber hinaus ist die Nutzung von Tools nativ integriert: Code ausführen, suchen, eine Seite scrapen… alles innerhalb des Antwortablaufs. Für Sie bedeutet das weniger Kopieren und Einfügen zwischen Apps und mehr Autonomie für den Assistenten, um das Notwendige mitzubringen.

Grok-4-Fast: Geschwindigkeit, 2-Minuten-Token-Fenster und weniger „Denken“ pro Aufgabe

xAI hat einen neuen Modus namens Grok4Fast (verfügbar für einige Abonnenten) getestet, der die Antwortzeiten beschleunigt, insbesondere bei mathematischen oder komplexen Fragen, bei denen die Starten Das ist meistens der langsame Teil. Es scheint fast sofort zu antworten, was man sehr schätzt, wenn man es eilig hat..

Was bietet es im Vergleich zu früheren Schnellmodi? Grok-4-Fast mischt logisches und nicht-logisches Verhalten im selben Gewichtungsraum; je nach „Systemaufforderung“ wird das eine oder das andere aktiviert. Dies ermöglicht es Ihnen, die Gänge im Handumdrehen zu wechseln, von Turbo auf Präzision, ohne das Modell wechseln zu müssen..

Drei praktische Punkte sind hervorzuheben: 1) extremer Kontext von bis zu 2 Millionen Tokens (Platz für eine umfangreiche Dokumentation), 2) Training zur Entscheidung, wann Werkzeuge eingesetzt werden sollen (Tool-Use RL) und 3) weniger „Denk“-Tokens (~40 % weniger, um die Genauigkeit von Grok-4 zu erreichen), was die Kosten bei hohen Lasten senkt. Wenn Sie autonome Agenten oder Assistenten mit Langzeitgedächtnis verwalten, finden Sie hier Einsparungen und Agilität..

In Community-Tests ist der Sprung in der Latenz gegenüber der aktuellen Fast-Version deutlich spürbar: fast keine Wartezeiten und ein sehr reibungsloses Nutzungserlebnis. Es bleibt jedoch abzuwarten, ob seine Leistungsfähigkeit stets mit der von Experten mithalten kann, wenn es auf den Grad der Nuancen ankommt..

Um es zu aktivieren (falls die Option angezeigt wird), gehen Sie zur Webversion von Grok, tippen Sie auf Ihren Avatar → Einstellungen → Grok-Abonnement und aktivieren Sie „Frühes Vorschaumodell“; dort können Sie Grok4Fast auswählen. Diese Funktion ist derzeit nicht für kostenlose Konten verfügbar; sie steht nur Abonnenten zur Verfügung..

Wann welcher Modus gewählt werden sollte: Klare Szenarien zur Vermeidung von Verwirrung

- Kurze Fragen und alltägliche AufgabenWenn es vor allem auf Schnelligkeit ankommt (Zusammenfassungen, Erläuterungen, konkrete Anfragen), wenden Sie sich bitte an Fast oder Grok-4-Fast.

- Mehrstufige technische ProblemeSetzen Sie auf die Strategie „Teile und herrsche“, bei der spezialisierte Agenten die Arbeit koordinieren.

- Genaue oder empfindliche AnalyseDer Experte gleicht dies mit Gründlichkeit aus und trifft in der Regel den Nagel auf den Kopf, auch wenn es etwas länger dauert.

- Man möchte nicht jedes Mal neu entscheiden müssen.Es verwaltet automatisch das Guthaben und passt Tiefe und Kosten je nach Art der Beratung an.

Ein einfacher Trick: Wenn die Abfrage eine relevante berufliche oder wirtschaftliche Entscheidung betrifft, versuchen Sie es mit Expert oder Heavy; wenn es nur darum geht, schnell zum Ziel zu kommen, eliminiert Fast/Grok-4-Fast die Wartezeit. Der Automatikmodus ist Ihr Copilot, wenn Sie den Schalter lieber vergessen möchten..

Leistung in Benchmarks und realen Anwendungsfällen

xAI erzielt starke Ergebnisse bei öffentlichen Evaluierungen wie AIME-2025 (92.0 % bestanden@1) und HMMT-2025 (93.3 % bestanden@1) sowie eine gute Platzierung bei offenen Wettbewerben (LMArena). Diese Zahlen dienen als Orientierungshilfe, entscheidend ist jedoch, wie sich das Ganze in Ihrem tatsächlichen Cashflow bei sich ändernden Daten auswirkt..

Wo spielt es seine Stärken in der Praxis aus? Bei Recherche- und Suchassistenten, fortgeschrittenen Dialogsystemen (die schnelle Reaktionen und lange Argumentationsketten kombinieren), Programmierung mit besserem Kosten-Nutzen-Verhältnis und mehrsprachigen Anwendungen, wobei auch in chinesischer Sprache und bei Such-Benchmarks Verbesserungen festgestellt wurden. Wenn der Kontext riesig ist und das Modell sich selbst "organisieren" muss, punktet Grok-4-Fast..

Vergleich mit GPT-4.5, Gemini 1.5 Pro und Claude 3

Wenn Sie Wert auf Echtzeit-Webbrowsing und interne Agentenzusammenarbeit legen, haben Grok 4 und Heavy einen Vorteil gegenüber Modellen, bei denen diese Funktionen nicht standardmäßig aktiviert sind; zum Vergleich mit anderen Optionen können Sie Empfehlungen unter [Link zu Empfehlungen] einsehen. die beste KI für jede Aufgabe. Darüber hinaus integriert Grok Signale von X (ehemals Twitter), einschließlich Verweisen auf Beiträge von Elon Musk, sofern diese relevant sind..

Jedoch GPT-4.5 und Gemini 1.5 Pro dominiert weiterhin viele Benchmarks und bietet ein sehr breites Ökosystem an Plugins und Sicherheitsrichtlinien; Claude 3 ist eine weitere etablierte Alternative. Wenn Sie hochspezialisierte Übersetzungen oder Sicherheitsgarantien auf Unternehmensebene benötigen, OpenAI y Google Sie haben dennoch Boden gutgemacht..

Übersetzung und linguistische Metriken: Wie schneidet Grok 4 ab?

Im Bereich des digitalen Marketings in spanischer Sprache wurde eine Genauigkeit von rund 95 % bei der Fachterminologie und 90 % bei der grammatikalischen Korrektheit gemessen, wobei 85 % des Originals im Kontext erhalten blieben. Es besteht Spielraum für die Verfeinerung von Formulierungen und die Anpassung regionaler Ausdrücke (z. B. verbessert die Änderung von „Verkäufer“ zu „Marketingexperten“ die Verständlichkeit)..

Mit geringfügigen menschlichen Korrekturen werden etwa 5 % der terminologischen Lücken und etwa 10 % der grammatikalischen Nuancen abgedeckt, wodurch die Gesamteffektivität auf etwa 93 % steigt. Für den professionellen Einsatz ist es solide, und mit einer kurzen Anpassung sieht es auch gut aus..

| Modell | Flüssigkeit (TFFT) | Exactitud | Kontextbeibehaltung | Grammatikalische Korrektheit |

|---|---|---|---|---|

| Grok 4 | 8,9/10 | 92% | ausgezeichnet | 94% |

| GPT‑4.5 | 9,2/10 | 94% | Sehr gut | 96% |

| Gemini 1.5 Pro | 9,0/10 | 93% | ausgezeichnet | 95% |

| Klaus 3 | 8,7/10 | 91% | gut | 93% |

Wenn Ihre Priorität auf einer Übersetzung mit möglichst präziser Terminologie liegt, kann es sich dennoch lohnen, eine menschliche Ebene hinzuzufügen oder je nach Fachgebiet führende Modelle in Betracht zu ziehen. Für die meisten Arbeitsabläufe leistet Grok 4 hervorragende Arbeit und punktet besonders dann, wenn man Live-Kontext benötigt..

Preise, Tarife und Kosten pro Token

Der Grok 4 Heavy-Plan kostet rund 300 US-Dollar pro Monat und bietet frühzeitigen Zugriff auf die neuesten Funktionen; er richtet sich an fortgeschrittene Benutzer, die die Multiagentenarchitektur voll ausnutzen. Das Standardmodell Grok 4 ist mit rund 30 Dollar pro Monat günstiger, und es gibt ein Grok 3 Kostenlos für X-Nutzer mit eingeschränktem Funktionsumfang.

Bei der API-Nutzung veröffentlicht xAI Stufen pro Token; zum Beispiel etwa 0,20 $ für jede Million eingehender Token in Kontexten bis zu ~128k, wobei andere Stufen für ausgehende und größere Kontexte gelten. Mit Grok-4-Fast trägt die Reduzierung der „Gedanken“-Token dazu bei, die Kosten pro Transaktion in Szenarien mit hohem Handelsvolumen zu senken..

Die Infrastruktur, die dies ermöglicht: Colossus und der Energieverbrauch

Im Inneren steckt Colossus, ein Supercomputer in Memphis, Tennessee, mit mehr als 200.000 GPUs. Diese enorme Rechenleistung ermöglicht Webabfragen in Echtzeit und die problemlose Bearbeitung von Tausenden gleichzeitiger Sitzungen..

Diese Leistungsfähigkeit hat ihren Preis: Die Diskussion über den Stromverbrauch und die Umweltauswirkungen von LLMs ist noch nicht abgeschlossen. Wenn Ihr Unternehmen Nachhaltigkeitsziele verfolgt, ist es ratsam, den Verbrauch zu überwachen und gegebenenfalls Ausgleichsmaßnahmen zu ergreifen..

Markteinführung, Integration mit X und Hinweise von Musk

Der Start von Grok 4 erfolgte im Juli 2025 und Elon Musk bezeichnete es als „die intelligenteste KI der Welt“. Die Integration mit X ist nicht oberflächlich: Das Modell kann Signale und Verweise aus aktuellen Veröffentlichungen (einschließlich Musks) einbeziehen, sofern diese Kontext liefern..

Das macht Grok zu einer attraktiven Option, um über aktuelle Nachrichten und Trendthemen in den sozialen Medien auf dem Laufenden zu bleiben. Wenn Sie mit Inhalten arbeiten, die eng mit aktuellen Ereignissen verknüpft sind, ist diese Verbindung ein Pluspunkt..

Wie man es aktiviert und welche Verfügbarkeit der Grok4Fast-Modus bietet

Grok4Fast befindet sich derzeit in der Testphase für ausgewählte Abonnenten. Wenn Sie den Dienst aktiviert haben, finden Sie die Option in Ihrem Website-Avatar unter Einstellungen → Abonnement → „Frühes Vorschaumodell“ aktivieren und Grok4Fast auswählen. Kostenlose Nutzer werden es vorerst nicht sehen; es bleibt abzuwarten, wann es weltweit verfügbar sein wird..

In den ersten Tests, die von Internetnutzern geteilt wurden, ist die Leistung bei der Beantwortung komplexer Fragen aufgrund der nahezu null Latenz im Vergleich zum herkömmlichen schnellen Modus bemerkenswert. Bei einfachen Aufgaben, bei denen es auf Schnelligkeit ankommt, ist die Reduzierung der Wartezeit sehr deutlich spürbar..

Professionelle Anwendungsbereiche: von Marketing und Support bis hin zu Programmierung und Inhalten

Mit Live-Suche, Multiagenten-Funktionen und Tools eignet sich Grok hervorragend zur Überwachung von Trends, zur Bereitstellung von technischem Support, zur Durchführung akademischer Forschung und zur Generierung von Inhalten auf Basis aktueller Nachrichten. Wir entwickeln uns ständig weiter, bieten Support für aktuelle Bibliotheken und Frameworks und behalten die neuesten Änderungen stets im Blick..

Wenn Sie sich für Automatisierung interessieren: Grok-4-Fast ermöglicht Agenten, die ohne Modellsprünge zwischen sofortiger Reaktion und längerer Argumentation wechseln. Somit kann derselbe Assistent je nach Bedarf von einer „Ja/Nein“-Strategie zu einer mehrstufigen Vorgehensweise übergehen..

Geschäftsintegration und technische Empfehlungen

- Nutzen Sie das lange Zeitfenster weise.Laden Sie nur das Nötigste hoch (Dokumente, Richtlinien, Historien) und teilen Sie es auf; füllen Sie nicht einfach 2 Millionen Tokens „nur so“ auf.

- Orchestrierung mit WerkzeugenDas Modell soll entscheiden, wann navigiert oder Code ausgeführt wird, aber die Aufrufe sollen überwacht werden, um Kosten und Latenz zu kontrollieren.

- Tatsächliche Kosten: Berechnet auf Basis der durchschnittlichen Eingabegröße, der Ausgabe und des Anteils der „Gedanken“-Token; Grok-4-Fast hilft, diese zu reduzieren.

- KompatibilitätEs fügt sich in Pipelines mit Chatbots, Voicebots und Microservices ein; es definiert Ereignisse und Berechtigungen beim Aufruf klar. Datenbanken oder APIs.

Wenn Sie Unterstützung suchen, bieten Unternehmen wie Aimoova maßgeschneiderte Agentenentwicklung und -bereitstellung, Multichannel-Kundenserviceintegration, Automatisierungen, die KI und Regeln kombinieren, sowie Schulungen zu Prompts, Governance und Metriken an. Ihr Ansatz minimiert Tokens und Latenz, ohne dass ein riesiges technisches Team erforderlich ist..

Lohnt sich der Premium-Tarif?

Wenn Ihre tägliche Arbeit technisches Schreiben, technische Unterstützung oder den Zugriff auf Echtzeitdaten beinhaltet, kann die höchste Stufe eine Investition und keine Ausgabe sein. Für die meisten Nutzer ist der Standardplan ausreichend; und wer einfach nur experimentieren möchte, kann mit dem kostenlosen Grok 3 auf X einen guten Einstieg finden..

Ein praktischer Tipp: Beginnen Sie ganz unten und evaluieren Sie mit einem kurzen Pilotprojekt (Unterstützung, interne Suche oder Codehilfe). Eine Messung der tatsächlichen Auswirkungen über einige Wochen wird Ihnen zeigen, ob Heavy die 300 Dollar pro Monat wert ist..

Roadmap: multimodal, Projekt „Eve“ und sogar Autos

Die nächsten Funktionen konzentrieren sich auf Multimodalität: Bilder, Video und Sprache in ein und demselben Erlebnis. Darüber hinaus verspricht „Eve“ natürlichere Interaktionen, und eine Integration in Fahrzeuge ist nicht ausgeschlossen. Tesla für Sprachnavigation und Suche.

Für diejenigen, die mit Übersetzungen arbeiten, gibt es Plattformen, die führende LLMs zentralisieren – Grok, Claude, ChatGPT oder DeepSeek – an einem zentralen Ort (z. B. MachineTranslation.com) für schnellere und konsistentere Arbeitsabläufe. Es ist eine Möglichkeit, Antworten aus mehreren Quellen zu erhalten, ohne zwischen verschiedenen Konten hin- und herwechseln zu müssen..

Leidenschaftlicher Autor über die Welt der Bytes und der Technologie im Allgemeinen. Ich liebe es, mein Wissen durch Schreiben zu teilen, und genau das werde ich in diesem Blog tun und Ihnen die interessantesten Dinge über Gadgets, Software, Hardware, technologische Trends und mehr zeigen. Mein Ziel ist es, Ihnen dabei zu helfen, sich auf einfache und unterhaltsame Weise in der digitalen Welt zurechtzufinden.