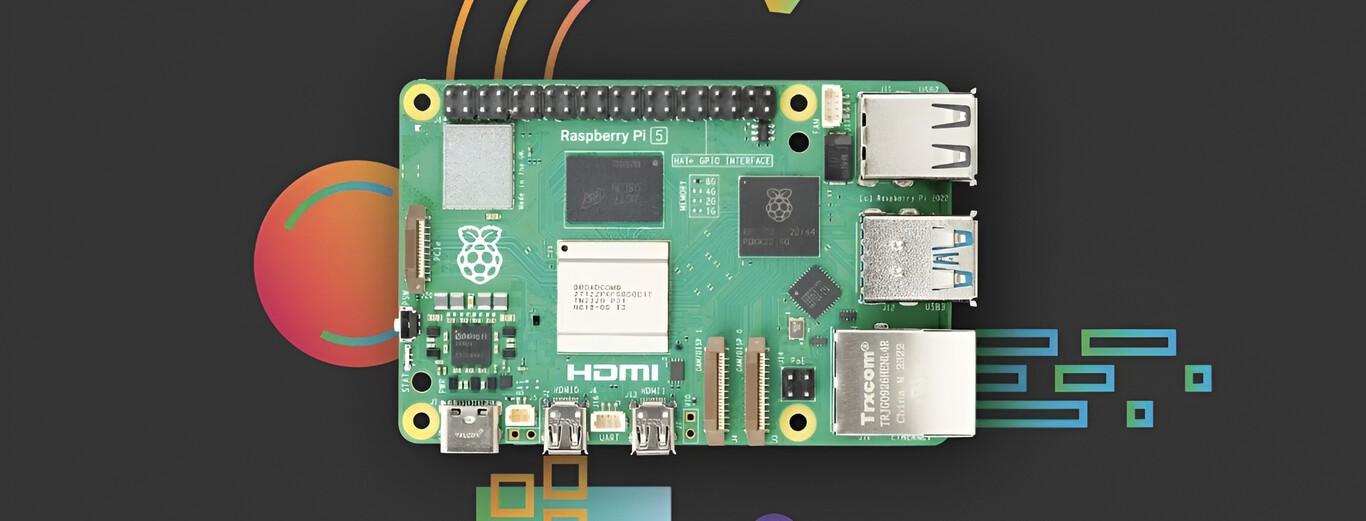

- Raspberry Pi 5 har etableret sig som en tilgængelig platform til at køre lette AI-modeller og agenter, der koordinerer cloud-tjenester, med et særligt fokus på privatliv og systemisolering.

- Destillerede og kompakte modeller (DeepSeek, Llama 3.2, Qwen osv.) tillader chat, oversættelse og kodesupport på beskeden hardware, dog med klare begrænsninger sammenlignet med store kommercielle LLM'er.

- Dedikerede acceleratorer som Hailo-modulerne (Hailo-8L og Hailo-10H i AI HAT+ 2) forbedrer inferensydelsen og muliggør lokal computervision og LLM på Raspberry Pi 5 med lav latenstid.

- Kombinationen af lille størrelse, dedikeret hardware og hjemmeautomation gør Raspberry Pi til en ideel AI-node i udkanten af netværket, der er i stand til at fortolke kommandoer og automatisere opgaver uden at være afhængig af skyen.

La Kunstig intelligens på Raspberry Pi Det oplever et ret særligt øjeblik. Indtil for nylig, når vi tænkte på AI, forestillede vi os enten en stor cloudbaseret chatbot, der krævede et abonnement, eller en ekstremt dyr computer fuld af GPU'er til at køre enorme modeller lokalt. Nu har landskabet ændret sig: Ankomsten af agenter som OpenClaw, destillerede modeller som DeepSeek og nye acceleratorer som AI HAT+ 2 har sat det lille forum i centrum for samtalen.

Denne ændring er ikke bare en forbigående dille: Kombinationen af Raspberry Pi 5, letvægtsmodeller og dedikeret AI-hardware Det giver dig mulighed for at køre chatbots, oversættere, kodeassistenter eller computervisionssystemer uden at være afhængig af skyen. Alt dette med større kontrol over sikkerhed, omkostninger og databeskyttelse, selvom der også er klare begrænsninger, som du bør være opmærksom på for at undgå skuffelse.

Fremkomsten af AI-agenter og Raspberry Pis rolle

De seneste måneder har der været meget snak om AI-agenter, der er i stand til at handle på egen håndOg et af de navne, der har skabt mest omtale, er OpenClaw. I modsætning til en klassisk chatbot, der kun svarer på beskeder, er en agent et system, der kan træffe beslutninger og udføre handlinger: starte scripts, kalde API'er, interagere med eksterne tjenester eller manipulere filer i et specifikt computermiljø.

Det interessante er, at Denne type agent behøver ikke at "hjernen" sidder i selve Raspberry Pi'en.Typisk kører den større model i skyen, mens boardet fungerer som en orkestrator: det vedligeholder samtalen, styrer brugerkonteksten, starter kommandoer i systemet og fungerer som en bro mellem den fysiske verden (sensorer, aktuatorer, hjemmeautomation) og den eksterne AI.

Samtidig er konfigurationer designet til Kør mindre modeller direkte på Raspberry Pi-hardwarenVærktøjer som Ollama eller llama.cpp giver dig mulighed for at indlæse reducerede LLM'er, der er optimeret til ARM-arkitekturen, især på modeller som Raspberry Pi 4 eller 5 med tilstrækkelig RAM. Det er ikke magi: nogle funktioner og hastighed ofres, men til visse anvendelser er resultatet fuldt ud brugbart.

Dette nye scenarie har endda ført til bevægelser på det finansielle marked omkring Raspberry Pimed bemærkelsesværdige stigninger i aktiekursen knyttet til entusiasme for tilgængelige AI-agenter. I sidste ende er den idé, der er ved at slå igennem, små fysiske enheder dedikeret til at køre eller koordinere AI, snarere end udelukkende at være afhængige af store datacentre eller avancerede stationære computere.

Sikkerhed, isolation og tvivl om tilgangen

At give en AI-agent dyb adgang til et system er ingen spøg: En agent med brede tilladelser kan læse filer, flytte data, udfylde webformularer eller få adgang til kritiske tjenester.Raspberry Pi-økosystemet understreger selv, at dette indebærer reelle risici, fordi disse algoritmer ikke er ufejlbarlige og kan lave fejl eller opføre sig uventet; derfor er det tilrådeligt at følge [de relevante retningslinjer/metoder]. god computersikkerhedspraksis.

Det er her, en af bundkortets store fordele kommer i spil: Brug af en Raspberry Pi som et isoleret miljø reducerer virkningen af potentielle fejl.I stedet for at give direkte kontrol til din hovedcomputer, kan du oprette et dedikeret system, hvor agenten kun har adgang til de strengt nødvendige ressourcer. Denne fysiske "sandkasse" hjælper med at inddæmme skade og giver mulighed for eksperimentering med større ro i sindet.

Ikke alle er overbeviste om, at denne tilgang er et universalmiddel. Specialiserede medier har påpeget det. Raspberry Pi har mistet noget af sin appel som en ultra-billig løsning.Især i avancerede konfigurationer med meget RAM. En Raspberry Pi 5-model med 16 GB kan nærme sig eller overstige $200, hvilket for nogle underminerer den oprindelige idé om en billig computer for alle.

I den forstand er der skeptiske stemmer, der mener, at At bruge en Raspberry Pi som base for komplekse agenter som OpenClaw er måske ikke den ideelle beslutning. Hvis budgettet er stramt, kan prisen på bundkortet, hukommelsen og eventuelle AI-acceleratorer øge prisen betydeligt, hvilket gør den dyrere end mere kraftfulde eller fleksible alternativer.

Alligevel er den dedikerede enhedsmetode med risikoisolering fortsat meget attraktiv: der værdsætter sikkerhed, privatliv og kontrolleret eksperimentering Raspberry Pi er et perfekt "laboratorium" til test af agenter og modeller uden at gå på kompromis med kritiske arbejdsmaskiner.

Raspberry Pi 5 som platform for lokale AI-modeller

Ud over agenternes del, Raspberry Pi 5 har etableret sig som et utroligt alsidigt værktøjDet er fortsat fantastisk til robotteknologi, elektronik, hjemmeautomation eller multimedia, men dets nuværende hardware giver dig mulighed for at gå et skridt videre og bruge det som grundlag for virkelige, lokale kunstig intelligens-projekter.

Takket være dens hurtigere CPU, GPU-forbedringer og muligheden for at bygge konfigurationer med masser af RAM, Raspberry Pi 5 er i stand til at køre lette AI-modeller rimeligt godt.Det vil ikke erstatte en server fuld af GPU'er, men det giver mulighed for at eksperimentere med computer vision, talegenkendelse, kompakte sprogmodeller eller specifikke assistenter til meget specifikke opgaver.

En fælles strategi involverer Vælg open source-modeller, der er optimeret til begrænset hardwareEksempler, der normalt anvendes, inkluderer Mistral 7B, nogle små varianter af Orca eller kompakte modeller som Microsoft Phi-2, forudsat at der findes tilpassede og frem for alt reducerede versioner med kvantiserings- eller destillationsteknikker, der passer til hukommelsen.

Det er vigtigt at forstå det Disse mindre LLM'er spiller ikke i samme liga som giganter som GPT-4De mister dybde, kontekst og responsivitet, især når de beskæftiger sig med meget generelle eller komplekse emner. Til gengæld tilbyder de acceptabel latenstid, lavere strømforbrug og fordelen ved ikke at være afhængige af eksterne forbindelser – en nøglefaktor, når al processering skal foregå på selve boardet.

Denne kombination forvandler Raspberry Pi 5 til en slags "Sandkasse", ideel til læring, prototyping og implementering af AI-løsninger som ikke kræver ekstrem teknisk viden eller uhyrlige investeringer, forudsat at det er meget klart, hvad der kan og ikke kan forventes af disse reducerede modeller.

Grundlæggende trin til at få AI op at køre på en Raspberry Pi 5

For at opsætte et projekt, der kører AI lokalt på Raspberry Pi 5, er det nyttigt at følge en række generelle trin. Det er ikke en fast opskrift, men en mental vejledning. af hvad du finder, når du begynder at rode med det.

Det første punkt er Vælg en model, der er kompatibel med ARM-arkitekturen og boardets ressourcerDet er her, modeller som den førnævnte Mistral 7B i stærkt komprimerede versioner, nogle små Orca- eller nedskalerede Phi-2-modeller og andre LLM'er fra 1B til 7B med parametre forberedt til at køre på beskedne enheder kommer i spil. Jo mindre modellen er, desto lettere er den at køre, men også desto mere begrænset vil den være.

Så kommer den del af Installer supportsoftwaren til arbejde med neurale netværkAfhængigt af dine behov kan du bruge TensorFlow Lite til visionsprojekter, PyTorch, hvis du skal bruge specifikke repositories, eller dedikerede runtime-programmer som Edge TPU, når du skal bruge eksterne acceleratorer. Til LLM gør værktøjer som llama.cpp eller Ollama tingene meget nemmere.

Når du har softwaren, skal du trykke på Konfigurer runtime-miljøet på Raspberry PiDette involverer justering af systemindstillinger, installation af yderligere afhængigheder, sikring af at modellen er optimeret til ARM, og ofte eksperimentering med parametre som kontekststørrelse, kvantiseringsniveau eller antal tråde for at afbalancere ydeevne og hukommelsesforbrug.

Når alt er sat op, kan du gå videre til Kør modellen og begynd at drage konklusionerDet er her, du ser, om hardware-software-kombinationen holder stik. Du skal indlæse data, sende forespørgsler, kontrollere latenstid og se, hvor godt svarkvaliteten matcher dine forventninger. Det er almindeligt at skulle finjustere utallige detaljer, indtil systemet kører problemfrit. Det anbefales at kontrollere diskpladsen ved hjælp af værktøjer til... analyser og rens din disk.

Hvis præstationen ikke er tilfredsstillende, har du mulighed for at Tilføj en ekstern accelerator for at aflaste CPU'en.Enheder som USB Coral med Edge TPU eller de nye kort baseret på Hailo-chips gør det muligt for neurale netværk at køre meget hurtigere og med lavt energiforbrug, hvilket i mange tilfælde fuldstændig ændrer oplevelsen.

Privatliv, sikkerhed og fordelene ved at behandle alt lokalt

Et af de stærkeste argumenter for at bruge AI på en Raspberry Pi er muligheden for at opbevare data inden for dit netværkNår du kører en model lokalt, sender du ikke personlige eller følsomme oplysninger til en tredjepartsserver, hvilket er særligt relevant i professionelle, uddannelsesmæssige eller avancerede hjemmeautomationsmiljøer. Det er også tilrådeligt at anvende teknikker til krypteret sikkerhedskopi til dine kopier.

Det betyder at Du har meget mere kontrol over, hvem der har adgang til det, du behandler.Hvis din lokale assistent analyserer interne dokumenter, overvåger sikkerhedskameraer eller administrerer brugshistorik for dit hjem, forbliver det hele inden for din infrastruktur. Du er ikke afhængig af ændrede privatlivspolitikker eller potentielle brud på eksterne tjenester.

Parallelt fungerer Raspberry Pi næsten som en "Fysisk firewall" til dine AI-eksperimenterDu kan oprette et separat system fra dit primære netværk, begrænse dets adgang til bestemte ressourcer og sikre, at selvom modellen laver mærkelige fejl, eller agenten bliver for kreativ, så er den potentielle skade inddæmmet.

Dette udelukker naturligvis ikke behovet for at konfigurere tilladelser, brugere og netværksregler korrektEn agent med for meget frihed på en dårligt sikret Raspberry Pi kan stadig være et problem. Forskellen er, at da det er et dedikeret og billigt miljø, er det meget nemmere at revidere, genopbygge fra bunden eller endda fysisk afbryde forbindelsen, hvis noget går galt.

Kort sagt, for dem, der værdsætter databeskyttelse og muligheden for at revidere hele informationsstrømmen, At bruge en Raspberry Pi som en lokal AI-node giver en ro i sindet, der er svær at opnå. når alt afhænger af cloud-tjenester, der administreres uden for din organisation eller dit hjem.

DeepSeek og virkeligheden ved at køre store modeller på beskeden hardware

Et andet navn, der har rystet landskabet, er DeepSeek, især modellen DeepSeek R1, designet til ræsonnement og med en meget ambitiøs tilgangMange overskrifter har fremhævet, at den overgår nogle af de mest avancerede kommercielle modeller og kan køres lokalt, hvilket giver næring til ideen om at have en "hjemmelavet ChatGPT" på enhver maskine.

Det er vigtigt at sætte tingene på plads: Den fulde version af DeepSeek R1 671B er et monster på over 400 GB Og det kræver adskillige meget avancerede GPU'er for at køre problemfrit. Det er den variant, der virkelig konkurrerer med topmodellerne fra OpenAI eller lignende platforme, og den er fuldstændig uden for rækkevidde for en Raspberry Pi eller en standard-pc.

Den store forskel i forhold til andre lukkede udbydere er, at hvis du har hardwaren, Du kan downloade modellen, samle den med værktøjer som Ollama og køre den derhjemme.og i mange tilfælde vil du have brug for tilslut en ekstern harddisk til at opbevare vægtene. Men vi taler om konfigurationer, der koster flere tusinde euro, med kort som RTX 4090, A100 eller tilsvarende datacenterkort; intet som en mikrocomputer med lavt strømforbrug.

For at give almindelige mennesker mulighed for at spille DeepSeek på standardmaskiner eller enheder som Raspberry Pi, anvendes følgende trin: destillerede og reducerede modellerDisse er i bund og grund komprimerede versioner af originalen, der bevarer noget af dens opførsel på bekostning af kapacitet og viden. Det er her, varianter af 14B-, 7B- eller endda 1.5B-parametre kommer ind i billedet.

Det centrale spørgsmål er, hvor meget der går tabt undervejs. Forholdet mellem modelstørrelse, hukommelse og responskvalitet er meget tydeligt.Hvis referencemodellen er over 400 GB, og Wikipedia allerede optager tæt på 100 GB, er det ikke realistisk at forvente, at en version på lige over 1 GB vil have al den viden tilgængelig i detaljer.

Virkelige tests af DeepSeek på forskellige enheder

For at se disse forskelle i praksis er det nyttigt at sammenligne de forskellige DeepSeek-varianters opførsel på forskellig hardware. På en arbejdsstation med Et RTX 3060 GPU med 12 GB VRAM kan køre 14B-parameterversionen rimeligt godt., og endda tvinge 32B-versionen frem ved at bruge system-RAM, selvom hastighederne falder betydeligt.

Hvis du prøver cloud-versionen af DeepSeek, uden lokale hardwarebegrænsningerDen større model fungerer fejlfrit og demonstrerer tydeligt, hvorfor den konkurrerer med branchegiganterne. Forskellen er mærkbar både i hastigheden og konsistensen af dens reaktioner og dens evne til at håndtere komplekse instruktioner.

Når du går ned til jorden af en Med en Raspberry Pi og 8 GB RAM ændrer scenariet sig radikalt.I dette tilfælde er den største model, der kan udføres funktionelt, den med 7B parametre, og selv da er hastigheden omkring 1 token pr. sekund. Dette gør det næsten uudholdeligt at opretholde en flydende samtale.

Når man vurderer kvaliteten af svarene, bliver forskellen endnu tydeligere. Stillet over for et simpelt spørgsmål om generel viden, såsom hvem der er en velkendt karakter fra en populær serie, 14B-modellen er korrekt, mens 7B-modellen begynder at give mærkelige svar.1.5B-modellen tilbyder direkte resultater, der minder mere om en opdigtet tekst uden et solidt grundlag.

Mønsteret gentages med mere generiske forespørgsler: Små varianter har en tendens til at give sjældne, ufuldstændige eller klart fejlagtige svar.Dette er logisk: ved at reducere modellens størrelse så meget, bliver dens repræsentationskapacitet og dens implicitte "hukommelse" af verden brutalt begrænset, så den kan ikke forventes at opføre sig som en topmodel.

Hvad bruges de destillerede modeller på Raspberry Pi egentlig til?

Trods disse begrænsninger har destillerede og kompakte modeller meget interessante anvendelser i enheder som Raspberry Pi. De er ikke beregnet til at erstatte store, generelle chatbots.men at løse veldefinerede opgaver, hvor kreativitet og encyklopædisk viden ikke er i hovedfokus.

Et af de områder, hvor de arbejder rimelig godt, er inden for grundlæggende matematikhjælp og kodegennemgangFor at opdage simple fejl i scripts, foreslå små funktioner eller foreslå forbedringer af Python-koder, giver en 7B- eller 14B-model normalt nyttige svar, så længe den ikke bliver bedt om noget ekstremt specifikt eller indviklet.

De kan også være meget nyttige til Generer og korriger kodefragmenter anvendt til hjemmeautomation, automatisering eller små projekterFor eksempel kan en 14B-model foreslå en Home Assistant-automatisering med en vis sammenhæng, mens 1.5B-versionen vil have en tendens til at opfinde dele eller tilbyde noget, der ikke samles eller giver mening.

Der, hvor de systematisk fejler, er i spørgsmål om almen viden, detaljerede faktuelle oplysninger eller opgaver, der kræver meget kontekstDerudover er humoristisk sans og evnen til at føre lange, naturlige samtaler påfaldende fraværende, selv i relativt store modeller, hvilket gør dem til ikke det bedste valg til brug som "virtuelle venner".

Et mærkeligt eksempel er at bede dem om at Opret en kompleks hjemmeside, f.eks. en landingsside, for at sælge et kursus.Alle modeller kan producere en funktionel HTML-struktur, men jo mere destilleret og mindre varianten er, desto enklere, grimmere og indholdsfattigere bliver den genererede hjemmeside, og de mister detaljer og nuancer undervejs.

Kort sagt, små modeller bygget på en Raspberry Pi er ideelle til assistance med begrænsede tekniske opgaver, hjemmeautomation, små udviklingsassistenter eller let dataklassificeringMen det er ikke meningen, at det skal erstatte en avanceret cloud-tjeneste, når det, du ønsker, er en alsidig assistent til generelle formål.

Raspberry Pi, hjemmeautomation og let kunstig intelligens

En af de mest lovende anvendelser af AI på Raspberry Pi er Smart hjemmeautomation med letvægtsmodellerIdeen er at bruge boardet som en lokal hjerne, der fortolker kommandoer, forbinder sig med sensorer og aktuatorer og træffer simple beslutninger uden at skulle sende noget til skyen.

For eksempel kan der oprettes et system, hvor En lille sprogmodel er ansvarlig for at forstå stemmekommandoer., herunder forbehandlingstrin som f.eks. Rens op for mikrofonstøjsåsom "træk gardinerne ned i stuen, når solen skinner direkte på rummet" eller "tænd kun varmen, hvis der er nogen hjemme, og temperaturen falder til under en bestemt tærskel." Modellen behøver ikke at vide, hvem en historisk person er, eller skrive digte: den skal kun omsætte ønsker til konkrete handlinger.

Med denne tilgang kan selv en LLM med parametre på 1.5B eller 3B give mening. fordi dens funktion ikke er at give geniale svar, men at knytte naturligt sprog til strukturerede kommandoerHvis det er specifikt trænet eller justeret til det pågældende domæne (hjemmeautomation, sensorer, rutiner), kan resultaterne være overraskende gode i forhold til, hvor let systemet er.

Denne type løsning giver dig mulighed for at oprette Smarte hjem, der er langt mere respektfulde for privatlivets fredhvor hverken stemmekommandoer eller enhedsbrugsmønstre forlader det lokale netværk. Ved ikke at være afhængig af eksterne tjenester forhindres det desuden, at alt ophører med at fungere på grund af en udbyder, der ændrer sin API, en server, der går ned, eller at tjenesten lukkes ned.

Selvom der stadig er meget at forfine og teste, er potentialet ved at kombinere små modeller med hjemmeautomationsplatforme som Home Assistant eller deres egne systemer Potentialet for dette på Raspberry Pi er enormt, og alt peger på, at vi ser flere og flere eksperimenter og virkelige projekter i den retning.

AI-acceleratorer til Raspberry Pi: Hailo, AI HAT+ og andre moduler

For at overvinde begrænsningerne i Raspberry Pi's CPU er der dukket nye teknologier op. dedikerede AI-acceleratorer, der integreres direkte med boardetDens mål er at behandle neurale netværk meget hurtigere og mere effektivt end en CPU eller i nogle tilfælde en konventionel GPU.

Sammenlignet med generelle processorer er disse acceleratorer designet til at køre parallelt de matematiske operationer, der er typiske for maskinlæringDette reducerer inferenstiden og også energiforbruget, hvilket er afgørende i indlejrede enheder eller i situationer, hvor et stort kontinuerligt energiforbrug ikke kan tolereres.

Et meget udbredt eksempel er brugen af en M.2 HAT+ kort forbundet til Raspberry Pi 5 sammen med et M.2 2242-modul, der integrerer en Hailo-8L-chipDenne type kit tilføjer en dedikeret neural processorenhed, der accelererer synsopgaver, objektdetektion eller endda nogle generative modeller, der er optimeret til dens arkitektur.

Hailo-chippen fokuserer på at behandle komplekse operationer parallelt med høj energieffektivitetSammenlignet med CPU- eller GPU-baserede løsninger betyder dette mindre varme, reducerede kølebehov og forbedret batterilevetid – en betydelig fordel i industrielle projekter, robotteknologi og distribuerede smarte sensorer.

Takket være disse moduler kan Raspberry Pi gå fra at være en simpel koordinator til blive en virkelig kapabel inferensnode, der kører sofistikerede neurale netværk direkte i kanten af netværket uden at mætte boardet og opretholder en meget lav latenstid.

AI HAT+ 2 og springet til lokale LLM'er på Raspberry Pi 5

En af de mest slående lanceringer på dette område er Raspberry Pi AI HAT+ 2, et udvidelseskort designet til Raspberry Pi 5 som inkorporerer Hailo-10H-chippen. Denne coprocessor tilbyder en inferensydelse på omkring 40 TOPS, nok til at håndtere lette generative AI-modeller lokalt.

Med denne hardware kan Raspberry Pi 5 udføre relativt kompakte sprogmodeller med lav latenstiduden at overbelaste hoved-CPU'en. Bearbejdningen delegeres til Hailo-10H, som håndterer intensiv drift, mens kortet styrer applikationslogik, brugerinput og integration med andre systemer.

De kompatible modeller, der officielt er nævnt, inkluderer DeepSeek-R1-Distill, Llama 3.2, Qwen2.5-Coder, Qwen2.5-Instruct og Qwen2De fleste har omkring 1.500 milliarder parametre, mens Llama 3.2 har cirka 1.000 milliard, alle designet til at tilbyde en rimelig balance mellem kapacitet og ressourceforbrug.

Offentlige forsøg viser, at disse modeller kan bruges til grundlæggende chatopgaver, tekstoversættelse, generering af kodestykker eller scenebeskrivelse Når det kombineres med visuelle input, er latenstiden lav, og brugeroplevelsen kommer meget tættere på, hvad folk forventer af moderne interaktiv AI.

Det er dog vigtigt at være klar over, at AI HAT+ 2 tillader ikke kørsel af massive modeller lokalt, såsom ChatGPT, Claude eller de større Meta LLM'er.Disse systemer har hundredvis af milliarder eller billioner af parametre, langt ud over hvad en coprocessor af denne type i en Raspberry Pi 5 med rimelighed kan håndtere.

Den store appel ved AI HAT+ 2 er, at den til en pris på omkring $130, Det giver dig mulighed for at forvandle en Raspberry Pi 5 til en meget kapabel lille lokal AI-stationDet giver adgang til et arkiv af Hailo-eksempler og -frameworks rettet mod både computer vision og generativ AI. Det er et nøgleværktøj for dem, der ønsker at bevæge sig ud over rent symbolske modeller og virkelig eksperimentere med moderne neurale netværk i udkanten af teknologien.

Landskabet, der udvikler sig omkring kunstig intelligens på Raspberry Pi, er ret kraftfuldt: blandt cloudbaserede agenter, lette on-premise modeller, dedikerede acceleratorer og nye boards som AI HAT+ 2Det lille bræt er blevet et ideelt laboratorium til at udforske, hvordan distribueret AI vil se ud i hverdagsenheder, forudsat at der tages højde for strømbegrænsninger, og projekter designes med omtanke.

Passioneret forfatter om bytes-verdenen og teknologien generelt. Jeg elsker at dele min viden gennem skrivning, og det er det, jeg vil gøre i denne blog, vise dig alle de mest interessante ting om gadgets, software, hardware, teknologiske trends og mere. Mit mål er at hjælpe dig med at navigere i den digitale verden på en enkel og underholdende måde.