- Preoblikovanje datoteke v intelektualni nabor podatkov vključuje vektorizacijo korpusa, gradnjo grafov odnosov in povezavo z umetno inteligenco kot pomočnikom za raziskovanje in iskanje idej.

- Kakovost, lokacija in natančna ocena nabora podatkov so prav tako ključni kot arhitektura modela za pridobitev zanesljive in kontekstualizirane umetne inteligence.

- Opombe podatkov, podprte s posebnimi orodji in postopki nadzora kakovosti, pretvorijo datoteko v učno surovino za več nalog.

- Osebne datoteke, odprta skladišča in simulirani podatki se združujejo v ekosisteme naborov podatkov, ki so uporabni za sektorje, kot so zdravstvo, promet, finance ali izobraževanje.

Pretvori osebno datoteko v živ in uporaben intelektualni nabor podatkov Ni več samo za velike laboratorije: vsak, ki že leta ustvarja digitalne vsebine, lahko to zgodovino spremeni v pregledno bazo znanja in gorivo za sisteme umetne inteligence. Zanimivo ni le shranjevanje vsega, kar ste napisali v primeren formatampak da bi ti deli medsebojno komunicirali, se medsebojno povezovali in da bi se z njimi lahko posvetovali glede idej, kontekstov ali akterjev, ne le z enostavnim iskanjem po ključnih besedah.

Ta skok iz statične datoteke v urejeno, komentirano in iskalno zbirko podatkov To odpira vrata različnim uporabam, od osebnega asistenta, usposobljenega za vaša besedila, do konstrukcije jezikovnih modelov, prilagojenih določeni kulturi ali sektorju. V tem članku bomo mirno in jasno razložili, kaj pomeni obravnavati datoteko kot intelektualni nabor podatkov, kako je tehnično zgrajena, kaj pomeni njeno pravilno prevajanje ali označevanje, katera orodja so vključena in v kakšnih resničnih kontekstih se že uporablja.

Od razpršenega arhiva do navigiranega intelektualnega nabora podatkov

Predstavljajte si, da že več kot desetletje pišete članke o [tema/predmet] tehnologija, regulacija, zasebnost ali umetna inteligenca na eni sami platformi. Zahtevate celoten izpis svojih besedil (datoteko z navadnim besedilom in tisoči dokumentov) in ga prejmete v nekaj minutah. Na papirju je ta datoteka dragocena: zajema štirinajst let vašega miselnega procesa. Dokler pa ostane le nestrukturirano besedilo, ne morete storiti veliko več kot ... iskanje po posameznih besedah.

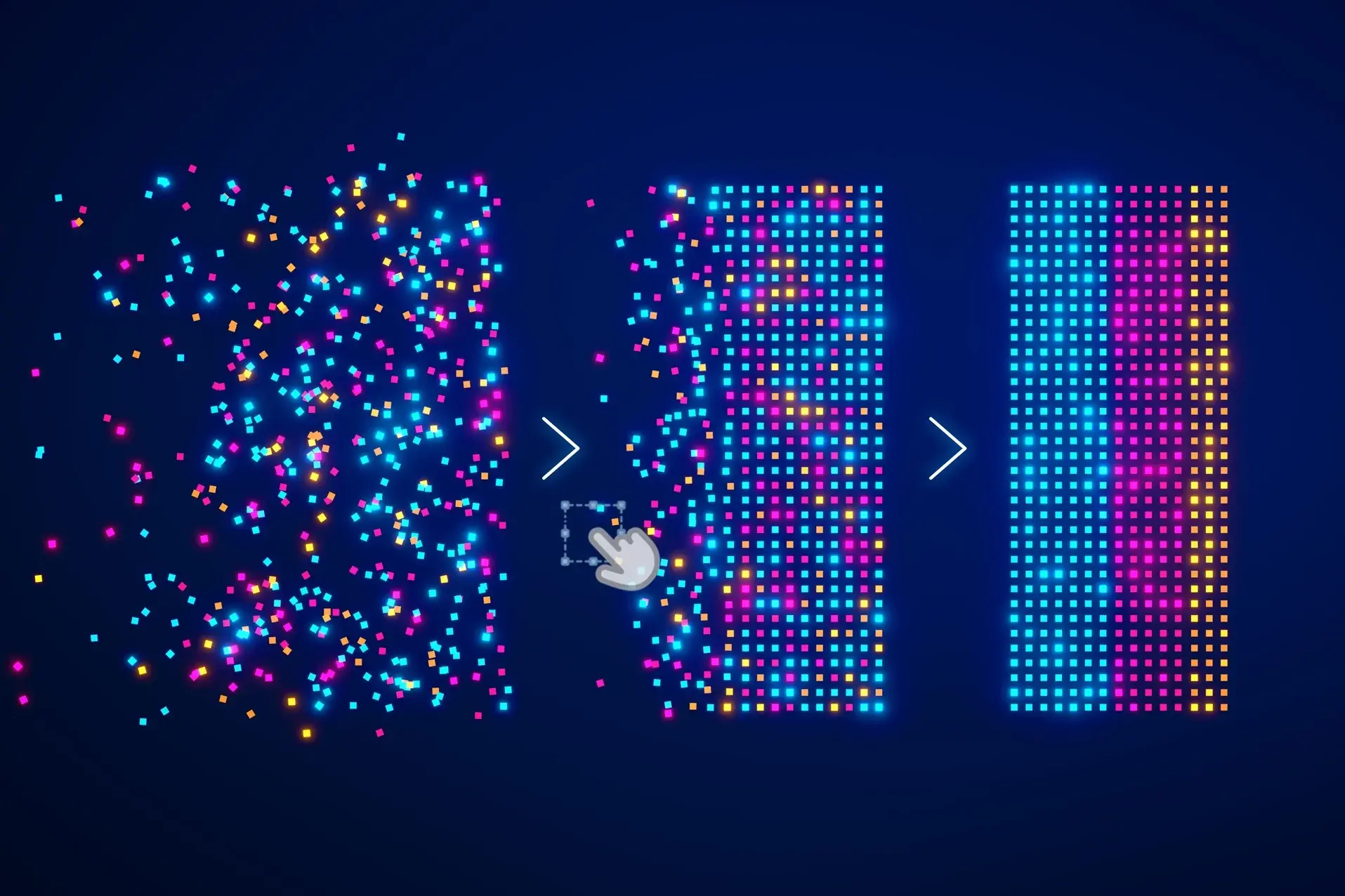

Prvi konceptualni premik vključuje prenehanje gledanja na datoteko kot na kup dokumentov in začetek njene obravnave kot koherenten korpus, ki ga je mogoče indeksirati in raziskovatiIdeja je, da se vsak članek pretvori v numerično predstavitev, ki zajame njegov pomen, te vektorje shrani v specializirano bazo podatkov in na njih zgradi graf odnosov ter pomočnik, ki ta semantični prostor natančno razume.

V študiji primera iz resničnega sveta, ki je vključevala 4.209 člankov, napisanih v angleščini v štirinajstih letih, je avtor uporabil model večjezična vdelava (paraphrase-multilingual-mpnet-base-v2, iz sentence-transformers) za pretvorbo vsakega besedila v 768-dimenzionalni vektor. Ti vektorji so bili shranjeni v ChromaDB, odprtokodni vektorski bazi podatkov. Celoten postopek, ki je potekal na standardnem strežniku brez grafičnega procesorja, je bil zaključen v približno petih minutah: ploščata datoteka je bila pretvorjena v neprekinjen prostor idej.

V praksi to pomeni, da ne iščete več »po ključnih besedah«, ampak po konceptih, vprašanjih ali delih besedilaLahko postavite vprašanja, kot so »Kdaj sem začel pisati o tehnoloških monopolih?« ali »Kateri članki so konceptualno blizu temu argumentu?«, in sistem se odzove tako, da v tem semantičnem prostoru poišče najbližje vektorje, tudi če nimajo istega besedišča. To je zelo neposreden način za razširitev spomina na lastno delo.

Na vrhu te vektorske plasti je bil z uporabo programa NetworkX zgrajen tudi graf, kjer vsako vozlišče predstavlja članek, robovi pa povezujejo besedila, ki si delijo tematske oznake ali presegajo določen prag semantične podobnosti. Rezultat, vizualiziran v orodjih, kot je Gephi, je zemljevid vašega intelektualnega dosežka, organiziran v skupineRegulacija, platforme, zasebnost, umetna inteligenca, električna mobilnost ... in tudi nepričakovane povezave med besedili, ki so ločena z leti, a so si ideje zelo bližnje.

Osebni asistent agent kot vrata do arhiva

Drugi ključni element tega pristopa je imeti Pomočnik umetne inteligence, zasidran v vaš nabor podatkov ki lahko deluje kot neprekinjen sodelavec, ne le kot preprost klepetalni robot v zavihku brskalnika. V prejšnjem primeru se je ta pomočnik imenoval Bautista: agentna instanca, ki temelji na antropičnih modelih (Claude Sonnet 4.6), vendar je sposobna delati z drugimi modeli, odvisno od uporabljenega API-ja.

Bautista se nahaja na avtorjevem lastnem strežniku in je orkestriran z uporabo infrastrukturne platforme, podobne OpenClawu, ki upravlja trajni pomnilnik med sejami, komunikacijske kanale (kot je Telegram), načrtovane naloge in dostop do orodij, kot sta datotečni sistem in izvajanje skriptov. Zahvaljujoč temu pomočnik ohranja kontinuiteto skozi časZapomni si prejšnje projekte, ohranja datoteke, avtomatizira procese in lahko deluje samostojno, ko mu je naročeno.

Razlika v primerjavi z odpiranjem generične predloge v brskalniku je v tem, da tukaj ne govorimo o še enem klepetu, temveč o nečem bolj podobnem vgrajeni sodelavec v vaši infrastrukturi, specializiran za vaš lastni korpus in sposoben delovati kot posrednik med to vektorsko datoteko in vašimi vsakodnevnimi potrebami: iskanje besedil, odkrivanje odvečnih elementov, pridobivanje citatov, izvajanje specifičnih analiz ali zagon vzdrževalnih skriptov.

Poleg tega je bil sistem zasnovan tako, da ohranja arhiv aktiven brez ročnega posredovanja. Vsakič, ko avtor objavi nov članek na Mediumu in deli povezavo za celoten dostop na Blueskyju, načrtovani proces dnevno poizveduje po javnem API-ju Blueskyja, zazna nov vnos, prenese besedilo, ustvari njegovo kodo za vdelavo in ga doda v ChromaDB. Avtomatiziran cevovod zagotavlja, da se nabor podatkov samodejno posodablja., zahvaljujoč nalogam indeksiranje datotekizogibanje klasičnemu problemu zastarelosti baz znanja, ker je njihovo posodabljanje mukotrpno.

V kasnejši fazi so bile dodane nove plasti analize, kot je prepoznavanje imenovanih entitet (ljudi, podjetij, tehnologij, držav, institucij) v celotnem korpusu, s ciljem preučevanja časovni razvoj omemb in omrežij sočasnega pojavljanjaZahvaljujoč temu je mogoče videti, kdaj se v besedilih pojavi akter, kot je OpenAI, kdaj Google+ izgine ali kako se različni agenti sčasoma povezujejo med seboj, kar sistem približa obsežni analizi diskurza kot preprostemu osebnemu arhivu.

Nabor podatkov, model in vedenje: datoteka kot surovina za umetno inteligenco

V kontekstu umetne inteligence, a Nabor podatkov je veliko več kot le zbirka podatkovTo je učno gradivo, ki oblikuje vedenje modela. Pri obdelavi naravnega jezika (NLP) je ta nabor podatkov običajno v obliki besedil, dialogov, navodil ali opomb, ki modelom omogočajo, da se med drugim naučijo prevajati, povzemati, pogovarjati ali razvrščati čustva.

Dolga leta je bil poudarek skoraj izključno na arhitekturi modela (število parametrov, vrsta plasti, računalniška zmogljivost), vendar so nedavne izkušnje pokazale, da kakovost, raznolikost in primernost podatkov za usposabljanje Tehtajo toliko kot zasnova modela ali celo več. Kot poudarjajo študije, kot so tiste Benderja in sodelavcev ali Paullade in sodelavcev, modeli niso nič boljši od podatkov, ki jih hranijo: če je nabor podatkov pristranski, nepopoln ali nereprezentativen, bo umetna inteligenca reproducirala iste pomanjkljivosti.

Ta sprememba perspektive je spodbudila jasen premik k kakovost pred količinoNe gre le za zbiranje ogromnih količin besedila, temveč za zagotavljanje, da so ti podatki usklajeni z jezikom, regionalno raznolikostjo in kulturnim kontekstom, v katerem bo umetna inteligenca uporabljena (Blasi et al., Kreutzer et al.). To je še posebej pomembno, če na arhiv gledamo kot na intelektualni nabor podatkov: avtorjev osebni korpus je lahko zelo bogat, če pa naj bi se nato uporabljal za modele, ki delujejo v drugih jezikih ali na drugih trgih, postaneta kuriranje in prilagajanje ključnega pomena.

Poleg tega nabor podatkov ni uporaben le za usposabljanje, ampak tudi za ocenite delovanje modelaČe se model ovrednoti z uporabo podatkov, ki jih je že videl med učenjem (kontaminacija podatkov), se pridobijo zavajajoče metrike, ki prikrivajo njegove resnične omejitve, kot so analizirali Dong in sodelavci ter Samuel in sodelavci. Zato je pri prenosu osebne datoteke v kontekst umetne inteligence ključnega pomena razlikovati, kateri deli se uporabljajo za učenje, kateri za validacijo in kateri za testiranje, ter oblikovati bogate in zahtevne nabore za ocenjevanje, namesto trivialnih testov, ki jih vsi modeli opravijo.

Prevajanje in lokalizacija naborov podatkov: veliko več kot le prenos besedila iz enega jezika v drugega

Ko želite ponovno uporabiti datoteko, kot je Intelektualni nabor podatkov v več jezikih ali trgihNato se pojavi specifičen izziv: prevajanje in lokalizacija korpusa. Na prvi pogled se morda zdi le še en prevajalski projekt, vendar je nabor podatkov umetne inteligence pogosto sestavljen iz izoliranih fragmentov, ohlapnih dialogov, kratkih navodil ali strukturiranih podatkov brez jasnega narativnega konteksta, kar popolnoma spremeni pravila igre.

V mnogih naborih podatkov najdemo zelo omejen kontekstTo so besedne zveze brez informacij o tem, kdo govori, o situaciji ali o njegovem namenu. Prevajalec mora sklepati na pragmatične funkcije (ukaz, dvom, žalitev, ironijo), da se model lahko pravilno nauči vedenja v ciljnem jeziku. Poleg tega obstajajo elementi, ki se jih ne sme dotikati, kot so delčki kode, spremenljivke, nadomestni elementi ali tehnične oznake, kjer lahko naiven prevod pokvari nabor podatkov.

V igro pride tudi množična doslednost: na videz majhne odločitve, kot je izbira med "tú" ali "usted", obravnavanje vključujočega spola ali obravnavanje določenih anglicizmov, Pomnožijo jih milijoni primerov.Nedoslednost, ki bi v knjigi lahko ostala neopažena, tukaj postane šum, ki ga model ponotranji. In za razliko od uredniškega prevajanja je pogosto najbolje ohraniti slovnične napake ali pogovorne izraze takšne, kot se pojavijo, saj cilj ni "polirati" besedilo, temveč umetno inteligenco naučiti, kako se ljudje dejansko izražajo.

Zato je namesto prevajanja bolj primerno govoriti o poiščite nabore podatkovTo vključuje prilagajanje kulturnih referenc, imen institucij, blagovnih znamk, formatov datumov, valut in merskih enot ter prilagajanje registra družbenim normam ciljnega trga. V velikih jezikovnih modelih je ta lokalizacija tisto, kar loči umetno inteligenco, ki preprosto »govori špansko«, od tiste, ki razume kulturne nianse, pričakovanja vljudnosti in lokalne reference.

Podjetja z dolgo zgodovino lokalizacije programske opreme in vsebin, kot je imaxin, se razvijajo v smeri prevajanje in specifična kuracija naborov podatkovNjihov pristop, ki združuje človeško strokovno znanje, natančno prilagojene slogovne vodnike, kurirane glosarje ter orodja za računalniško podprto in strojno prevajanje, bolj spominja na postopek nadzora kakovosti podatkov kot na tradicionalno prevajanje: natančna opredelitev jezikovnih in tehničnih meril, upravljanje namernih napak, uporaba avtomatiziranega zagotavljanja kakovosti in statistično vzorčenje za spremljanje doslednosti.

Označen nabor podatkov: dajanje strukture in pomena podatkom

Da datoteka postane Resnično uporaben intelektualni nabor podatkov za nadzorovane modeleNi dovolj zgolj zbirati besedil: besedila morajo biti označena. Označen nabor podatkov je tak, v katerem je vsak element (slika, zvočni fragment, stavek, tabela) dobil metapodatke, ki opisujejo njegovo vsebino ali funkcijo: oznake, kategorije, entitete, odnosi, prepisi, omejevalni okvirji itd.

V računalniškem vidu lahko na primer opombe vključujejo globalne klasifikacijske oznake, omejevalne okvirje okoli predmetov, segmentacijske maske, ki vsakemu slikovnemu elementu dodelijo kategorijo, opombe ključnih točk (človeški sklepi, obrazne točke) ali trajektorije vzdolž videoposnetka. V besedilu govorimo o vnosi imenovanih entitet (ljudje, organizacije, kraji), klasifikacija dokumentov, sintaktična analiza, odnosi med entitetami ali oznake čustev.

Cilj vsega tega dela je, da imajo modeli jasni primeri tega, kaj bi morali prepoznati ali predvidetiNabor podatkov z označenimi slikami mačk, avtomobilov in pešcev omogoča učenje modelov, ki zaznajo in razvrstijo te objekte; nabor podatkov o pogovorih z oznakami namere in čustev omogoča učenje klepetalnih robotov in sistemov za analizo čustev; dokumentarni korpus z označenimi entitetami in eksplicitnimi odnosi postavlja temelje za sisteme za ekstrakcijo znanja.

Opombe niso omejene le na besedilo ali slike: pri zvoku naloge vključujejo prepisovanje, označevanje zvočnih dogodkov (aplavz, smeh, streli), segmentacijo po govorcu in časovno žigosanje ključnih besed. Pri multimodalnih podatkih (na primer video z zvokom in podnapisi) pa se delo opravlja na usklajevanju modalitet in skupnem označevanju interakcij (izraz obraza plus ton glasu plus besedilna vsebina).

Na področju strukturiranih in tabelaričnih podatkov pomeni komentiranje tudi Razložite pomen stolpcev in vrednostiTo vključuje povezovanje enakovrednih vnosov med bazami podatkov ali označevanje ustreznih atributov za naloge napovedovanja. Vsaka vrsta projekta bo izbrala en ali drug nabor opomb, pogosto pa se jih več kombinira, da se zajamejo kompleksni primeri uporabe.

Orodja in postopki za označevanje datoteke kot nabora podatkov

Snemanje podatkov v velikem obsegu zahteva specifična orodja in dobro premišljeni delovni procesiNi enako ročno označiti nekaj deset slik kot upravljati več sto tisoč primerov v več formatih z ekipami, razpršenimi po več časovnih pasovih.

V računalniškem vidu se uporabljajo odprtokodne rešitve, kot so LabelImg (za omejevalne okvirje), CVAT (za kompleksne anotacije slik in videoposnetkov s skupnimi funkcijami) ali komercialne platforme, kot sta Labelbox ali SuperAnnotate, ki vključujejo kakovostno analitiko, upravljanje projektov in avtomatizacijo. Za besedilo orodja, kot so Prodigy, LightTag, BRAT ali Datasaur, omogočajo anotacijo entitet, klasifikacij, sintaktičnih odvisnosti in odnosov s podrobnim sledenjem anotatorjev in konfliktov.

V zvoku programska oprema, kot so Label Studio, Praat ali Sonix, omogoča natančno segmentacijo, prepisovanje in označevanje zvokov. Za multimodalne podatke lahki projekti, kot je VGG Image Annotator (VIA), ali aplikacije, kot je RectLabel, ponujajo vsestransko osnovo za sinhronizacijo opomb med vrstami podatkov. Za projekte, ki zahtevajo veliko količino in hitrost, pa platforme, kot so avtomatizacija in obsežno sodelovanje kot so Amazon SageMaker Ground Truth, Scale AI, DataLoop ali rešitve za sodelovanje, kot sta Digma ali Hive Data.

Izbira orodja ni le stvar osebnih preferenc: upoštevati morate vrsto podatkov, proračun, velikost ekipe, potrebo po sodelovanju v realnem času in velikost nabora podatkov. Skoraj vse napredne platforme vključujejo funkcije za potrjevanje osnovnih pravil, upravljanje konfliktov, merjenje produktivnosti in kakovosti ter kombiniranje človeških opomb z avtomatiziranimi predlogi, ki jih ustvarijo obstoječi modeli.

Poleg samega orodja kakovost določa tudi postopek. zelo jasni in posodobljeni vodniki za anotacijeTo vključuje usposabljanje komentatorjev (zlasti na občutljivih področjih, kot je medicina), organizacijo navzkrižnih pregledov, opredelitev metrik kakovosti (ujemanje med komentatorji, natančnost, odpoklic) in uporabo strokovno potrjenih podatkov "zlatega standarda" za kalibracijo ekipe. Komentiranje datoteke kot intelektualnega nabora podatkov ni šprint, temveč neprekinjen, iterativni cikel.

Mnogi projekti se odločajo za hibridni pristop: preproste ali ponavljajoče se naloge (npr. predhodno zaznavanje objektov ali predhodna klasifikacija besedila) so avtomatizirane, človeško delo pa je rezervirano za dvoumni, zapleteni ali zelo vplivni primeriTo zmanjšuje stroške brez žrtvovanja kakovosti in omogoča ocenjevalnikom, da se osredotočijo tja, kjer dodajo največ vrednosti.

Uporaba označenih in intelektualnih naborov podatkov v resničnem svetu

Obravnavanje datoteke kot intelektualnega nabora podatkov ni teoretična vaja: ima zelo konkretne aplikacije v več sektorjih, kjer sta komentiranje in kuriranje ključnega pomena za uvedbo zanesljive umetne inteligence. V računalniškem vidu na primer komentirani nabori slik in videoposnetkov omogočajo razvoj sistemov za prepoznavanje obrazov, odkrivanje anomalij na rentgenskih ali magnetnih slikah, avtomatizirane preglede tovarn ali avtonomna vozila, ki Prepoznajo pešce, znake in ovire en tiempo real.

Pri obdelavi naravnega jezika dobro lokalizirani in označeni nabori podatkov omogočajo naloge, kot so analiza čustev na družbenih omrežjih, razvrščanje poizvedb v storitvah za stranke, ekstrakcija entitet v pravnih dokumentih, strojno prevajanje ali usposabljanje klepetalnih robotov, ki razumejo čustvene nianse in kulturni kontekstiOsebni arhiv člankov lahko postane osnova specializiranega asistenta, ki pred objavo nečesa novega pregleda že povedano, zazna ponovitve ali ugotovi spremembe v drži skozi leta.

Zdravje in biotehnologija se vse bolj zanašata na visoko komentirane nabore podatkov: medicinske slike s potrjenimi diagnozami, strukturirane klinične zapise in genomska zaporedja, označena z ustreznimi mutacijami. V avtomobilski industriji in prometu so podatki bistveni za avtonomno vožnjo, inteligentno načrtovanje poti in upravljanje prometa. V trgovini in bančništvu se uporabljajo za Priporočevalci izdelkov, odkrivanje goljufij in analiza tveganja.

Druga področja, kot so precizno kmetijstvo, okolje, varnost in obramba, videoigre, virtualna resničnost, izobraževanje in znanstvene raziskave, uporabljajo označene nabore podatkov za spremljanje pridelkov, analizo satelitskih posnetkov, ustvarjanje poglobljenih izkušenj, personalizacijo učenja ali pospeševanje odkritij v biologiji ali astrofiziki. V vseh je logika podobna: Bolje strukturirano in dokumentirano (na primer z Datoteke README) Boljši kot je nabor podatkov, boljši bodo modeli, zasnovani na njem..

Če datoteko obravnavamo kot intelektualni nabor podatkov v osebnem ključu, je vrednost v moči sproti se posvetujte z vsem, kar veste in ste napisaliRazumevanje razvoja vaših idej, odkrivanje tematskih vrzeli, povezovanje besedil iz oddaljenih obdobij in uporaba tega razširjenega spomina v drugih kontekstih, kot so poučevanje, raziskovanje ali poslovna strategija. Vse to brez prenosa pisanja na stroj, temveč z uporabo umetne inteligence kot podpornega orodja za preverjanje podatkov, iskanje referenc ali preizkušanje argumentov.

Kje najti nabore podatkov in kako se njihovo ustvarjanje avtomatizira

Vsi nabori podatkov ne izvirajo iz osebnih datotek: mnogi izvirajo iz odprti repozitoriji in javni viri Ti viri so uporabni za usposabljanje in vrednotenje modelov ali za raziskovalne projekte, podatkovno novinarstvo in strateške analize. Internet že ponuja bogastvo virov, ki jih je mogoče izkoristiti, vedno ob upoštevanju ustreznih pravnih in etičnih vidikov.

Družbeno omrežje X (prej Twitter) na primer ponuja API-je, ki uporabnikom omogočajo zbiranje tvitov, filtriranih po hashtagih in drugih merilih. Te podatke je nato mogoče strukturirati v tabele in vizualizirati z orodji, kot je Tableau. Google Dataset Search ponuja specializiran iskalnik za javne nabore podatkov, kjer lahko uporabniki najdejo vse od poslovnih baz podatkov do industrijskih statistik. Blogi, kot je FiveThirtyEight, objavljajo svoje nabore podatkov o politiki, športu in družbi, tako da lahko vsakdo ponovi ali razširi njihove analize.

Vzporedno se uporabljajo vedno bolj simuliranih okoljih za samodejno ustvarjanje opombiranih podatkovŠe posebej na področjih, kot so avtonomna vozila, kjer bi bilo poustvarjanje vseh pogojev realnosti v fizičnem svetu počasno, drago in nevarno. Simulatorji omogočajo izdelavo slik in videoposnetkov s popolnimi opombami (položaji predmetov, vremenske razmere, trajektorije) in raziskovanje ekstremnih scenarijev, ki jih je težko zajeti v podatkih iz resničnega sveta.

Prihodnost kaže na kombinacijo kuriranih podatkov iz resničnega sveta, osebnih arhivov, obravnavanih kot intelektualni korpusi, in sintetičnih podatkov, ustvarjenih v simulaciji, vse usklajeno s tehnikami nadzorovanega, delno nadzorovanega, nenadzorovanega in samonadzorovanega učenja. Anotacija bo ostala ključni element, vendar jo bodo vse bolj podpirali modeli, ki Predlagajo oznake, odkrivajo nedoslednosti in merijo pristranskosti.prepuščanje bolj finih odločitev ljudem.

V tem kontekstu postane pomembna etična in regulativna razsežnost: ravnanje z osebnimi datotekami kot z nabori podatkov zahteva spoštovanje zasebnosti, avtorskih pravic in pričakovanj glede uporabe, medtem ko morajo platforme za množično sodelovanje ali crowdsourcing zagotoviti poštene pogoje za komentatorje in preglednost glede tega, kateri modeli so usposobljeni s podatki, ki jih ustvarijo.

Ko je celotna veriga skrbno upravljana – od ekstrahiranja osebne datoteke do vektorizacije, grafov, lociranja, komentiranja, avtomatizacije posodobitev in povezovanja s pomočniki umetne inteligence – dobite nekaj, kar ima danes zelo malo avtorjev, podjetij ali organizacij: globok, dosleden in aktiven intelektualni nabor podatkovsposobni poganjati sisteme umetne inteligence, ki so resnično usklajeni z glasom, kontekstom in cilji tistih, ki jih upravljajo, in služiti kot razširjeni spomin v svetu, ki je vse bolj nasičen z informacijami.

Strasten pisec o svetu bajtov in tehnologije nasploh. Rad delim svoje znanje s pisanjem in to je tisto, kar bom počel v tem blogu, saj vam bom pokazal vse najbolj zanimive stvari o pripomočkih, programski opremi, strojni opremi, tehnoloških trendih in še več. Moj cilj je, da vam pomagam krmariti po digitalnem svetu na preprost in zabaven način.