- Transformar um arquivo em um conjunto de dados inteligentes envolve vetorizar o corpus, construir grafos de relacionamento e conectar um assistente de IA para explorá-lo em busca de ideias.

- A qualidade, a localização e a avaliação rigorosa do conjunto de dados são tão cruciais quanto a arquitetura do modelo para a obtenção de IA confiável e contextualizada.

- A anotação de dados, apoiada por ferramentas específicas e processos de controle de qualidade, transforma o arquivo em matéria-prima treinável para múltiplas tarefas.

- Arquivos pessoais, repositórios abertos e dados simulados são combinados para criar ecossistemas de conjuntos de dados aplicáveis a setores como saúde, transporte, finanças ou educação.

Converter um arquivo pessoal em um conjunto de dados intelectuais vivos e úteis Não se limita mais a grandes laboratórios: qualquer pessoa que produza conteúdo digital há anos pode transformar esse histórico em uma base de conhecimento navegável e combustível para sistemas de inteligência artificial. O interessante não é apenas salvar tudo o que você escreveu no... formato adequadomas sim para que essas peças dialoguem entre si, se relacionem entre si e possam ser consultadas para ideias, contextos ou atores, além de uma simples busca por palavras-chave.

Esse salto de um arquivo estático para um conjunto de dados selecionado, anotado e pesquisável Isso abre portas para usos que vão desde um assistente pessoal treinado com seus próprios textos até a construção de modelos linguísticos adaptados a uma cultura ou setor específico. Neste artigo, explicaremos de forma calma e clara o que significa tratar um arquivo como um conjunto de dados intelectuais, como ele é construído tecnicamente, o que a tradução ou anotação adequada implica, quais ferramentas estão envolvidas e em que contextos reais ele já está sendo usado.

De arquivos dispersos a conjuntos de dados intelectuais navegáveis

Imagine que você escreve artigos sobre [tópico/tópico] há mais de uma década. tecnologia, regulamentação, privacidade ou inteligência artificial em uma única plataforma. Você solicita um despejo completo de seus textos (um arquivo de texto simples com milhares de documentos) e o recebe em questão de minutos. No papel, esse arquivo é valioso: ele encapsula quatorze anos do seu processo de pensamento. Mas enquanto permanecer apenas texto não estruturado, você poderá fazer pouco mais do que... pesquisar por palavras individuais.

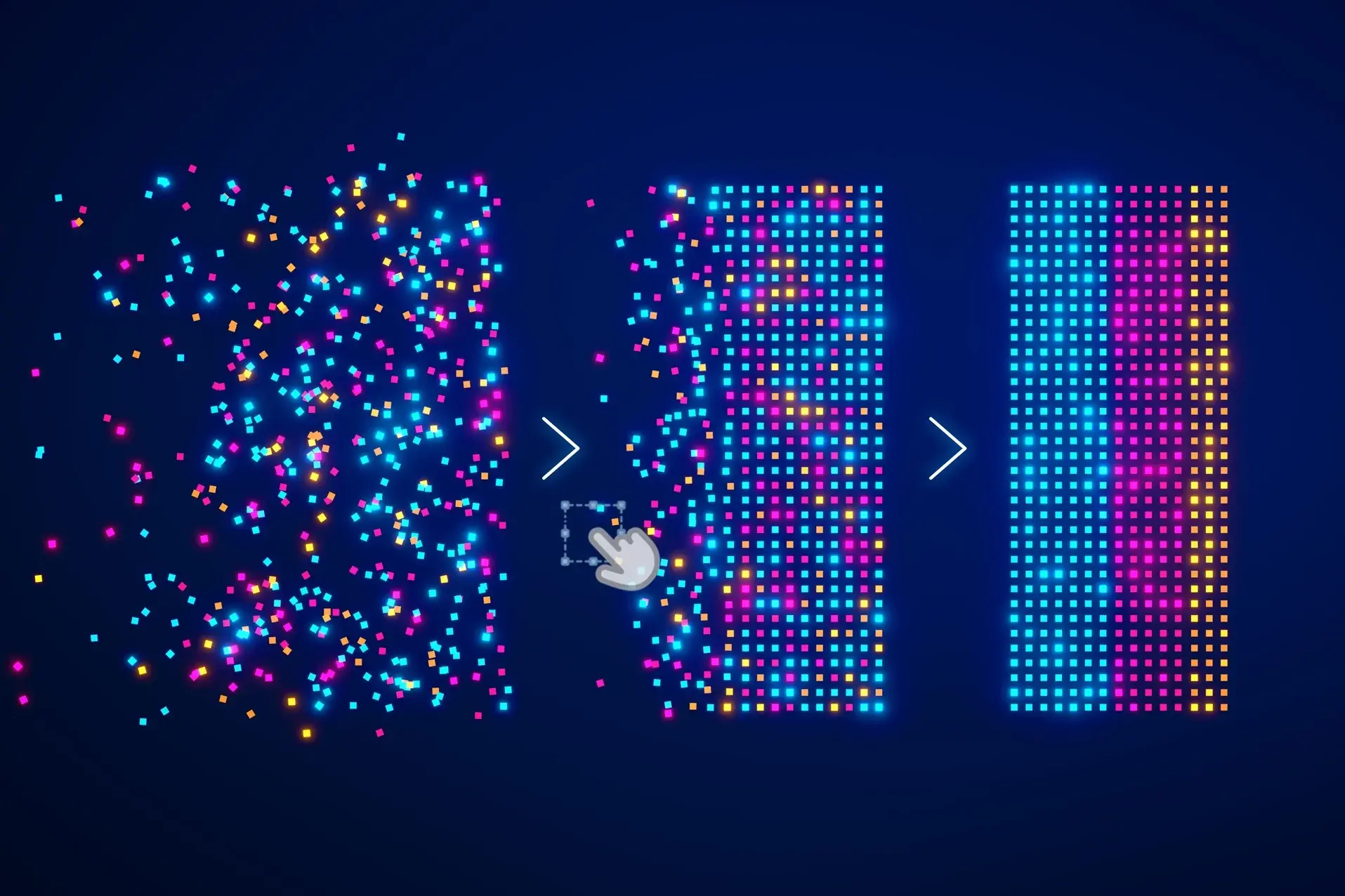

A primeira mudança conceitual envolve deixar de ver esse arquivo como uma pilha de documentos e começar a tratá-lo como um... corpus coerente que pode ser indexado e exploradoA ideia é transformar cada artigo em uma representação numérica que capture seu significado, armazenar esses vetores em um banco de dados especializado e construir, a partir deles, um grafo de relacionamentos e um assistente que compreenda intimamente esse espaço semântico.

Em um estudo de caso real envolvendo 4.209 artigos escritos em inglês ao longo de quatorze anos, o autor utilizou um modelo de incorporações multilíngues (paraphrase-multilingual-mpnet-base-v2, do sentence-transformers) para converter cada texto em um vetor de 768 dimensões. Esses vetores foram armazenados no ChromaDB, um banco de dados vetorial de código aberto. Todo o processo, executado em um servidor padrão sem GPU, foi concluído em cerca de cinco minutos: o arquivo plano foi transformado em um espaço contínuo de ideias.

Na prática, isso significa que você não pesquisa mais "por palavras-chave", mas sim... por meio de conceitos, perguntas ou fragmentos de textoVocê pode fazer perguntas como "Quando comecei a escrever sobre monopólios tecnológicos?" ou "Quais artigos são conceitualmente semelhantes a este argumento?" e o sistema responde localizando os vetores mais próximos nesse espaço semântico, mesmo que não compartilhem o mesmo vocabulário. É uma maneira muito direta de expandir sua memória sobre seu próprio trabalho.

Um grafo também foi construído sobre essa camada vetorial usando o NetworkX, onde cada nó representa um artigo e as arestas conectam textos que compartilham tags temáticas ou excedem um certo limite de similaridade semântica. Visualizado em ferramentas como o Gephi, o resultado é um Mapa da sua produção intelectual organizada em grupos.Regulamentação, plataformas, privacidade, inteligência artificial, mobilidade elétrica… e também conexões inesperadas entre textos separados por anos, mas muito próximos em ideias.

Um assistente pessoal com capacidade de ação como porta de entrada para o arquivo.

O outro elemento-chave dessa abordagem é ter um Assistente de inteligência artificial ancorado ao seu conjunto de dados que pode operar como um colaborador contínuo, não apenas como um simples chatbot em uma aba do navegador. No exemplo anterior, esse assistente se chamava Bautista: uma instância agentiva baseada em modelos antrópicos (Claude Sonnet 4.6), mas capaz de trabalhar com outros modelos dependendo da API utilizada.

Bautista reside no servidor do próprio autor e é orquestrado usando uma plataforma de infraestrutura semelhante ao OpenClaw, que gerencia a memória persistente entre sessões, canais de comunicação (como o Telegram), tarefas agendadas e acesso a ferramentas como o sistema de arquivos e a execução de scripts. Graças a isso, o assistente mantém a continuidade ao longo do tempoEle memoriza projetos anteriores, preserva arquivos, automatiza processos e pode agir de forma autônoma quando instruído.

A diferença em relação à abertura de um modelo genérico no navegador é que aqui não estamos falando apenas de mais um chat, mas de algo mais parecido com uma colaborador integrado em sua infraestrutura, especializada em seu próprio corpus e capaz de atuar como intermediária entre esse arquivo vetorizado e suas necessidades diárias: localizar textos, detectar redundâncias, recuperar citações, executar análises específicas ou iniciar scripts de manutenção.

Além disso, o sistema foi projetado para manter o arquivo ativo sem intervenção manual. Sempre que o autor publica um novo artigo no Medium e compartilha o link de acesso completo no Bluesky, um processo agendado consulta diariamente a API pública do Bluesky, detecta a nova entrada, baixa o texto, gera seu código de incorporação e o adiciona ao ChromaDB. Um sistema automatizado garante que o conjunto de dados se atualize automaticamente., graças às tarefas de indexação de arquivosEvitar o problema clássico das bases de conhecimento se tornarem obsoletas porque atualizá-las é uma tarefa árdua.

Numa fase posterior, foram adicionadas novas camadas de análise, como o reconhecimento de entidades nomeadas (pessoas, empresas, tecnologias, países, instituições) em todo o corpus, com o objetivo de estudar a Evolução temporal de menções e redes de coocorrênciaGraças a isso, é possível ver quando um agente como a OpenAI aparece nos textos, quando o Google+ desaparece ou como diferentes agentes se relacionam entre si ao longo do tempo, aproximando o sistema da análise de discurso em larga escala em vez de um simples arquivo pessoal.

Conjunto de dados, modelo e comportamento: o arquivo como matéria-prima para IA

No contexto da inteligência artificial, um Um conjunto de dados é muito mais do que uma coleção de dados.Este é o material de treinamento que molda o comportamento do modelo. Em processamento de linguagem natural (PLN), esse conjunto de dados geralmente assume a forma de textos, diálogos, instruções ou anotações que permitem aos modelos aprender a traduzir, resumir, conversar ou classificar emoções, entre outras tarefas.

Durante anos, a ênfase foi colocada quase exclusivamente na arquitetura do modelo (número de parâmetros, tipo de camadas, capacidade computacional), mas a experiência recente tem demonstrado que a qualidade, a diversidade e a adequação dos dados de treinamento Elas têm tanto peso quanto, ou até mais que, o próprio projeto do modelo. Como apontam estudos como os de Bender et al. ou Paullada et al., os modelos não são melhores do que os dados que os alimentam: se o conjunto de dados for tendencioso, incompleto ou não representativo, a IA reproduzirá essas mesmas falhas.

Essa mudança de perspectiva impulsionou um movimento claro em direção a qualidade em vez de quantidadeNão se trata apenas de coletar grandes volumes de texto, mas de garantir que esses dados estejam alinhados com o idioma, a variedade regional e o contexto cultural em que a IA será implementada (Blasi et al., Kreutzer et al.). Isso é especialmente relevante se considerarmos um arquivo como um conjunto de dados intelectuais: o corpus pessoal de um autor pode ser muito rico, mas, se for usado posteriormente em modelos que operam em outros idiomas ou mercados, a curadoria e a adaptação tornam-se essenciais.

Além disso, o conjunto de dados não é útil apenas para treinamento, mas também para avaliar o desempenho do modeloSe um modelo for avaliado usando dados que já viu durante o treinamento (contaminação de dados), métricas enganosas serão obtidas, mascarando suas verdadeiras limitações, conforme analisado por Dong et al. e Samuel et al. Portanto, ao transferir um arquivo pessoal para um contexto de IA, é crucial distinguir quais partes são usadas para treinamento, quais para validação e quais para teste, bem como projetar conjuntos de avaliação ricos e desafiadores, em vez de testes triviais que todos os modelos passam.

Traduzir e localizar conjuntos de dados: muito mais do que simplesmente transferir texto de um idioma para outro.

Quando você quiser reutilizar um arquivo como Conjunto de dados intelectuais em vários idiomas ou mercadosSurge então um desafio específico: a tradução e localização do corpus. À primeira vista, pode parecer apenas mais um projeto de tradução, mas um conjunto de dados de IA é frequentemente composto por fragmentos isolados, diálogos soltos, instruções curtas ou dados estruturados sem um contexto narrativo claro, o que muda completamente as regras do jogo.

Em muitos conjuntos de dados encontramos contexto muito limitadoEssas são frases sem informações sobre quem está falando, a situação ou sua intenção. O tradutor precisa inferir funções pragmáticas (uma ordem, uma dúvida, um insulto, ironia) para que o modelo possa aprender corretamente o comportamento no idioma de destino. Além disso, existem elementos que não devem ser alterados, como trechos de código, variáveis, marcadores de posição ou rótulos técnicos, onde uma tradução ingênua pode comprometer o conjunto de dados.

A consistência em massa também entra em jogo: decisões aparentemente pequenas, como escolher entre "tú" ou "usted", lidar com questões de gênero inclusivas ou o tratamento de certos anglicismos, Eles são multiplicados por milhões de exemplos.Uma inconsistência que poderia passar despercebida em um livro se torna ruído aqui, que o modelo internaliza. E, diferentemente da tradução editorial, muitas vezes é melhor manter os erros gramaticais ou coloquialismos como aparecem, porque o objetivo não é "aprimorar" o texto, mas ensinar a IA como as pessoas realmente se expressam.

Portanto, em vez de traduzir, é mais apropriado falar sobre localizar conjuntos de dadosIsso envolve a adaptação de referências culturais, nomes de instituições, marcas, formatos de data, moedas e unidades de medida, além do ajuste do registro às normas sociais do mercado-alvo. Em grandes modelos de linguagem, essa localização é o que distingue uma IA que simplesmente "fala espanhol" de uma que compreende nuances culturais, expectativas de cortesia e referências locais.

Empresas com longa trajetória em localização de software e conteúdo, como a iMasin, vêm evoluindo nessa direção. tradução e curadoria específica de conjuntos de dadosCombinando conhecimento especializado, guias de estilo refinados, glossários selecionados e ferramentas de tradução automática e assistida por computador, sua abordagem se assemelha mais a um processo de controle de qualidade de dados do que à tradução tradicional: definição precisa de critérios linguísticos e técnicos, gerenciamento de erros intencionais, uso de controle de qualidade automatizado e amostragem estatística para monitorar a consistência.

Conjunto de dados anotado: dando estrutura e significado aos dados.

Para que um arquivo se torne um Um conjunto de dados intelectuais verdadeiramente útil para modelos supervisionados.Não basta simplesmente coletar textos: eles precisam ser anotados. Um conjunto de dados anotado é aquele em que cada elemento (imagem, fragmento de áudio, frase, tabela) possui metadados que descrevem seu conteúdo ou função: tags, categorias, entidades, relações, transcrições, áreas delimitadoras, etc.

Em visão computacional, por exemplo, as anotações podem incluir rótulos de classificação global, caixas delimitadoras em torno de objetos, máscaras de segmentação que atribuem uma categoria a cada pixel, anotações de pontos-chave (articulações humanas, pontos faciais) ou trajetórias ao longo de um vídeo. Em texto, falamos sobre entradas de entidades nomeadas (pessoas, organizações, lugares), classificação de documentos, análise sintática, relações entre entidades ou etiquetas de sentimento.

O objetivo de todo esse trabalho é que os modelos tenham exemplos claros daquilo que eles deveriam reconhecer ou preverUm conjunto de dados de imagens anotadas com gatos, carros e pedestres permite o treinamento de modelos que detectam e classificam esses objetos; um conjunto de dados de conversas com etiquetas de intenção e emoção permite o treinamento de chatbots e sistemas de análise de sentimentos; um corpus documental com entidades marcadas e relações explícitas estabelece a base para sistemas de extração de conhecimento.

A anotação não se limita a texto ou imagens: em áudio, as tarefas incluem transcrição, marcação de eventos sonoros (aplausos, risos, tiros), segmentação por locutor e registro de palavras-chave com marcação de tempo. E em dados multimodais (vídeo com áudio e legendas, por exemplo), o trabalho consiste em alinhar as modalidades e anotar as interações em conjunto (expressão facial, tom de voz e conteúdo textual).

No âmbito dos dados estruturados e tabulares, a anotação também significa Explique o significado de colunas e valores.Isso inclui vincular entradas equivalentes em diferentes bancos de dados ou marcar atributos relevantes para tarefas de previsão. Cada tipo de projeto escolherá um ou outro conjunto de anotações, e frequentemente vários são combinados para abranger casos de uso complexos.

Ferramentas e processos para anotar um arquivo como um conjunto de dados

A coleta de dados em grande escala exige Ferramentas específicas e fluxos de trabalho bem planejados.Rotular manualmente algumas dezenas de imagens é bem diferente de gerenciar centenas de milhares de exemplos em múltiplos formatos, com equipes espalhadas por diversos fusos horários.

Em visão computacional, são utilizadas soluções de código aberto como LabelImg (para caixas delimitadoras), CVAT (para anotação complexa de imagens e vídeos com recursos colaborativos) ou plataformas comerciais como Labelbox ou SuperAnnotate, que incorporam análises de qualidade, gerenciamento de projetos e automação. Para texto, ferramentas como Prodigy, LightTag, BRAT ou Datasaur facilitam a anotação de entidades, classificações, dependências sintáticas e relações, com rastreamento detalhado de anotadores e conflitos.

Em áudio, softwares como Label Studio, Praat ou Sonix permitem segmentação, transcrição e rotulagem precisas de sons. Para dados multimodais, projetos leves como o VGG Image Annotator (VIA) ou aplicativos como o RectLabel oferecem uma base versátil para sincronizar anotações entre diferentes tipos de dados. E para projetos que exigem alto volume e velocidade, plataformas como automação e colaboração em massa tais como Amazon SageMaker Ground Truth, Scale AI, DataLoop ou soluções colaborativas como Digma ou Hive Data.

A escolha de uma ferramenta não é apenas uma questão de preferência pessoal: é preciso considerar o tipo de dados, o orçamento, o tamanho da equipe, a necessidade de colaboração em tempo real e o tamanho do conjunto de dados. Quase todas as plataformas avançadas incluem recursos para validar regras básicas, gerenciar conflitos, medir produtividade e qualidade e combinar anotações humanas com sugestões automatizadas geradas por modelos preexistentes.

Além da ferramenta em si, a qualidade é determinada pelo processo. Fornecer Guias de anotação muito claros e atualizados.Isso envolve o treinamento de anotadores (especialmente em áreas sensíveis como a medicina), a organização de revisões cruzadas, a definição de métricas de qualidade (concordância entre anotadores, precisão, recall) e o uso de dados de "padrão ouro" validados por especialistas para calibrar a equipe. Anotar um arquivo como um conjunto de dados intelectual não é uma tarefa de curta distância, mas um ciclo contínuo e iterativo.

Muitos projetos optam por uma abordagem híbrida: tarefas simples ou repetitivas (como detecção preliminar de objetos ou pré-classificação de texto) são automatizadas, e o trabalho humano é reservado para tarefas mais complexas. casos ambíguos, complexos ou de grande impactoIsso reduz custos sem sacrificar a qualidade e permite que os avaliadores se concentrem onde agregam mais valor.

Aplicações práticas de conjuntos de dados anotados e intelectuais

Tratar um arquivo como um conjunto de dados inteligentes não é um exercício teórico: tem aplicações muito concretas em múltiplos setores onde a anotação e a curadoria são essenciais para a implementação de IA confiável. Em visão computacional, por exemplo, conjuntos de imagens e vídeos anotados permitem o desenvolvimento de sistemas de reconhecimento facial, detecção de anomalias em raios-X ou ressonâncias magnéticas, inspeções automatizadas de fábricas ou veículos autônomos que Eles identificam pedestres, placas e obstáculos. en tiempo real.

Em processamento de linguagem natural, conjuntos de dados bem localizados e anotados permitem tarefas como análise de sentimentos em mídias sociais, classificação de consultas em atendimento ao cliente, extração de entidades em documentos jurídicos, tradução automática ou treinamento de chatbots que compreendem o idioma. nuances emocionais e contextos culturaisUm arquivo pessoal de artigos pode se tornar a base de um assistente especializado que, antes de publicar algo novo, revisa o que já foi dito, detecta repetições ou identifica mudanças de postura ao longo dos anos.

Na área da saúde e biotecnologia, os dados dependem cada vez mais de conjuntos de dados altamente anotados: imagens médicas com diagnósticos confirmados, registros clínicos estruturados e sequências genômicas rotuladas com mutações relevantes. No setor automotivo e de transportes, os dados são essenciais para a condução autônoma, o planejamento inteligente de rotas e a gestão do tráfego. No comércio e na área bancária, são utilizados para Recomendadores de produtos, detecção de fraudes e análise de riscos..

Outras áreas, como agricultura de precisão, meio ambiente, segurança e defesa, videogames, realidade virtual, educação e pesquisa científica, utilizam conjuntos de dados anotados para monitorar plantações, analisar imagens de satélite, criar experiências imersivas, personalizar o aprendizado ou acelerar descobertas em biologia ou astrofísica. Em todas elas, a lógica é semelhante: Quanto melhor estruturado e documentado (por exemplo, com Arquivos README) Quanto melhor o conjunto de dados, melhores serão os modelos desenvolvidos com base nele..

Se considerarmos o arquivo como um conjunto de dados intelectuais com uma chave pessoal, o valor reside no poder. Consulte rapidamente tudo o que você sabe e escreveu.Compreender como suas ideias evoluíram, descobrir lacunas temáticas, conectar textos de períodos distantes e aproveitar essa memória ampliada em outros contextos, como ensino, pesquisa ou estratégia de negócios. Tudo isso sem delegar a escrita à máquina, mas sim usando a IA como uma ferramenta de apoio para verificar dados, buscar referências ou testar argumentos.

Onde encontrar conjuntos de dados e como sua criação está sendo automatizada.

Nem todos os conjuntos de dados têm origem em arquivos pessoais: muitos provêm de repositórios abertos e fontes públicas Esses recursos são úteis para o treinamento e avaliação de modelos, ou para projetos de pesquisa, jornalismo de dados e análise estratégica. A internet já oferece uma vasta gama de recursos que podem ser aproveitados, sempre com as devidas considerações legais e éticas.

A rede social X (antiga Twitter), por exemplo, oferece APIs que permitem aos usuários coletar tweets filtrados por hashtags e outros critérios. Esses dados podem então ser estruturados em tabelas e visualizados com ferramentas como o Tableau. O Google Dataset Search fornece um mecanismo de busca especializado para conjuntos de dados públicos, onde os usuários podem encontrar de tudo, desde bancos de dados corporativos até estatísticas do setor. Blogs como o FiveThirtyEight publicam seus conjuntos de dados sobre política, esportes e sociedade para que qualquer pessoa possa replicar ou ampliar suas análises.

Em paralelo, estão sendo usados cada vez mais. ambientes simulados para gerar dados anotados automaticamenteEspecialmente em áreas como veículos autônomos, onde recriar todas as condições da realidade no mundo físico seria lento, caro e perigoso, os simuladores permitem a produção de imagens e vídeos com anotações perfeitas (posições de objetos, condições climáticas, trajetórias) e a exploração de cenários extremos difíceis de capturar em dados do mundo real.

O futuro aponta para uma combinação de dados reais cuidadosamente selecionados, arquivos pessoais tratados como corpora intelectuais e dados sintéticos gerados em simulação, todos coordenados com técnicas de aprendizado supervisionado, semissupervisionado, não supervisionado e autossupervisionado. A anotação continuará sendo um elemento fundamental, mas cada vez mais auxiliada por modelos que Eles propõem rótulos, detectam inconsistências e medem vieses.Deixando as decisões mais importantes para o povo.

Nesse contexto, a dimensão ética e regulatória torna-se importante: o tratamento de arquivos pessoais como conjuntos de dados exige o respeito à privacidade, aos direitos autorais e às expectativas de uso, enquanto as plataformas de crowdsourcing ou colaboração em massa devem garantir condições justas para os anotadores e transparência sobre quais modelos são treinados com os dados que eles geram.

Quando toda essa cadeia é cuidadosamente gerenciada — desde a extração de um arquivo pessoal até a vetorização, a criação de gráficos, a localização, a anotação, a automatização de atualizações e a conexão com assistentes de IA — você obtém algo que pouquíssimos autores, empresas ou organizações possuem hoje: um conjunto de dados intelectuais profundo, consistente e em tempo realcapaz de impulsionar sistemas de inteligência artificial verdadeiramente alinhados com a voz, o contexto e os objetivos daqueles que os utilizam, e de servir como memória estendida em um mundo cada vez mais saturado de informações.

Escritor apaixonado pelo mundo dos bytes e da tecnologia em geral. Adoro compartilhar meu conhecimento por meio da escrita, e é isso que farei neste blog, mostrar a vocês tudo o que há de mais interessante sobre gadgets, software, hardware, tendências tecnológicas e muito mais. Meu objetivo é ajudá-lo a navegar no mundo digital de uma forma simples e divertida.