- Raspberry Pi 5 stał się dostępną platformą do uruchamiania lekkich modeli sztucznej inteligencji i agentów koordynujących usługi w chmurze, ze szczególnym uwzględnieniem prywatności i izolacji systemu.

- Modele uproszczone i kompaktowe (DeepSeek, Llama 3.2, Qwen itp.) umożliwiają czatowanie, tłumaczenie i obsługę kodu na skromnym sprzęcie, choć z wyraźnymi ograniczeniami w porównaniu z dużymi komercyjnymi modelami LLM.

- Dedykowane akceleratory, takie jak moduły Hailo (Hailo-8L i Hailo-10H w AI HAT+ 2), zwiększają wydajność wnioskowania, umożliwiając lokalne przetwarzanie obrazu i LLM na Raspberry Pi 5 przy niskim opóźnieniu.

- Połączenie niewielkich rozmiarów, dedykowanego sprzętu i automatyki domowej sprawia, że Raspberry Pi jest idealnym węzłem AI na brzegu sieci, zdolnym do interpretowania poleceń i automatyzowania zadań bez polegania na chmurze.

La Sztuczna inteligencja na Raspberry Pi Przeżywamy wyjątkowy moment. Do niedawna, myśląc o sztucznej inteligencji, wyobrażaliśmy sobie albo dużego chatbota w chmurze, wymagającego subskrypcji, albo niezwykle drogi komputer z wieloma procesorami graficznymi do lokalnego uruchamiania ogromnych modeli. Teraz sytuacja się zmieniła: pojawienie się agentów takich jak OpenClaw, modeli destylowanych, takich jak DeepSeek, oraz nowych akceleratorów, takich jak AI HAT+ 2, sprawiło, że mała płyta główna znalazła się w centrum uwagi.

Ta zmiana nie jest tylko chwilową modą: Połączenie Raspberry Pi 5, lekkich modeli i dedykowanego sprzętu AI Umożliwia uruchamianie chatbotów, tłumaczy, asystentów kodowania czy systemów wizji komputerowej bez polegania na chmurze. Wszystko to z większą kontrolą nad bezpieczeństwem, kosztami i prywatnością danych, choć istnieją również wyraźne ograniczenia, o których należy pamiętać, aby uniknąć rozczarowania.

Rozwój agentów AI i rola Raspberry Pi

W ostatnich miesiącach dużo się o tym mówiło Agenci AI zdolni do samodzielnego działaniaJedną z nazw, która wywołała największe poruszenie, jest OpenClaw. W przeciwieństwie do klasycznego chatbota, który odpowiada tylko na wiadomości, agent to system, który może podejmować decyzje i wykonywać działania: uruchamiać skrypty, wywoływać API, wchodzić w interakcje z usługami zewnętrznymi lub manipulować plikami w określonym środowisku obliczeniowym.

Ciekawe jest to Ten typ agenta nie wymaga, aby jego „mózg” znajdował się w samym Raspberry Pi.Zazwyczaj większy model działa w chmurze, natomiast zarząd działa jako koordynator: utrzymuje konwersację, zarządza kontekstem użytkownika, uruchamia polecenia w systemie i działa jako pomost między światem fizycznym (czujniki, siłowniki, automatyka domowa) a zdalną sztuczną inteligencją.

Jednocześnie konfiguracje zaprojektowane dla uruchamiaj mniejsze modele bezpośrednio na sprzęcie Raspberry PiNarzędzia takie jak Ollama czy llama.cpp umożliwiają ładowanie zredukowanych LLM-ów zoptymalizowanych pod architekturę ARM, szczególnie na modelach takich jak Raspberry Pi 4 lub 5 z wystarczającą ilością pamięci RAM. To nie magia: niektóre funkcje i szybkość są poświęcane, ale w niektórych zastosowaniach wynik jest całkowicie użyteczny.

Ten nowy scenariusz doprowadził nawet do ruchy na rynku finansowym wokół Raspberry Pize znaczącymi wzrostami ceny akcji związanymi z entuzjazmem dla dostępnych agentów AI. Ostatecznie, idea, która zyskuje na popularności, to małe urządzenia fizyczne dedykowane do uruchamiania lub koordynowania AI, zamiast polegania wyłącznie na dużych centrach danych lub komputerach stacjonarnych wysokiej klasy.

Bezpieczeństwo, izolacja i wątpliwości co do podejścia

Udzielenie agentowi AI głębokiego dostępu do systemu nie jest żadnym żartem: Agent z szerokimi uprawnieniami może odczytywać pliki, przenosić dane, wypełniać formularze internetowe i uzyskiwać dostęp do kluczowych usług.Ekosystem Raspberry Pi podkreśla, że wiąże się to z realnymi ryzykami, ponieważ algorytmy te nie są nieomylne i mogą popełniać błędy lub zachowywać się w nieoczekiwany sposób; dlatego zaleca się przestrzeganie [odpowiednich wytycznych/metod]. dobre praktyki bezpieczeństwa komputerowego.

Tutaj właśnie ujawnia się jedna z największych zalet płyty głównej: Używanie Raspberry Pi jako odizolowanego środowiska zmniejsza wpływ potencjalnych awarii.Zamiast oddawać bezpośrednią kontrolę nad komputerem głównym, możesz skonfigurować dedykowany system, w którym agent ma dostęp tylko do niezbędnych zasobów. Ta fizyczna „piaskownica” pomaga ograniczyć uszkodzenia i umożliwia eksperymentowanie z większym spokojem ducha.

Nie wszyscy są przekonani, że takie podejście jest panaceum. Specjalistyczne media zwróciły uwagę, że Raspberry Pi traci nieco na atrakcyjności jako bardzo tanie urządzenie.Zwłaszcza w zaawansowanych konfiguracjach z dużą ilością pamięci RAM. Model Raspberry Pi 5 z 16 GB pamięci może zbliżać się do 200 dolarów, a nawet je przekraczać, co dla niektórych podważa pierwotną ideę taniego komputera dla każdego.

W tym sensie istnieją głosy sceptyczne, które uważają, że Wykorzystanie Raspberry Pi jako bazy dla złożonych agentów, takich jak OpenClaw, może nie być najlepszą decyzją. Jeśli budżet jest ograniczony, koszt płyty głównej, pamięci i wszelkich akceleratorów AI może znacznie zwiększyć cenę, czyniąc ją droższą od wydajniejszych i bardziej elastycznych alternatyw.

Mimo to podejście oparte na dedykowanym urządzeniu z izolacją ryzyka pozostaje bardzo atrakcyjne: kto ceni bezpieczeństwo, prywatność i kontrolowane eksperymenty Raspberry Pi stanowi idealne „laboratorium” do testowania agentów i modeli bez narażania krytycznych maszyn roboczych.

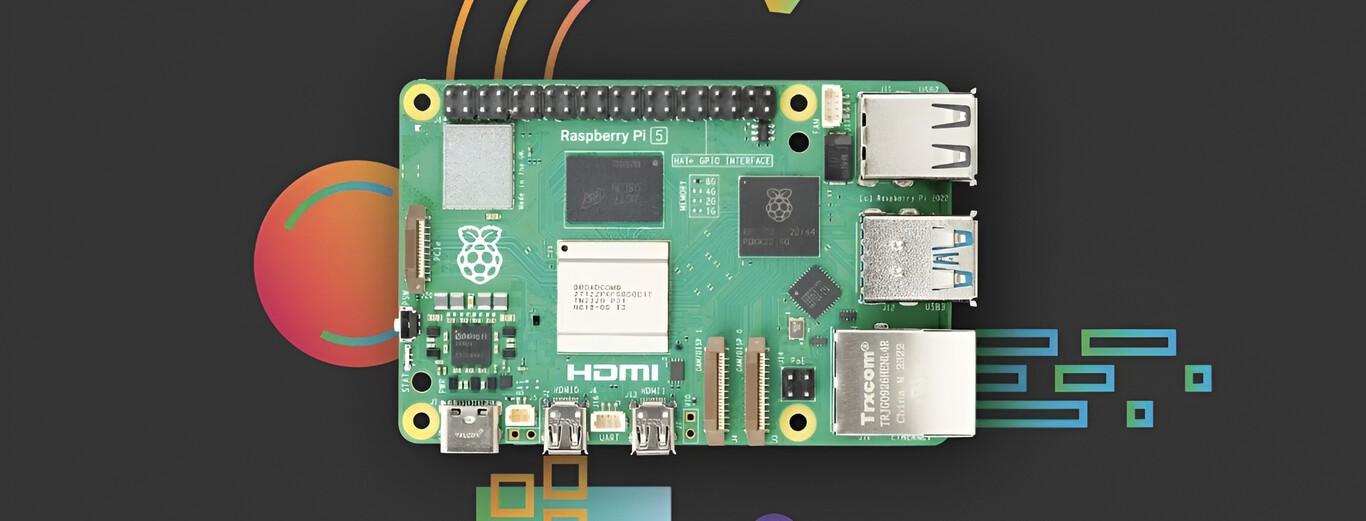

Raspberry Pi 5 jako platforma dla lokalnych modeli AI

Poza częścią agentów, Raspberry Pi 5 ugruntował swoją pozycję jako niezwykle wszechstronne narzędzieNadal sprawdza się znakomicie w robotyce, elektronice, automatyce domowej czy multimediach, ale jego obecne możliwości sprzętowe pozwalają pójść o krok dalej i wykorzystać go jako podstawę rzeczywistych, lokalnych projektów z zakresu sztucznej inteligencji.

Dzięki szybszemu procesorowi, ulepszeniom GPU i możliwości tworzenia konfiguracji z dużą ilością pamięci RAM, Raspberry Pi 5 całkiem dobrze radzi sobie z uruchamianiem lekkich modeli AI.Nie zastąpi serwera pełnego procesorów GPU, ale pozwala na eksperymentowanie z przetwarzaniem obrazu komputerowego, rozpoznawaniem mowy, kompaktowymi modelami językowymi lub konkretnymi asystentami do bardzo specyficznych zadań.

Typowa strategia obejmuje wybierz modele open-source zoptymalizowane pod kątem ograniczonego sprzętuPrzykładami, które są zazwyczaj używane, są Mistral 7B, kilka mniejszych wariantów Orca lub kompaktowe modele, takie jak Microsoft Phi-2, pod warunkiem, że istnieją dostosowane i przede wszystkim zredukowane wersje z technikami kwantyzacji lub destylacji, aby zmieściły się w pamięci.

Ważne jest, aby to zrozumieć Te mniejsze LLM-y nie grają w tej samej lidze co giganci, tacy jak GPT-4Tracą głębię, kontekst i responsywność, zwłaszcza w przypadku bardzo ogólnych lub złożonych tematów. W zamian oferują akceptowalne opóźnienie, niższe zużycie energii i zaletę braku konieczności korzystania z połączeń zewnętrznych – co jest kluczowe, gdy całe przetwarzanie ma odbywać się na samej płytce.

To połączenie sprawia, że Raspberry Pi 5 staje się swego rodzaju „piaskownica” idealna do nauki, prototypowania i wdrażania rozwiązań AI które nie wymagają ekstremalnej wiedzy technicznej ani wygórowanych nakładów inwestycyjnych, pod warunkiem, że jest jasne, czego można, a czego nie można oczekiwać od tych uproszczonych modeli.

Podstawowe kroki uruchomienia sztucznej inteligencji na Raspberry Pi 5

Aby skonfigurować projekt, który uruchamia sztuczną inteligencję lokalnie na Raspberry Pi 5, pomocne będzie wykonanie szeregu ogólnych kroków. To nie jest sztywny przepis, ale raczej mentalny przewodnik. tego, co znajdziesz, gdy zaczniesz majsterkować.

Pierwsza sprawa wybierz model zgodny z architekturą ARM i zasobami płytyW tym miejscu do gry wchodzą modele takie jak wspomniany Mistral 7B w mocno skompresowanych wersjach, kilka mniejszych modeli Orca lub pomniejszonych modeli Phi-2, a także inne modele LLM od 1B do 7B z parametrami przygotowanymi do pracy na skromniejszych urządzeniach. Im mniejszy model, tym łatwiej go uruchomić, ale jednocześnie tym bardziej będzie ograniczony.

Następnie nadchodzi część zainstaluj oprogramowanie wspomagające pracę z sieciami neuronowymiW zależności od potrzeb możesz użyć TensorFlow Lite do projektów wizyjnych, PyTorch, jeśli zamierzasz korzystać z konkretnych repozytoriów, lub dedykowanych środowisk uruchomieniowych, takich jak Edge TPU, jeśli zamierzasz korzystać z zewnętrznych akceleratorów. W przypadku LLM narzędzia takie jak llama.cpp lub Ollama znacznie ułatwiają pracę.

Po zainstalowaniu oprogramowania naciśnij Skonfiguruj środowisko wykonawcze na Raspberry PiWiąże się to z koniecznością dostosowania opcji systemowych, zainstalowania dodatkowych zależności, zoptymalizowania modelu pod kątem architektury ARM, a często także z koniecznością manipulowania parametrami, takimi jak rozmiar kontekstu, poziom kwantyzacji lub liczba wątków, aby zrównoważyć wydajność i zużycie pamięci.

Po skonfigurowaniu wszystkiego możesz przejść do Uruchom model i zacznij wyciągać wnioskiTutaj sprawdzasz, czy kombinacja sprzętu i oprogramowania sobie z tym poradzi. Będziesz musiał załadować dane, wysłać zapytania, sprawdzić opóźnienia i sprawdzić, na ile jakość odpowiedzi odpowiada Twoim oczekiwaniom. Często trzeba dopracowywać niezliczone szczegóły, aż system zacznie działać płynnie. Zaleca się sprawdzenie miejsca na dysku za pomocą narzędzi do... przeanalizuj i wyczyść dysk.

Jeśli wydajność nie jest zadowalająca, masz możliwość Dodaj zewnętrzny akcelerator, aby odciążyć procesor.Urządzenia takie jak USB Coral z Edge TPU czy nowe karty bazujące na układach Hailo umożliwiają sieciom neuronowym znacznie szybszą pracę przy mniejszym zużyciu energii, co w wielu przypadkach całkowicie zmienia doświadczenie użytkownika.

Prywatność, bezpieczeństwo i zalety przetwarzania wszystkiego lokalnie

Jednym z najsilniejszych argumentów przemawiających za wykorzystaniem sztucznej inteligencji na Raspberry Pi jest możliwość przechowywania danych w sieciUruchamiając model lokalnie, nie wysyłasz danych osobowych ani poufnych na serwer zewnętrzny, co jest szczególnie istotne w środowiskach profesjonalnych, edukacyjnych lub w zaawansowanej automatyzacji domu. Zaleca się również stosowanie technik szyfrowana kopia zapasowa do twoich kopii.

To znaczy że Masz o wiele większą kontrolę nad tym, kto ma dostęp do przetwarzanych przez Ciebie danych.Jeśli Twój lokalny asystent analizuje dokumenty wewnętrzne, monitoruje kamery bezpieczeństwa lub zarządza historią użytkowania Twojego domu, wszystko to pozostaje w ramach Twojej infrastruktury. Nie jesteś zależny od zmian w polityce prywatności ani potencjalnych naruszeń w usługach zewnętrznych.

Równolegle Raspberry Pi działa niemal jak „Fizyczna zapora sieciowa” dla Twoich eksperymentów ze sztuczną inteligencjąMożesz skonfigurować system niezależny od głównej sieci, ograniczyć jego dostęp do określonych zasobów i upewnić się, że nawet jeśli model popełni dziwne błędy lub agent okaże się zbyt kreatywny, potencjalne szkody zostaną ograniczone.

Oczywiście nie neguje to potrzeby poprawnie skonfiguruj uprawnienia, użytkowników i reguły siecioweAgent z nadmierną swobodą na słabo zabezpieczonym Raspberry Pi nadal może stanowić problem. Różnica polega na tym, że jako dedykowane i niedrogie środowisko, znacznie łatwiej jest przeprowadzić audyt, odbudować system od podstaw, a nawet fizycznie go odłączyć w razie awarii.

Podsumowując, dla tych, którzy cenią sobie ochronę danych i możliwość audytu całego przepływu informacji, Wykorzystanie Raspberry Pi jako lokalnego węzła AI zapewnia spokój ducha, który trudno osiągnąć. gdy wszystko zależy od usług w chmurze zarządzanych spoza Twojej organizacji lub Twojego domu.

DeepSeek i rzeczywistość uruchamiania dużych modeli na skromnym sprzęcie

Kolejną nazwą, która wstrząsnęła rynkiem, jest DeepSeek, a w szczególności model DeepSeek R1, zaprojektowany z myślą o rozumowaniu i bardzo ambitnym podejściuWiele nagłówków podkreślało, że przewyższa on wydajnością niektóre z najbardziej zaawansowanych modeli komercyjnych i może być uruchamiany lokalnie, co rozbudziło ideę posiadania „domowego ChatGPT” na dowolnej maszynie.

Ważne jest, aby odkładać rzeczy na swoje miejsce: Pełna wersja DeepSeek R1 671B to potwór o pojemności ponad 400 GB Do płynnej pracy wymaga kilku bardzo zaawansowanych procesorów graficznych. To wariant, który naprawdę konkuruje z topowymi modelami OpenAI i podobnymi platformami, a jest całkowicie poza zasięgiem Raspberry Pi czy standardowego komputera PC.

Główną różnicą w porównaniu do innych zamkniętych dostawców jest to, że jeśli masz sprzęt, Możesz pobrać model, złożyć go przy użyciu narzędzi, takich jak Ollama, i uruchomić w domu.i w wielu przypadkach będziesz potrzebować podłącz zewnętrzny dysk twardy do przechowywania ciężarów. Mówimy jednak o konfiguracjach kosztujących kilka tysięcy euro, z kartami takimi jak RTX 4090, A100 lub podobnymi kartami dla centrów danych; niczym w porównaniu z mikrokomputerem o niskim poborze mocy.

Aby umożliwić zwykłym użytkownikom granie w DeepSeek na standardowych komputerach lub urządzeniach, takich jak Raspberry Pi, należy wykonać następujące kroki: modele destylowane i zredukowaneSą to zasadniczo skompresowane wersje oryginału, które zachowują część jego działania kosztem pojemności i wiedzy. To właśnie tutaj pojawiają się warianty o parametrach 14B, 7B, a nawet 1.5B.

Kluczowe pytanie brzmi, ile tracimy po drodze. Związek między rozmiarem modelu, pamięcią i jakością odpowiedzi jest bardzo wyraźnyJeśli model referencyjny ma ponad 400 GB, a Wikipedia zajmuje już blisko 100 GB, to nierealistyczne jest oczekiwanie, że wersja zajmująca nieco ponad 1 GB będzie zawierała wszystkie szczegółowe informacje na temat tej wiedzy.

Testy DeepSeek w warunkach rzeczywistych na różnych urządzeniach

Aby zobaczyć te różnice w praktyce, warto porównać zachowanie różnych wariantów DeepSeek na zróżnicowanym sprzęcie. Na stacji roboczej z Karta graficzna RTX 3060 z 12 GB pamięci VRAM może całkiem dobrze obsługiwać wersję o parametrach 14B.i nawet wymusić wersję 32B wykorzystując pamięć RAM systemu, mimo że prędkość spada znacząco.

Jeśli wypróbujesz wersję DeepSeek w chmurze, bez lokalnych ograniczeń sprzętowychWiększy model działa bez zarzutu i wyraźnie pokazuje, dlaczego konkuruje z gigantami branży. Różnica jest zauważalna zarówno w szybkości i spójności odpowiedzi, jak i w zdolności do obsługi złożonych instrukcji.

Kiedy schodzisz na ziemię Z Raspberry Pi i 8 GB pamięci RAM scenariusz zmienia się radykalnie.W tym przypadku największym modelem, który można funkcjonalnie wykonać, jest ten z 7 miliardami parametrów, a nawet wtedy prędkość wynosi około 1 tokena na sekundę. To sprawia, że prowadzenie płynnej rozmowy jest niemal nie do zniesienia.

Oceniając jakość odpowiedzi, różnica staje się jeszcze bardziej widoczna. W obliczu prostego pytania z wiedzy ogólnej, na przykład kto jest znaną postacią z popularnego serialu, Model 14B jest poprawny, natomiast model 7B zaczyna dawać dziwne odpowiedzi.Wersja 1.5B oferuje wyniki, które bardziej przypominają sfabrykowany tekst bez solidnych podstaw.

Ten wzór powtarza się w przypadku zapytań bardziej ogólnych: Małe warianty mają tendencję do dawania rzadkich, niekompletnych lub ewidentnie błędnych odpowiedzi.Jest to logiczne: poprzez tak duże zmniejszenie rozmiaru modelu jego pojemność reprezentacyjna i ukryta „pamięć” świata zostają brutalnie ograniczone, nie można więc oczekiwać, że będzie zachowywał się jak model najwyższej klasy.

Do czego tak naprawdę służą destylowane modele na Raspberry Pi?

Pomimo tych ograniczeń, modele destylowane i kompaktowe mają bardzo ciekawe zastosowania w urządzeniach takich jak Raspberry Pi. Nie mają one zastąpić dużych, uniwersalnych chatbotów.ale do rozwiązywania ściśle określonych zadań, w których kreatywność i encyklopedyczna wiedza nie są najważniejsze.

Jednym z obszarów, w którym radzą sobie całkiem dobrze, jest podstawowa pomoc matematyczna i przegląd koduAby wykryć proste błędy w skryptach, zaproponować małe funkcje lub zasugerować ulepszenia fragmentów kodu Pythona, model 7B lub 14B zwykle daje przydatne odpowiedzi, o ile nie jest proszony o coś wyjątkowo szczegółowego lub zawiłego.

Mogą być również bardzo przydatne Generuj i poprawiaj fragmenty kodu stosowane w automatyce domowej, automatyce lub małych projektachNa przykład model 14B może proponować automatyzację Home Assistant z pewną spójnością, podczas gdy wersja 1.5B będzie miała tendencję do wymyślania części lub oferowania czegoś, co nie jest kompilowalne lub nie ma sensu.

Tam, gdzie systematycznie zawodzą, jest pytania z zakresu wiedzy ogólnej, szczegółowe informacje faktyczne lub zadania wymagające szerokiego kontekstuCo więcej, nawet w stosunkowo dużych modelach brakuje poczucia humoru i umiejętności prowadzenia długich, naturalnych rozmów, co sprawia, że nie są one najlepszym wyborem na „wirtualnych przyjaciół”.

Ciekawym przykładem jest poproszenie ich o Utwórz złożoną witrynę internetową, na przykład stronę docelową służącą do sprzedaży kursu.Każdy model może wygenerować funkcjonalną strukturę HTML, ale im bardziej szczegółowa i mniejsza jest jej wersja, tym prostsza, brzydsza i uboższa w treść staje się generowana strona internetowa, tracąc przy tym szczegóły i niuanse.

Krótko mówiąc, małe modele zbudowane na Raspberry Pi są idealne do pomoc w ograniczonych zadaniach technicznych, automatyce domowej, małych asystentach programistycznych lub lekkiej klasyfikacji danychNie ma on jednak zastąpić najnowocześniejszej usługi w chmurze, jeśli potrzebujesz wszechstronnego asystenta ogólnego przeznaczenia.

Raspberry Pi, automatyka domowa i lekka sztuczna inteligencja

Jednym z najbardziej obiecujących zastosowań sztucznej inteligencji na Raspberry Pi jest inteligentna automatyka domowa z lekkimi modelamiPomysł polega na wykorzystaniu tablicy jako lokalnego mózgu, który interpretuje polecenia, łączy się z czujnikami i siłownikami oraz podejmuje proste decyzje bez konieczności wysyłania jakichkolwiek danych do chmury.

Na przykład można skonfigurować system, w którym Mały model języka odpowiada za rozumienie poleceń głosowych., w tym etapy wstępnego przetwarzania, takie jak Wyczyść szum mikrofonutakich jak „opuść rolety w salonie, gdy słońce świeci bezpośrednio na pokój” lub „włącz ogrzewanie tylko wtedy, gdy ktoś jest w domu i temperatura spadnie poniżej określonego progu”. Model nie musi znać postaci historycznej ani pisać wierszy: wystarczy, że przełoży prośby na konkretne działania.

Dzięki temu podejściu nawet LLM z parametrami 1.5B lub 3B może mieć sens. ponieważ jego funkcją nie jest udzielanie błyskotliwych odpowiedzi, lecz mapowanie języka naturalnego na polecenia strukturalneJeśli system zostanie specjalnie przeszkolony lub dostosowany do danej dziedziny (automatyka domowa, czujniki, procedury), wyniki mogą być zaskakująco dobre, biorąc pod uwagę jego niewielką wagę.

Tego typu rozwiązanie pozwala na tworzenie inteligentne domy, które znacznie bardziej szanują prywatnośćgdzie ani polecenia głosowe, ani wzorce użytkowania urządzenia nie opuszczają sieci lokalnej. Co więcej, niezależność od usług zewnętrznych zapobiega przerwaniu działania wszystkiego z powodu zmiany interfejsu API przez dostawcę, awarii serwera lub wyłączenia usługi.

Choć wciąż jest wiele do dopracowania i przetestowania, potencjał połączenia małe modele z platformami automatyki domowej, takimi jak Home Assistant lub własnymi systemami Potencjał tego rozwiązania na Raspberry Pi jest ogromny i wszystko wskazuje na to, że będziemy świadkami coraz większej liczby eksperymentów i prawdziwych projektów w tym zakresie.

Akceleratory AI dla Raspberry Pi: Hailo, AI HAT+ i inne moduły

Aby pokonać ograniczenia procesora Raspberry Pi, pojawiły się nowe technologie dedykowane akceleratory AI, które integrują się bezpośrednio z płytąJego celem jest przetwarzanie danych w sieciach neuronowych znacznie szybciej i wydajniej niż przy użyciu procesora CPU lub, w niektórych przypadkach, konwencjonalnego procesora graficznego GPU.

W porównaniu do procesorów ogólnego przeznaczenia, akceleratory te są zaprojektowane tak, aby: równolegle wykonywać operacje matematyczne typowe dla uczenia maszynowegoSkraca to czas wnioskowania, a także zużycie energii, co jest kluczowe w przypadku urządzeń wbudowanych lub w sytuacjach, w których nie można tolerować dużego, ciągłego wydatku energii.

Bardzo powszechnym przykładem jest użycie Karta M.2 HAT+ podłączona do Raspberry Pi 5 wraz z modułem M.2 2242, który integruje układ Hailo-8LTen typ zestawu zawiera specjalną jednostkę przetwarzania neuronowego, która przyspiesza zadania związane z wizją, wykrywaniem obiektów, a nawet niektóre modele generatywne zoptymalizowane pod kątem jego architektury.

Chip Hailo koncentruje się na do przetwarzania złożonych operacji równolegle z zachowaniem wysokiej efektywności energetycznejW porównaniu z rozwiązaniami bazującymi na procesorach CPU lub GPU oznacza to mniejszą emisję ciepła, mniejsze wymagania dotyczące chłodzenia i dłuższy czas pracy na baterii — co stanowi znaczącą zaletę w projektach przemysłowych, robotyce i rozproszonych inteligentnych czujnikach.

Dzięki tym modułom Raspberry Pi może zmienić się z prostego koordynatora w stać się naprawdę zdolnym węzłem wnioskowania, uruchamiając zaawansowane sieci neuronowe bezpośrednio na krawędzi sieci, bez przeciążania płyty i zachowując bardzo niskie opóźnienia.

AI HAT+ 2 i przejście na lokalne LLM na Raspberry Pi 5

Jednym z najbardziej imponujących startów w tym obszarze jest Raspberry Pi AI HAT+ 2, płytka rozszerzeń przeznaczona dla Raspberry Pi 5 który zawiera układ Hailo-10H. Ten koprocesor oferuje wydajność wnioskowania na poziomie około 40 TOPS, co wystarcza do lokalnej obsługi lekkich generatywnych modeli AI.

Dzięki temu sprzętowi Raspberry Pi 5 może wykonywać stosunkowo kompaktowe modele językowe z niskim opóźnieniembez przeciążania głównego procesora. Przetwarzanie jest delegowane do Hailo-10H, który obsługuje intensywne operacje, podczas gdy płyta zarządza logiką aplikacji, wprowadzaniem danych przez użytkownika i integracją z innymi systemami.

Wśród oficjalnie wymienionych kompatybilnych modeli znajdują się: DeepSeek-R1-Distill, Llama 3.2, Qwen2.5-Coder, Qwen2.5-Instruct i Qwen2Większość z nich ma około 1.500 miliarda parametrów, podczas gdy Llama 3.2 ma ich około 1.000 miliarda, a wszystkie zostały zaprojektowane tak, aby zapewnić rozsądny balans między pojemnością a zużyciem zasobów.

Publiczne testy pokazują, że modele te można wykorzystać do podstawowe zadania czatu, tłumaczenie tekstu, generowanie fragmentów kodu lub opis sceny W połączeniu z danymi wizyjnymi opóźnienia są niewielkie, a doświadczenie użytkownika jest znacznie bliższe temu, czego ludzie oczekują od nowoczesnej, interaktywnej sztucznej inteligencji.

Ważne jest jednak, aby jasno powiedzieć, że AI HAT+ 2 nie pozwala na uruchamianie lokalnie dużych modeli, takich jak ChatGPT, Claude czy większe modele Meta LLM.Systemy te mają setki miliardów lub bilionów parametrów, znacznie wykraczających poza możliwości koprocesora tego typu w Raspberry Pi 5.

Wielką zaletą AI HAT+ 2 jest to, że w cenie około 130 dolarów Umożliwia przekształcenie Raspberry Pi 5 w bardzo wydajną, małą, lokalną stację AIOferuje dostęp do repozytorium przykładów i frameworków Hailo, ukierunkowanych zarówno na przetwarzanie obrazu, jak i generatywną sztuczną inteligencję. To kluczowe narzędzie dla tych, którzy chcą wyjść poza modele czysto symboliczne i prawdziwie eksperymentować z nowoczesnymi sieciami neuronowymi na brzegu sieci.

Krajobraz, który wyłania się wokół sztucznej inteligencji na Raspberry Pi, jest całkiem potężny: wśród agentów w chmurze, lekkich modeli lokalnych, dedykowanych akceleratorów i nowych płyt, takich jak AI HAT+ 2Mała płytka stała się idealnym laboratorium do badania, jak rozproszona sztuczna inteligencja będzie wyglądać w urządzeniach codziennego użytku, pod warunkiem uwzględnienia ograniczeń mocy i przemyślanego zaprojektowania projektów.

Pisarz z pasją zajmujący się światem bajtów i technologii w ogóle. Uwielbiam dzielić się swoją wiedzą poprzez pisanie i właśnie to będę robić na tym blogu, pokazywać Ci wszystkie najciekawsze rzeczy o gadżetach, oprogramowaniu, sprzęcie, trendach technologicznych i nie tylko. Moim celem jest pomóc Ci poruszać się po cyfrowym świecie w prosty i zabawny sposób.