- Å transformere en fil til et intellektuelt datasett innebærer å vektorisere korpuset, bygge relasjonsgrafer og koble til en AI-assistent for å utforske det for ideer.

- Kvaliteten, plasseringen og den grundige evalueringen av datasettet er like avgjørende som modellarkitekturen for å oppnå pålitelig og kontekstualisert AI.

- Dataannotering, støttet av spesifikke verktøy og kvalitetskontrollprosesser, omdanner filen til et opplæringsbart råmateriale for flere oppgaver.

- Personlige filer, åpne databaser og simulerte data kombineres for å lage datasettøkosystemer som kan brukes i sektorer som helse, transport, finans eller utdanning.

Konverter en personlig fil til en levende og nyttig intellektuelt datasett Det er ikke lenger bare for store laboratorier: alle som har produsert digitalt innhold i årevis kan forvandle den historien til en navigerbar kunnskapsbase og drivstoff for kunstig intelligens-systemer. Det interessante er ikke bare å lagre alt du har skrevet i passende formatmen å få disse stykkene til å dialogere med hverandre, relatere seg til hverandre og kunne konsulteres for ideer, kontekster eller aktører, utover et enkelt søk med nøkkelord.

Det hoppet fra en statisk fil til en kuratert, kommentert og søkbart datasett Dette åpner døren for bruksområder som spenner fra en personlig assistent som er trent på dine egne tekster til konstruksjon av språklige modeller skreddersydd for en spesifikk kultur eller sektor. I denne artikkelen skal vi rolig og tydelig forklare hva det vil si å behandle en fil som et intellektuelt datasett, hvordan det er teknisk konstruert, hva det innebærer å oversette eller annotere det på riktig måte, hvilke verktøy som er involvert, og i hvilke virkelige kontekster det allerede brukes.

Fra spredt arkiv til navigerbart intellektuelt datasett

Tenk deg at du har skrevet artikler om [emne/emne] i over et tiår. teknologi, regulering, personvern eller kunstig intelligens på én enkelt plattform. Du ber om en komplett oversikt over tekstene dine (en ren tekstfil med tusenvis av dokumenter) og mottar den i løpet av minutter. På papiret er den filen verdifull: den oppsummerer fjorten år av tankeprosessen din. Men så lenge det bare forblir ustrukturert tekst, kan du gjøre lite mer enn... søk etter individuelle ord.

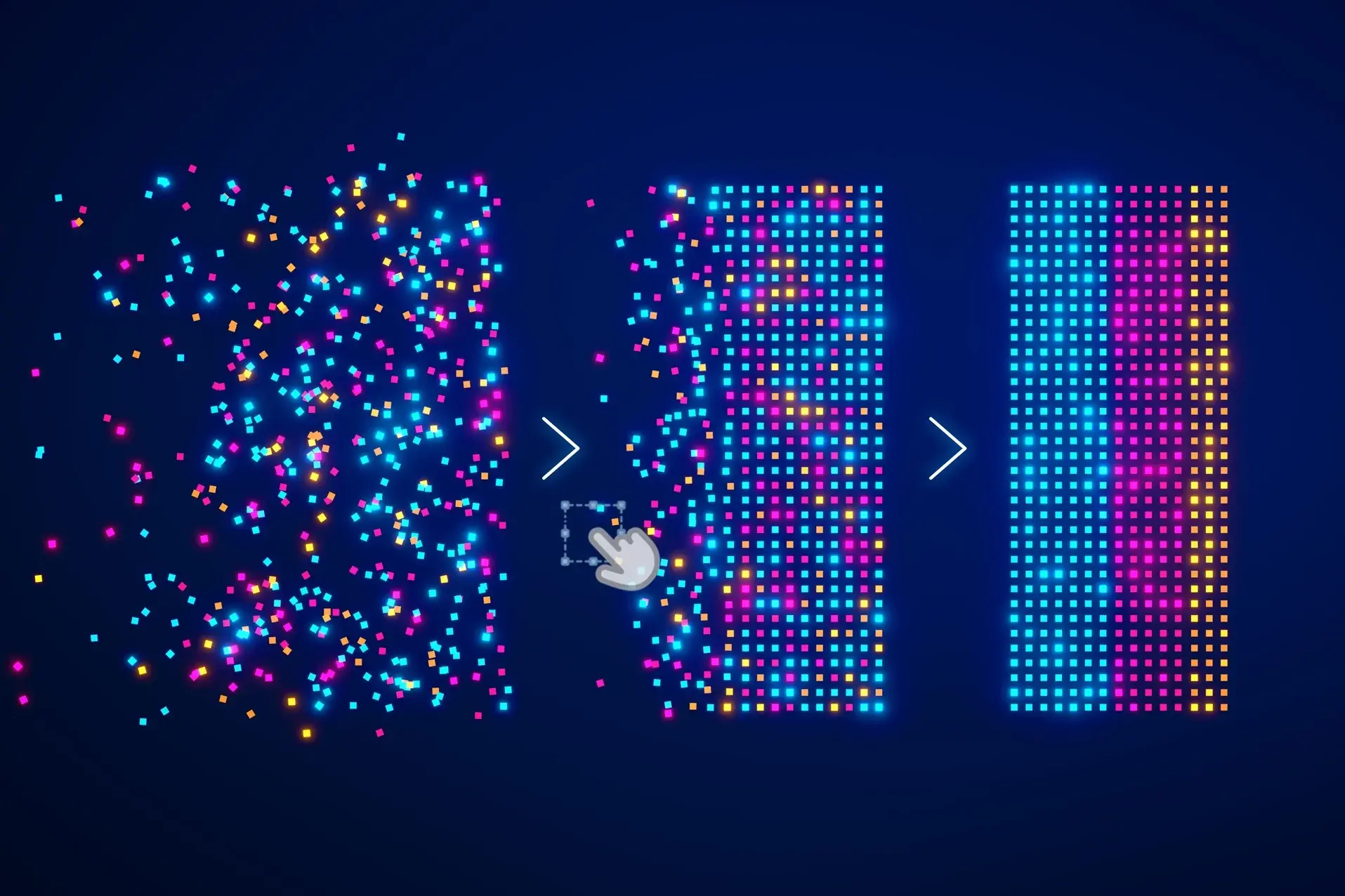

Det første konseptuelle skiftet innebærer å slutte å se på filen som en stabel med dokumenter og begynne å behandle den som en sammenhengende korpus som kan indekseres og utforskesTanken er å transformere hver artikkel til en numerisk representasjon som fanger opp betydningen, lagre disse vektorene i en spesialisert database, og bygge på dem en graf over relasjoner og en assistent som forstår det semantiske rommet godt.

I en casestudie fra den virkelige verden som involverte 4.209 artikler skrevet på engelsk over fjorten år, brukte forfatteren en modell av flerspråklige innebygginger (paraphrase-multilingual-mpnet-base-v2, fra sentence-transformers) for å konvertere hver tekst til en 768-dimensjonal vektor. Disse vektorene ble lagret i ChromaDB, en vektordatabase med åpen kildekode. Hele prosessen, som kjørte på en standard server uten GPU, ble fullført på omtrent fem minutter: den flate filen ble transformert til et kontinuerlig rom av ideer.

I praksis betyr dette at du ikke lenger søker «etter nøkkelord», men av konsepter, spørsmål eller tekstfragmenterDu kan stille spørsmål som «Når begynte jeg å skrive om teknologimonopoler?» eller «Hvilke artikler er konseptuelt nær dette argumentet?», og systemet svarer ved å finne de nærmeste vektorene i det semantiske rommet, selv om de ikke deler samme vokabular. Det er en veldig direkte måte å utvide hukommelsen din om ditt eget arbeid.

En graf ble også konstruert oppå dette vektorlaget ved hjelp av NetworkX, hvor hver node representerer en artikkel og kantene forbinder tekster som deler tematiske tagger eller overskrider en viss terskel for semantisk likhet. Visualisert i verktøy som Gephi, er resultatet en kart over din intellektuelle produksjon organisert i klyngerRegulering, plattformer, personvern, kunstig intelligens, elektrisk mobilitet ... og også uventede forbindelser mellom tekster atskilt med år, men svært like i ideer.

En personlig assistent som en inngangsport til arkivet

Det andre viktige elementet i denne tilnærmingen er å ha en assistent for kunstig intelligens forankret til datasettet ditt som kan fungere som en kontinuerlig samarbeidspartner, ikke bare en enkel chatbot i en nettleserfane. I det forrige eksemplet het assistenten Bautista: en agentisk instans basert på antropiske modeller (Claude Sonnet 4.6), men som er i stand til å jobbe med andre modeller avhengig av API-et som brukes.

Bautista ligger på forfatterens egen server og er orkestrert ved hjelp av en OpenClaw-lignende infrastrukturplattform, som administrerer vedvarende minne mellom økter, kommunikasjonskanaler (som Telegram), planlagte oppgaver og tilgang til verktøy som filsystemet og skriptutførelse. Takket være dette kan assistenten opprettholder kontinuitet over tidDen husker tidligere prosjekter, bevarer filer, automatiserer prosesser og kan handle autonomt når den får beskjed om det.

Forskjellen sammenlignet med å åpne en generisk mal i nettleseren er at vi her ikke snakker om bare en annen chat, men noe mer som en innebygd samarbeidspartner i infrastrukturen din, spesialisert i ditt eget korpus og i stand til å fungere som mellomledd mellom den vektoriserte filen og dine daglige behov: finne tekster, oppdage redundanser, hente sitater, kjøre spesifikke analyser eller starte vedlikeholdsskript.

Videre ble systemet designet for å holde arkivet levende uten manuell inngripen. Hver gang forfatteren publiserer en ny artikkel på Medium og deler lenken for full tilgang på Bluesky, spør en planlagt prosess Blueskys offentlige API daglig, oppdager den nye oppføringen, laster ned teksten, genererer innebyggingskoden og legger den til i ChromaDB. En automatisert pipeline sørger for at datasettet oppdaterer seg selv., takket være oppgaver fra filindekseringunngå det klassiske problemet med at kunnskapsbaser blir foreldet fordi det er et ork å oppdatere dem.

I en senere fase ble nye analyselag lagt til, slik som gjenkjenning av navngitte enheter (personer, selskaper, teknologier, land, institusjoner) på tvers av hele korpuset, med sikte på å studere tidsmessig utvikling av omtaler og samforekomstnettverkTakket være dette er det mulig å se når en aktør som OpenAI dukker opp i tekstene, når Google+ forsvinner, eller hvordan ulike agenter forholder seg til hverandre over tid, noe som bringer systemet nærmere storskala diskursanalyse enn et enkelt personlig arkiv.

Datasett, modell og oppførsel: filen som råmateriale for AI

I sammenheng med kunstig intelligens, en Et datasett er mye mer enn en samling av dataDette er treningsmaterialet som former modellens oppførsel. I naturlig språkbehandling (NLP) tar dette datasettet vanligvis form av tekster, dialoger, instruksjoner eller merknader som lar modeller lære å oversette, oppsummere, snakke om eller klassifisere følelser, blant andre oppgaver.

I årevis ble det lagt nesten utelukkende vekt på modellens arkitektur (antall parametere, lagtype, beregningskapasitet), men nyere erfaring har vist at kvaliteten, mangfoldet og egnetheten til treningsdataene De veier like mye som, eller til og med mer enn, modelldesignet. Som studier som de av Bender et al. eller Paullada et al. påpeker, er modeller ikke bedre enn dataene de forsynes med: hvis datasettet er partisk, ufullstendig eller ikke representativt, vil AI-en reprodusere de samme feilene.

Denne endringen i perspektiv har drevet en tydelig bevegelse mot kvalitet fremfor kvantitetDet handler ikke bare om å samle enorme tekstmengder, men om å sikre at disse dataene er i samsvar med språket, den regionale variasjonen og den kulturelle konteksten der AI-en skal distribueres (Blasi et al., Kreutzer et al.). Dette er spesielt relevant hvis vi tenker på et arkiv som et intellektuelt datasett: en forfatters personlige korpus kan være veldig rikt, men hvis det deretter skal brukes til modeller som opererer på andre språk eller markeder, blir kuratering og tilpasning avgjørende.

Datasettet er dessuten ikke bare nyttig for trening, men også for evaluere modellens ytelseHvis en modell evalueres ved hjelp av data den allerede har sett under trening (datakontaminering), oppnås misvisende beregninger som maskerer dens sanne begrensninger, slik det er analysert av Dong et al. og Samuel et al. Når man overfører en personlig fil til en AI-kontekst, er det derfor avgjørende å skille hvilke deler som brukes til trening, hvilke til validering og hvilke til testing, samt å designe rike og utfordrende evalueringssett, i stedet for trivielle tester som alle modeller består.

Oversettelse og lokalisering av datasett: mye mer enn bare å overføre tekst fra ett språk til et annet

Når du vil gjenbruke en fil, som for eksempel Intellektuelle datasett på flere språk eller markederEn spesifikk utfordring oppstår da: oversettelsen og lokaliseringen av korpuset. Ved første øyekast kan det virke som bare et annet oversettelsesprosjekt, men et AI-datasett består ofte av isolerte fragmenter, løse dialoger, korte instruksjoner eller strukturerte data uten en klar narrativ kontekst, noe som fullstendig endrer spillereglene.

I mange datasett finner vi svært begrenset kontekstDette er fraser uten informasjon om hvem som snakker, situasjonen eller deres intensjon. Oversetteren må utlede pragmatiske funksjoner (en kommando, en tvil, en fornærmelse, ironi) slik at modellen kan lære seg atferden på målspråket på riktig måte. I tillegg finnes det elementer som ikke må berøres, for eksempel kodebiter, variabler, plassholdere eller tekniske etiketter, der en naiv oversettelse kan ødelegge datasettet.

Massekonsistens spiller også inn: tilsynelatende små avgjørelser, som å velge mellom «tú» eller «usted», håndtering av inkluderende kjønn, eller behandlingen av visse anglisismer, De multipliseres med millioner av eksempler.En inkonsekvens som kanskje går ubemerket hen i en bok, blir her til støy som modellen internaliserer. Og i motsetning til redaksjonell oversettelse er det ofte best å beholde grammatiske feil eller dagligdagse uttrykk slik de fremstår, fordi målet ikke er å «polere» teksten, men å lære AI-en hvordan folk faktisk uttrykker seg.

Derfor er det mer passende å snakke om, i stedet for å oversette. finn datasettDette innebærer å tilpasse kulturelle referanser, navn på institusjoner, merkevarer, datoformater, valutaer og måleenheter, og justere registeret til målmarkedets sosiale normer. I store språkmodeller er det denne lokaliseringen som skiller en AI som bare «snakker spansk» fra en som forstår kulturelle nyanser, forventninger til høflighet og lokale referanser.

Selskaper med lang historie innen programvare- og innholdslokalisering, som imaxin, har utviklet seg mot oversettelse og spesifikk kuratering av datasettVed å kombinere menneskelig ekspertise, finjusterte stilguider, kuraterte ordlister og dataassisterte og maskinbaserte oversettelsesverktøy, ligner tilnærmingen deres mer på en datakvalitetskontrollprosess enn tradisjonell oversettelse: presis definisjon av språklige og tekniske kriterier, håndtering av bevisste feil, bruk av automatisert kvalitetssikring og statistisk utvalg for å overvåke konsistens.

Annotert datasett: gir struktur og mening til dataene

For at en fil skal bli en Et virkelig nyttig intellektuelt datasett for overvåkede modellerDet er ikke nok å bare samle tekster: de må annoteres. Et annotert datasett er et datasett der hvert element (bilde, lydfragment, setning, tabell) har fått metadata som beskriver innholdet eller funksjonen: tagger, kategorier, enheter, relasjoner, transkripsjoner, avgrensningsbokser osv.

I datasyn kan for eksempel annoteringer inkludere globale klassifiseringsetiketter, avgrensningsbokser rundt objekter, segmenteringsmasker som tilordner en kategori til hver piksel, annoteringer av nøkkelpunkter (menneskelige ledd, ansiktspunkter) eller baner langs en video. I tekst snakker vi om oppføringer av navngitte enheter (personer, organisasjoner, steder), dokumentklassifisering, syntaktisk analyse, forhold mellom enheter eller sentimentkoder.

Målet med alt dette arbeidet er at modellene skal ha klare eksempler på hva de bør gjenkjenne eller forutsiEt datasett med kommenterte bilder av katter, biler og fotgjengere muliggjør trening av modeller som oppdager og klassifiserer disse objektene; et datasett med samtaler med intensjons- og følelsestagger muliggjør trening av chatboter og sentimentanalysesystemer; et dokumentarkorpus med markerte enheter og eksplisitte relasjoner legger grunnlaget for kunnskapsutvinningssystemer.

Annotering er ikke begrenset til tekst eller bilder: i lyd inkluderer oppgaver transkripsjon, merking av lydhendelser (applaus, latter, skudd), segmentering etter taler og tidsstempling av nøkkelord. Og i multimodale data (for eksempel video med lyd og undertekster) jobbes det med å samkjøre modaliteter og annotere interaksjoner sammen (ansiktsuttrykk pluss tonefall pluss tekstinnhold).

Innen strukturerte og tabellariske data betyr annotering også Forklar betydningen av kolonner og verdierDette inkluderer å koble likeverdige oppføringer på tvers av databaser eller merke relevante attributter for prediksjonsoppgaver. Hver prosjekttype vil velge ett eller annet sett med annoteringer, og ofte kombineres flere for å dekke komplekse brukstilfeller.

Verktøy og prosesser for å kommentere en fil som et datasett

Registrering av data i stor skala krever spesifikke verktøy og gjennomtenkte arbeidsflyterDet er ikke det samme å manuelt merke noen dusin bilder som det er å administrere hundretusenvis av eksempler i flere formater med team spredt over flere tidssoner.

Innen datasyn brukes åpen kildekode-løsninger som LabelImg (for avgrensningsbokser), CVAT (for kompleks bilde- og videoannotering med samarbeidsfunksjoner), eller kommersielle plattformer som Labelbox eller SuperAnnotate, som inkluderer kvalitetsanalyse, prosjektledelse og automatisering. For tekst forenkler verktøy som Prodigy, LightTag, BRAT eller Datasaur annotering av enheter, klassifiseringer, syntaktiske avhengigheter og relasjoner, med detaljert sporing av annotatorer og konflikter.

Innen lyd tillater programvare som Label Studio, Praat eller Sonix presis segmentering, transkripsjon og merking av lyder. For multimodale data tilbyr lette prosjekter som VGG Image Annotator (VIA) eller applikasjoner som RectLabel et allsidig grunnlag for å synkronisere annoteringer på tvers av datatyper. Og for prosjekter som krever høyt volum og hastighet, plattformer som automatisering og massivt samarbeid som for eksempel Amazon SageMaker Ground Truth, Scale AI, DataLoop eller samarbeidsløsninger som Digma eller Hive Data.

Å velge et verktøy er ikke bare et spørsmål om personlig preferanse: du må vurdere datatypen, budsjettet, teamstørrelsen, behovet for samarbeid i sanntid og størrelsen på datasettet. Nesten alle avanserte plattformer inkluderer funksjoner for å validere grunnleggende regler, håndtere konflikter, måle produktivitet og kvalitet, og kombinere menneskelig annotering med automatiserte forslag generert av eksisterende modeller.

Utover selve verktøyet, bestemmes kvaliteten av prosessen. veldig tydelige og oppdaterte annotasjonsguiderDette innebærer å trene opp kommentatorer (spesielt innen sensitive felt som medisin), organisere kryssvurderinger, definere kvalitetsmålinger (samsvar mellom kommentatorer, nøyaktighet, gjenkjenning) og bruke ekspertvaliderte "gullstandard"-data for å kalibrere teamet. Å kommentere en fil som et intellektuelt datasett er ikke en sprint, men en kontinuerlig, iterativ syklus.

Mange prosjekter velger en hybrid tilnærming: enkle eller repeterende oppgaver (f.eks. foreløpig objektdeteksjon eller forhåndsklassifisering av tekst) automatiseres, og menneskelig arbeid er reservert for tvetydige, komplekse eller alvorlige sakerDette reduserer kostnadene uten å ofre kvaliteten, og lar scorere fokusere der de tilfører mest verdi.

Anvendelser av kommenterte og intellektuelle datasett i den virkelige verden

Å behandle en fil som et intellektuelt datasett er ikke en teoretisk øvelse: det har svært konkrete anvendelser i flere sektorer der annotering og kuratering er nøkkelen til å distribuere pålitelig AI. Innen datasyn, for eksempel, tillater annoterte bilde- og videosett utvikling av ansiktsgjenkjenningssystemer, anomalideteksjon i røntgenbilder eller MR-bilder, automatiserte fabrikkinspeksjoner eller autonome kjøretøy som De identifiserer fotgjengere, skilt og hindringer no tiempo ekte.

I naturlig språkbehandling muliggjør godt lokaliserte og kommenterte datasett oppgaver som sentimentanalyse på sosiale medier, klassifisering av spørringer i kundeservice, enhetsuttrekk i juridiske dokumenter, maskinoversettelse eller opplæring av chatboter som forstår emosjonelle nyanser og kulturelle konteksterEt personlig arkiv med artikler kan bli grunnlaget for en spesialisert assistent som, før publisering av noe nytt, gjennomgår det som allerede er sagt, oppdager gjentakelser eller identifiserer endringer i holdning gjennom årene.

Helse og bioteknologi er i økende grad avhengig av svært annoterte datasett: medisinske bilder med bekreftede diagnoser, strukturerte kliniske journaler og genomsekvenser merket med relevante mutasjoner. Innen bilindustri og transport er data avgjørende for autonom kjøring, intelligent ruteplanlegging og trafikkstyring. Innen handel og bankvirksomhet brukes det til Produktanbefalinger, svindeldeteksjon og risikoanalyse.

Andre felt som presisjonslandbruk, miljø, sikkerhet og forsvar, videospill, virtuell virkelighet, utdanning og vitenskapelig forskning bruker kommenterte datasett til å overvåke avlinger, analysere satellittbilder, skape engasjerende opplevelser, tilpasse læring eller akselerere oppdagelser innen biologi eller astrofysikk. Logikken er lik i alle disse feltene: Den bedre strukturerte og dokumentert (for eksempel med README-filer) Jo bedre datasettet er, desto bedre vil modellene som designes på det være..

Hvis vi ser på filen som et intellektuelt datasett i en personlig nøkkel, ligger verdien i makt konsulter alt du vet og har skrevet på fartenÅ forstå hvordan ideene dine har utviklet seg, oppdage tematiske hull, koble sammen tekster fra fjerne perioder og utnytte det utvidede minnet i andre sammenhenger, som undervisning, forskning eller forretningsstrategi. Alt dette uten å delegere skrivingen til maskinen, men heller bruke AI som et støtteverktøy for å verifisere data, søke etter referanser eller teste argumenter.

Hvor finner man datasett og hvordan opprettelsen av dem automatiseres

Ikke alle datasett stammer fra personlige filer: mange kommer fra åpne arkiver og offentlige kilder Disse ressursene er nyttige for opplæring og evaluering av modeller, eller for forskningsprosjekter, datajournalistikk og strategisk analyse. Internett tilbyr allerede et vell av ressurser som kan utnyttes, alltid med behørige juridiske og etiske hensyn.

Det sosiale nettverket X (tidligere Twitter) tilbyr for eksempel API-er som lar brukere samle inn tweets filtrert etter emneknagger og andre kriterier. Disse dataene kan deretter struktureres i tabeller og visualiseres med verktøy som Tableau. Google Dataset Search tilbyr en spesialisert søkemotor for offentlige datasett, hvor brukere kan finne alt fra bedriftsdatabaser til bransjestatistikk. Blogger som FiveThirtyEight publiserer datasettene sine om politikk, sport og samfunn, slik at alle kan replikere eller utvide analysene deres.

Parallelt blir de brukt mer og mer simulerte miljøer for automatisk å generere kommenterte dataSpesielt innen felt som autonome kjøretøy, hvor det ville være tregt, dyrt og farlig å gjenskape alle virkelighetens forhold i den fysiske verden. Simulatorer tillater produksjon av bilder og videoer med perfekte annoteringer (objekters posisjoner, værforhold, baner) og utforskning av ekstreme scenarier som er vanskelige å fange opp i virkelige data.

Fremtiden peker mot en kombinasjon av kuraterte data fra den virkelige verden, personlige arkiver behandlet som intellektuelle korpus, og syntetiske data generert i simulering, alt koordinert med veiledede, semi-veiledede, uveiledede og selvveiledede læringsteknikker. Annotering vil forbli et nøkkelelement, men i økende grad assistert av modeller som De foreslår etiketter, oppdager inkonsekvenser og måler skjevheter.å overlate de finere avgjørelsene til folket.

I denne sammenhengen blir den etiske og regulatoriske dimensjonen viktig: håndtering av personfiler som datasett krever respekt for personvern, opphavsrett og bruksforventninger, mens crowdsourcing- eller massesamarbeidsplattformer må sikre rettferdige vilkår for annotatorer og åpenhet om hvilke modeller som trenes med dataene de genererer.

Når hele denne kjeden håndteres nøye – fra å trekke ut en personlig fil til vektorisering, grafisk fremstilling, lokalisering, annotering, automatisering av oppdateringer og tilkobling av den til AI-assistenter – får du noe som svært få forfattere, selskaper eller organisasjoner har i dag: en dypt, konsistent og levende intellektuelt datasetti stand til å drive kunstig intelligens-systemer som virkelig er i samsvar med stemmen, konteksten og målene til de som driver dem, og til å tjene som utvidet hukommelse i en stadig mer informasjonsmettet verden.

Lidenskapelig forfatter om verden av bytes og teknologi generelt. Jeg elsker å dele kunnskapen min gjennom å skrive, og det er det jeg skal gjøre i denne bloggen, vise deg alle de mest interessante tingene om dingser, programvare, maskinvare, teknologiske trender og mer. Målet mitt er å hjelpe deg med å navigere i den digitale verden på en enkel og underholdende måte.