- Mengubah fail menjadi set data intelektual melibatkan pengvektoran korpus, membina graf hubungan dan menghubungkan pembantu AI untuk menerokanya untuk mendapatkan idea.

- Kualiti, lokasi dan penilaian set data yang teliti adalah sama pentingnya dengan seni bina model untuk mendapatkan AI yang andal dan kontekstual.

- Anotasi data, yang disokong oleh alat khusus dan proses kawalan kualiti, mengubah fail menjadi bahan mentah yang boleh dilatih untuk pelbagai tugas.

- Fail peribadi, repositori terbuka dan data simulasi digabungkan untuk mewujudkan ekosistem set data yang boleh digunakan untuk sektor seperti kesihatan, pengangkutan, kewangan atau pendidikan.

Tukar fail peribadi kepada set data intelektual yang hidup dan berguna Ia bukan lagi hanya untuk makmal besar: sesiapa sahaja yang telah menghasilkan kandungan digital selama bertahun-tahun boleh mengubah sejarah itu menjadi pangkalan pengetahuan yang boleh dinavigasi dan bahan api untuk sistem kecerdasan buatan. Perkara yang menarik bukan sekadar menyimpan semua yang telah anda tulis dalam format yang sesuaitetapi untuk menjadikan karya-karya tersebut berdialog antara satu sama lain, berkaitan antara satu sama lain dan boleh dirujuk untuk idea, konteks atau pelakon, melangkaui carian mudah mengikut kata kunci.

Lompatan itu dari fail statik ke set data yang dikurasi, dianotasi dan boleh dicari Ini membuka peluang kepada pelbagai kegunaan, daripada pembantu peribadi yang terlatih tentang teks anda sendiri hinggalah kepada pembinaan model linguistik yang disesuaikan dengan budaya atau sektor tertentu. Dalam artikel ini, kami akan menerangkan dengan tenang dan jelas apa maksudnya untuk melayan fail sebagai set data intelektual, bagaimana ia dibina secara teknikal, apa yang diperlukan untuk menterjemah atau memberi anotasi dengan betul, alatan yang terlibat dan dalam konteks dunia sebenar yang telah pun digunakan.

Daripada arkib berselerak kepada set data intelektual yang boleh dilayari

Bayangkan anda telah menulis artikel tentang [topik/topik] selama lebih sedekad teknologi, peraturan, privasi atau kecerdasan buatan pada satu platform. Anda meminta dump lengkap teks anda (fail teks biasa dengan beribu-ribu dokumen) dan menerimanya dalam beberapa minit. Di atas kertas, fail itu berharga: ia merangkumi empat belas tahun proses pemikiran anda. Tetapi selagi ia kekal sebagai teks tidak berstruktur, anda hanya boleh melakukan sedikit sahaja daripada... cari mengikut perkataan individu.

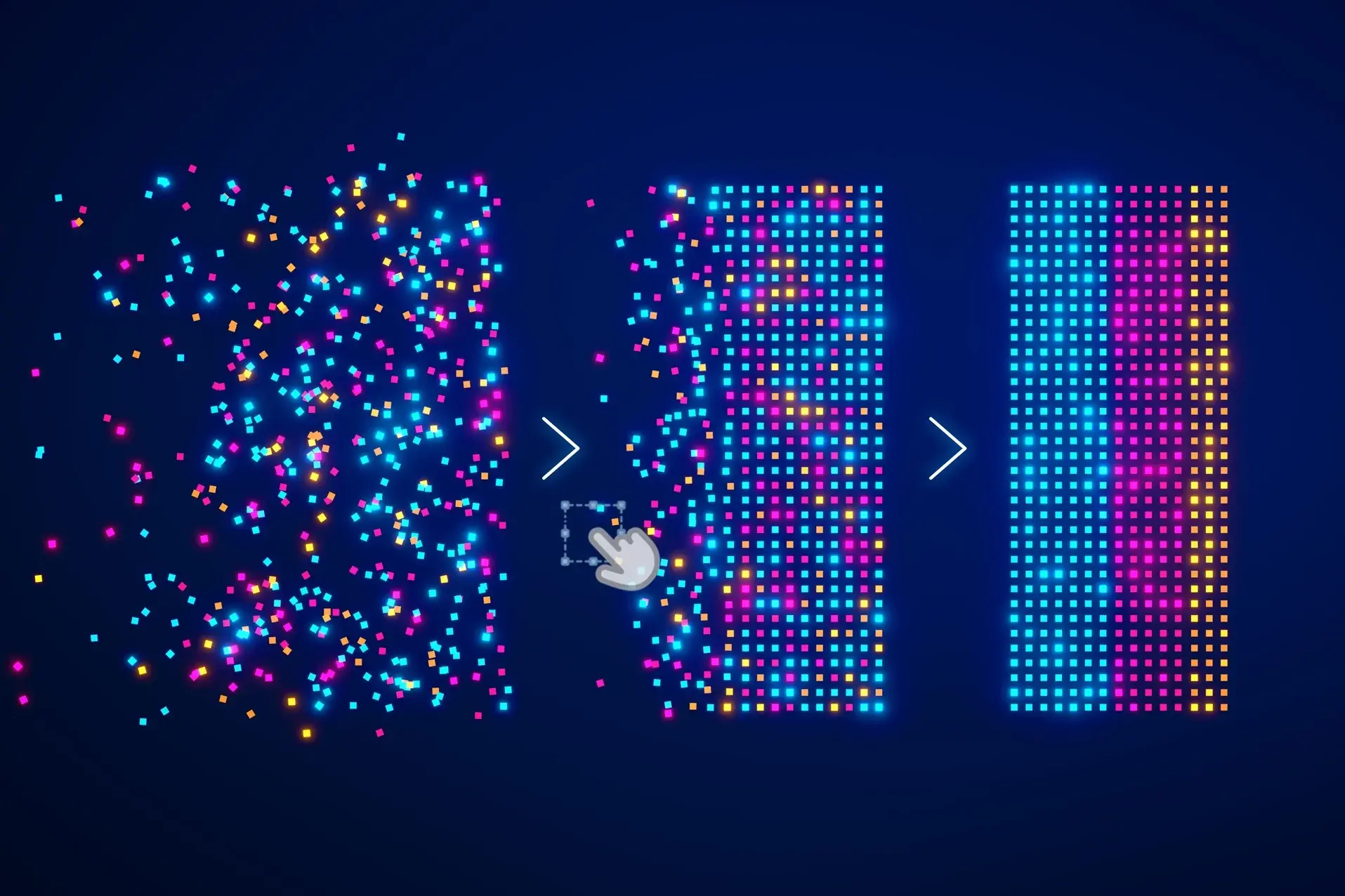

Peralihan konseptual pertama melibatkan berhenti melihat fail itu sebagai timbunan dokumen dan mula melayannya sebagai korpus yang koheren yang boleh diindeks dan diterokaiIdeanya adalah untuk mengubah setiap artikel menjadi perwakilan berangka yang menangkap maknanya, menyimpan vektor tersebut dalam pangkalan data khusus, dan membina graf hubungan dan pembantu yang memahami ruang semantik tersebut secara mendalam.

Dalam kajian kes dunia sebenar yang melibatkan 4.209 artikel yang ditulis dalam Bahasa Inggeris selama empat belas tahun, penulis menggunakan model penyematan berbilang bahasa (parafrasa-berbilang-bahasa-mpnet-asas-v2, daripada pengubah-ayat-pengubah) untuk menukar setiap teks kepada vektor 768 dimensi. Vektor-vektor ini disimpan dalam ChromaDB, pangkalan data vektor sumber terbuka. Keseluruhan proses, yang dijalankan pada pelayan standard tanpa GPU, telah siap dalam masa kira-kira lima minit: fail rata telah diubah menjadi ruang idea yang berterusan.

Dalam praktiknya, ini bermakna anda tidak lagi mencari "mengikut kata kunci" tetapi mengikut konsep, soalan atau cebisan teksAnda boleh bertanya soalan seperti "Bilakah saya mula menulis tentang monopoli teknologi?" atau "Artikel manakah yang secara konseptualnya hampir dengan hujah ini?" dan sistem akan bertindak balas dengan mencari vektor terdekat dalam ruang semantik tersebut, walaupun ia tidak berkongsi perbendaharaan kata yang sama. Ia merupakan cara yang sangat langsung untuk meluaskan ingatan anda tentang karya anda sendiri.

Graf juga dibina di atas lapisan vektor ini menggunakan NetworkX, di mana setiap nod mewakili artikel dan tepinya menghubungkan teks yang berkongsi tag tematik atau melebihi ambang persamaan semantik tertentu. Divisualisasikan dalam alat seperti Gephi, hasilnya ialah peta output intelektual anda yang disusun ke dalam kelompokPeraturan, platform, privasi, kecerdasan buatan, mobiliti elektrik… dan juga hubungan yang tidak dijangka antara teks yang dipisahkan oleh tahun tetapi ideanya sangat hampir.

Pembantu peribadi ejen sebagai pintu masuk ke arkib

Elemen penting lain dalam pendekatan ini ialah mempunyai pembantu kecerdasan buatan yang disauhkan pada set data anda yang boleh beroperasi sebagai kolaborator berterusan, bukan sekadar chatbot mudah dalam tab pelayar. Dalam contoh sebelumnya, pembantu itu dinamakan Bautista: contoh agentik berdasarkan model Anthropic (Claude Sonnet 4.6) tetapi mampu berfungsi dengan model lain bergantung pada API yang digunakan.

Bautista berada di pelayan pengarang sendiri dan diuruskan menggunakan platform infrastruktur seperti OpenClaw, yang mengurus memori berterusan antara sesi, saluran komunikasi (seperti Telegram), tugasan berjadual dan akses kepada alat seperti sistem fail dan pelaksanaan skrip. Disebabkan ini, pembantu mengekalkan kesinambungan dari semasa ke semasaIa mengingati projek sebelumnya, menyimpan fail, mengautomasikan proses dan boleh bertindak secara autonomi apabila diarahkan.

Perbezaannya berbanding membuka templat generik dalam pelayar ialah di sini kita bukan sekadar bercakap tentang sembang lain, tetapi sesuatu yang lebih seperti kolaborator terbenam dalam infrastruktur anda, khusus dalam korpus anda sendiri dan mampu bertindak sebagai perantara antara fail vektor tersebut dan keperluan harian anda: mencari teks, mengesan redundansi, mendapatkan petikan, menjalankan analisis khusus atau melancarkan skrip penyelenggaraan.

Tambahan pula, sistem ini direka bentuk untuk memastikan arkib terus hidup tanpa campur tangan manual. Setiap kali penulis menerbitkan artikel baharu di Medium dan berkongsi pautan akses penuh di Bluesky, proses berjadual akan membuat pertanyaan pada API awam Bluesky setiap hari, mengesan entri baharu, memuat turun teks, menjana kod benamnya dan menambahkannya ke ChromaDB. Saluran paip automatik memastikan set data dikemas kini dengan sendirinya., terima kasih kepada tugas-tugas pengindeksan failmengelakkan masalah klasik pangkalan pengetahuan menjadi usang kerana mengemas kininya adalah satu tugas yang berat.

Dalam fasa kemudian, lapisan analisis baharu telah ditambah, seperti pengecaman entiti yang dinamakan (orang, syarikat, teknologi, negara, institusi) merentasi keseluruhan korpus, dengan tujuan untuk mengkaji evolusi temporal sebutan dan rangkaian kejadian bersamaDisebabkan ini, adalah mungkin untuk melihat bila pelakon seperti OpenAI muncul dalam teks, bila Google+ hilang, atau bagaimana ejen yang berbeza berhubung antara satu sama lain dari semasa ke semasa, menjadikan sistem lebih dekat kepada analisis wacana berskala besar berbanding arkib peribadi yang mudah.

Set data, model dan tingkah laku: fail sebagai bahan mentah untuk AI

Dalam konteks kecerdasan buatan, Set data adalah lebih daripada sekadar koleksi dataIni adalah bahan latihan yang membentuk tingkah laku model. Dalam pemprosesan bahasa semula jadi (NLP), set data ini biasanya berbentuk teks, dialog, arahan atau anotasi yang membolehkan model belajar menterjemah, meringkaskan, berbual atau mengklasifikasikan emosi, antara tugasan lain.

Selama bertahun-tahun, penekanan diberikan hampir secara eksklusif pada seni bina model (bilangan parameter, jenis lapisan, kapasiti pengkomputeran), tetapi pengalaman baru-baru ini menunjukkan bahawa kualiti, kepelbagaian dan kesesuaian data latihan Beratnya sama seperti, atau lebih daripada, reka bentuk model. Seperti yang ditunjukkan oleh kajian oleh Bender et al. atau Paullada et al., model tidak lebih baik daripada data yang memberi mereka maklumat: jika set data berat sebelah, tidak lengkap atau tidak mewakili, AI akan menghasilkan semula kelemahan yang sama.

Perubahan perspektif ini telah mendorong satu gerakan yang jelas ke arah kualiti berbanding kuantitiIa bukan sekadar mengumpul teks dalam jumlah yang besar, tetapi juga memastikan data ini sejajar dengan bahasa, kepelbagaian serantau dan konteks budaya di mana AI akan digunakan (Blasi et al., Kreutzer et al.). Ini amat relevan jika kita menganggap arkib sebagai set data intelektual: korpus peribadi pengarang boleh menjadi sangat kaya, tetapi jika ia kemudiannya digunakan untuk model yang beroperasi dalam bahasa atau pasaran lain, kurasi dan penyesuaian menjadi kritikal.

Tambahan pula, set data ini bukan sahaja berguna untuk latihan, tetapi juga untuk menilai prestasi modelJika model dinilai menggunakan data yang telah dilihat semasa latihan (pencemaran data), metrik yang mengelirukan diperoleh yang menutupi batasan sebenarnya, seperti yang dianalisis oleh Dong et al. dan Samuel et al. Oleh itu, apabila memindahkan fail peribadi ke konteks AI, adalah penting untuk membezakan bahagian mana yang digunakan untuk latihan, yang mana untuk pengesahan, dan yang mana untuk pengujian, serta untuk mereka bentuk set penilaian yang kaya dan mencabar, bukannya ujian remeh yang lulus semua model.

Menterjemah dan menyetempatkan set data: lebih daripada sekadar memindahkan teks dari satu bahasa ke bahasa yang lain

Apabila anda ingin menggunakan semula fail seperti Set data intelektual dalam beberapa bahasa atau pasaranSatu cabaran khusus kemudiannya timbul: terjemahan dan penyetempatan korpus. Pada pandangan pertama, ia mungkin kelihatan seperti satu lagi projek terjemahan, tetapi set data AI selalunya terdiri daripada serpihan terpencil, dialog longgar, arahan pendek atau data berstruktur tanpa konteks naratif yang jelas, yang mengubah sepenuhnya peraturan permainan.

Dalam banyak set data yang kita dapati konteks yang sangat terhadIni adalah frasa tanpa maklumat tentang siapa yang bercakap, situasi, atau niat mereka. Penterjemah perlu membuat kesimpulan tentang fungsi pragmatik (arahan, keraguan, penghinaan, ironi) supaya model dapat mempelajari tingkah laku dalam bahasa sasaran dengan betul. Di samping itu, terdapat elemen yang tidak boleh disentuh, seperti coretan kod, pembolehubah, ruang letak, atau label teknikal, di mana terjemahan naif boleh memecahkan set data.

Konsistensi massa juga memainkan peranan: keputusan yang nampaknya kecil, seperti memilih antara "tú" atau "usted," mengendalikan jantina inklusif, atau layanan terhadap Anglicisme tertentu, Ia didarabkan dengan berjuta-juta contoh.Ketidakkonsistenan yang mungkin tidak disedari dalam sesebuah buku menjadi hingar-bingar yang diinternalisasikan oleh model tersebut. Dan, tidak seperti dalam terjemahan editorial, selalunya lebih baik untuk mengekalkan kesalahan tatabahasa atau kolokialisme seperti yang kelihatan, kerana matlamatnya bukanlah untuk "menggilap" teks, tetapi untuk mengajar AI bagaimana orang ramai sebenarnya meluahkan diri mereka.

Oleh itu, daripada menterjemah, adalah lebih sesuai untuk membincangkan tentang cari set dataIni melibatkan penyesuaian rujukan budaya, nama institusi, jenama, format tarikh, mata wang dan unit ukuran, serta melaraskan daftar tersebut kepada norma sosial pasaran sasaran. Dalam model bahasa yang besar, penyetempatan inilah yang membezakan AI yang hanya "bercakap bahasa Sepanyol" daripada AI yang memahami nuansa budaya, jangkaan kesopanan dan rujukan tempatan.

Syarikat-syarikat yang mempunyai sejarah panjang dalam penyetempatan perisian dan kandungan, seperti imaxin, telah berkembang ke arah terjemahan dan kurasi khusus set dataMenggabungkan kepakaran manusia, panduan gaya yang ditala dengan teliti, glosari yang dikurasi dan alat bantuan komputer serta terjemahan mesin, pendekatan mereka menyerupai proses kawalan kualiti data lebih daripada terjemahan tradisional: definisi kriteria linguistik dan teknikal yang tepat, pengurusan ralat yang disengajakan, penggunaan QA automatik dan persampelan statistik untuk memantau konsistensi.

Set data beranotasi: memberikan struktur dan makna kepada data

Untuk fail menjadi Set data intelektual yang benar-benar berguna untuk model yang diseliaTidak mencukupi untuk sekadar mengumpul teks: ia mesti dianotasi. Set data beranotasi ialah set data di mana setiap elemen (imej, serpihan audio, ayat, jadual) telah diberikan metadata yang menerangkan kandungan atau fungsinya: tag, kategori, entiti, perhubungan, transkrip, kotak sempadan, dsb.

Dalam visi komputer, sebagai contoh, anotasi boleh merangkumi label pengelasan global, kotak sempadan di sekeliling objek, topeng segmentasi yang memberikan kategori kepada setiap piksel, anotasi titik utama (sendi manusia, titik muka) atau trajektori di sepanjang video. Dalam teks, kita membincangkan tentang entri entiti yang dinamakan (orang, organisasi, tempat), pengelasan dokumen, analisis sintaksis, hubungan antara entiti atau tag sentimen.

Matlamat semua kerja ini adalah untuk model-model tersebut mempunyai contoh yang jelas tentang apa yang mereka harus kenal pasti atau ramalkanSet data imej beranotasi dengan kucing, kereta dan pejalan kaki membolehkan model latihan yang mengesan dan mengklasifikasikan objek ini; set data perbualan dengan tag niat dan emosi membolehkan latihan chatbot dan sistem analisis sentimen; korpus dokumentari dengan entiti yang ditanda dan hubungan eksplisit meletakkan asas untuk sistem pengekstrakan pengetahuan.

Anotasi tidak terhad kepada teks atau imej: dalam audio, tugasan termasuk transkripsi, penandaan peristiwa bunyi (tepukan tangan, ketawa, tembakan), segmentasi mengikut penutur dan pengecapan masa kata kunci. Dan dalam data multimodal (video dengan audio dan sari kata, sebagai contoh), kerja dilakukan untuk menyelaraskan modaliti dan memberi anotasi interaksi bersama (ekspresi wajah serta nada suara serta kandungan teks).

Dalam bidang data berstruktur dan berjadual, anotasi juga bermaksud Terangkan maksud lajur dan nilaiIni termasuk menghubungkan entri yang setara merentasi pangkalan data atau menandakan atribut yang berkaitan untuk tugasan ramalan. Setiap jenis projek akan memilih satu atau satu lagi set anotasi, dan selalunya beberapa digabungkan untuk merangkumi kes penggunaan yang kompleks.

Alat dan proses untuk menganotasi fail sebagai set data

Merekod data pada skala memerlukan alat khusus dan aliran kerja yang difikirkan dengan telitiTidak sama untuk melabelkan beberapa dozen imej secara manual seperti menguruskan ratusan ribu contoh dalam pelbagai format dengan pasukan yang tersebar di beberapa zon waktu.

Dalam visi komputer, penyelesaian sumber terbuka seperti LabelImg (untuk kotak sempadan), CVAT (untuk anotasi imej dan video kompleks dengan ciri kolaboratif), atau platform komersial seperti Labelbox atau SuperAnnotate digunakan, menggabungkan analitik kualiti, pengurusan projek dan automasi. Untuk teks, alatan seperti Prodigy, LightTag, BRAT atau Datasaur memudahkan anotasi entiti, klasifikasi, kebergantungan sintaksis dan perhubungan, dengan penjejakan terperinci anotator dan konflik.

Dalam audio, perisian seperti Label Studio, Praat atau Sonix membolehkan segmentasi, transkripsi dan pelabelan bunyi yang tepat. Untuk data multimodal, projek ringan seperti VGG Image Annotator (VIA) atau aplikasi seperti RectLabel menawarkan asas serba boleh untuk menyegerakkan anotasi merentasi jenis data. Dan untuk projek yang memerlukan kelantangan dan kelajuan tinggi, platform seperti automasi dan kerjasama besar-besaran seperti Amazon SageMaker Ground Truth, Scale AI, DataLoop atau penyelesaian kolaboratif seperti Digma atau Hive Data.

Memilih alat bukan sekadar soal pilihan peribadi: anda perlu mempertimbangkan jenis data, bajet, saiz pasukan, keperluan untuk kerjasama masa nyata dan saiz set data. Hampir semua platform canggih menyertakan ciri untuk mengesahkan peraturan asas, mengurus konflik, mengukur produktiviti dan kualiti serta menggabungkan anotasi manusia dengan cadangan automatik yang dijana oleh model sedia ada.

Selain alat itu sendiri, kualiti ditentukan oleh prosesnya. Menyediakan panduan anotasi yang sangat jelas dan terkiniIni melibatkan latihan anotator (terutamanya dalam bidang sensitif seperti perubatan), menganjurkan semakan silang, menentukan metrik kualiti (persetujuan antara anotator, ketepatan, ingatan) dan menggunakan data "piawaian emas" yang disahkan pakar untuk menentukur pasukan. Menganotasi fail sebagai set data intelektual bukanlah pecutan, tetapi kitaran berulang yang berterusan.

Banyak projek memilih pendekatan hibrid: tugasan mudah atau berulang (contohnya, pengesanan objek awal atau pra-pengelasan teks) diautomasikan, dan kerja manusia dikhaskan untuk kes-kes yang samar-samar, kompleks atau berimpak tinggiIni mengurangkan kos tanpa mengorbankan kualiti dan membolehkan penilai memberi tumpuan kepada perkara yang mereka tambahkan nilai paling tinggi.

Aplikasi dunia sebenar bagi set data beranotasi dan intelektual

Melayan fail sebagai set data intelektual bukanlah satu latihan teori: ia mempunyai aplikasi yang sangat konkrit dalam pelbagai sektor di mana anotasi dan kurasi adalah kunci untuk menggunakan AI yang andal. Dalam visi komputer, sebagai contoh, set imej dan video beranotasi membolehkan pembangunan sistem pengecaman wajah, pengesanan anomali dalam sinar-X atau MRI, pemeriksaan kilang automatik atau kenderaan autonomi yang Mereka mengenal pasti pejalan kaki, papan tanda dan halangan en tiempo nyata.

Dalam pemprosesan bahasa semula jadi, set data yang disetempatkan dan dianotasi dengan baik membolehkan tugas seperti analisis sentimen di media sosial, pengelasan pertanyaan dalam khidmat pelanggan, pengekstrakan entiti dalam dokumen undang-undang, terjemahan mesin atau melatih chatbot yang memahami nuansa emosi dan konteks budayaArkib artikel peribadi boleh menjadi asas pembantu khusus yang, sebelum menerbitkan sesuatu yang baharu, menyemak apa yang telah diperkatakan, mengesan pengulangan, atau mengenal pasti perubahan postur selama bertahun-tahun.

Kesihatan dan bioteknologi semakin bergantung pada set data yang sangat beranotasi: imej perubatan dengan diagnosis yang disahkan, rekod klinikal berstruktur dan urutan genomik yang dilabelkan dengan mutasi yang berkaitan. Dalam automotif dan pengangkutan, data adalah penting untuk pemanduan autonomi, perancangan laluan pintar dan pengurusan trafik. Dalam perdagangan dan perbankan, ia digunakan untuk Pengesyor produk, pengesanan penipuan dan analisis risiko.

Bidang lain seperti pertanian jitu, alam sekitar, keselamatan dan pertahanan, permainan video, realiti maya, pendidikan dan penyelidikan saintifik menggunakan set data beranotasi untuk memantau tanaman, menganalisis imej satelit, mencipta pengalaman imersif, memperibadikan pembelajaran atau mempercepatkan penemuan dalam biologi atau astrofizik. Dalam kesemuanya, logiknya adalah serupa: Lebih berstruktur dan didokumentasikan (contohnya, dengan Fail README) Lebih baik set data, lebih baik model yang direka bentuk padanya..

Jika kita melihat fail tersebut sebagai set data intelektual dalam kunci peribadi, nilainya terletak pada kuasa rujuk serta-merta semua yang anda tahu dan telah tulisMemahami bagaimana idea anda telah berkembang, menemui jurang tematik, menghubungkan teks dari zaman yang jauh dan memanfaatkan ingatan lanjutan itu dalam konteks lain, seperti pengajaran, penyelidikan atau strategi perniagaan. Semua ini tanpa mendelegasikan penulisan kepada mesin, tetapi sebaliknya menggunakan AI sebagai alat sokongan untuk mengesahkan data, mencari rujukan atau menguji hujah.

Tempat untuk mencari set data dan cara penciptaannya diautomasikan

Tidak semua set data berasal daripada fail peribadi: kebanyakannya datang daripada repositori terbuka dan sumber awam Sumber-sumber ini berguna untuk melatih dan menilai model, atau untuk projek penyelidikan, kewartawanan data dan analisis strategik. Internet sudah menawarkan pelbagai sumber yang boleh dimanfaatkan, sentiasa dengan pertimbangan perundangan dan etika yang sewajarnya.

Rangkaian sosial X (dahulunya Twitter), sebagai contoh, menawarkan API yang membolehkan pengguna mengumpul tweet yang ditapis mengikut hashtag dan kriteria lain. Data ini kemudiannya boleh distrukturkan ke dalam jadual dan divisualisasikan dengan alatan seperti Tableau. Carian Set Data Google menyediakan enjin carian khusus untuk set data awam, di mana pengguna boleh menemui segala-galanya daripada pangkalan data perusahaan hingga statistik industri. Blog seperti FiveThirtyEight menerbitkan set data mereka tentang politik, sukan dan masyarakat supaya sesiapa sahaja boleh meniru atau melanjutkan analisis mereka.

Secara selari, ia semakin banyak digunakan persekitaran simulasi untuk menjana data beranotasi secara automatikTerutamanya dalam bidang seperti kenderaan autonomi, di mana mencipta semula semua keadaan realiti dalam dunia fizikal akan menjadi perlahan, mahal dan berbahaya. Simulator membolehkan penghasilan imej dan video dengan anotasi yang sempurna (kedudukan objek, keadaan cuaca, trajektori) dan penerokaan senario ekstrem yang sukar ditangkap dalam data dunia sebenar.

Masa depan menunjukkan gabungan data dunia sebenar yang dikurasi, arkib peribadi yang dianggap sebagai korpora intelektual dan data sintetik yang dihasilkan dalam simulasi, semuanya diselaraskan dengan teknik pembelajaran yang diselia, separa diselia, tidak diselia dan diselia kendiri. Anotasi akan kekal sebagai elemen utama, tetapi semakin dibantu oleh model yang Mereka mencadangkan label, mengesan ketidakkonsistenan dan mengukur bias.menyerahkan keputusan yang lebih baik kepada rakyat.

Dalam konteks ini, dimensi etika dan peraturan menjadi penting: pengendalian fail peribadi sebagai set data memerlukan penghormatan terhadap privasi, hak cipta dan jangkaan penggunaan, manakala platform crowdsourcing atau kolaborasi massa mesti memastikan keadaan yang adil untuk anotator dan ketelusan tentang model mana yang dilatih dengan data yang dihasilkannya.

Apabila keseluruhan rantaian ini diuruskan dengan teliti—daripada mengekstrak fail peribadi kepada pengvektoran, penggrafan, pencarian lokasi, penganotasian, pengautomasikan kemas kini dan menghubungkannya kepada pembantu AI—anda memperoleh sesuatu yang sangat sedikit dimiliki oleh penulis, syarikat atau organisasi hari ini: a set data intelektual yang mendalam, konsisten dan hidupmampu memperkasakan sistem kecerdasan buatan yang benar-benar sejajar dengan suara, konteks dan matlamat mereka yang memacunya, dan berfungsi sebagai ingatan lanjutan dalam dunia yang semakin tepu maklumat.

Penulis yang bersemangat tentang dunia bait dan teknologi secara umum. Saya suka berkongsi pengetahuan saya melalui penulisan, dan itulah yang akan saya lakukan dalam blog ini, menunjukkan kepada anda semua perkara yang paling menarik tentang alat, perisian, perkakasan, trend teknologi dan banyak lagi. Matlamat saya adalah untuk membantu anda mengemudi dunia digital dengan cara yang mudah dan menghiburkan.