- Raspberry Pi 5 si è affermato come una piattaforma accessibile per l'esecuzione di modelli e agenti di intelligenza artificiale leggeri che coordinano i servizi cloud, con particolare attenzione alla privacy e all'isolamento del sistema.

- I modelli distillati e compatti (DeepSeek, Llama 3.2, Qwen, ecc.) consentono il supporto di chat, traduzione e codice su hardware modesto, sebbene con evidenti limitazioni rispetto ai grandi LLM commerciali.

- Acceleratori dedicati come i moduli Hailo (Hailo-8L e Hailo-10H in AI HAT+ 2) migliorano le prestazioni di inferenza, consentendo la visione artificiale locale e LLM su Raspberry Pi 5 con bassa latenza.

- La combinazione di dimensioni ridotte, hardware dedicato e domotica rende Raspberry Pi un nodo AI ideale per l'edge, in grado di interpretare comandi e automatizzare le attività senza dover ricorrere al cloud.

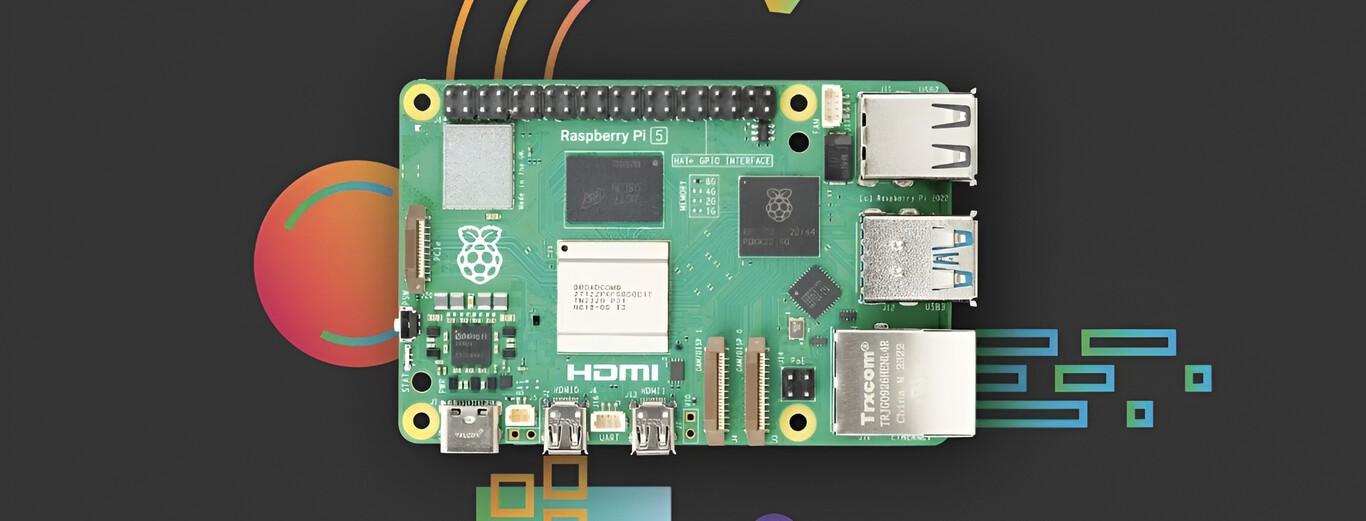

La Intelligenza artificiale sul Raspberry Pi Sta vivendo un momento piuttosto speciale. Fino a poco tempo fa, quando pensavamo all'intelligenza artificiale, immaginavamo un grande chatbot basato su cloud che richiedeva un abbonamento, o un computer estremamente costoso pieno di GPU per eseguire modelli enormi in locale. Ora il panorama è cambiato: l'arrivo di agenti come OpenClaw, modelli distillati come DeepSeek e nuovi acceleratori come AI HAT+ 2 hanno messo la piccola scheda al centro del dibattito.

Questo cambiamento non è solo una moda passeggera: La combinazione di Raspberry Pi 5, modelli leggeri e hardware AI dedicato Permette di gestire chatbot, traduttori, assistenti di programmazione o sistemi di visione artificiale senza dover ricorrere al cloud. Il tutto con un maggiore controllo su sicurezza, costi e privacy dei dati, sebbene esistano anche chiare limitazioni di cui è opportuno essere consapevoli per evitare delusioni.

L'ascesa degli agenti di intelligenza artificiale e il ruolo del Raspberry Pi

Negli ultimi mesi si è parlato molto di questo Agenti di intelligenza artificiale in grado di agire autonomamenteE uno dei nomi che ha generato più entusiasmo è OpenClaw. A differenza di un classico chatbot che risponde solo ai messaggi, un agente è un sistema in grado di prendere decisioni ed eseguire azioni: avviare script, chiamare API, interagire con servizi esterni o manipolare file all'interno di uno specifico ambiente informatico.

La cosa interessante è che Questo tipo di agente non ha bisogno che il "cervello" si trovi nel Raspberry Pi stesso.In genere, il modello più grande viene eseguito nel cloud, mentre la scheda funge da orchestratore: mantiene la conversazione, gestisce il contesto dell'utente, avvia comandi nel sistema e funge da ponte tra il mondo fisico (sensori, attuatori, domotica) e l'intelligenza artificiale remota.

Allo stesso tempo, le configurazioni progettate per eseguire modelli più piccoli direttamente sull'hardware Raspberry PiStrumenti come Ollama o llama.cpp consentono di caricare LLM ridotti e ottimizzati per l'architettura ARM, soprattutto su modelli come Raspberry Pi 4 o 5 con RAM sufficiente. Non è magia: alcune funzionalità e velocità vengono sacrificate, ma per certi utilizzi il risultato è perfettamente utilizzabile.

Questo nuovo scenario ha portato addirittura a movimenti nel mercato finanziario che circonda Raspberry Picon notevoli aumenti del prezzo delle sue azioni legati all'entusiasmo per gli agenti di intelligenza artificiale accessibili. In definitiva, l'idea che sta prendendo piede è quella di piccoli dispositivi fisici dedicati all'esecuzione o al coordinamento dell'intelligenza artificiale, piuttosto che affidarsi esclusivamente a grandi data center o computer desktop di fascia alta.

Sicurezza, isolamento e dubbi sull'approccio

Concedere a un agente di intelligenza artificiale un accesso approfondito a un sistema non è uno scherzo: Un agente con autorizzazioni estese può leggere file, spostare dati, compilare moduli web o accedere a servizi critici.Lo stesso ecosistema Raspberry Pi sottolinea che ciò comporta rischi reali, perché questi algoritmi non sono infallibili e possono commettere errori o comportarsi in modo inaspettato; pertanto, è consigliabile seguire [le linee guida/i metodi pertinenti]. buone pratiche di sicurezza informatica.

Ed è qui che entra in gioco uno dei grandi vantaggi della scheda madre: L'utilizzo di un Raspberry Pi come ambiente isolato riduce l'impatto di potenziali guasti.Invece di affidare il controllo diretto al computer principale, è possibile impostare un sistema dedicato in cui l'agente ha accesso solo alle risorse strettamente necessarie. Questa "sandbox" fisica aiuta a contenere i danni e consente di sperimentare con maggiore tranquillità.

Non tutti sono convinti che questo approccio sia una panacea. I media specializzati hanno sottolineato che Il Raspberry Pi sta perdendo un po' del suo fascino come soluzione ultra economica.Soprattutto in configurazioni avanzate con molta RAM, un modello Raspberry Pi 5 da 16 GB può avvicinarsi o superare i 200 dollari, il che per alcuni mina l'idea originale di un computer low-cost alla portata di tutti.

In questo senso, ci sono voci scettiche che credono che Utilizzare un Raspberry Pi come base per agenti complessi come OpenClaw potrebbe non essere la decisione ideale. Se il budget è limitato, il costo della scheda madre, della memoria e di eventuali acceleratori di intelligenza artificiale può aumentare significativamente il prezzo, rendendolo più costoso rispetto ad alternative più potenti o flessibili.

Ciononostante, l'approccio basato su dispositivi dedicati con isolamento del rischio rimane molto interessante: che valorizza la sicurezza, la privacy e la sperimentazione controllata Il Raspberry Pi rappresenta un "laboratorio" perfetto per testare agenti e modelli senza compromettere le macchine su cui si lavora in modo critico.

Raspberry Pi 5 come piattaforma per modelli di intelligenza artificiale locali

Oltre alla parte degli agenti, il Raspberry Pi 5 si è affermato come uno strumento incredibilmente versatileRimane fantastico per la robotica, l'elettronica, la domotica o i multimedia, ma il suo hardware attuale consente di fare un ulteriore passo avanti e di utilizzarlo come base per progetti di intelligenza artificiale locali e nel mondo reale.

Grazie alla sua CPU più veloce, ai miglioramenti della GPU e alla possibilità di creare configurazioni con molta RAM, Il Raspberry Pi 5 è in grado di eseguire modelli di intelligenza artificiale leggeri in modo abbastanza buono.Non sostituirà un server pieno di GPU, ma consentirà di sperimentare con la visione artificiale, il riconoscimento vocale, modelli linguistici compatti o assistenti specifici per attività molto specifiche.

Una strategia comune prevede optare per modelli open source ottimizzati per hardware limitatoTra gli esempi più comunemente utilizzati ci sono Mistral 7B, alcune piccole varianti di Orca o modelli compatti come Microsoft Phi-2, a patto che esistano versioni adattate e soprattutto ridotte con tecniche di quantizzazione o distillazione per adattarsi alla memoria.

È importante capire che Questi LLM più piccoli non giocano nella stessa lega dei giganti come GPT-4Perdono profondità, contesto e reattività, soprattutto quando si trattano argomenti molto generali o complessi. In cambio, offrono una latenza accettabile, un consumo energetico inferiore e il vantaggio di non dipendere da connessioni esterne, un fattore chiave quando tutta l'elaborazione deve avvenire sulla scheda stessa.

Questa combinazione trasforma il Raspberry Pi 5 in una sorta di “sandbox” ideale per l’apprendimento, la prototipazione e l’implementazione di soluzioni di intelligenza artificiale che non richiedono conoscenze tecniche estreme o investimenti esorbitanti, a patto che sia ben chiaro cosa ci si può e cosa non ci si può aspettare da questi modelli ridotti.

Passaggi di base per far funzionare l'intelligenza artificiale su un Raspberry Pi 5

Per impostare un progetto che esegua l'intelligenza artificiale localmente sul Raspberry Pi 5, è utile seguire una serie di passaggi generali. Non è una ricetta fissa, ma una guida mentale. di ciò che scoprirai quando inizierai a armeggiare.

Il primo punto è scegliere un modello compatibile con l'architettura ARM e le risorse della schedaÈ qui che entrano in gioco modelli come il già citato Mistral 7B in versioni altamente compresse, alcuni piccoli modelli Orca o Phi-2 in scala ridotta, e altri LLM da 1B a 7B con parametri predisposti per funzionare su dispositivi modesti. Più piccolo è il modello, più facile sarà da usare, ma anche più limitato sarà.

Poi arriva la parte di installare il software di supporto per lavorare con le reti neuraliA seconda delle esigenze, è possibile utilizzare TensorFlow Lite per progetti di visione, PyTorch se si prevede di utilizzare repository specifici o runtime dedicati come Edge TPU quando si utilizzano acceleratori esterni. Per LLM, strumenti come llama.cpp o Ollama semplificano notevolmente le cose.

Una volta ottenuto il software, tocca Configurare l'ambiente di runtime sul Raspberry PiCiò comporta la regolazione delle opzioni di sistema, l'installazione di dipendenze aggiuntive, la garanzia che il modello sia ottimizzato per ARM e spesso la modifica di parametri quali la dimensione del contesto, il livello di quantizzazione o il numero di thread per bilanciare prestazioni e consumo di memoria.

Con tutto impostato, puoi passare a Esegui il modello e inizia a fare inferenzeQui è dove si verifica se la combinazione hardware-software funziona. Dovrai caricare dati, inviare query, controllare la latenza e verificare quanto la qualità della risposta corrisponda alle tue aspettative. È normale dover perfezionare innumerevoli dettagli finché il sistema non funziona senza problemi. È consigliabile controllare lo spazio su disco utilizzando strumenti per... analizza e pulisci il tuo disco.

Se le prestazioni sono insufficienti, hai la possibilità di Aggiungere un acceleratore esterno per scaricare il lavoro dalla CPU.Dispositivi come USB Coral con Edge TPU o le nuove schede basate sui chip Hailo consentono alle reti neurali di funzionare molto più velocemente e con un basso consumo energetico, il che in molti casi cambia completamente l'esperienza.

Privacy, sicurezza e i vantaggi di elaborare tutto localmente

Uno degli argomenti più forti a favore dell'utilizzo dell'intelligenza artificiale su un Raspberry Pi è la capacità di mantenere i dati all'interno della tua reteQuando si esegue un modello localmente, non si inviano informazioni personali o sensibili a un server di terze parti, il che è particolarmente rilevante in ambienti professionali, educativi o di domotica avanzata. È inoltre consigliabile applicare tecniche per backup crittografato alle tue copie.

Ciò significa che Hai molto più controllo su chi può accedere a ciò che elabori.Che il tuo assistente locale analizzi documenti interni, monitori le telecamere di sicurezza o gestisca la cronologia di utilizzo della tua abitazione, tutto rimane all'interno della tua infrastruttura. Non sei soggetto a modifiche delle policy sulla privacy o a potenziali violazioni dei servizi esterni.

Parallelamente, il Raspberry Pi funziona quasi come un “Firewall fisico” per i tuoi esperimenti di intelligenza artificialeÈ possibile impostare un sistema separato dalla rete principale, limitarne l'accesso a determinate risorse e garantire che, anche se il modello commette strani errori o l'agente diventa troppo creativo, il potenziale danno sia contenuto.

Naturalmente, ciò non nega la necessità di configurare correttamente i permessi, gli utenti e le regole di reteUn agente con troppa libertà su un Raspberry Pi poco sicuro può comunque rappresentare un problema. La differenza è che, trattandosi di un ambiente dedicato ed economico, è molto più facile da controllare, ricostruire da zero o persino disconnettere fisicamente se qualcosa va storto.

In sintesi, per coloro che apprezzano la protezione dei dati e la possibilità di controllare l'intero flusso di informazioni, Utilizzare un Raspberry Pi come nodo AI locale offre una tranquillità difficile da ottenere. quando tutto dipende dai servizi cloud gestiti dall'esterno della tua organizzazione o da casa tua.

DeepSeek e la realtà dell'esecuzione di modelli di grandi dimensioni su hardware modesto

Un altro nome che ha scosso il panorama è DeepSeek, in particolare il modello DeepSeek R1, progettato per il ragionamento e con un approccio molto ambiziosoMolti titoli hanno sottolineato che supera in prestazioni alcuni dei modelli commerciali più avanzati e può essere eseguito localmente, alimentando l'idea di avere un "ChatGPT fatto in casa" su qualsiasi macchina.

È importante mettere le cose al loro posto: La versione completa di DeepSeek R1 671B è un mostro da oltre 400 GB E richiede diverse GPU di fascia alta per funzionare senza problemi. Questa è la variante che compete davvero con i modelli top di gamma di OpenAI o piattaforme simili, ed è completamente fuori dalla portata di un Raspberry Pi o di un PC standard.

La grande differenza rispetto ad altri provider chiusi è che, se si dispone dell'hardware, È possibile scaricare il modello, assemblarlo con strumenti come Ollama e utilizzarlo a casa.e in molti casi avrai bisogno collegare un disco rigido esterno per immagazzinare i pesi. Ma stiamo parlando di configurazioni che costano diverse migliaia di euro, con schede come la RTX 4090, la A100 o schede per data center equivalenti; niente a che vedere con un microcomputer a basso consumo.

Per consentire alle persone comuni di giocare a DeepSeek su macchine o dispositivi standard come il Raspberry Pi, vengono utilizzati i seguenti passaggi: modelli distillati e ridottiSi tratta essenzialmente di versioni compresse dell'originale, che ne mantengono parte del comportamento a scapito di capacità e conoscenze. È qui che entrano in gioco le varianti con parametri 14B, 7B o persino 1.5B.

La domanda chiave è quanto si perde lungo il cammino. La relazione tra dimensione del modello, memoria e qualità della risposta è molto evidenteSe il modello di riferimento è di oltre 400 GB e Wikipedia occupa già quasi 100 GB, non è realistico aspettarsi che una versione di poco più di 1 GB possa contenere tutte queste informazioni in dettaglio.

Test reali di DeepSeek su diversi dispositivi

Per vedere queste differenze nella pratica, è utile confrontare il comportamento delle diverse varianti di DeepSeek su hardware diversi. Su una workstation con Una GPU RTX 3060 con 12 GB di VRAM può eseguire la versione con parametro 14B abbastanza bene.e persino forzare la versione a 32B utilizzando la RAM di sistema, anche se la velocità cala notevolmente.

Se provi la versione cloud di DeepSeek, senza limitazioni hardware localiIl modello più grande funziona in modo impeccabile e dimostra chiaramente perché compete con i giganti del settore. La differenza è evidente sia nella velocità e nella coerenza delle sue risposte, sia nella sua capacità di gestire istruzioni complesse.

Quando scendi a terra di un Con un Raspberry Pi e 8 GB di RAM, lo scenario cambia radicalmente.In questo caso, il modello più grande che può essere eseguito funzionalmente è quello con 7B parametri, e anche in questo caso la velocità è di circa 1 token al secondo. Questo rende quasi insopportabile mantenere una conversazione fluida.

Valutando la qualità delle risposte, la differenza diventa ancora più evidente. Di fronte a una semplice domanda di cultura generale, come ad esempio chi è un personaggio famoso di una serie TV popolare, Il modello 14B è corretto, mentre il modello 7B inizia a dare risposte strane.Quello da 1.5 miliardi offre direttamente risultati che ricordano più un testo inventato, senza una base solida.

Lo schema si ripete con query più generiche: Le varianti di piccole dimensioni tendono a fornire risposte rare, incomplete o chiaramente errate.Ciò è logico: riducendo così tanto le dimensioni del modello, la sua capacità rappresentativa e la sua "memoria" implicita del mondo vengono brutalmente ridotte, quindi non ci si può aspettare che si comporti come un modello di fascia alta.

A cosa servono realmente i modelli distillati su Raspberry Pi?

Nonostante queste limitazioni, i modelli distillati e compatti hanno utilizzi molto interessanti in dispositivi come il Raspberry Pi. Non sono pensati per sostituire i grandi chatbot generici.ma per risolvere compiti ben definiti in cui la creatività e la conoscenza enciclopedica non sono l'obiettivo principale.

Uno dei campi in cui lavorano abbastanza bene è in aiuto di matematica di base e revisione del codicePer rilevare semplici errori negli script, proporre piccole funzioni o suggerire miglioramenti a parti di codice Python, un modello 7B o 14B solitamente fornisce risposte utili, a patto che non venga richiesto qualcosa di estremamente specifico o contorto.

Possono anche essere molto utili per Generare e correggere frammenti di codice applicati alla domotica, all'automazione o a piccoli progettiAd esempio, un modello 14B potrebbe proporre un'automazione Home Assistant con una certa coerenza, mentre la versione 1.5B tenderà a inventare parti o a offrire qualcosa che non si adatta o non ha senso.

Dove falliscono sistematicamente è in domande di cultura generale, informazioni fattuali dettagliate o compiti che richiedono molto contestoInoltre, il senso dell'umorismo e la capacità di sostenere lunghe conversazioni naturali sono palesemente assenti anche nei modelli relativamente grandi, il che li rende non la scelta migliore per essere utilizzati come "amici virtuali".

Un esempio curioso è chiedere loro di Crea un sito web complesso, come una landing page per vendere un corso.Tutti i modelli possono produrre una struttura HTML funzionale, ma più la variante è distillata e piccola, più il sito web generato diventa semplice, brutto e povero di contenuti, perdendo dettagli e sfumature lungo il percorso.

In breve, i piccoli modelli costruiti su un Raspberry Pi sono ideali per assistenza con compiti tecnici limitati, automazione domestica, piccoli assistenti allo sviluppo o classificazione di dati leggeriMa non è pensato per sostituire un servizio cloud all'avanguardia quando ciò che si desidera è un assistente versatile e multiuso.

Raspberry Pi, domotica e intelligenza artificiale leggera

Una delle applicazioni più promettenti dell'intelligenza artificiale su Raspberry Pi è la domotica intelligente con modelli leggeriL'idea è di utilizzare la scheda come un cervello locale che interpreta i comandi, si collega a sensori e attuatori e prende decisioni semplici senza dover inviare nulla al cloud.

Ad esempio, è possibile impostare un sistema in cui Un piccolo modello linguistico è responsabile della comprensione dei comandi vocali., compresi i passaggi di pre-elaborazione come Pulisci il rumore del microfonocome "abbassare le tapparelle del soggiorno quando il sole splende direttamente sulla stanza" o "accendere il riscaldamento solo se c'è qualcuno in casa e la temperatura scende sotto una certa soglia". Il modello non ha bisogno di sapere chi è un personaggio storico o di scrivere poesie: deve solo tradurre le richieste in azioni concrete.

Con questo approccio, anche un LLM con parametri 1.5B o 3B può avere senso. perché la sua funzione non è quella di fornire risposte brillanti, ma di mappare il linguaggio naturale in comandi strutturatiSe viene addestrato o adattato specificamente per quel dominio (automazione domestica, sensori, routine), i risultati possono essere sorprendentemente buoni, considerando la leggerezza del sistema.

Questo tipo di soluzione consente di creare case intelligenti molto più rispettose della privacydove né i comandi vocali né i modelli di utilizzo del dispositivo escono dalla rete locale. Inoltre, non dipendendo da servizi esterni, impedisce che tutto cessi di funzionare a causa di una modifica dell'API da parte di un provider, di un malfunzionamento di un server o della chiusura del servizio.

Sebbene ci sia ancora molto da perfezionare e testare, il potenziale della combinazione piccoli modelli con piattaforme di domotica come Home Assistant o sistemi propri Il potenziale di questo approccio su Raspberry Pi è enorme e tutto fa presagire che assisteremo a sempre più esperimenti e progetti concreti in questo senso.

Acceleratori AI per Raspberry Pi: Hailo, AI HAT+ e altri moduli

Per superare i limiti della CPU del Raspberry Pi, sono emerse nuove tecnologie acceleratori AI dedicati che si integrano direttamente con la schedaIl suo obiettivo è elaborare le reti neurali in modo molto più rapido ed efficiente rispetto a una CPU o, in alcuni casi, a una GPU convenzionale.

Rispetto ai processori generici, questi acceleratori sono progettati per eseguire in parallelo le operazioni matematiche tipiche dell'apprendimento automaticoCiò riduce il tempo di inferenza e anche il consumo energetico, un aspetto fondamentale nei dispositivi integrati o in situazioni in cui non è tollerabile un elevato dispendio energetico continuo.

Un esempio molto diffuso è l'uso di un Scheda M.2 HAT+ collegata al Raspberry Pi 5 insieme a un modulo M.2 2242 che integra un chip Hailo-8LQuesto tipo di kit aggiunge un'unità di elaborazione neurale dedicata che accelera le attività visive, il rilevamento di oggetti o persino alcuni modelli generativi ottimizzati per la sua architettura.

Il chip Hailo si concentra su per elaborare operazioni complesse in parallelo con elevata efficienza energeticaRispetto alle soluzioni basate su CPU o GPU, ciò si traduce in meno calore, minori requisiti di raffreddamento e maggiore durata della batteria: un vantaggio significativo nei progetti industriali, nella robotica e nei sensori intelligenti distribuiti.

Grazie a questi moduli, il Raspberry Pi può passare dall'essere un semplice coordinatore a diventare un nodo di inferenza veramente capace, eseguendo reti neurali sofisticate direttamente ai margini della rete senza saturare la scheda e mantenendo una latenza molto bassa.

AI HAT+ 2 e il passaggio agli LLM locali su Raspberry Pi 5

Uno dei lanci più sorprendenti in quest'area è il Raspberry Pi AI HAT+ 2, una scheda di espansione progettata per Raspberry Pi 5 che incorpora il chip Hailo-10H. Questo coprocessore offre prestazioni di inferenza di circa 40 TOPS, sufficienti per gestire localmente modelli di intelligenza artificiale generativa leggeri.

Con questo hardware, il Raspberry Pi 5 può eseguire modelli linguistici relativamente compatti con bassa latenzasenza sovraccaricare la CPU principale. L'elaborazione è delegata all'Hailo-10H, che gestisce le operazioni intensive, mentre la scheda gestisce la logica applicativa, l'input dell'utente e l'integrazione con altri sistemi.

I modelli compatibili che sono stati ufficialmente menzionati includono DeepSeek-R1-Distill, Llama 3.2, Qwen2.5-Coder, Qwen2.5-Instruct e Qwen2La maggior parte ha circa 1.500 miliardi di parametri, mentre Llama 3.2 ne ha circa 1.000 miliardo, tutti progettati per offrire un ragionevole equilibrio tra capacità e consumo di risorse.

Le prove pubbliche dimostrano che questi modelli possono essere utilizzati per attività di chat di base, traduzione di testo, generazione di frammenti di codice o descrizione di scene Se combinata con l'input visivo, la latenza è bassa e l'esperienza utente si avvicina molto di più a ciò che le persone si aspettano dalla moderna intelligenza artificiale interattiva.

Tuttavia, è importante essere chiari sul fatto che AI HAT+ 2 non consente l'esecuzione di modelli di grandi dimensioni in locale, come ChatGPT, Claude o i più grandi Meta LLM.Questi sistemi hanno centinaia di miliardi o trilioni di parametri, ben oltre ciò che un coprocessore di questo tipo in un Raspberry Pi 5 può ragionevolmente gestire.

Il grande fascino dell'AI HAT+ 2 è che, per un prezzo di circa 130 dollari, Ti consente di trasformare un Raspberry Pi 5 in una piccola stazione di intelligenza artificiale locale molto efficienteOffre accesso a un repository di esempi e framework Hailo orientati sia alla visione artificiale che all'intelligenza artificiale generativa. È uno strumento fondamentale per chi desidera andare oltre i modelli puramente simbolici e sperimentare concretamente le moderne reti neurali in ambito edge.

Il panorama che si sta delineando attorno all'intelligenza artificiale su Raspberry Pi è piuttosto potente: tra agenti basati su cloud, modelli on-premise leggeri, acceleratori dedicati e nuove schede come AI HAT+ 2La piccola scheda è diventata un laboratorio ideale per esplorare come apparirà l'intelligenza artificiale distribuita nei dispositivi di uso quotidiano, a patto che si tengano in considerazione i limiti di potenza e che i progetti siano progettati con attenzione.

Scrittore appassionato del mondo dei byte e della tecnologia in generale. Adoro condividere le mie conoscenze attraverso la scrittura, ed è quello che farò in questo blog, mostrarti tutte le cose più interessanti su gadget, software, hardware, tendenze tecnologiche e altro ancora. Il mio obiettivo è aiutarti a navigare nel mondo digitale in modo semplice e divertente.