- Trasformare un file in un dataset intellettuale implica vettorializzare il corpus, costruire grafi di relazioni e collegare un assistente di intelligenza artificiale per esplorarlo alla ricerca di idee.

- La qualità, la posizione e la rigorosa valutazione del dataset sono cruciali quanto l'architettura del modello per ottenere un'intelligenza artificiale affidabile e contestualizzata.

- L'annotazione dei dati, supportata da strumenti specifici e processi di controllo qualità, trasforma il file in materia prima addestrabile per molteplici attività.

- File personali, repository aperti e dati simulati vengono combinati per creare ecosistemi di dataset applicabili a settori quali la sanità, i trasporti, la finanza o l'istruzione.

Convertire un file personale in un insieme di dati intellettuali vivi e utili Non è più solo per i grandi laboratori: chiunque produca contenuti digitali da anni può trasformare quella cronologia in una base di conoscenza navigabile e carburante per i sistemi di intelligenza artificiale. La cosa interessante non è solo salvare tutto ciò che hai scritto nel formato adattoma far sì che questi elementi dialoghino tra loro, si relazionino l'uno con l'altro e possano essere consultati per idee, contesti o attori, al di là di una semplice ricerca per parole chiave.

Quel salto da un file statico a un set di dati curato, annotato e ricercabile Questo apre la strada a utilizzi che spaziano da un assistente personale addestrato sui propri testi alla costruzione di modelli linguistici su misura per una cultura o un settore specifici. In questo articolo, spiegheremo con calma e chiarezza cosa significa trattare un file come un insieme di dati intellettuali, come viene tecnicamente costruito, cosa comporta una traduzione o un'annotazione corretta, quali strumenti sono coinvolti e in quali contesti reali viene già utilizzato.

Da archivio sparso a insieme di dati intellettuali navigabili

Immagina di scrivere articoli su [argomento/argomento] da oltre un decennio. tecnologia, regolamentazione, privacy o intelligenza artificiale su un'unica piattaforma. Richiedi un dump completo dei tuoi testi (un file di testo semplice con migliaia di documenti) e lo ricevi in pochi minuti. Sulla carta, quel file è prezioso: racchiude quattordici anni del tuo processo di pensiero. Ma finché rimane solo testo non strutturato, non puoi fare molto di più che... ricerca per singole parole.

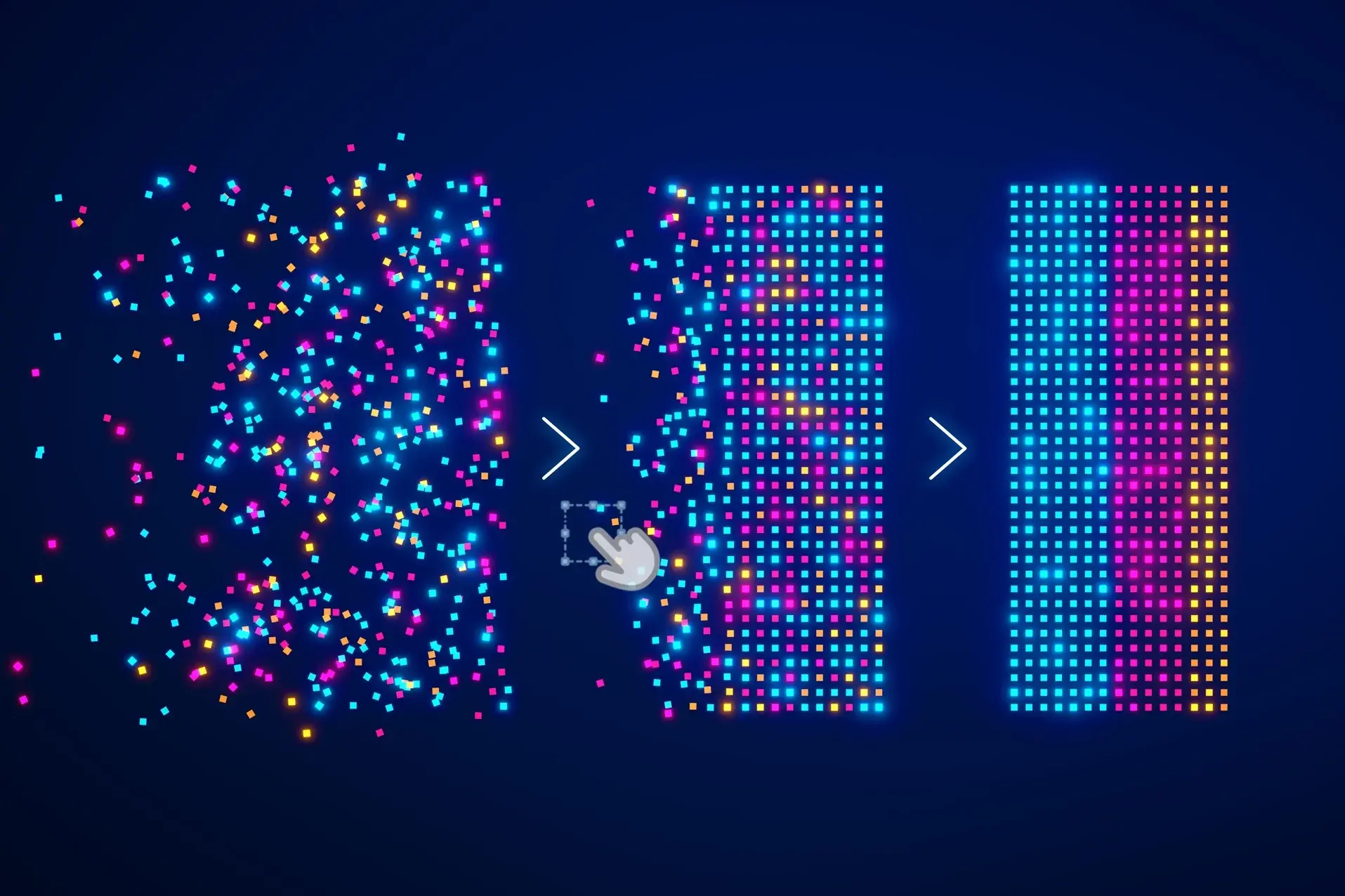

Il primo cambiamento concettuale consiste nel smettere di vedere quel file come una pila di documenti e iniziare a trattarlo come un corpus coerente che può essere indicizzato ed esploratoL'idea è quella di trasformare ogni articolo in una rappresentazione numerica che ne catturi il significato, memorizzare questi vettori in un database specializzato e costruire su di essi un grafo di relazioni e un assistente che comprenda a fondo quello spazio semantico.

In uno studio di caso reale che coinvolge 4.209 articoli scritti in inglese nell'arco di quattordici anni, l'autore ha utilizzato un modello di incorporamenti multilingue (paraphrase-multilingual-mpnet-base-v2, da sentence-transformers) per convertire ogni testo in un vettore a 768 dimensioni. Questi vettori sono stati memorizzati in ChromaDB, un database vettoriale open-source. L'intero processo, eseguito su un server standard senza GPU, è stato completato in circa cinque minuti: il file flat è stato trasformato in uno spazio continuo di idee.

In pratica, questo significa che non si cerca più "per parole chiave" ma mediante concetti, domande o frammenti di testoÈ possibile porre domande come "Quando ho iniziato a scrivere sui monopoli tecnologici?" o "Quali articoli sono concettualmente vicini a questa argomentazione?" e il sistema risponde individuando i vettori più simili in quello spazio semantico, anche se non condividono lo stesso vocabolario. È un modo molto diretto per ampliare la propria memoria sul proprio lavoro.

È stato inoltre costruito un grafico sopra questo livello vettoriale utilizzando NetworkX, dove ogni nodo rappresenta un articolo e gli archi collegano testi che condividono tag tematici o superano una certa soglia di somiglianza semantica. Visualizzato in strumenti come Gephi, il risultato è un mappa della tua produzione intellettuale organizzata in clusterRegolamentazione, piattaforme, privacy, intelligenza artificiale, mobilità elettrica… e anche connessioni inaspettate tra testi separati da anni ma molto vicini nelle idee.

Un assistente personale attivo come porta d'accesso all'archivio

L'altro elemento chiave di questo approccio è avere un Assistente di intelligenza artificiale ancorato al tuo set di dati che può operare come collaboratore continuo, non solo come un semplice chatbot in una scheda del browser. Nell'esempio precedente, questo assistente si chiamava Bautista: un'istanza agentica basata su modelli antropici (Claude Sonnet 4.6) ma in grado di lavorare con altri modelli a seconda dell'API utilizzata.

Bautista risiede sul server dell'autore ed è orchestrato utilizzando una piattaforma infrastrutturale simile a OpenClaw, che gestisce la memoria persistente tra le sessioni, i canali di comunicazione (come Telegram), le attività pianificate e l'accesso a strumenti come il file system e l'esecuzione degli script. Grazie a questo, l'assistente mantiene la continuità nel tempoRicorda i progetti precedenti, conserva i file, automatizza i processi e può agire in modo autonomo su richiesta.

La differenza rispetto all'apertura di un modello generico nel browser è che qui non stiamo parlando di una semplice chat, ma di qualcosa di più simile a un collaboratore integrato nella tua infrastrutturaspecializzato nel tuo corpus e in grado di fungere da intermediario tra quel file vettorializzato e le tue esigenze quotidiane: individuare testi, rilevare ridondanze, recuperare citazioni, eseguire analisi specifiche o avviare script di manutenzione.

Inoltre, il sistema è stato progettato per mantenere l'archivio attivo senza intervento manuale. Ogni volta che l'autore pubblica un nuovo articolo su Medium e condivide il link di accesso completo su Bluesky, un processo programmato interroga quotidianamente l'API pubblica di Bluesky, rileva la nuova voce, scarica il testo, genera il codice di incorporamento e lo aggiunge a ChromaDB. Una pipeline automatizzata garantisce che il set di dati si aggiorni automaticamente., grazie ai compiti di indicizzazione dei fileevitando il classico problema delle basi di conoscenza che diventano obsolete perché aggiornarle è un'operazione complessa.

In una fase successiva sono stati aggiunti nuovi livelli di analisi, come il riconoscimento di entità nominate (persone, aziende, tecnologie, paesi, istituzioni) nell'intero corpus, con l'obiettivo di studiare il evoluzione temporale delle menzioni e reti di co-occorrenzaGrazie a ciò, è possibile vedere quando un attore come OpenAI compare nei testi, quando Google+ scompare o come diversi agenti interagiscono tra loro nel tempo, avvicinando il sistema all'analisi del discorso su larga scala piuttosto che a un semplice archivio personale.

Dataset, modello e comportamento: il file come materia prima per l'IA

Nel contesto dell'intelligenza artificiale, un Un dataset è molto più di una semplice raccolta di datiSi tratta del materiale di addestramento che modella il comportamento del modello. Nell'elaborazione del linguaggio naturale (NLP), questo set di dati assume solitamente la forma di testi, dialoghi, istruzioni o annotazioni che consentono ai modelli di imparare a tradurre, riassumere, conversare o classificare le emozioni, tra le altre attività.

Per anni, l'enfasi è stata posta quasi esclusivamente sull'architettura del modello (numero di parametri, tipo di strati, capacità di calcolo), ma l'esperienza recente ha dimostrato che la qualità, la diversità e l'adeguatezza dei dati di addestramento Hanno un peso pari, se non superiore, alla progettazione del modello stesso. Come sottolineano studi come quelli di Bender et al. o Paullada et al., i modelli non sono migliori dei dati che li alimentano: se il set di dati è distorto, incompleto o non rappresentativo, l'IA riprodurrà gli stessi difetti.

Questo cambiamento di prospettiva ha determinato un chiaro movimento verso la qualità rispetto alla quantitàNon si tratta solo di raccogliere enormi quantità di testo, ma di garantire che questi dati siano in linea con la lingua, la varietà regionale e il contesto culturale in cui l'IA verrà implementata (Blasi et al., Kreutzer et al.). Ciò è particolarmente rilevante se consideriamo un archivio come un insieme di dati intellettuali: il corpus personale di un autore può essere molto ricco, ma se deve poi essere utilizzato per modelli che operano in altre lingue o mercati, la curatela e l'adattamento diventano cruciali.

Inoltre, il dataset non è utile solo per l'addestramento, ma anche per valutare le prestazioni del modelloSe un modello viene valutato utilizzando dati già visti durante la fase di addestramento (contaminazione dei dati), si ottengono metriche fuorvianti che ne mascherano i veri limiti, come analizzato da Dong et al. e Samuel et al. Pertanto, quando si trasferisce un file personale in un contesto di intelligenza artificiale, è fondamentale distinguere quali parti vengono utilizzate per l'addestramento, quali per la validazione e quali per il test, nonché progettare set di valutazione ricchi e stimolanti, anziché test banali che tutti i modelli superano.

Traduzione e localizzazione di dataset: molto più che semplice trasferimento di testo da una lingua all'altra.

Quando vuoi riutilizzare un file come Insieme di dati intellettuali in diverse lingue o mercatiSi pone quindi una sfida specifica: la traduzione e la localizzazione del corpus. A prima vista, potrebbe sembrare un semplice progetto di traduzione, ma un dataset di intelligenza artificiale è spesso composto da frammenti isolati, dialoghi frammentari, brevi istruzioni o dati strutturati privi di un chiaro contesto narrativo, il che cambia completamente le regole del gioco.

In molti set di dati troviamo contesto molto limitatoSi tratta di frasi prive di informazioni su chi sta parlando, sulla situazione o sull'intenzione. Il traduttore deve dedurre le funzioni pragmatiche (un comando, un dubbio, un insulto, un'ironia) affinché il modello possa apprendere correttamente il comportamento nella lingua di destinazione. Inoltre, ci sono elementi che non devono essere modificati, come frammenti di codice, variabili, segnaposto o etichette tecniche, dove una traduzione ingenua potrebbe compromettere il dataset.

Anche la coerenza di massa entra in gioco: decisioni apparentemente piccole, come la scelta tra "tú" o "usted", la gestione del genere inclusivo o il trattamento di certi anglicismi, Questi esempi si moltiplicano per milioni.Un'incongruenza che potrebbe passare inosservata in un libro qui diventa rumore che il modello interiorizza. E, a differenza della traduzione editoriale, spesso è meglio lasciare gli errori grammaticali o i colloquialismi così come appaiono, perché l'obiettivo non è "rifinire" il testo, ma insegnare all'IA come le persone si esprimono realmente.

Pertanto, piuttosto che tradurre, è più opportuno parlare di individuare i set di datiQuesto processo implica l'adattamento di riferimenti culturali, nomi di istituzioni, marchi, formati di data, valute e unità di misura, nonché l'adeguamento del registro alle norme sociali del mercato di riferimento. Nei modelli linguistici più complessi, questa localizzazione è ciò che distingue un'IA che si limita a "parlare spagnolo" da una che comprende le sfumature culturali, le aspettative di cortesia e i riferimenti locali.

Le aziende con una lunga storia nella localizzazione di software e contenuti, come imaxin, si sono evolute verso traduzione e curatela specifica di set di datiCombinando competenza umana, guide di stile precise, glossari curati e strumenti di traduzione automatica e assistita da computer, il loro approccio assomiglia più a un processo di controllo qualità dei dati che alla traduzione tradizionale: definizione precisa dei criteri linguistici e tecnici, gestione degli errori intenzionali, utilizzo di controlli di qualità automatizzati e campionamento statistico per monitorare la coerenza.

Dataset annotato: dare struttura e significato ai dati

Affinché un file diventi un Un insieme di dati intellettuali davvero utile per i modelli supervisionatiNon basta semplicemente raccogliere i testi: è necessario annotarli. Un dataset annotato è un dataset in cui a ciascun elemento (immagine, frammento audio, frase, tabella) sono stati assegnati metadati che ne descrivono il contenuto o la funzione: tag, categorie, entità, relazioni, trascrizioni, riquadri di delimitazione, ecc.

Nella visione artificiale, ad esempio, le annotazioni possono includere etichette di classificazione globali, riquadri di delimitazione attorno agli oggetti, maschere di segmentazione che assegnano una categoria a ciascun pixel, annotazioni di punti chiave (articolazioni umane, punti facciali) o traiettorie lungo un video. Nel testo, parliamo di voci di entità nominate (persone, organizzazioni, luoghi), classificazione dei documenti, analisi sintattica, relazioni tra entità o tag di sentiment.

L'obiettivo di tutto questo lavoro è che i modelli abbiano esempi chiari di ciò che dovrebbero riconoscere o prevedereUn dataset di immagini annotate con gatti, automobili e pedoni consente di addestrare modelli in grado di rilevare e classificare questi oggetti; un dataset di conversazioni con tag di intento ed emozione consente di addestrare chatbot e sistemi di analisi del sentiment; un corpus documentario con entità contrassegnate e relazioni esplicite pone le basi per i sistemi di estrazione della conoscenza.

L'annotazione non si limita a testo o immagini: nell'audio, le attività includono la trascrizione, l'etichettatura di eventi sonori (applausi, risate, spari), la segmentazione per oratore e la marcatura temporale delle parole chiave. Nei dati multimodali (video con audio e sottotitoli, ad esempio), il lavoro consiste nell'allineare le modalità e annotare le interazioni tra loro (espressioni facciali, tono di voce e contenuto testuale).

Nell'ambito dei dati strutturati e tabellari, annotare significa anche Spiega il significato di colonne e valoriCiò include il collegamento di voci equivalenti tra database o la marcatura di attributi rilevanti per le attività di previsione. Ogni tipo di progetto sceglierà un insieme di annotazioni piuttosto che un altro, e spesso ne vengono combinati diversi per coprire casi d'uso complessi.

Strumenti e processi per annotare un file come set di dati

La registrazione dei dati su larga scala richiede strumenti specifici e flussi di lavoro ben ponderatiEtichettare manualmente poche decine di immagini non è la stessa cosa che gestire centinaia di migliaia di esempi in diversi formati con team dislocati in vari fusi orari.

Nell'ambito della visione artificiale, si utilizzano soluzioni open-source come LabelImg (per i riquadri di delimitazione), CVAT (per l'annotazione complessa di immagini e video con funzionalità collaborative) o piattaforme commerciali come Labelbox o SuperAnnotate, che integrano analisi della qualità, gestione dei progetti e automazione. Per il testo, strumenti come Prodigy, LightTag, BRAT o Datasaur facilitano l'annotazione di entità, classificazioni, dipendenze sintattiche e relazioni, con un tracciamento dettagliato degli annotatori e dei conflitti.

Nell'ambito audio, software come Label Studio, Praat o Sonix consentono una segmentazione, trascrizione ed etichettatura precise dei suoni. Per i dati multimodali, progetti leggeri come VGG Image Annotator (VIA) o applicazioni come RectLabel offrono una base versatile per sincronizzare le annotazioni tra diversi tipi di dati. E per i progetti che richiedono volumi e velocità elevati, piattaforme come automazione e collaborazione su larga scala come ad esempio Amazon SageMaker Ground Truth, Scale AI, DataLoop o soluzioni collaborative come Digma o Hive Data.

La scelta di uno strumento non è solo una questione di preferenze personali: è necessario considerare il tipo di dati, il budget, le dimensioni del team, la necessità di collaborazione in tempo reale e la dimensione del set di dati. Quasi tutte le piattaforme avanzate includono funzionalità per la convalida delle regole di base, la gestione dei conflitti, la misurazione della produttività e della qualità e la combinazione di annotazioni umane con suggerimenti automatici generati da modelli preesistenti.

Oltre allo strumento stesso, la qualità è determinata dal processo. Fornire guide di annotazione molto chiare e aggiornateQuesto processo implica la formazione degli annotatori (soprattutto in settori sensibili come la medicina), l'organizzazione di revisioni incrociate, la definizione di metriche di qualità (accordo tra annotatori, accuratezza, richiamo) e l'utilizzo di dati "gold standard" validati da esperti per calibrare il team. Annotare un file come insieme di dati intellettuali non è un'operazione da completare in tempi brevi, ma un ciclo continuo e iterativo.

Molti progetti optano per un approccio ibrido: i compiti semplici o ripetitivi (ad esempio, il rilevamento preliminare degli oggetti o la pre-classificazione del testo) vengono automatizzati e il lavoro umano è riservato a casi ambigui, complessi o di grande impattoCiò riduce i costi senza compromettere la qualità e consente ai valutatori di concentrarsi sugli aspetti in cui possono apportare maggior valore aggiunto.

Applicazioni concrete di set di dati annotati e intellettuali

Trattare un file come un insieme di dati intellettuali non è un esercizio teorico: ha applicazioni molto concrete in molteplici settori in cui l'annotazione e la curatela sono fondamentali per implementare un'IA affidabile. Nella visione artificiale, ad esempio, gli insiemi di immagini e video annotati consentono lo sviluppo di sistemi di riconoscimento facciale, rilevamento di anomalie in raggi X o risonanze magnetiche, ispezioni automatizzate di fabbrica o veicoli autonomi che Identificano pedoni, segnali e ostacoli en tiempo reale.

Nell'elaborazione del linguaggio naturale, i dataset ben localizzati e annotati consentono attività come l'analisi del sentiment sui social media, la classificazione delle query nel servizio clienti, l'estrazione di entità nei documenti legali, la traduzione automatica o l'addestramento di chatbot che comprendono sfumature emotive e contesti culturaliUn archivio personale di articoli può diventare la base di un assistente specializzato che, prima di pubblicare qualcosa di nuovo, rivede quanto già detto, individua ripetizioni o identifica cambiamenti di stile nel corso degli anni.

La salute e la biotecnologia si affidano sempre più a set di dati altamente annotati: immagini mediche con diagnosi confermate, cartelle cliniche strutturate e sequenze genomiche etichettate con mutazioni rilevanti. Nel settore automobilistico e dei trasporti, i dati sono essenziali per la guida autonoma, la pianificazione intelligente dei percorsi e la gestione del traffico. Nel commercio e nel settore bancario, vengono utilizzati per Sistemi di raccomandazione prodotti, rilevamento frodi e analisi dei rischi.

Altri settori come l'agricoltura di precisione, l'ambiente, la sicurezza e la difesa, i videogiochi, la realtà virtuale, l'istruzione e la ricerca scientifica utilizzano set di dati annotati per monitorare le colture, analizzare immagini satellitari, creare esperienze immersive, personalizzare l'apprendimento o accelerare le scoperte in biologia o astrofisica. In tutti questi ambiti, la logica è simile: La struttura migliore e documentato (ad esempio, con file README) Quanto migliore è il set di dati, tanto migliori saranno i modelli progettati su di esso..

Se consideriamo il file come un insieme di dati intellettuali in una chiave personale, il valore risiede nel potere consulta al volo tutto ciò che sai e hai scrittoComprendere come si sono evolute le proprie idee, individuare lacune tematiche, collegare testi di epoche distanti e sfruttare questa memoria estesa in altri contesti, come l'insegnamento, la ricerca o la strategia aziendale. Tutto questo senza delegare la scrittura alla macchina, ma utilizzando l'intelligenza artificiale come strumento di supporto per verificare i dati, cercare riferimenti o testare le argomentazioni.

Dove trovare i dataset e come viene automatizzata la loro creazione

Non tutti i set di dati provengono da file personali: molti provengono da archivi aperti e fonti pubbliche Queste risorse sono utili per la formazione e la valutazione di modelli, per progetti di ricerca, giornalismo basato sui dati e analisi strategica. Internet offre già una vasta gamma di risorse che possono essere sfruttate, sempre nel rispetto delle norme legali ed etiche.

Il social network X (precedentemente Twitter), ad esempio, offre API che consentono agli utenti di raccogliere tweet filtrati per hashtag e altri criteri. Questi dati possono poi essere strutturati in tabelle e visualizzati con strumenti come Tableau. Google Dataset Search fornisce un motore di ricerca specializzato per dataset pubblici, dove gli utenti possono trovare di tutto, dai database aziendali alle statistiche di settore. Blog come FiveThirtyEight pubblicano i propri dataset su politica, sport e società in modo che chiunque possa replicare o ampliare le loro analisi.

Parallelamente, vengono utilizzati sempre di più ambienti simulati per generare automaticamente dati annotatiSoprattutto in settori come quello dei veicoli autonomi, dove ricreare tutte le condizioni della realtà nel mondo fisico sarebbe lento, costoso e pericoloso. I simulatori consentono la produzione di immagini e video con annotazioni perfette (posizioni degli oggetti, condizioni meteorologiche, traiettorie) e l'esplorazione di scenari estremi difficili da riprodurre con dati reali.

Il futuro indica una combinazione di dati reali curati, archivi personali trattati come corpora intellettuali e dati sintetici generati in simulazione, il tutto coordinato con tecniche di apprendimento supervisionato, semi-supervisionato, non supervisionato e auto-supervisionato. L'annotazione rimarrà un elemento chiave, ma sempre più supportata da modelli che Propongono etichette, individuano incongruenze e misurano i pregiudizi.lasciando le decisioni più importanti al popolo.

In questo contesto, la dimensione etica e normativa assume importanza: la gestione di file personali come dataset richiede il rispetto della privacy, del diritto d'autore e delle aspettative di utilizzo, mentre le piattaforme di crowdsourcing o di collaborazione di massa devono garantire condizioni eque per gli annotatori e trasparenza sui modelli addestrati con i dati che generano.

Quando l'intera catena viene gestita con cura, dall'estrazione di un file personale alla vettorializzazione, alla creazione di grafici, alla localizzazione, all'annotazione, all'automazione degli aggiornamenti e al collegamento con assistenti AI, si ottiene qualcosa che pochissimi autori, aziende o organizzazioni possiedono oggi: un insieme di dati intellettuali profondo, coerente e dinamicoin grado di alimentare sistemi di intelligenza artificiale realmente allineati con la voce, il contesto e gli obiettivi di coloro che li guidano, e di fungere da memoria estesa in un mondo sempre più saturo di informazioni.

Scrittore appassionato del mondo dei byte e della tecnologia in generale. Adoro condividere le mie conoscenze attraverso la scrittura, ed è quello che farò in questo blog, mostrarti tutte le cose più interessanti su gadget, software, hardware, tendenze tecnologiche e altro ancora. Il mio obiettivo è aiutarti a navigare nel mondo digitale in modo semplice e divertente.