- Mengubah sebuah berkas menjadi kumpulan data intelektual melibatkan vektorisasi korpus, membangun grafik hubungan, dan menghubungkan asisten AI untuk menjelajahinya guna mendapatkan ide.

- Kualitas, lokasi, dan evaluasi yang cermat terhadap dataset sama pentingnya dengan arsitektur model untuk mendapatkan AI yang andal dan kontekstual.

- Anotasi data, yang didukung oleh alat-alat khusus dan proses kontrol kualitas, mengubah berkas menjadi bahan mentah yang dapat dilatih untuk berbagai tugas.

- File pribadi, repositori terbuka, dan data simulasi digabungkan untuk menciptakan ekosistem kumpulan data yang dapat diterapkan pada sektor-sektor seperti kesehatan, transportasi, keuangan, atau pendidikan.

Konversikan file pribadi menjadi sebuah kumpulan data intelektual yang hidup dan bermanfaat Ini bukan lagi hanya untuk laboratorium besar: siapa pun yang telah menghasilkan konten digital selama bertahun-tahun dapat mengubah riwayat tersebut menjadi basis pengetahuan yang mudah dinavigasi dan bahan bakar untuk sistem kecerdasan buatan. Hal yang menarik bukanlah hanya menyimpan semua yang telah Anda tulis di format yang sesuaiNamun, tujuannya adalah agar karya-karya tersebut dapat berdialog satu sama lain, saling berhubungan, dan dapat dijadikan sumber ide, konteks, atau aktor, di luar sekadar pencarian berdasarkan kata kunci.

Lompatan dari file statis ke kumpulan data yang dikurasi, dianotasi, dan dapat dicari. Hal ini membuka pintu bagi berbagai penggunaan, mulai dari asisten pribadi yang dilatih menggunakan teks Anda sendiri hingga pembangunan model linguistik yang disesuaikan dengan budaya atau sektor tertentu. Dalam artikel ini, kami akan menjelaskan dengan tenang dan jelas apa artinya memperlakukan sebuah file sebagai kumpulan data intelektual, bagaimana konstruksi teknisnya, apa yang diperlukan untuk menerjemahkan atau memberi anotasi dengan benar, alat apa yang terlibat, dan dalam konteks dunia nyata apa hal itu sudah digunakan.

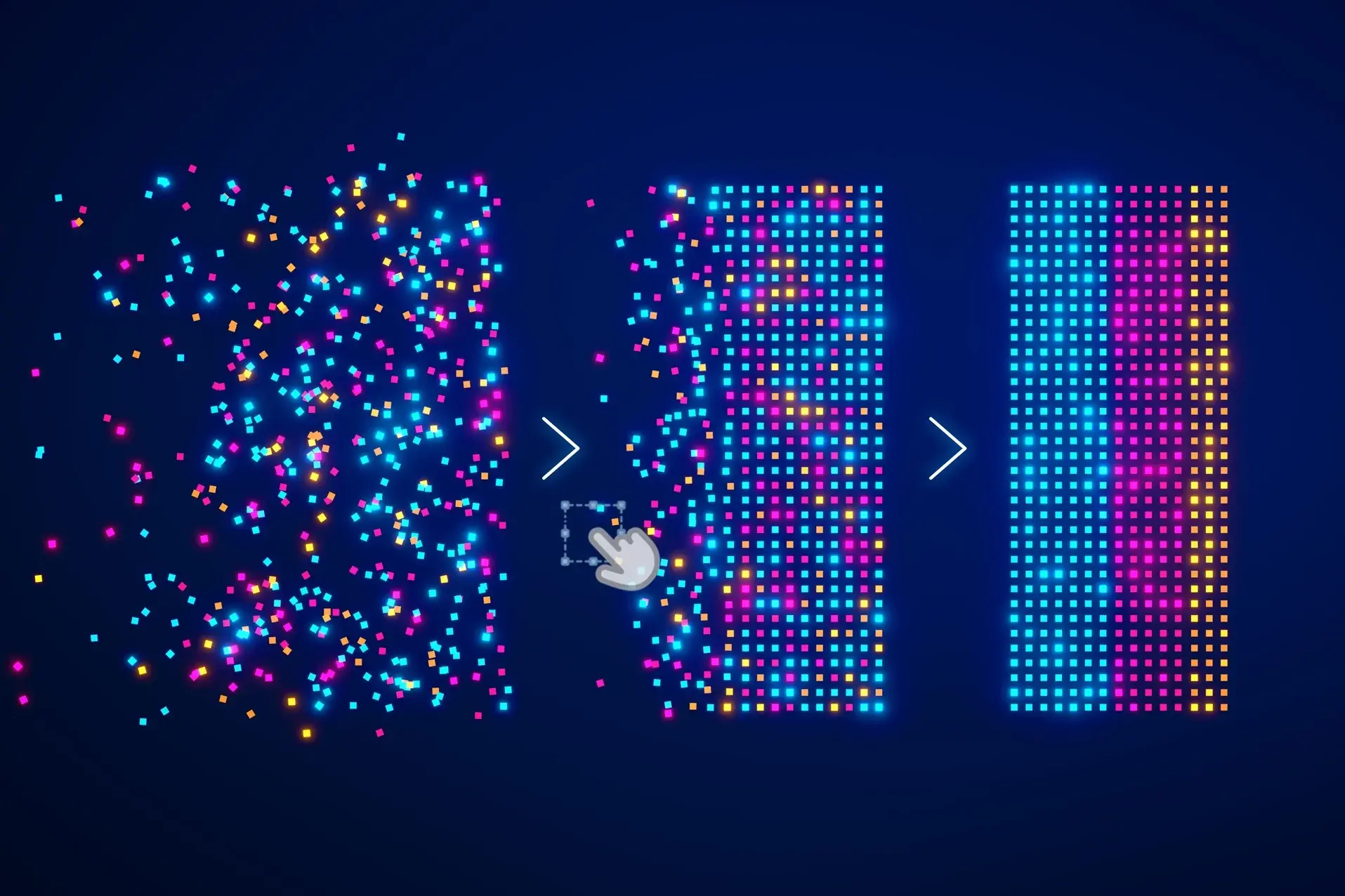

Dari arsip yang tersebar menjadi kumpulan data intelektual yang mudah dinavigasi.

Bayangkan Anda telah menulis artikel tentang [topik/topik] selama lebih dari satu dekade. teknologi, regulasi, privasi, atau kecerdasan buatan pada satu platform. Anda meminta salinan lengkap teks Anda (berkas teks biasa berisi ribuan dokumen) dan menerimanya dalam hitungan menit. Di atas kertas, berkas itu berharga: berkas itu merangkum proses berpikir Anda selama empat belas tahun. Tetapi selama berkas itu tetap berupa teks yang tidak terstruktur, Anda hanya dapat melakukan sedikit hal selain... cari berdasarkan kata-kata individual.

Pergeseran konseptual pertama melibatkan berhenti memandang berkas tersebut sebagai tumpukan dokumen dan mulai memperlakukannya sebagai sebuah korpus yang koheren yang dapat diindeks dan dieksplorasiIdenya adalah mengubah setiap artikel menjadi representasi numerik yang menangkap maknanya, menyimpan vektor-vektor tersebut dalam basis data khusus, dan membangun di atasnya sebuah grafik hubungan dan asisten yang memahami ruang semantik tersebut secara mendalam.

Dalam studi kasus dunia nyata yang melibatkan 4.209 artikel yang ditulis dalam bahasa Inggris selama empat belas tahun, penulis menggunakan model penyematan multibahasa (parafrase-multilingual-mpnet-base-v2, dari sentence-transformers) untuk mengubah setiap teks menjadi vektor 768 dimensi. Vektor-vektor ini disimpan di ChromaDB, sebuah basis data vektor sumber terbuka. Seluruh proses, yang dijalankan pada server standar tanpa GPU, selesai dalam waktu sekitar lima menit: file datar diubah menjadi ruang ide yang kontinu.

Dalam praktiknya, ini berarti Anda tidak lagi mencari "berdasarkan kata kunci" tetapi berdasarkan konsep, pertanyaan, atau fragmen teksAnda dapat mengajukan pertanyaan seperti "Kapan saya mulai menulis tentang monopoli teknologi?" atau "Artikel mana yang secara konseptual dekat dengan argumen ini?" dan sistem akan merespons dengan menemukan vektor terdekat dalam ruang semantik tersebut, meskipun vektor tersebut tidak memiliki kosakata yang sama. Ini adalah cara yang sangat langsung untuk memperluas ingatan Anda tentang karya Anda sendiri.

Sebuah grafik juga dibangun di atas lapisan vektor ini menggunakan NetworkX, di mana setiap simpul mewakili sebuah artikel dan tepinya menghubungkan teks-teks yang memiliki tag tematik yang sama atau melampaui ambang batas kesamaan semantik tertentu. Divisualisasikan dalam alat seperti Gephi, hasilnya adalah sebuah Peta hasil karya intelektual Anda yang dikelompokkan menjadi beberapa klaster.Regulasi, platform, privasi, kecerdasan buatan, mobilitas listrik… dan juga hubungan tak terduga antara teks-teks yang terpisah oleh tahun tetapi sangat dekat dalam ide-idenya.

Asisten pribadi yang bertindak sebagai gerbang menuju arsip.

Elemen kunci lainnya dari pendekatan ini adalah memiliki Asisten kecerdasan buatan yang terhubung dengan kumpulan data Anda. yang dapat beroperasi sebagai kolaborator berkelanjutan, bukan hanya chatbot sederhana di tab browser. Dalam contoh sebelumnya, asisten tersebut bernama Bautista: sebuah instance agen berbasis model Antropik (Claude Sonnet 4.6) tetapi mampu bekerja dengan model lain tergantung pada API yang digunakan.

Bautista berada di server milik penulis sendiri dan diatur menggunakan platform infrastruktur mirip OpenClaw, yang mengelola memori persisten antar sesi, saluran komunikasi (seperti Telegram), tugas terjadwal, dan akses ke alat-alat seperti sistem file dan eksekusi skrip. Berkat ini, asisten tersebut mempertahankan kesinambungan dari waktu ke waktuSistem ini mengingat proyek-proyek sebelumnya, menyimpan file, mengotomatiskan proses, dan dapat bertindak secara mandiri ketika diberi instruksi.

Perbedaannya dibandingkan dengan membuka templat umum di browser adalah di sini kita tidak hanya berbicara tentang obrolan biasa, tetapi sesuatu yang lebih seperti... kolaborator terintegrasi dalam infrastruktur Anda, yang terspesialisasi dalam korpus Anda sendiri dan mampu bertindak sebagai perantara antara file vektorisasi tersebut dan kebutuhan harian Anda: menemukan teks, mendeteksi redundansi, mengambil kutipan, menjalankan analisis spesifik, atau meluncurkan skrip pemeliharaan.

Selain itu, sistem ini dirancang untuk menjaga agar arsip tetap aktif tanpa intervensi manual. Setiap kali penulis menerbitkan artikel baru di Medium dan membagikan tautan akses penuh di Bluesky, proses terjadwal akan melakukan query ke API publik Bluesky setiap hari, mendeteksi entri baru, mengunduh teks, menghasilkan kode sematan, dan menambahkannya ke ChromaDB. Pipeline otomatis memastikan bahwa dataset memperbarui dirinya sendiri., berkat tugas-tugas pengindeksan berkasmenghindari masalah klasik basis pengetahuan yang menjadi usang karena memperbaruinya merupakan pekerjaan yang melelahkan.

Pada fase selanjutnya, lapisan analisis baru ditambahkan, seperti pengenalan entitas bernama (orang, perusahaan, teknologi, negara, institusi) di seluruh korpus, dengan tujuan untuk mempelajari Evolusi temporal penyebutan dan jaringan kemunculan bersama.Berkat hal ini, dimungkinkan untuk melihat kapan aktor seperti OpenAI muncul dalam teks, kapan Google+ menghilang, atau bagaimana berbagai agen saling berhubungan dari waktu ke waktu, sehingga sistem ini lebih mendekati analisis wacana skala besar daripada sekadar arsip pribadi.

Kumpulan data, model, dan perilaku: berkas sebagai bahan mentah untuk AI.

Dalam konteks kecerdasan buatan, sebuah Kumpulan data jauh lebih dari sekadar kumpulan data.Ini adalah materi pelatihan yang membentuk perilaku model. Dalam pemrosesan bahasa alami (NLP), dataset ini biasanya berupa teks, dialog, instruksi, atau anotasi yang memungkinkan model untuk belajar menerjemahkan, meringkas, bercakap-cakap, atau mengklasifikasikan emosi, di antara tugas-tugas lainnya.

Selama bertahun-tahun, penekanan hampir secara eksklusif ditempatkan pada arsitektur model (jumlah parameter, jenis lapisan, kapasitas komputasi), tetapi pengalaman baru-baru ini menunjukkan bahwa kualitas, keragaman, dan kesesuaian data pelatihan Bobotnya sama pentingnya, atau bahkan lebih penting, daripada desain model itu sendiri. Seperti yang ditunjukkan oleh studi-studi seperti yang dilakukan oleh Bender dkk. atau Paullada dkk., model tidak akan lebih baik daripada data yang digunakan: jika dataset bias, tidak lengkap, atau tidak representatif, AI akan mereproduksi kekurangan yang sama.

Perubahan perspektif ini telah mendorong pergerakan yang jelas menuju kualitas daripada kuantitasIni bukan hanya tentang mengumpulkan volume teks yang sangat besar, tetapi juga tentang memastikan bahwa data ini selaras dengan bahasa, variasi regional, dan konteks budaya di mana AI akan diterapkan (Blasi dkk., Kreutzer dkk.). Hal ini sangat relevan jika kita menganggap arsip sebagai kumpulan data intelektual: korpus pribadi seorang penulis bisa sangat kaya, tetapi jika kemudian akan digunakan untuk model yang beroperasi dalam bahasa atau pasar lain, kurasi dan adaptasi menjadi sangat penting.

Selain itu, dataset ini tidak hanya berguna untuk pelatihan, tetapi juga untuk... mengevaluasi kinerja modelJika suatu model dievaluasi menggunakan data yang telah dilihatnya selama pelatihan (kontaminasi data), maka akan diperoleh metrik yang menyesatkan yang menutupi keterbatasan sebenarnya, seperti yang dianalisis oleh Dong dkk. dan Samuel dkk. Oleh karena itu, ketika mentransfer file pribadi ke konteks AI, sangat penting untuk membedakan bagian mana yang digunakan untuk pelatihan, bagian mana untuk validasi, dan bagian mana untuk pengujian, serta untuk merancang rangkaian evaluasi yang kaya dan menantang, daripada tes sepele yang dilewati semua model.

Menerjemahkan dan melokalisasi kumpulan data: lebih dari sekadar mentransfer teks dari satu bahasa ke bahasa lain.

Saat Anda ingin menggunakan kembali file seperti Kumpulan data intelektual dalam beberapa bahasa atau pasar.Tantangan spesifik kemudian muncul: penerjemahan dan lokalisasi korpus. Sekilas, ini mungkin tampak seperti proyek penerjemahan biasa, tetapi kumpulan data AI sering kali terdiri dari fragmen-fragmen terisolasi, dialog lepas, instruksi singkat, atau data terstruktur tanpa konteks naratif yang jelas, yang sepenuhnya mengubah aturan mainnya.

Dalam banyak dataset kita menemukan konteks yang sangat terbatasIni adalah frasa tanpa informasi tentang siapa yang berbicara, situasinya, atau maksud mereka. Penerjemah harus menyimpulkan fungsi pragmatis (perintah, keraguan, penghinaan, ironi) agar model dapat mempelajari perilaku dengan benar dalam bahasa target. Selain itu, ada elemen yang tidak boleh diubah, seperti cuplikan kode, variabel, placeholder, atau label teknis, di mana terjemahan yang naif dapat merusak dataset.

Konsistensi massal juga berperan: keputusan yang tampaknya kecil, seperti memilih antara "tú" atau "usted," menangani gender inklusif, atau perlakuan terhadap Anglisisme tertentu, Jumlah contoh tersebut dikalikan dengan jutaan.Ketidakkonsistenan yang mungkin tidak disadari dalam sebuah buku menjadi gangguan di sini yang diinternalisasi oleh model. Dan, tidak seperti dalam terjemahan editorial, seringkali lebih baik untuk mempertahankan kesalahan tata bahasa atau ungkapan sehari-hari sebagaimana adanya, karena tujuannya bukan untuk "memoles" teks, tetapi untuk mengajari AI bagaimana orang sebenarnya mengekspresikan diri.

Oleh karena itu, daripada menerjemahkan, lebih tepat untuk membicarakannya. menemukan kumpulan dataHal ini melibatkan adaptasi referensi budaya, nama institusi, merek, format tanggal, mata uang, dan satuan pengukuran, serta penyesuaian ragam bahasa dengan norma sosial pasar sasaran. Dalam model bahasa yang besar, lokalisasi inilah yang membedakan AI yang hanya "berbicara bahasa Spanyol" dari AI yang memahami nuansa budaya, harapan kesopanan, dan referensi lokal.

Perusahaan-perusahaan dengan sejarah panjang di bidang perangkat lunak dan lokalisasi konten, seperti imaxin, telah berevolusi ke arah tersebut. penerjemahan dan kurasi spesifik dari kumpulan dataDengan menggabungkan keahlian manusia, panduan gaya yang disempurnakan, glosarium yang dikurasi, dan alat bantu penerjemahan berbantuan komputer dan mesin, pendekatan mereka lebih menyerupai proses kontrol kualitas data daripada penerjemahan tradisional: definisi yang tepat tentang kriteria linguistik dan teknis, pengelolaan kesalahan yang disengaja, penggunaan QA otomatis, dan pengambilan sampel statistik untuk memantau konsistensi.

Dataset beranotasi: memberikan struktur dan makna pada data.

Agar sebuah file menjadi Kumpulan data intelektual yang benar-benar bermanfaat untuk model supervised learning.Mengumpulkan teks saja tidak cukup: teks tersebut harus dianotasi. Kumpulan data yang dianotasi adalah kumpulan data di mana setiap elemen (gambar, fragmen audio, kalimat, tabel) telah diberi metadata yang menjelaskan konten atau fungsinya: tag, kategori, entitas, relasi, transkrip, kotak pembatas, dll.

Dalam visi komputer, misalnya, anotasi dapat mencakup label klasifikasi global, kotak pembatas di sekitar objek, masker segmentasi yang menetapkan kategori untuk setiap piksel, anotasi titik-titik kunci (sendi manusia, titik-titik wajah), atau lintasan sepanjang video. Dalam teks, kita berbicara tentang entri entitas bernama (orang, organisasi, tempat), klasifikasi dokumen, analisis sintaksis, hubungan antar entitas, atau tag sentimen.

Tujuan dari semua pekerjaan ini adalah agar model-model tersebut memiliki contoh-contoh yang jelas tentang apa yang seharusnya mereka kenali atau prediksi.Kumpulan data gambar beranotasi yang berisi kucing, mobil, dan pejalan kaki memungkinkan pelatihan model yang mendeteksi dan mengklasifikasikan objek-objek ini; kumpulan data percakapan dengan tag maksud dan emosi memungkinkan pelatihan chatbot dan sistem analisis sentimen; korpus dokumen dengan entitas yang ditandai dan hubungan eksplisit meletakkan dasar untuk sistem ekstraksi pengetahuan.

Anotasi tidak terbatas pada teks atau gambar: dalam audio, tugas-tugasnya meliputi transkripsi, pemberian tag pada peristiwa suara (tepuk tangan, tawa, tembakan), segmentasi berdasarkan pembicara, dan pemberian cap waktu pada kata kunci. Dan dalam data multimodal (video dengan audio dan subtitle, misalnya), pekerjaan dilakukan untuk menyelaraskan modalitas dan memberi anotasi pada interaksi secara bersamaan (ekspresi wajah ditambah nada suara ditambah konten tekstual).

Dalam ranah data terstruktur dan tabular, anotasi juga berarti Jelaskan arti kolom dan nilai.Ini termasuk menghubungkan entri yang setara di berbagai basis data atau menandai atribut yang relevan untuk tugas prediksi. Setiap jenis proyek akan memilih satu atau beberapa set anotasi, dan seringkali beberapa digabungkan untuk mencakup kasus penggunaan yang kompleks.

Alat dan proses untuk memberi anotasi pada file sebagai kumpulan data.

Perekaman data dalam skala besar membutuhkan alat khusus dan alur kerja yang dipikirkan dengan matangMemberi label pada beberapa lusin gambar secara manual tidak sama dengan mengelola ratusan ribu contoh dalam berbagai format dengan tim yang tersebar di beberapa zona waktu.

Dalam visi komputer, solusi sumber terbuka seperti LabelImg (untuk kotak pembatas), CVAT (untuk anotasi gambar dan video kompleks dengan fitur kolaboratif), atau platform komersial seperti Labelbox atau SuperAnnotate digunakan, yang menggabungkan analitik kualitas, manajemen proyek, dan otomatisasi. Untuk teks, alat seperti Prodigy, LightTag, BRAT, atau Datasaur memfasilitasi anotasi entitas, klasifikasi, ketergantungan sintaksis, dan hubungan, dengan pelacakan detail annotator dan konflik.

Dalam bidang audio, perangkat lunak seperti Label Studio, Praat, atau Sonix memungkinkan segmentasi, transkripsi, dan pelabelan suara yang presisi. Untuk data multimodal, proyek ringan seperti VGG Image Annotator (VIA) atau aplikasi seperti RectLabel menawarkan fondasi serbaguna untuk menyinkronkan anotasi di berbagai jenis data. Dan untuk proyek yang membutuhkan volume dan kecepatan tinggi, platform seperti otomatisasi dan kolaborasi besar-besaran seperti Amazon SageMaker Ground Truth, Scale AI, DataLoop atau solusi kolaboratif seperti Digma atau Hive Data.

Memilih alat bukan hanya soal preferensi pribadi: Anda perlu mempertimbangkan jenis data, anggaran, ukuran tim, kebutuhan kolaborasi waktu nyata, dan ukuran dataset. Hampir semua platform canggih menyertakan fitur untuk memvalidasi aturan dasar, mengelola konflik, mengukur produktivitas dan kualitas, serta menggabungkan anotasi manusia dengan saran otomatis yang dihasilkan oleh model yang sudah ada.

Di luar alat itu sendiri, kualitas ditentukan oleh prosesnya. Menyediakan panduan anotasi yang sangat jelas dan terkiniHal ini melibatkan pelatihan annotator (terutama di bidang sensitif seperti kedokteran), pengorganisasian tinjauan silang, penetapan metrik kualitas (kesepakatan antar annotator, akurasi, recall), dan penggunaan data "standar emas" yang divalidasi oleh para ahli untuk mengkalibrasi tim. Memberi anotasi pada sebuah file sebagai kumpulan data intelektual bukanlah sebuah perlombaan cepat, melainkan siklus iteratif yang berkelanjutan.

Banyak proyek memilih pendekatan hibrida: tugas-tugas sederhana atau berulang (misalnya, deteksi objek awal atau pra-klasifikasi teks) diotomatiskan, dan pekerjaan manusia dikhususkan untuk tugas-tugas yang membutuhkan keahlian teknis. kasus yang ambigu, kompleks, atau berdampak tinggiHal ini mengurangi biaya tanpa mengorbankan kualitas dan memungkinkan pencetak gol untuk fokus pada area di mana mereka dapat memberikan nilai tambah terbesar.

Penerapan nyata dari kumpulan data beranotasi dan intelektual.

Memperlakukan sebuah file sebagai kumpulan data intelektual bukanlah latihan teoretis: hal ini memiliki aplikasi yang sangat konkret di berbagai sektor di mana anotasi dan kurasi merupakan kunci untuk menerapkan AI yang andal. Dalam visi komputer, misalnya, kumpulan gambar dan video yang dianotasi memungkinkan pengembangan sistem pengenalan wajah, deteksi anomali dalam sinar-X atau MRI, inspeksi pabrik otomatis, atau kendaraan otonom yang Mereka mengidentifikasi pejalan kaki, rambu-rambu, dan rintangan. en tiempo nyata.

Dalam pemrosesan bahasa alami, kumpulan data yang terlokalisasi dan dianotasi dengan baik memungkinkan tugas-tugas seperti analisis sentimen di media sosial, klasifikasi pertanyaan dalam layanan pelanggan, ekstraksi entitas dalam dokumen hukum, penerjemahan mesin, atau pelatihan chatbot yang memahami bahasa. nuansa emosional dan konteks budayaArsip pribadi berupa artikel dapat menjadi dasar bagi seorang asisten khusus yang, sebelum menerbitkan sesuatu yang baru, meninjau kembali apa yang telah dikatakan sebelumnya, mendeteksi pengulangan, atau mengidentifikasi perubahan sikap selama bertahun-tahun.

Bidang kesehatan dan bioteknologi semakin bergantung pada kumpulan data yang dianotasi secara detail: citra medis dengan diagnosis yang terkonfirmasi, catatan klinis terstruktur, dan sekuens genom yang diberi label dengan mutasi yang relevan. Di bidang otomotif dan transportasi, data sangat penting untuk pengemudian otonom, perencanaan rute cerdas, dan manajemen lalu lintas. Di bidang perdagangan dan perbankan, data digunakan untuk... Sistem rekomendasi produk, deteksi penipuan, dan analisis risiko..

Bidang lain seperti pertanian presisi, lingkungan, keamanan dan pertahanan, permainan video, realitas virtual, pendidikan, dan penelitian ilmiah menggunakan kumpulan data beranotasi untuk memantau tanaman, menganalisis citra satelit, menciptakan pengalaman imersif, mempersonalisasi pembelajaran, atau mempercepat penemuan di bidang biologi atau astrofisika. Dalam semua bidang tersebut, logikanya serupa: Semakin terstruktur dan baik didokumentasikan (misalnya, dengan File README) Semakin baik datasetnya, semakin baik pula model yang dirancang berdasarkan dataset tersebut..

Jika kita memandang file tersebut sebagai kumpulan data intelektual dalam kunci pribadi, nilainya terletak pada kekuasaan. Konsultasikan secara langsung semua yang Anda ketahui dan telah tulis.Memahami bagaimana ide-ide Anda telah berkembang, menemukan kesenjangan tematik, menghubungkan teks dari periode yang berbeda, dan memanfaatkan memori yang lebih luas tersebut dalam konteks lain, seperti pengajaran, penelitian, atau strategi bisnis. Semua ini tanpa mendelegasikan penulisan kepada mesin, melainkan menggunakan AI sebagai alat pendukung untuk memverifikasi data, mencari referensi, atau menguji argumen.

Di mana menemukan kumpulan data dan bagaimana pembuatannya diotomatiskan.

Tidak semua kumpulan data berasal dari file pribadi: banyak yang berasal dari repositori terbuka dan sumber publik Sumber daya ini berguna untuk pelatihan dan evaluasi model, atau untuk proyek penelitian, jurnalisme data, dan analisis strategis. Internet sudah menawarkan banyak sekali sumber daya yang dapat dimanfaatkan, selalu dengan mempertimbangkan aspek hukum dan etika.

Jejaring sosial X (sebelumnya Twitter), misalnya, menawarkan API yang memungkinkan pengguna untuk mengumpulkan tweet yang difilter berdasarkan tagar dan kriteria lainnya. Data ini kemudian dapat disusun ke dalam tabel dan divisualisasikan dengan alat seperti Tableau. Google Dataset Search menyediakan mesin pencari khusus untuk kumpulan data publik, di mana pengguna dapat menemukan segala sesuatu mulai dari basis data perusahaan hingga statistik industri. Blog seperti FiveThirtyEight menerbitkan kumpulan data mereka tentang politik, olahraga, dan masyarakat sehingga siapa pun dapat mereplikasi atau memperluas analisis mereka.

Seiring dengan itu, penggunaannya semakin meningkat. lingkungan simulasi untuk secara otomatis menghasilkan data beranotasiTerutama di bidang seperti kendaraan otonom, di mana menciptakan kembali semua kondisi realitas di dunia fisik akan lambat, mahal, dan berbahaya. Simulator memungkinkan produksi gambar dan video dengan anotasi sempurna (posisi objek, kondisi cuaca, lintasan) dan eksplorasi skenario ekstrem yang sulit ditangkap dalam data dunia nyata.

Masa depan mengarah pada kombinasi data dunia nyata yang dikurasi, arsip pribadi yang diperlakukan sebagai korpus intelektual, dan data sintetis yang dihasilkan dalam simulasi, semuanya dikoordinasikan dengan teknik pembelajaran terawasi, semi-terawasi, tak terawasi, dan mandiri. Anotasi akan tetap menjadi elemen kunci, tetapi semakin dibantu oleh model yang Mereka mengusulkan label, mendeteksi ketidakkonsistenan, dan mengukur bias.menyerahkan keputusan-keputusan yang lebih detail kepada rakyat.

Dalam konteks ini, dimensi etika dan regulasi menjadi penting: menangani file pribadi sebagai kumpulan data memerlukan penghormatan terhadap privasi, hak cipta, dan harapan penggunaan, sementara platform crowdsourcing atau kolaborasi massal harus memastikan kondisi yang adil bagi pemberi anotasi dan transparansi tentang model mana yang dilatih dengan data yang mereka hasilkan.

Ketika seluruh rantai ini dikelola dengan cermat—mulai dari mengekstrak file pribadi hingga membuat vektor, grafik, menemukan lokasi, memberi anotasi, mengotomatiskan pembaruan, dan menghubungkannya ke asisten AI—Anda akan mendapatkan sesuatu yang sangat sedikit dimiliki oleh penulis, perusahaan, atau organisasi saat ini: sebuah kumpulan data intelektual yang mendalam, konsisten, dan terkini.mampu menggerakkan sistem kecerdasan buatan yang benar-benar selaras dengan suara, konteks, dan tujuan dari mereka yang menggerakkannya, dan berfungsi sebagai memori tambahan di dunia yang semakin jenuh dengan informasi.

Penulis yang bersemangat tentang dunia byte dan teknologi secara umum. Saya suka berbagi ilmu melalui tulisan, dan itulah yang akan saya lakukan di blog ini, menunjukkan kepada Anda semua hal paling menarik tentang gadget, perangkat lunak, perangkat keras, tren teknologi, dan banyak lagi. Tujuan saya adalah membantu Anda menavigasi dunia digital dengan cara yang sederhana dan menghibur.