- Transformacija datoteke u intelektualni skup podataka uključuje vektorizaciju korpusa, izgradnju grafova odnosa i povezivanje AI asistenta za istraživanje u potrazi za idejama.

- Kvaliteta, lokacija i rigorozna evaluacija skupa podataka jednako su ključni kao i arhitektura modela za dobivanje pouzdane i kontekstualizirane umjetne inteligencije.

- Anotacija podataka, podržana specifičnim alatima i procesima kontrole kvalitete, pretvara datoteku u sirovi materijal pogodan za učenje za više zadataka.

- Osobne datoteke, otvoreni repozitoriji i simulirani podaci kombiniraju se kako bi se stvorili ekosustavi skupova podataka primjenjivi na sektore poput zdravstva, prometa, financija ili obrazovanja.

Pretvori osobnu datoteku u živi i koristan intelektualni skup podataka Više nije samo za velike laboratorije: svatko tko godinama proizvodi digitalni sadržaj može transformirati tu povijest u lako razumljivu bazu znanja i gorivo za sustave umjetne inteligencije. Zanimljivo je ne samo spremati sve što ste napisali u pogodan formatveć da ti dijelovi međusobno dijalogiziraju, da se međusobno povezuju i da se s njima može konzultirati za ideje, kontekste ili aktere, izvan jednostavnog pretraživanja ključnim riječima.

Taj skok iz statičke datoteke u odabrani, komentirani i pretraživi skup podataka To otvara vrata različitim primjenama, od osobnog asistenta obučenog za vlastite tekstove do konstrukcije lingvističkih modela prilagođenih određenoj kulturi ili sektoru. U ovom ćemo članku smireno i jasno objasniti što znači tretirati datoteku kao intelektualni skup podataka, kako je tehnički konstruirana, što podrazumijeva njezino pravilno prevođenje ili označavanje, koji su alati uključeni i u kojim se stvarnim kontekstima već koristi.

Od raspršene arhive do lako razumljivog intelektualnog skupa podataka

Zamislite da pišete članke o [temi/predmetu] već više od desetljeća tehnologija, propisi, privatnost ili umjetna inteligencija na jednoj platformi. Zatražite potpuni dump vaših tekstova (obična tekstualna datoteka s tisućama dokumenata) i primite ga za nekoliko minuta. Na papiru, ta je datoteka vrijedna: ona obuhvaća četrnaest godina vašeg misaonog procesa. Ali sve dok ostaje samo nestrukturirani tekst, možete učiniti malo više od... pretraživanje po pojedinačnim riječima.

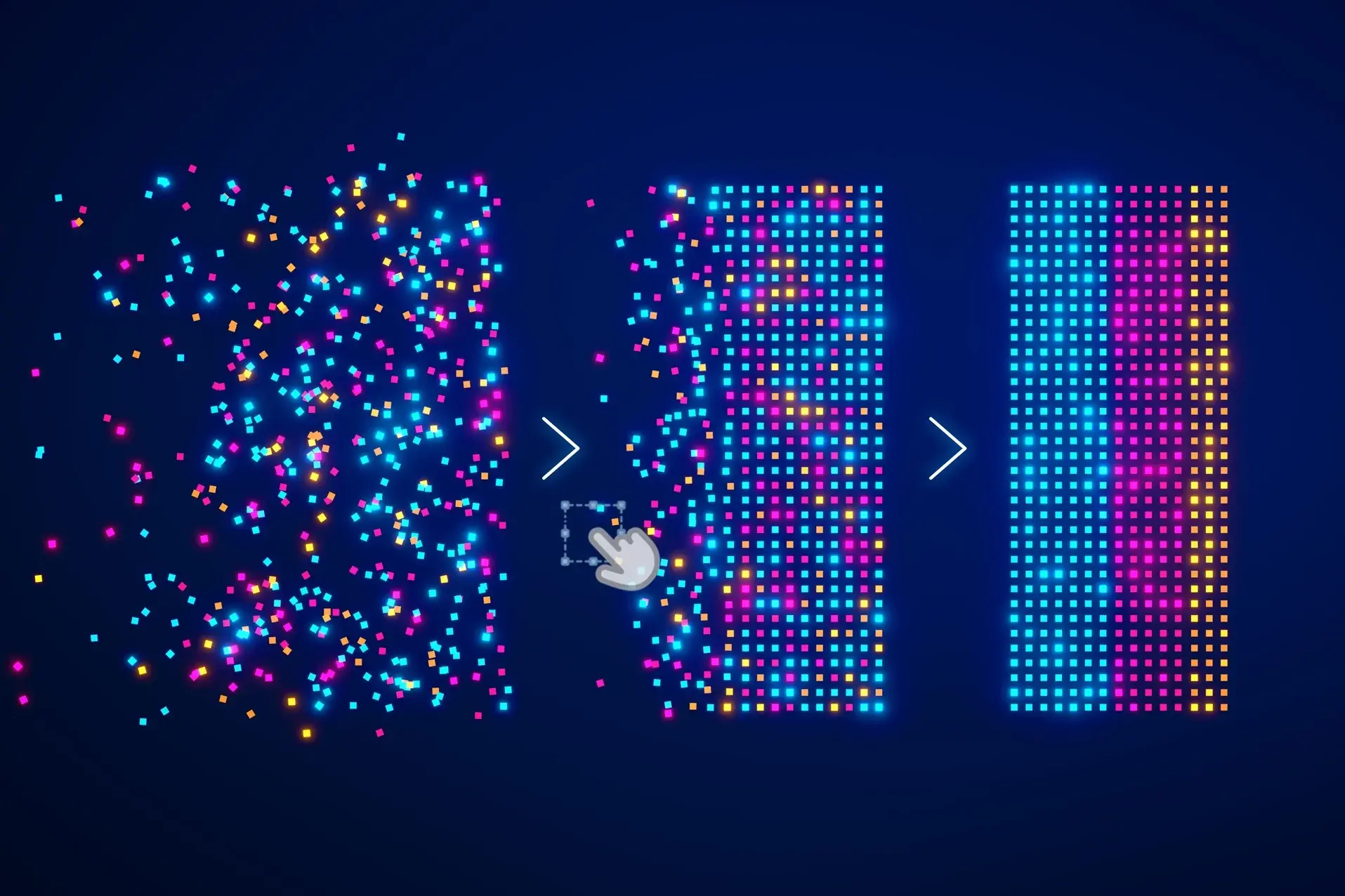

Prva konceptualna promjena uključuje prestanak gledanja na tu datoteku kao na hrpu dokumenata i početak tretiranja nje kao koherentni korpus koji se može indeksirati i istraživatiIdeja je transformirati svaki članak u numerički prikaz koji obuhvaća njegovo značenje, pohraniti te vektore u specijaliziranu bazu podataka i na njima izgraditi graf odnosa i asistenta koji intimno razumije taj semantički prostor.

U studiji slučaja iz stvarnog svijeta koja je uključivala 4.209 članaka napisanih na engleskom jeziku tijekom četrnaest godina, autor je koristio model višejezična ugrađivanja (paraphrase-multilingual-mpnet-base-v2, iz sentence-transformers) za pretvaranje svakog teksta u 768-dimenzionalni vektor. Ti su vektori pohranjeni u ChromaDB-u, vektorskoj bazi podataka otvorenog koda. Cijeli proces, pokrenut na standardnom poslužitelju bez GPU-a, završen je za otprilike pet minuta: ravna datoteka transformirana je u kontinuirani prostor ideja.

U praksi to znači da više ne pretražujete "po ključnim riječima" već konceptima, pitanjima ili fragmentima tekstaMožete postavljati upite poput „Kada sam počeo pisati o tehnološkim monopolima?“ ili „Koji su članci konceptualno bliski ovom argumentu?“, a sustav reagira lociranjem najbližih vektora u tom semantičkom prostoru, čak i ako ne dijele isti vokabular. To je vrlo izravan način proširenja pamćenja o vlastitom radu.

Graf je također konstruiran na vrhu ovog vektorskog sloja pomoću NetworkX-a, gdje svaki čvor predstavlja članak, a rubovi povezuju tekstove koji dijele tematske oznake ili prelaze određeni prag semantičke sličnosti. Vizualizirano u alatima poput Gephija, rezultat je mapa vašeg intelektualnog rada organizirana u klastereRegulacija, platforme, privatnost, umjetna inteligencija, električna mobilnost… i također neočekivane veze između tekstova razdvojenih godinama, ali vrlo bliskih idejama.

Agentski osobni asistent kao ulaz u arhivu

Drugi ključni element ovog pristupa je imati Pomoćnik za umjetnu inteligenciju usidren u vaš skup podataka koji može funkcionirati kao kontinuirani suradnik, a ne samo kao jednostavan chatbot u kartici preglednika. U prethodnom primjeru, taj se asistent zvao Bautista: agentska instanca temeljena na antropskim modelima (Claude Sonnet 4.6), ali sposobna za rad s drugim modelima ovisno o korištenom API-ju.

Bautista se nalazi na autorovom vlastitom poslužitelju i orkestriran je pomoću infrastrukturne platforme slične OpenClawu, koja upravlja perzistentnom memorijom između sesija, komunikacijskim kanalima (kao što je Telegram), zakazanim zadacima i pristupom alatima poput datotečnog sustava i izvršavanja skripti. Zahvaljujući tome, pomoćnik održava kontinuitet tijekom vremenaPamti prethodne projekte, čuva datoteke, automatizira procese i može djelovati autonomno kada se dobije uputa.

Razlika u usporedbi s otvaranjem generičkog predloška u pregledniku je u tome što ovdje ne govorimo o samo još jednom chatu, već o nečemu poput ugrađeni suradnik u vašoj infrastrukturi, specijaliziran za vaš vlastiti korpus i sposoban djelovati kao posrednik između te vektorizirane datoteke i vaših svakodnevnih potreba: lociranja tekstova, otkrivanja redundancija, dohvaćanja citata, izvršavanja specifičnih analiza ili pokretanja skripti za održavanje.

Nadalje, sustav je dizajniran tako da arhivu održava aktivnim bez ručne intervencije. Svaki put kada autor objavi novi članak na Mediumu i podijeli poveznicu za puni pristup na Blueskyju, planirani proces svakodnevno šalje upit javnom Bluesky API-ju, detektira novi unos, preuzima tekst, generira njegov kod za ugradnju i dodaje ga u ChromaDB. Automatizirani cjevovod osigurava da se skup podataka sam ažurira., zahvaljujući zadacima indeksiranje datotekaizbjegavajući klasičan problem zastarjevanja baza znanja jer je njihovo ažuriranje mukotrpan posao.

U kasnijoj fazi dodani su novi slojevi analize, poput prepoznavanja imenovanih entiteta (ljudi, tvrtki, tehnologija, država, institucija) u cijelom korpusu, s ciljem proučavanja vremenska evolucija spominjanja i mreža istovremene pojaveZahvaljujući tome, moguće je vidjeti kada se akter poput OpenAI-a pojavljuje u tekstovima, kada Google+ nestaje ili kako se različiti agenti međusobno odnose tijekom vremena, što sustav približava analizi diskursa velikih razmjera nego jednostavnoj osobnoj arhivi.

Skup podataka, model i ponašanje: datoteka kao sirovina za umjetnu inteligenciju

U kontekstu umjetne inteligencije, a Skup podataka je mnogo više od skupa podatakaOvo je materijal za učenje koji oblikuje ponašanje modela. U obradi prirodnog jezika (NLP), ovaj skup podataka obično ima oblik tekstova, dijaloga, uputa ili napomena koje omogućuju modelima da nauče prevoditi, sažimati, komunicirati ili klasificirati emocije, između ostalog.

Godinama se naglasak stavljao gotovo isključivo na arhitekturu modela (broj parametara, vrsta slojeva, računalni kapacitet), ali nedavna iskustva su pokazala da kvaliteta, raznolikost i prikladnost podataka za obuku Teži jednako kao i dizajn modela, ili čak i više. Kao što ističu studije poput onih Bendera i suradnika ili Paullade i suradnika, modeli nisu ništa bolji od podataka koji ih hrane: ako je skup podataka pristran, nepotpun ili nereprezentativan, umjetna inteligencija će reproducirati iste te nedostatke.

Ova promjena perspektive potaknula je jasan pokret prema kvaliteta nad kvantitetomNe radi se samo o prikupljanju ogromnih količina teksta, već o osiguravanju da su ti podaci usklađeni s jezikom, regionalnom raznolikošću i kulturnim kontekstom u kojem će se umjetna inteligencija primijeniti (Blasi i sur., Kreutzer i sur.). To je posebno važno ako arhivu promatramo kao intelektualni skup podataka: autorov osobni korpus može biti vrlo bogat, ali ako se zatim koristi za modele koji funkcioniraju na drugim jezicima ili tržištima, kuriranje i prilagodba postaju ključne.

Nadalje, skup podataka nije koristan samo za obuku, već i za procijeniti performanse modelaAko se model evaluira korištenjem podataka koje je već vidio tijekom obuke (kontaminacija podataka), dobivaju se zavaravajuće metrike koje prikrivaju njegova stvarna ograničenja, kako su analizirali Dong i suradnici te Samuel i suradnici. Stoga je prilikom prijenosa osobne datoteke u kontekst umjetne inteligencije ključno razlikovati koji se dijelovi koriste za obuku, koji za validaciju, a koji za testiranje, kao i dizajnirati bogate i izazovne skupove za evaluaciju, a ne trivijalne testove koje svi modeli prolaze.

Prevođenje i lokalizacija skupova podataka: puno više od pukog prijenosa teksta iz jednog jezika u drugi

Kada želite ponovno upotrijebiti datoteku poput Intelektualni skup podataka na nekoliko jezika ili tržištaTada se javlja specifičan izazov: prijevod i lokalizacija korpusa. Na prvi pogled može se činiti kao još jedan prijevodni projekt, ali skup podataka umjetne inteligencije često se sastoji od izoliranih fragmenata, labavih dijaloga, kratkih uputa ili strukturiranih podataka bez jasnog narativnog konteksta, što potpuno mijenja pravila igre.

U mnogim skupovima podataka nalazimo vrlo ograničen kontekstTo su fraze bez informacija o tome tko govori, o situaciji ili njihovoj namjeri. Prevoditelj mora zaključiti pragmatičke funkcije (naredba, sumnja, uvreda, ironija) kako bi model mogao pravilno naučiti ponašanje u ciljanom jeziku. Osim toga, postoje elementi koji se ne smiju dirati, poput isječaka koda, varijabli, rezerviranih mjesta ili tehničkih oznaka, gdje naivan prijevod može narušiti skup podataka.

Masovna dosljednost također dolazi do izražaja: naizgled male odluke, poput izbora između "tú" ili "usted", rukovanja uključivim rodom ili tretiranja određenih anglicizama, Množe ih milijuni primjeraka.Nedosljednost koja bi mogla proći nezapaženo u knjizi ovdje postaje šum koji model internalizira. I, za razliku od uredničkog prijevoda, često je najbolje zadržati gramatičke pogreške ili kolokvijalizme kakvi se pojavljuju, jer cilj nije "polirati" tekst, već naučiti umjetnu inteligenciju kako se ljudi zapravo izražavaju.

Stoga je, umjesto prevođenja, prikladnije govoriti o lociranje skupova podatakaTo uključuje prilagodbu kulturnih referenci, naziva institucija, robnih marki, formata datuma, valuta i mjernih jedinica te prilagođavanje registra društvenim normama ciljnog tržišta. U velikim jezičnim modelima, ova lokalizacija je ono što razlikuje umjetnu inteligenciju koja jednostavno "govori španjolski" od one koja razumije kulturne nijanse, očekivanja pristojnosti i lokalne reference.

Tvrtke s dugom poviješću u lokalizaciji softvera i sadržaja, poput imaxina, razvijaju se prema prijevod i specifična kuracija skupova podatakaKombinirajući ljudsko stručno znanje, fino podešene stilske vodiče, odabrane glosare te alate za računalno i strojno prevođenje, njihov pristup više nalikuje procesu kontrole kvalitete podataka nego tradicionalnom prevođenju: precizna definicija jezičnih i tehničkih kriterija, upravljanje namjernim pogreškama, korištenje automatizirane kontrole kvalitete i statističko uzorkovanje za praćenje dosljednosti.

Anotirani skup podataka: davanje strukture i značenja podacima

Da bi datoteka postala Uistinu koristan intelektualni skup podataka za nadzirane modeleNije dovoljno samo prikupljati tekstove: oni moraju biti označeni bilješkama. Označeni skup podataka je onaj u kojem je svakom elementu (slika, audio fragment, rečenica, tablica) dodijeljen metapodatak koji opisuje njegov sadržaj ili funkciju: oznake, kategorije, entiteti, odnosi, transkripti, granični okviri itd.

U računalnom vidu, na primjer, anotacije mogu uključivati globalne klasifikacijske oznake, okvire za ograničavanje objekata, maske segmentacije koje dodjeljuju kategoriju svakom pikselu, anotacije ključnih točaka (ljudski zglobovi, točke lica) ili putanje duž videa. U tekstu govorimo o unosi imenovanih entiteta (ljudi, organizacije, mjesta), klasifikacija dokumenata, sintaktička analiza, odnosi između entiteta ili oznake sentimenta.

Cilj cijelog ovog rada je da modeli imaju jasne primjere onoga što bi trebali prepoznati ili predvidjetiSkup podataka s označenim slikama mačaka, automobila i pješaka omogućuje obuku modela koji detektiraju i klasificiraju te objekte; skup podataka razgovora s oznakama namjere i emocija omogućuje obuku chatbotova i sustava za analizu sentimenta; dokumentarni korpus s označenim entitetima i eksplicitnim odnosima postavlja temelje za sustave za ekstrakciju znanja.

Anotacija nije ograničena samo na tekst ili slike: u audio zapisima, zadaci uključuju transkripciju, označavanje zvučnih događaja (pljesak, smijeh, pucnji), segmentaciju po govorniku i vremensko označavanje ključnih riječi. A u multimodalnim podacima (npr. video sa zvukom i titlovima), rad se obavlja na usklađivanju modaliteta i zajedničkom označavanju interakcija (izraz lica plus ton glasa plus tekstualni sadržaj).

U području strukturiranih i tabličnih podataka, označavanje također znači Objasnite značenje stupaca i vrijednostiTo uključuje povezivanje ekvivalentnih unosa u bazama podataka ili označavanje relevantnih atributa za zadatke predviđanja. Svaka vrsta projekta odabrat će jedan ili drugi skup napomena, a često se nekoliko njih kombinira kako bi se pokrili složeni slučajevi upotrebe.

Alati i procesi za označavanje datoteke kao skupa podataka

Snimanje podataka u velikom obimu zahtijeva specifični alati i dobro osmišljeni tijekovi radaNije isto ručno označavati nekoliko desetaka slika kao upravljati stotinama tisuća primjera u više formata s timovima raspoređenim po nekoliko vremenskih zona.

U računalnom vidu koriste se rješenja otvorenog koda poput LabelImg (za okvire za ograničavanje), CVAT (za složene anotacije slika i videa s kolaborativnim značajkama) ili komercijalne platforme poput Labelboxa ili SuperAnnotatea, koje uključuju kvalitetnu analitiku, upravljanje projektima i automatizaciju. Za tekst, alati poput Prodigyja, LightTaga, BRAT-a ili Datasaura olakšavaju anotaciju entiteta, klasifikacija, sintaktičkih ovisnosti i odnosa, uz detaljno praćenje anotatora i sukoba.

U audio industriji, softver poput Label Studija, Praata ili Sonixa omogućuje preciznu segmentaciju, transkripciju i označavanje zvukova. Za multimodalne podatke, lagani projekti poput VGG Image Annotatora (VIA) ili aplikacije poput RectLabela nude svestranu osnovu za sinkronizaciju anotacija među vrstama podataka. A za projekte koji zahtijevaju veliku količinu i brzinu, platforme poput automatizacija i masovna suradnja kao što su Amazon SageMaker Ground Truth, Scale AI, DataLoop ili kolaborativna rješenja kao što su Digma ili Hive Data.

Odabir alata nije samo stvar osobnih preferencija: morate uzeti u obzir vrstu podataka, proračun, veličinu tima, potrebu za suradnjom u stvarnom vremenu i veličinu skupa podataka. Gotovo sve napredne platforme uključuju značajke za validaciju osnovnih pravila, upravljanje sukobima, mjerenje produktivnosti i kvalitete te kombiniranje ljudskih anotacija s automatiziranim prijedlozima generiranim postojećim modelima.

Osim samog alata, kvalitetu određuje i proces. vrlo jasni i ažurni vodiči za anotacijeTo uključuje obuku anotatora (posebno u osjetljivim područjima poput medicine), organiziranje unakrsnih recenzija, definiranje metrika kvalitete (suglasnost među anotatorima, točnost, prisjetljivost) i korištenje podataka "zlatnog standarda" koje su provjerili stručnjaci za kalibraciju tima. Anotiranje datoteke kao intelektualnog skupa podataka nije sprint, već kontinuirani, iterativni ciklus.

Mnogi projekti se odlučuju za hibridni pristup: jednostavni ili repetitivni zadaci (npr. preliminarno otkrivanje objekata ili prethodna klasifikacija teksta) su automatizirani, a ljudski rad je rezerviran za dvosmisleni, složeni ili slučajevi s velikim utjecajemTo smanjuje troškove bez žrtvovanja kvalitete i omogućuje ocjenjivačima da se usredotoče tamo gdje dodaju najveću vrijednost.

Primjene anotiranih i intelektualnih skupova podataka u stvarnom svijetu

Tretiranje datoteke kao intelektualnog skupa podataka nije teorijska vježba: ima vrlo konkretne primjene u više sektora gdje su anotacije i kuriranje ključni za primjenu pouzdane umjetne inteligencije. U računalnom vidu, na primjer, anotirani skupovi slika i videozapisa omogućuju razvoj sustava za prepoznavanje lica, otkrivanje anomalija na rendgenskim snimkama ili magnetskoj rezonanciji, automatizirane inspekcije tvornica ili autonomna vozila koja Prepoznaju pješake, znakove i prepreke hr tiempo pravi.

U obradi prirodnog jezika, dobro lokalizirani i označeni skupovi podataka omogućuju zadatke poput analize sentimenta na društvenim mrežama, klasifikacije upita u korisničkoj službi, izdvajanja entiteta u pravnim dokumentima, strojnog prevođenja ili obuke chatbotova koji razumiju emocionalne nijanse i kulturni kontekstiOsobna arhiva članaka može postati osnova specijaliziranog asistenta koji prije objavljivanja nečeg novog pregledava ono što je već rečeno, otkriva ponavljanja ili identificira promjene u držanju tijekom godina.

Zdravlje i biotehnologija sve se više oslanjaju na visoko komentirane skupove podataka: medicinske slike s potvrđenim dijagnozama, strukturirane kliničke zapise i genomske sekvence označene relevantnim mutacijama. U automobilskoj industriji i transportu podaci su ključni za autonomnu vožnju, inteligentno planiranje ruta i upravljanje prometom. U trgovini i bankarstvu koriste se za Preporučitelji proizvoda, otkrivanje prijevara i analiza rizika.

Druga područja poput precizne poljoprivrede, okoliša, sigurnosti i obrane, videoigara, virtualne stvarnosti, obrazovanja i znanstvenih istraživanja koriste anotirane skupove podataka za praćenje usjeva, analizu satelitskih snimaka, stvaranje impresivnih iskustava, personalizaciju učenja ili ubrzavanje otkrića u biologiji ili astrofizici. U svima njima logika je slična: Bolje strukturirano i dokumentirano (na primjer s README datoteke) Što je skup podataka bolji, to će modeli dizajnirani na njemu biti bolji..

Ako datoteku promatramo kao intelektualni skup podataka u osobnom ključu, vrijednost leži u moći konzultirajte u hodu sve što znate i što ste napisaliRazumijevanje kako su se vaše ideje razvijale, otkrivanje tematskih praznina, povezivanje tekstova iz dalekih razdoblja i korištenje tog proširenog pamćenja u drugim kontekstima, poput poučavanja, istraživanja ili poslovne strategije. Sve to bez delegiranja pisanja stroju, već korištenjem umjetne inteligencije kao alata za podršku za provjeru podataka, pretraživanje referenci ili testiranje argumenata.

Gdje pronaći skupove podataka i kako se njihovo stvaranje automatizira

Nisu svi skupovi podataka potjecali iz osobnih datoteka: mnogi potječu iz otvoreni repozitoriji i javni izvori Ovi resursi su korisni za obuku i evaluaciju modela ili za istraživačke projekte, podatkovno novinarstvo i stratešku analizu. Internet već nudi bogatstvo resursa koji se mogu iskoristiti, uvijek uz dužna pravna i etička razmatranja.

Društvena mreža X (prije poznata kao Twitter), na primjer, nudi API-je koji korisnicima omogućuju prikupljanje tweetova filtriranih prema hashtagovima i drugim kriterijima. Ti se podaci zatim mogu strukturirati u tablice i vizualizirati alatima poput Tableaua. Google Dataset Search pruža specijaliziranu tražilicu za javne skupove podataka, gdje korisnici mogu pronaći sve, od poslovnih baza podataka do statistike industrije. Blogovi poput FiveThirtyEight objavljuju svoje skupove podataka o politici, sportu i društvu tako da svatko može replicirati ili proširiti njihove analize.

Paralelno s tim, sve se više koriste simulirana okruženja za automatsko generiranje anotiranih podatakaPogotovo u područjima poput autonomnih vozila, gdje bi ponovno stvaranje svih uvjeta stvarnosti u fizičkom svijetu bilo sporo, skupo i opasno. Simulatori omogućuju izradu slika i videozapisa s savršenim bilješkama (položaji objekata, vremenski uvjeti, putanje) i istraživanje ekstremnih scenarija koje je teško uhvatiti u stvarnim podacima.

Budućnost ukazuje na kombinaciju kuriranih podataka iz stvarnog svijeta, osobnih arhiva tretiranih kao intelektualni korpusi i sintetičkih podataka generiranih u simulaciji, a sve to koordinirano s tehnikama nadziranog, polunadziranog, nenadziranog i samonadziranog učenja. Anotacija će ostati ključni element, ali sve više potpomognuta modelima koji Oni predlažu oznake, otkrivaju nedosljednosti i mjere pristranosti.prepuštajući finije odluke ljudima.

U tom kontekstu, etička i regulatorna dimenzija postaje važna: rukovanje osobnim datotekama kao skupovima podataka zahtijeva poštivanje privatnosti, autorskih prava i očekivanja korištenja, dok platforme za crowdsourcing ili masovnu suradnju moraju osigurati pravedne uvjete za anotatore i transparentnost o tome koji se modeli obučavaju s podacima koje generiraju.

Kada se cijelim ovim lancem pažljivo upravlja - od izdvajanja osobne datoteke do vektorizacije, grafičkog prikaza, lociranja, označavanja, automatizacije ažuriranja i povezivanja s AI asistentima - dobiva se nešto što danas ima vrlo malo autora, tvrtki ili organizacija: dubok, konzistentan i aktivan intelektualni skup podatakasposobni pokretati sustave umjetne inteligencije koji su istinski usklađeni s glasom, kontekstom i ciljevima onih koji ih pokreću te služiti kao proširena memorija u svijetu sve zasićenijem informacijama.

Strastveni pisac o svijetu bajtova i tehnologije općenito. Volim dijeliti svoje znanje pisanjem, a to je ono što ću učiniti na ovom blogu, pokazati vam sve najzanimljivije stvari o gadgetima, softveru, hardveru, tehnološkim trendovima i još mnogo toga. Moj cilj je pomoći vam da se snađete u digitalnom svijetu na jednostavan i zabavan način.