- Der Raspberry Pi 5 hat sich als zugängliche Plattform für die Ausführung von leichtgewichtigen KI-Modellen und Agenten etabliert, die Cloud-Dienste koordinieren, wobei ein besonderer Fokus auf Datenschutz und Systemisolation liegt.

- Vereinfachte und kompakte Modelle (DeepSeek, Llama 3.2, Qwen usw.) ermöglichen Chat, Übersetzung und Codeunterstützung auf einfacher Hardware, allerdings mit deutlichen Einschränkungen im Vergleich zu großen kommerziellen LLMs.

- Spezielle Beschleuniger wie die Hailo-Module (Hailo-8L und Hailo-10H in AI HAT+ 2) steigern die Inferenzleistung und ermöglichen lokale Computer Vision und LLM auf dem Raspberry Pi 5 mit geringer Latenz.

- Die Kombination aus geringer Größe, dedizierter Hardware und Hausautomation macht den Raspberry Pi zu einem idealen KI-Knoten am Netzwerkrand, der Befehle interpretieren und Aufgaben automatisieren kann, ohne auf die Cloud angewiesen zu sein.

La Künstliche Intelligenz auf dem Raspberry Pi Es erlebt gerade einen ganz besonderen Moment. Bis vor Kurzem stellten wir uns KI entweder als großen, Cloud-basierten Chatbot mit Abonnement oder als extrem teuren Computer mit vielen GPUs vor, um riesige Modelle lokal auszuführen. Doch das hat sich geändert: Agenten wie OpenClaw, optimierte Modelle wie DeepSeek und neue Beschleuniger wie AI HAT+ 2 haben die kleinen Boards in den Mittelpunkt der Diskussion gerückt.

Diese Veränderung ist nicht nur eine vorübergehende Modeerscheinung: Die Kombination aus Raspberry Pi 5, leichten Modellen und dedizierter KI-Hardware Es ermöglicht Ihnen, Chatbots, Übersetzer, Programmierassistenten oder Bildverarbeitungssysteme ohne Cloud-Anbindung zu betreiben. All dies bei verbesserter Kontrolle über Sicherheit, Kosten und Datenschutz. Allerdings gibt es auch klare Einschränkungen, die Sie kennen sollten, um Enttäuschungen zu vermeiden.

Der Aufstieg von KI-Agenten und die Rolle des Raspberry Pi

In den letzten Monaten wurde viel darüber geredet KI-Agenten, die selbstständig handeln könnenEiner der Namen, der für besonders viel Aufsehen gesorgt hat, ist OpenClaw. Anders als ein klassischer Chatbot, der lediglich auf Nachrichten reagiert, ist ein Agent ein System, das Entscheidungen treffen und Aktionen ausführen kann: Skripte starten, APIs aufrufen, mit externen Diensten interagieren oder Dateien innerhalb einer bestimmten Computerumgebung bearbeiten.

Das Interessante ist das Dieser Agententyp benötigt das „Gehirn“ nicht im Raspberry Pi selbst.Das größere Modell läuft typischerweise in der Cloud, während das Board als Orchestrator fungiert: Es hält die Kommunikation aufrecht, verwaltet den Benutzerkontext, startet Befehle im System und dient als Brücke zwischen der physischen Welt (Sensoren, Aktoren, Hausautomation) und der entfernten KI.

Gleichzeitig werden Konfigurationen entwickelt für Kleinere Modelle können direkt auf der Raspberry Pi-Hardware ausgeführt werden.Tools wie Ollama oder llama.cpp ermöglichen das Laden reduzierter LLMs, die für die ARM-Architektur optimiert sind, insbesondere auf Modellen wie dem Raspberry Pi 4 oder 5 mit ausreichend RAM. Das ist keine Zauberei: Einige Funktionen und Geschwindigkeiten werden dadurch eingeschränkt, aber für bestimmte Anwendungen ist das Ergebnis durchaus brauchbar.

Dieses neue Szenario hat sogar dazu geführt, dass Bewegungen am Finanzmarkt im Zusammenhang mit Raspberry PiDer Aktienkurs stieg deutlich an, was auf die Begeisterung für leicht zugängliche KI-Systeme zurückzuführen ist. Letztendlich setzt sich die Idee durch, dass kleine, physische Geräte KI ausführen oder koordinieren können, anstatt sich ausschließlich auf große Rechenzentren oder leistungsstarke Desktop-Computer zu verlassen.

Sicherheit, Isolation und Zweifel an der Herangehensweise

Einem KI-Agenten tiefgreifenden Zugriff auf ein System zu gewähren, ist kein Scherz: Ein Agent mit weitreichenden Berechtigungen kann Dateien lesen, Daten verschieben, Webformulare ausfüllen oder auf kritische Dienste zugreifen.Das Raspberry Pi-Ökosystem selbst betont, dass dies mit realen Risiken verbunden ist, da diese Algorithmen nicht unfehlbar sind und Fehler machen oder sich unerwartet verhalten können; daher ist es ratsam, [die entsprechenden Richtlinien/Methoden] zu befolgen. gute Computersicherheitspraktiken.

Hier kommt einer der großen Vorteile des Motherboards zum Tragen: Durch die Verwendung eines Raspberry Pi als isolierte Umgebung wird der Einfluss potenzieller Fehler verringert.Anstatt Ihrem Hauptrechner die direkte Kontrolle zu gewähren, können Sie ein dediziertes System einrichten, in dem der Agent nur Zugriff auf die unbedingt notwendigen Ressourcen hat. Diese physische „Sandbox“ hilft, Schäden zu begrenzen und ermöglicht unbesorgtes Experimentieren.

Nicht alle sind davon überzeugt, dass dieser Ansatz ein Allheilmittel ist. Fachmedien haben darauf hingewiesen, dass Der Raspberry Pi hat als extrem günstige Option etwas von seinem Reiz eingebüßt.Insbesondere bei fortgeschrittenen Konfigurationen mit viel Arbeitsspeicher. Ein Raspberry Pi 5 mit 16 GB kann fast oder sogar über 200 US-Dollar kosten, was für manche die ursprüngliche Idee eines kostengünstigen Computers für jedermann untergräbt.

In diesem Sinne gibt es skeptische Stimmen, die glauben, dass Die Verwendung eines Raspberry Pi als Basis für komplexe Agenten wie OpenClaw ist möglicherweise nicht die optimale Entscheidung. Bei knappem Budget können die Kosten für Motherboard, Arbeitsspeicher und eventuelle KI-Beschleuniger den Preis erheblich erhöhen, sodass das System teurer wird als leistungsstärkere oder flexiblere Alternativen.

Dennoch bleibt der Ansatz mit dedizierten Geräten und Risikoisolierung sehr attraktiv: die Wert auf Sicherheit, Privatsphäre und kontrollierte Experimente legen Der Raspberry Pi bietet ein perfektes "Labor" zum Testen von Substanzen und Modellen, ohne kritische Arbeitsmaschinen zu beeinträchtigen.

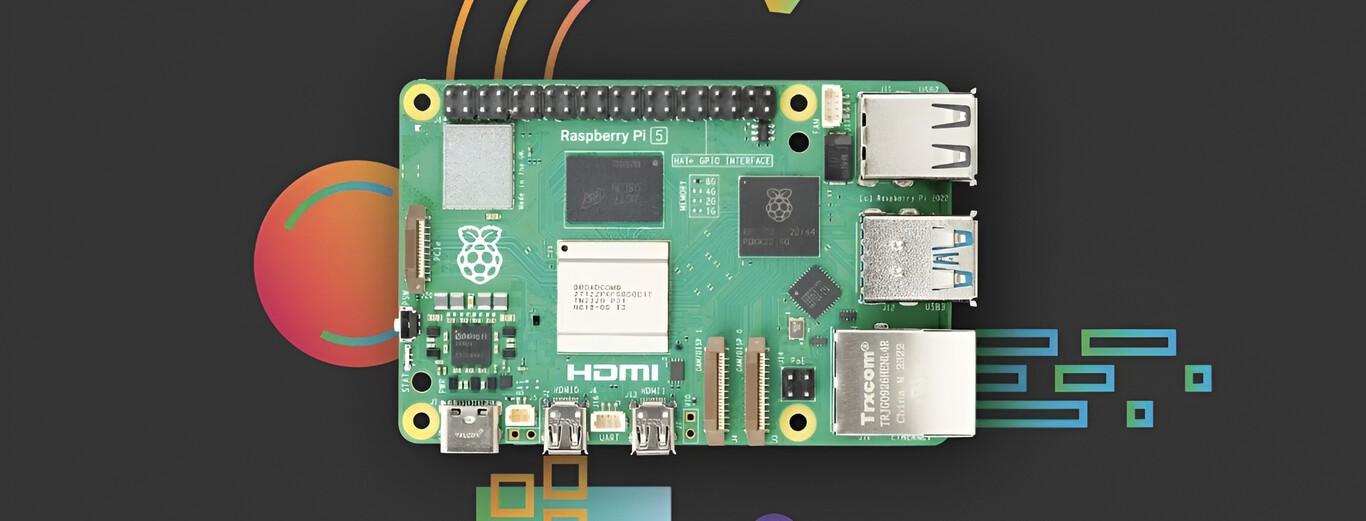

Raspberry Pi 5 als Plattform für lokale KI-Modelle

Abgesehen von der Rolle der Agenten, Der Raspberry Pi 5 hat sich als unglaublich vielseitiges Werkzeug etabliert.Es eignet sich nach wie vor hervorragend für Robotik, Elektronik, Hausautomation oder Multimedia, aber die aktuelle Hardware ermöglicht es, noch einen Schritt weiter zu gehen und es als Grundlage für reale, lokale Projekte im Bereich der künstlichen Intelligenz zu nutzen.

Dank der schnelleren CPU, der verbesserten GPU und der Möglichkeit, Konfigurationen mit viel RAM zu erstellen, Der Raspberry Pi 5 ist in der Lage, einfache KI-Modelle recht gut auszuführen.Es wird keinen Server voller GPUs ersetzen, ermöglicht aber Experimente mit Computer Vision, Spracherkennung, kompakten Sprachmodellen oder speziellen Assistenten für ganz bestimmte Aufgaben.

Eine gängige Strategie beinhaltet Entscheiden Sie sich für Open-Source-Modelle, die für leistungsschwache Hardware optimiert sind.Üblicherweise werden beispielsweise Mistral 7B, einige kleine Varianten von Orca oder kompakte Modelle wie Microsoft Phi-2 verwendet, vorausgesetzt, es gibt angepasste und vor allem reduzierte Versionen mit Quantisierungs- oder Destillationstechniken, die in den Speicher passen.

Es ist wichtig, das zu verstehen Diese kleineren LLMs spielen nicht in derselben Liga wie Giganten wie GPT-4.Sie verlieren an Tiefe, Kontext und Reaktionsfähigkeit, insbesondere bei sehr allgemeinen oder komplexen Themen. Im Gegenzug bieten sie akzeptable Latenzzeiten, einen geringeren Stromverbrauch und den Vorteil, nicht auf externe Verbindungen angewiesen zu sein – ein Schlüsselfaktor, wenn die gesamte Verarbeitung auf der Platine selbst erfolgen soll.

Diese Kombination verwandelt den Raspberry Pi 5 in eine Art von „Sandbox“ – ideal zum Lernen, Prototyping und Einsetzen von KI-Lösungen die keine extremen technischen Kenntnisse oder exorbitante Investitionen erfordern, vorausgesetzt, es ist ganz klar, was von diesen reduzierten Modellen erwartet werden kann und was nicht.

Grundlegende Schritte zur Inbetriebnahme von KI auf einem Raspberry Pi 5

Um ein Projekt einzurichten, das KI lokal auf dem Raspberry Pi 5 ausführt, ist es hilfreich, eine Reihe allgemeiner Schritte zu befolgen. Es ist kein festes Rezept, sondern eher eine gedankliche Richtlinie. was Sie entdecken werden, wenn Sie anfangen, daran herumzubasteln.

Der erste Punkt ist Wählen Sie ein Modell, das mit der ARM-Architektur und den Ressourcen des Boards kompatibel ist.Hier kommen Modelle wie das bereits erwähnte Mistral 7B in stark komprimierten Versionen, einige kleine Orca- oder verkleinerte Phi-2-Modelle sowie andere LLMs von 1B bis 7B mit für den Betrieb auf leistungsschwächeren Geräten optimierten Parametern zum Einsatz. Je kleiner das Modell, desto einfacher ist es auszuführen, aber auch desto eingeschränkter ist sein Funktionsumfang.

Dann kommt der Teil von Installieren Sie die Unterstützungssoftware für die Arbeit mit neuronalen Netzen.Je nach Bedarf können Sie TensorFlow Lite für Bildverarbeitungsprojekte, PyTorch für die Verwendung bestimmter Repositories oder dedizierte Laufzeitumgebungen wie Edge TPU für externe Beschleuniger nutzen. Für LLM erleichtern Tools wie llama.cpp oder Ollama die Arbeit erheblich.

Sobald Sie die Software haben, tippen Sie Konfigurieren Sie die Laufzeitumgebung auf dem Raspberry PiDies beinhaltet die Anpassung von Systemoptionen, die Installation zusätzlicher Abhängigkeiten, die Sicherstellung, dass das Modell für ARM optimiert ist, und oft das Ausprobieren von Parametern wie Kontextgröße, Quantisierungsgrad oder Anzahl der Threads, um Leistung und Speicherverbrauch in Einklang zu bringen.

Nachdem alles eingerichtet ist, können Sie fortfahren mit Führe das Modell aus und beginne mit den Schlussfolgerungen.Hier zeigt sich, ob die Hardware-Software-Kombination die Anforderungen erfüllt. Sie müssen Daten laden, Anfragen senden, die Latenz messen und prüfen, ob die Antwortqualität Ihren Erwartungen entspricht. Oftmals müssen zahlreiche Details optimiert werden, bis das System reibungslos läuft. Es empfiehlt sich, den Festplattenspeicher mithilfe von Tools zu überprüfen… Analysieren und bereinigen Sie Ihre Festplatte.

Sollte die Leistung nicht ausreichen, haben Sie die Möglichkeit, Fügen Sie einen externen Beschleuniger hinzu, um die CPU zu entlasten.Geräte wie USB Coral mit Edge TPU oder die neuen Karten auf Basis von Hailo-Chips ermöglichen es neuronalen Netzen, viel schneller und mit geringerem Energieverbrauch zu laufen, was in vielen Fällen das Nutzererlebnis grundlegend verändert.

Datenschutz, Sicherheit und die Vorteile der lokalen Datenverarbeitung

Eines der stärksten Argumente für den Einsatz von KI auf einem Raspberry Pi ist die Fähigkeit, Daten innerhalb Ihres Netzwerks zu haltenWenn Sie ein Modell lokal ausführen, senden Sie keine persönlichen oder sensiblen Daten an einen Server eines Drittanbieters. Dies ist insbesondere in professionellen, schulischen oder fortgeschrittenen Hausautomatisierungsumgebungen relevant. Es empfiehlt sich außerdem, entsprechende Techniken anzuwenden. verschlüsselte Sicherung an Ihre Kopien.

Das bedeutet das Sie haben deutlich mehr Kontrolle darüber, wer Zugriff auf Ihre Daten hat.Wenn Ihr lokaler Assistent interne Dokumente analysiert, Sicherheitskameras überwacht oder Nutzungshistorien für Ihr Zuhause verwaltet, bleibt alles innerhalb Ihrer Infrastruktur. Sie sind nicht von sich ändernden Datenschutzrichtlinien oder potenziellen Sicherheitslücken externer Dienste abhängig.

Parallel dazu funktioniert der Raspberry Pi fast wie ein „Physische Firewall“ für Ihre KI-ExperimenteSie können ein separates System von Ihrem Hauptnetzwerk einrichten, dessen Zugriff auf bestimmte Ressourcen beschränken und so sicherstellen, dass der potenzielle Schaden auch dann begrenzt wird, wenn das Modell seltsame Fehler macht oder der Agent zu kreativ wird.

Dies hebt natürlich nicht die Notwendigkeit auf, Berechtigungen, Benutzer und Netzwerkregeln ordnungsgemäß konfigurierenEin Agent mit zu viel Freiheit auf einem schlecht gesicherten Raspberry Pi kann immer noch ein Problem darstellen. Der Unterschied besteht darin, dass es sich um eine dedizierte und kostengünstige Umgebung handelt, die sich im Fehlerfall viel einfacher überprüfen, von Grund auf neu aufbauen oder sogar physisch trennen lässt.

Zusammenfassend lässt sich sagen, dass dieses Angebot für diejenigen geeignet ist, die Wert auf Datenschutz und die Möglichkeit legen, den gesamten Informationsfluss zu überprüfen, Die Verwendung eines Raspberry Pi als lokaler KI-Knoten bietet eine Sicherheit, die man sonst nur schwer findet. wenn alles von Cloud-Diensten abhängt, die von außerhalb Ihrer Organisation oder Ihres Zuhauses verwaltet werden.

DeepSeek und die Realität der Ausführung großer Modelle auf bescheidener Hardware

Ein weiterer Name, der die Branche aufgemischt hat, ist DeepSeek, insbesondere das Modell DeepSeek R1 wurde für logisches Denken und mit einem sehr ambitionierten Ansatz entwickelt.In vielen Schlagzeilen wurde hervorgehoben, dass es einige der fortschrittlichsten kommerziellen Modelle übertrifft und lokal ausgeführt werden kann, was die Idee beflügelt, ein "selbstgemachtes ChatGPT" auf jeder beliebigen Maschine zu haben.

Es ist wichtig, die Dinge an ihren Platz zu räumen: Die Vollversion von DeepSeek R1 671B ist ein Monstrum mit über 400 GB. Und es benötigt mehrere sehr leistungsstarke GPUs, um reibungslos zu laufen. Diese Variante kann tatsächlich mit den Topmodellen von OpenAI oder ähnlichen Plattformen konkurrieren und ist für einen Raspberry Pi oder einen Standard-PC völlig unerreichbar.

Der große Unterschied zu anderen geschlossenen Anbietern besteht darin, dass man, wenn man die entsprechende Hardware besitzt, Sie können das Modell herunterladen, es mit Tools wie Ollama zusammenbauen und zu Hause ausführen.und in vielen Fällen werden Sie benötigen Schließen Sie eine externe Festplatte an. um die Gewichte zu speichern. Aber wir sprechen hier von Konfigurationen, die mehrere tausend Euro kosten, mit Karten wie der RTX 4090, A100 oder vergleichbaren Rechenzentrumskarten; nichts Vergleichbares zu einem stromsparenden Mikrocomputer.

Um es auch normalen Menschen zu ermöglichen, DeepSeek auf Standardrechnern oder Geräten wie dem Raspberry Pi zu spielen, werden folgende Schritte durchgeführt: destillierte und reduzierte ModelleEs handelt sich im Wesentlichen um komprimierte Versionen des Originals, die einen Teil seines Verhaltens beibehalten, jedoch auf Kosten von Speicherkapazität und Wissen. Hier kommen Varianten mit 14B-, 7B- oder sogar 1.5B-Parametern ins Spiel.

Die entscheidende Frage ist, wie viel dabei verloren geht. Der Zusammenhang zwischen Modellgröße, Speicher und Antwortqualität ist sehr deutlich.Wenn das Referenzmodell über 400 GB groß ist und Wikipedia bereits fast 100 GB belegt, ist es unrealistisch zu erwarten, dass eine Version von nur etwas über 1 GB all dieses Wissen im Detail enthalten wird.

Praxistests von DeepSeek auf verschiedenen Geräten

Um diese Unterschiede in der Praxis zu verdeutlichen, ist es hilfreich, das Verhalten der verschiedenen DeepSeek-Varianten auf unterschiedlicher Hardware zu vergleichen. Auf einer Workstation mit Eine RTX 3060 GPU mit 12 GB VRAM kann die 14B-Parameterversion recht gut ausführen.und sogar die 32-Bit-Version durch Verwendung des System-RAMs erzwingen, obwohl die Geschwindigkeiten dadurch deutlich sinken.

Wenn Sie die Cloud-Version von DeepSeek ausprobieren, ohne lokale HardwarebeschränkungenDas größere Modell arbeitet einwandfrei und beweist eindrucksvoll, warum es mit den Branchenriesen konkurrieren kann. Der Unterschied zeigt sich sowohl in der Geschwindigkeit und Zuverlässigkeit seiner Reaktionen als auch in seiner Fähigkeit, komplexe Anweisungen zu verarbeiten.

Wenn man auf den Boden eines Mit einem Raspberry Pi und 8 GB RAM ändert sich das Szenario radikal.In diesem Fall ist das größte Modell, das funktional ausgeführt werden kann, das mit 7 Milliarden Parametern, und selbst dann liegt die Geschwindigkeit bei etwa einem Token pro Sekunde. Dadurch ist eine flüssige Konversation nahezu unmöglich.

Bei der Bewertung der Qualität der Antworten wird der Unterschied noch deutlicher. Konfrontiert mit einer einfachen Allgemeinwissensfrage, wie zum Beispiel: Wer ist eine bekannte Figur aus einer beliebten Serie? Das Modell 14B ist korrekt, während das Modell 7B anfängt, seltsame Ergebnisse zu liefern.Die 1.5B-Variante liefert direkt Ergebnisse, die eher an einen erfundenen Text ohne solide Grundlage erinnern.

Das Muster wiederholt sich bei allgemeineren Abfragen: Kleine Varianten führen häufig zu seltenen, unvollständigen oder eindeutig fehlerhaften Antworten.Das ist logisch: Durch die so starke Verkleinerung des Modells werden seine Repräsentationsfähigkeit und sein implizites „Gedächtnis“ der Welt drastisch reduziert, sodass man nicht erwarten kann, dass es sich wie ein Spitzenmodell verhält.

Wozu werden die destillierten Modelle auf dem Raspberry Pi eigentlich verwendet?

Trotz dieser Einschränkungen haben destillierte und kompakte Modelle sehr interessante Einsatzmöglichkeiten in Geräten wie dem Raspberry Pi. Sie sind nicht als Ersatz für große, universell einsetzbare Chatbots gedacht.aber zur Lösung klar definierter Aufgaben, bei denen Kreativität und enzyklopädisches Wissen nicht im Vordergrund stehen.

Eines der Gebiete, in denen sie recht gut funktionieren, ist in Grundlegende Mathematikhilfe und Code-ÜberprüfungUm einfache Fehler in Skripten zu erkennen, kleine Funktionen vorzuschlagen oder Verbesserungen an Teilen des Python-Codes anzuregen, liefert ein 7B- oder 14B-Modell in der Regel nützliche Antworten, solange es nicht nach etwas extrem Spezifischem oder Kompliziertem gefragt wird.

Sie können auch sehr nützlich sein für Generieren und Korrigieren von Codefragmenten für Hausautomation, Automatisierung oder kleinere ProjekteEin 14B-Modell könnte beispielsweise eine Home Assistant-Automatisierung mit einer gewissen Kohärenz vorschlagen, während die 1.5B-Version dazu neigt, Teile zu erfinden oder etwas anzubieten, das nicht kompiliert werden kann oder keinen Sinn ergibt.

Ihr systematisches Versagen liegt in Allgemeinwissensfragen, detaillierte Fakteninformationen oder Aufgaben, die viel Kontext erfordern.Darüber hinaus fehlt es selbst bei relativ großen Modellen auffällig an Sinn für Humor und der Fähigkeit, lange, natürliche Gespräche zu führen, was sie zur ungeeigneten Wahl als „virtuelle Freunde“ macht.

Ein kurioses Beispiel ist die Aufforderung an sie, Erstellen Sie eine komplexe Website, zum Beispiel eine Landingpage zum Verkauf eines Kurses.Alle Modelle können eine funktionale HTML-Struktur erzeugen, aber je reduzierter und kleiner die Variante ist, desto einfacher, unansehnlicher und inhaltsärmer wird die generierte Website, wobei Details und Nuancen verloren gehen.

Kurz gesagt, kleine Modelle, die auf einem Raspberry Pi basieren, sind ideal für Unterstützung bei begrenzten technischen Aufgaben, Hausautomation, kleinen Entwicklungsarbeiten oder einfacher DatenklassifizierungEs ist jedoch nicht als Ersatz für einen hochmodernen Cloud-Dienst gedacht, wenn man einen vielseitigen Allzweckassistenten benötigt.

Raspberry Pi, Hausautomation und leichtgewichtige künstliche Intelligenz

Eine der vielversprechendsten Anwendungen von KI auf dem Raspberry Pi ist die Smart-Home-Automatisierung mit leichten ModellenDie Idee besteht darin, die Platine als lokales Gehirn zu nutzen, das Befehle interpretiert, sich mit Sensoren und Aktoren verbindet und einfache Entscheidungen trifft, ohne dass etwas an die Cloud gesendet werden muss.

Beispielsweise kann ein System eingerichtet werden, bei dem Ein kleines Sprachmodell ist für das Verständnis von Sprachbefehlen zuständig.einschließlich Vorverarbeitungsschritten wie Mikrofonrauschen beseitigenBeispiele hierfür sind: „Die Jalousien im Wohnzimmer herunterlassen, wenn die Sonne direkt in den Raum scheint“ oder „Die Heizung nur einschalten, wenn jemand zu Hause ist und die Temperatur unter einen bestimmten Wert sinkt“. Das Modell muss weder historische Persönlichkeiten kennen noch Gedichte schreiben können: Es muss lediglich Anfragen in konkrete Aktionen umsetzen.

Mit diesem Ansatz kann sogar ein LLM mit 1.5B- oder 3B-Parametern sinnvoll sein. denn seine Funktion besteht nicht darin, brillante Antworten zu liefern, sondern natürliche Sprache strukturierten Befehlen zuzuordnen.Wenn es speziell für diesen Bereich (Hausautomation, Sensoren, Routinen) trainiert oder angepasst wird, können die Ergebnisse angesichts der geringen Systemgröße überraschend gut sein.

Diese Art von Lösung ermöglicht es Ihnen, Folgendes zu erstellen Intelligente Häuser, die die Privatsphäre deutlich besser respektieren.Weder Sprachbefehle noch Nutzungsmuster des Geräts verlassen das lokale Netzwerk. Da es zudem nicht von externen Diensten abhängig ist, wird verhindert, dass die Funktionalität aufgrund von API-Änderungen eines Anbieters, Serverausfällen oder der Abschaltung eines Dienstes beeinträchtigt wird.

Obwohl noch vieles verfeinert und getestet werden muss, ist das Potenzial der Kombination kleine Modelle mit Hausautomatisierungsplattformen wie Home Assistant oder eigenen Systemen Das Potenzial hierfür auf dem Raspberry Pi ist enorm, und alles deutet darauf hin, dass wir immer mehr Experimente und reale Projekte in diesem Bereich sehen werden.

KI-Beschleuniger für Raspberry Pi: Hailo, AI HAT+ und andere Module

Um die Einschränkungen der CPU des Raspberry Pi zu überwinden, sind neue Technologien entstanden dedizierte KI-Beschleuniger, die sich direkt in das Board integrieren lassenZiel ist es, neuronale Netze wesentlich schneller und effizienter zu verarbeiten als eine CPU oder in manchen Fällen eine herkömmliche GPU.

Im Vergleich zu Allzweckprozessoren sind diese Beschleuniger so konzipiert, dass sie parallel die für maschinelles Lernen typischen mathematischen Operationen ausführenDadurch werden die Inferenzzeit und der Energieverbrauch reduziert, was insbesondere bei eingebetteten Systemen oder in Situationen, in denen ein hoher, kontinuierlicher Energieverbrauch nicht toleriert werden kann, von entscheidender Bedeutung ist.

Ein sehr weit verbreitetes Beispiel ist die Verwendung von einem Eine M.2 HAT+ Karte ist zusammen mit einem M.2 2242 Modul, das einen Hailo-8L Chip integriert, an einen Raspberry Pi 5 angeschlossen.Dieses Kit enthält eine spezielle neuronale Verarbeitungseinheit, die Bildverarbeitungsaufgaben, Objekterkennung oder sogar einige für seine Architektur optimierte generative Modelle beschleunigt.

Der Hailo-Chip konzentriert sich auf komplexe Operationen parallel mit hoher Energieeffizienz verarbeitenIm Vergleich zu CPU- oder GPU-basierten Lösungen bedeutet dies weniger Wärmeentwicklung, einen geringeren Kühlbedarf und eine längere Akkulaufzeit – ein bedeutender Vorteil bei Industrieprojekten, Robotik und verteilten intelligenten Sensoren.

Dank dieser Module kann der Raspberry Pi von einem einfachen Koordinator zu einem zu einem wirklich leistungsfähigen Inferenzknoten werden, wodurch hochentwickelte neuronale Netze direkt am Rand des Netzwerks ausgeführt werden, ohne die Platine zu überlasten und eine sehr geringe Latenz aufrechtzuerhalten.

AI HAT+ 2 und der Sprung zu lokalen LLMs auf Raspberry Pi 5

Eine der bemerkenswertesten Produkteinführungen in diesem Bereich ist die Raspberry Pi AI HAT+ 2, eine Erweiterungsplatine für Raspberry Pi 5 Dazu gehört der Hailo-10H-Chip. Dieser Coprozessor bietet eine Inferenzleistung von rund 40 TOPS, ausreichend für die lokale Verarbeitung von ressourcenschonenden generativen KI-Modellen.

Mit dieser Hardware kann der Raspberry Pi 5 relativ kompakte Sprachmodelle mit geringer Latenz ausführenohne die Haupt-CPU zu überlasten. Die Verarbeitung wird an den Hailo-10H delegiert, der rechenintensive Operationen übernimmt, während das Board die Anwendungslogik, Benutzereingaben und die Integration mit anderen Systemen verwaltet.

Zu den offiziell genannten kompatiblen Modellen gehören: DeepSeek-R1-Distill, Llama 3.2, Qwen2.5-Coder, Qwen2.5-Instruct und Qwen2Die meisten verfügen über rund 1.500 Milliarden Parameter, während Llama 3.2 etwa 1.000 Milliarde aufweist; alle sind so konzipiert, dass sie ein ausgewogenes Verhältnis zwischen Kapazität und Ressourcenverbrauch bieten.

Öffentliche Versuche zeigen, dass diese Modelle verwendet werden können für grundlegende Chat-Aufgaben, Textübersetzung, Code-Snippet-Generierung oder Szenenbeschreibung In Kombination mit visueller Eingabe ist die Latenz gering und das Benutzererlebnis kommt dem, was die Menschen von moderner interaktiver KI erwarten, viel näher.

Es ist jedoch wichtig klarzustellen, dass AI HAT+ 2 erlaubt es nicht, massive Modelle lokal auszuführen, wie zum Beispiel ChatGPT, Claude oder die größeren Meta LLMs.Diese Systeme verfügen über Hunderte von Milliarden oder Billionen von Parametern, weit mehr als ein Coprozessor dieser Art in einem Raspberry Pi 5 vernünftigerweise bewältigen kann.

Der große Reiz des AI HAT+ 2 liegt darin, dass er für einen Preis von rund 130 US-Dollar Es ermöglicht Ihnen, einen Raspberry Pi 5 in eine sehr leistungsfähige kleine lokale KI-Station zu verwandeln.Es bietet Zugriff auf eine Sammlung von Hailo-Beispielen und -Frameworks, die sowohl für Computer Vision als auch für generative KI entwickelt wurden. Es ist ein wichtiges Werkzeug für alle, die über rein symbolische Modelle hinausgehen und mit modernen neuronalen Netzen am Netzwerkrand experimentieren möchten.

Die Landschaft rund um künstliche Intelligenz auf dem Raspberry Pi ist durchaus vielversprechend: unter anderem cloudbasierte Agenten, schlanke On-Premises-Modelle, dedizierte Beschleuniger und neue Boards wie AI HAT+ 2Die kleine Platine hat sich zu einem idealen Labor entwickelt, um zu erforschen, wie verteilte KI in Alltagsgeräten aussehen wird, vorausgesetzt, dass die Leistungsbeschränkungen berücksichtigt und die Projekte durchdacht konzipiert werden.

Leidenschaftlicher Autor über die Welt der Bytes und der Technologie im Allgemeinen. Ich liebe es, mein Wissen durch Schreiben zu teilen, und genau das werde ich in diesem Blog tun und Ihnen die interessantesten Dinge über Gadgets, Software, Hardware, technologische Trends und mehr zeigen. Mein Ziel ist es, Ihnen dabei zu helfen, sich auf einfache und unterhaltsame Weise in der digitalen Welt zurechtzufinden.