- Z.AI bietet kostenlosen Chat ohne Registrierung und eine abonnementbasierte API mit eigenen GLM-4.5/4.6-Modellen.

- Hauptfunktionen: Deep Reasoning, Codegenerierung, Agenten, Dateien und Websuche.

- Open-Source-Strategie (MIT), Kompatibilität mit Hardware Alternative und Brücke zu bigmodel.cn.

Z.AI ist als Chatroom im Sturm erobert worden. künstliche Intelligenz Es ist über den Browser zugänglich und legt Wert auf eine unkomplizierte Bedienung ohne Registrierung oder sonstige Umstände. Sein Hauptvorteil besteht darin, dass es mit … funktioniert. eigene Modelle der GLM-Serie (GLM-4.5 und GLM-4.6)Entwickelt für fortgeschrittene Schlussfolgerungen, Codegenerierung und Agentenfunktionen. Wenn Sie eine Alternative suchen, die nicht auf traditionelle Anbieter angewiesen ist, werden Sie sich hier sofort wohlfühlen.

Der Vorschlag zeichnet sich durch seine Freier Zugang mit großzügigen LimitsEs bietet schnelle Reaktionszeiten und nützliche Tools wie Dateianalyse und Websuche. Darüber hinaus stellt es eine kostenpflichtige API für Entwickler und Integrationen bereit, verfolgt aber in seinen Modellen eine offene Philosophie, die all jenen entgegenkommt, die Einschränkungen des Ökosystems vermeiden möchten. Arbeiten mit Open-Source-Technologie unter der MIT-Lizenz.

Was ist Z.AI und wer steckt dahinter?

Im Wesentlichen ist Z.AI ein Konversations-Chat, der auf Sprachmodellen der nächsten Generation basiert und sich insbesondere auf Folgendes konzentriert: strukturiertes Denken und ProgrammierungAnders als bei anderen Plattformen ist für den Einstieg kein Abonnement erforderlich: Man greift über den Browser darauf zu, stellt seine Frage, und das war's – ohne Wartezeiten oder Zwischenschritte. Diese Unmittelbarkeit spricht Nutzer an, die Wert auf Einfachheit legen. Der Datenschutz, der sich daraus ergibt, dass keine Registrierung erforderlich ist..

Das Flaggschiffprodukt ist mit Zhipu AI (vollständiger Name: Beijing Zhipu Huazhang Technologie), ein Unternehmen, das an der Tsinghua-Universität gegründet wurde und sich später zu einem unabhängigen Startup entwickelte. In China zählt es zu den „KI-Tigern“ und hält laut International Data Group bereits den ersten Platz. Dritter Platz auf dem LLM-Markt im Land, ein bedeutender Meilenstein in einem hart umkämpften Sektor.

Seine finanzielle Entwicklung war ebenfalls bemerkenswert: Im Jahr 2023 sammelte er mehr als 2,5 Milliarden Yuan mit der Unterstützung von Giganten wie Alibaba und Tencent und im Jahr 2024 beteiligte sich Prosperity7 Ventures mit einer Investition von 400 Mio.Die Bewertung liegt damit bei rund 3.000 Milliarden US-Dollar. Parallel dazu verfolgt Zhipu AI eine offene Strategie: Die GLM-Modelle des Unternehmens können unter der MIT-Lizenz kommerziell genutzt und von Repositories wie [Name der Repositories einfügen] heruntergeladen werden. Umarmendes Gesicht oder ModelScope die lokale Ausführung.

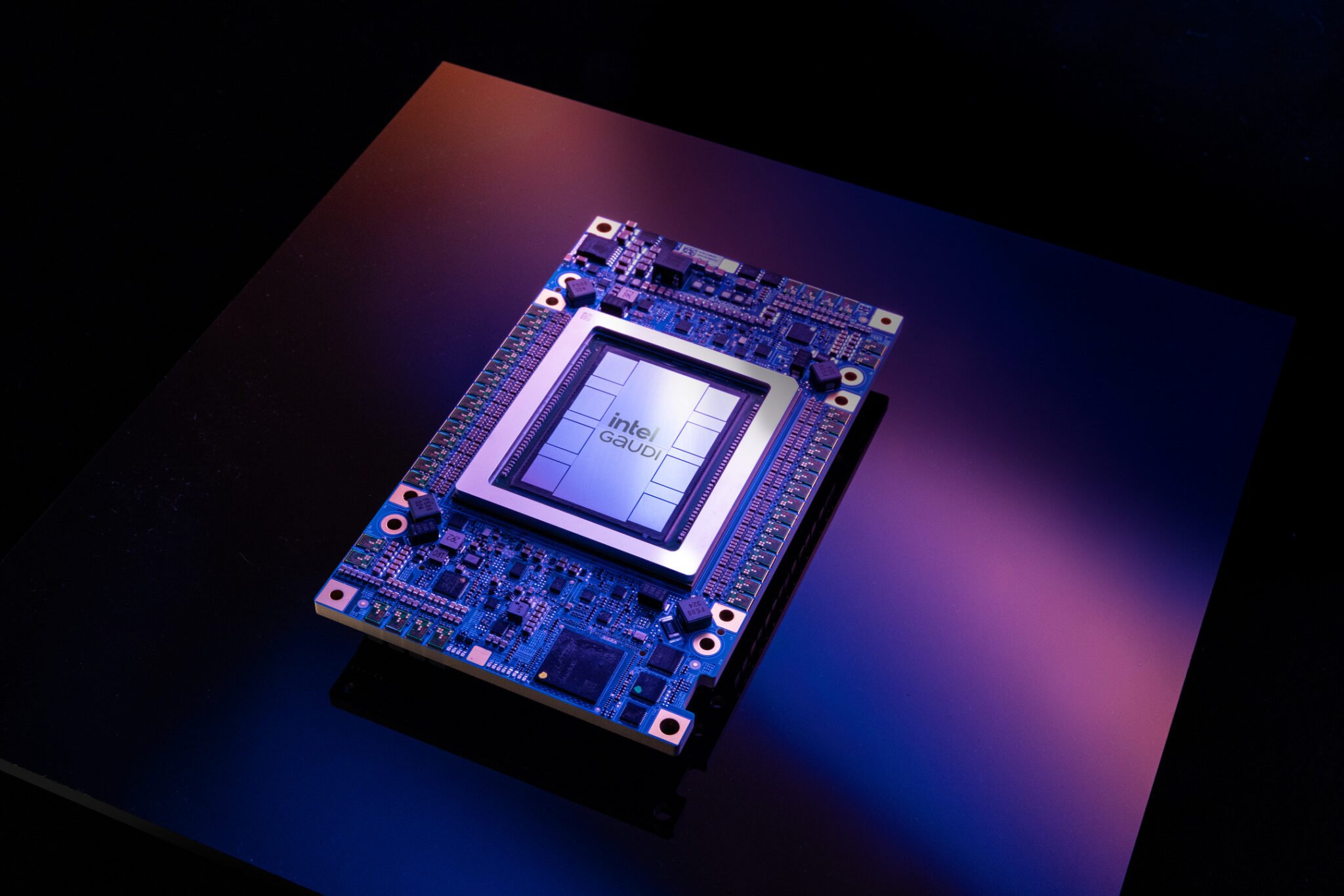

Ein weiteres relevantes Detail ist die technologische Unabhängigkeit. Z.AI ist nicht von der Infrastruktur von OpenAI weder von Cloudflare noch hat Kompatibilität mit angekündigt Huawei Ascend und Cambricon-ChipsDie Integration alternativer Hardware in das von westlichen GPUs dominierte Ökosystem bedeutet für Anwender und Unternehmen eine weitere Bereitstellungsmöglichkeit. IA ohne an einzelne Lieferanten gebunden zu sein.

Hauptmodelle und Funktionen

Die Plattform stützt sich hauptsächlich auf GLM-4.5 und GLM-4.6Letzteres wurde kürzlich angekündigt und bietet Unterstützung für chinesische Chips sowie Verbesserungen bei der Verarbeitung und dem Code. Beide Modelle verwenden eine Mixture-of-Experts-Architektur (MoE) und verarbeiten breite KontextfensterBis zu 128.000 Eingabe-Tokens und rund 96.000 Ausgabe-Tokens ermöglichen die Bearbeitung langer Dokumente, ausführlicher Konversationen und tiefgehender Analysen ohne Verlust der Kohärenz.

In bestimmten Varianten des tiefen logischen Denkens ist GLM-4.6 in der Lage, sehr umfangreiche Inhalte zu synthetisieren (die Fähigkeit, mit Kontexte von bis zu 200 Token (in der Zusammenfassung von Aufgaben). Darüber hinaus verfügt es über multimodale Funktionen: Es versteht Text, verwaltet Code und kann mit Bilder in Analyseabläufenwodurch sich die praktischen Anwendungsmöglichkeiten vervielfachen.

Ein Unterscheidungsmerkmal ist der Aspekt von MittelDas System kann komplexe Aufgaben zerlegen, Schritte orchestrieren, APIs aufrufen und die Abfolge von Aktionen halbautomatisch ausführen. Dadurch lassen sich wiederkehrende Aufgaben oder Arbeitsabläufe, die zuvor Ad-hoc-Skripte erforderten, einfacher optimieren. Es bietet einen „Copiloten“, der über einfache Dialoge hinausgeht.

Innerhalb des Z.ai-Ökosystems erscheinen auch 32B-Parametermodelle für Test- und Vergleichsszenarien, wie zum Beispiel GLM-4-32B (Basis)Das Denkmodell Z1-32B und die kontemplative Variante Z1-Rumination-32B sind enthalten. Dieses Angebot zielt darauf ab, einen unkomplizierten Einstieg zu ermöglichen, sodass jeder die wichtigsten Funktionen ohne jegliche Einrichtungsschritte testen kann.

Z.ai-Plattform: Webzugang und barrierefreies Nutzererlebnis

Der primäre Bereich ist chat.z.aiHier können Sie direkt im Browser chatten. Eine Registrierung ist nicht erforderlich, und die Benutzeroberfläche ist minimalistisch gestaltet: Sie geben Ihre Frage in das Textfeld ein, senden sie ab und erhalten eine Antwort. Neben dem Chat stehen Ihnen weitere nützliche Funktionen zur Verfügung, wie zum Beispiel … Laden und Analysieren von Dateien (TXT, PDF, Word) und Internetrecherchen, um die Antworten mit aktuellen Informationen anzureichern.

Die Plattform dient nicht nur zum Experimentieren: Entwickler können mit einem einzigen Klick in die MaaS-Umgebung von Zhipu "einsteigen". bigmodel.cn um API-Schlüssel zu erhalten und die Modelle in Ihre eigene Anwendung zu integrieren AppsDieser „Schnellschalter“ ist so konstruiert, dass er den Weg des Test zur Entwicklung und um technischen Teams einen reibungsloseren Übergang vom Evaluierungsmodus zum Produktionsmodus zu ermöglichen.

Die Nutzung des Online-Chats ist bis zu einem gewissen Tageslimit kostenlos, das für die meisten Nutzer sehr großzügig bemessen ist. Sobald Sie Ihr Limit erreicht haben, müssen Sie bis zum nächsten Tag warten, um den Chat weiter nutzen zu können. Es lohnt sich also, eine Pause einzulegen. Token-Nutzung optimieren Das richtige Modell für jede Aufgabe auswählen.

Wie Sie Ihren ersten Chat beginnen

Der Einstieg ist ganz einfach: Besuchen Sie die Website, wählen Sie ein Modell aus und geben Sie Ihre Frage ein. Sie benötigen kein Konto, sodass die erste Kontaktaufnahme sofort möglich ist und für viele die Registrierung überflüssig macht. In vier Schritten können Sie loslegen: Melden Sie sich an, wählen Sie ein Modell, stellen Sie Ihre Frage und setzen Sie die Konversation fort..

- Greifen Sie über Ihren Browser auf Z.AI zu.Eine Registrierung ist nicht erforderlich, sodass Sie es spontan ausprobieren können. Dieser Verzicht auf anfänglichen Papierkram wird oft mit einem privateren und direkteren Erlebnis in Verbindung gebracht.

- Wählen Sie das richtige ModellDie GLM-Familie bietet Varianten für logisches Schließen, Codeverarbeitung, Websuche und Zusammenfassungen. Die Wahl der richtigen Variante verbessert die Ausgabequalität und reduziert den Tokenverbrauch.

- Formulieren Sie Ihre Anfrage klar und deutlich.Geben Sie Kontext, definieren Sie Ziele, bitten Sie um einen Stil und fügen Sie gegebenenfalls kurze Beispiele hinzu. Eine gut formulierte Aufgabenstellung macht den entscheidenden Unterschied.

- Wird im selben Thread wiederholtDas Gespräch behält seinen Kontext, sodass Sie nach Anpassungen fragen und tiefer in die Materie einsteigen können, ohne den roten Faden oder die Kohärenz zu verlieren.

Welches Modell eignet sich für welche Aufgabe?

Die Wahl einer bestimmten Variante trägt dazu bei, die Leistung zu maximieren und die tägliche Zufuhr nicht zu überschreiten. Hier finden Sie praktische Richtlinien für gängige Aufgaben unter Berücksichtigung der folgenden Punkte: Spezialisierung GLM-4.5 und GLM-4.6.

- Lange ZusammenfassungenGLM-4.6 mit Deep Reasoning eignet sich am besten für lange Dokumente (Kontexte mit bis zu 200 Tokens). Es synthetisiert in der Regel präzise und erhält die Struktur.

- Programmierung und FehlersucheDie codeoptimierte Variante von GLM-4.6 hat sich in 74 praktischen Szenarien als leistungsfähiger erwiesen als Konkurrenzprodukte. eine zusätzliche Effizienz von 30 %.

- Allgemeine Fragen und grundlegende SchreibtechnikenGLM-4.5 bietet ein ausgewogenes Verhältnis zwischen Tokenqualität und -kosten und ist ideal für alltägliche Abfragen und Standardtexte.

- Dateianalyse und WebsucheGLM-4.6 mit Web-Suchfunktion kombiniert Dokumentenanalyse mit Online-Abfragen und bietet einen multimodalen Ansatz.

Denken Sie daran, dass Token-Verbrauch Das hängt vom Modell und der Aufgabe ab.Daher ist es ratsam, vor dem Absenden die Art der Frage, den Tonfall und die gewünschte Länge zu überprüfen, um das Kontingent nicht für unnötige Interaktionen zu verbrauchen.

Tarife, Limits und APIs

Der Basis-Chat ist kostenlos und bietet großzügige Limits. Falls Sie eine Integration in Prozesse oder Produkte benötigen, steht Ihnen die API über ein System zur Verfügung. Abonnement (nicht per Token)Mit einem sehr günstigen Einsteigertarif ab etwa 3 US-Dollar pro Monat. Anschließend können Sie den Tarif je nach Modell und Datenvolumen anpassen.

Über das API-Panel können Sie Schlüssel erstellen, Nutzungslimits festlegen und die Abrechnung verwalten. Es handelt sich um einen Workflow, der für den Übergang von Pilotversuch Ohne Stolpersteine, sowohl für einzelne Anwender mit Automatisierungsambitionen als auch für Teams, die Kostenkontrolle und Transparenz anstreben.

Desktop-Erfahrung

Wenn Sie Ihre Werkzeuge gerne in separaten Fenstern haben, können Sie Z.AI als Desktop-Anwendung "einbinden" in Windows oder macOS über einen inoffiziellen Wrapper. Es fügt keine nativen Funktionen hinzu, bietet aber Komfort für Multi-Account und Fokus ohne Ablenkungen durch den Browser.

Bewährte Vorgehensweisen, um das Beste daraus zu machen

Ein paar einfache Gewohnheiten können die Qualität und die Kosten erheblich beeinflussen. Betrachten Sie diese Richtlinien als Ihr „Sicherheitsset“ für die Arbeit mit GLM-Modelle effizient vom ersten Tag an

- Aufforderungen mit KontextGeben Sie Zielsetzung, Tonfall, Länge, Zielgruppe und ein Beispiel an. Je klarer das Briefing, desto leichter lässt sich das gewünschte Ergebnis erzielen.

- Testen, messen, anpassenKurze Zyklen mit einfachen KPIs (wahrgenommener Nutzen, Zeitersparnis, Kosten pro Aufgabe). Schnelle Iterationen zur Verbesserung.

- AlternativplanBevor Sie sich zu 100 % festlegen, sollten Sie 2-3 Optionen (Modell oder Lieferant) parallel in Betracht ziehen.

- Redaktionelle RezensionBei öffentlich zugänglichen Werken wird eine zweite menschliche Lesung und eine Quellcodekontrolle hinzugefügt, um die Rückverfolgbarkeit zu gewährleisten.

Vom Probetraining zum MVP in 15 Minuten

Wenn Sie im Handumdrehen von der Idee zum Prototyp gelangen möchten, probieren Sie diesen Leitfaden aus. Er wurde entwickelt, um schnell zu überprüfen, ob Z.AI in Ihren Workflow passt und ob die Beziehung zwischen Z.AI und Ihrem Workflow funktioniert. Qualität/Geschwindigkeit/Kosten übertreffen Sie Ihre Ausgangswerte.

- Probieren Sie es im Internet aus.: Formulieren Sie 3–5 reale Fragen (Marketing, Produkt oder Code) und bewerten Sie Qualität und Latenz.

- Mikro-Kurzbericht: Bitten Sie um eine Gliederung und einen Entwurf (Landingpage, E-Mail oder Snippet) und führen Sie zwei Iterationen durch, um Verständlichkeit und Fehler zu überprüfen.

- Mini-Pilotprojekt mit APIErstellen Sie einen Schlüssel und automatisieren Sie einen wiederkehrenden Prozess (z. B. Ticketzusammenfassung). Überwachen Sie Tokens und Zeiten.

- Es misst ab Minute einsWahrgenommener Nutzen, Anteil gültiger Antworten, Zeitersparnis und Kosten pro Aufgabe. Werden die Zielvorgaben nicht erreicht, ist das Experiment abzubrechen und ein anderer Ansatz zu versuchen.

Schneller Vergleich mit anderen KIs

Gegen ChatGPT, Claude oder GeminiZ.AI setzt im Wettbewerb klar auf Begründung und KostenDer tatsächliche Vorteil hängt von der Sprache, den verfügbaren Werkzeugen (Suche, Dateien, Agenten) und der Latenz in Ihrer Region ab. Seine Stärken spielt es vor allem bei strukturierten und codebasierten Aufgaben aus, dank GLM-4.6.

Ebenso im Vergleich zu Optionen wie DeepSeekZ.AI kann sich als Alternative positionieren wirtschaftlicher In bestimmten Szenarien, die endgültige Entscheidung hängt jedoch von Ihrem Volumen, Ihren Vereinbarungen und Ihrer Architektur ab. Laut den in den Quellen zitierten Benchmarks übertrifft die GLM-Serie die neuesten GPT-Modelle in Bezug auf logisches Denken und Codierung; betrachten Sie dies als nützlichen Hinweis und Überprüfen Sie es in Ihrem eigenen Anwendungsfall. vor dem Applaus oder der Ablehnung.

Praktische Funktionen: Datei-, Web- und multimodaler Ansatz

Das Hochladen von Dateien (TXT, PDF, Word) ist eine sehr praktische Funktion: Sie laden das Dokument und die Vorlage hoch. analysiere seinen Inhalt Darauf basierend reagieren. Nützlich für Berichte, Handbücher, interne Wissensdatenbanken oder juristische Dokumente, die einen ständigen Kontext erfordern.

Die Option von Im Web suchen Es liefert zusätzliche Informationen, insbesondere wenn Sie aktuelle Fakten oder unterschiedliche Quellen benötigen. Bedenken Sie jedoch, dass jede Suchanfrage mehr Ressourcen beanspruchen kann. Nutzen Sie diese Funktion daher nur, wenn sie wirklich einen Mehrwert bietet.

Die multimodale Unterstützung ermöglicht visuelle Referenzen und Aufgaben, bei denen Bilder den Text ergänzen. Es handelt sich nicht um einen Grafikeditor, sondern um eine KI, die versteht Visuelle Hinweise im Rahmen Ihres kommunikativen oder technischen Ziels.

Katalog der Modelle im "Tester"-Modus

Zusätzlich zu GLM-4.5/4.6 bietet die Plattform einen „Tester“ mit 32 Milliarden Modellen zum Vergleich des Echtzeitverhaltens. Diese umfassen die GLM-4-32B (Basis)Z1-32B ist auf rationales Denken ausgerichtet, während Z1-Rumination-32B einen kontemplativen/tiefgründigen Fokus hat. Ziel ist es, dass Sie mit kontrastierenden Varianten experimentieren und eine auswählen. kein Eintritt derjenige, der am besten passt.

Wenn Sie nach der Evaluierungsphase in die Produktion wechseln möchten, können Sie sich mit einem einzigen Klick mit der MaaS-Umgebung von Zhipu verbinden unter bigmodel.cn zur Verwaltung von APIs, Limits und Abrechnung. Diese Kontinuität verringert die Reibungsverluste zwischen „Mir gefällt, was ich sehe“ und „Lasst es uns integrieren“.

Geschäfts-, Finanzierungs- und Open-Source-Strategie

Zhipu AI hat erstklassige Unterstützung erhalten, unter anderem durch Investitionen von Alibaba, Tencent und dem Prosperity7-Fonds. Neben der hohen Bewertung zeichnet sich das Unternehmen durch [fehlende Informationen – vermutlich eine spezifische Plattform oder Strategie] aus. Setzen Sie auf Open SourceGLM-Modelle können unter der MIT-Lizenz heruntergeladen und verwendet werden, was lokale Implementierungen ermöglicht, ohne an geschlossene Dienste gebunden zu sein.

Kompatibilität mit alternativer Hardware (Huawei Ascend, Cambricon) und die Tatsache, dass sie nicht von OpenAI oder Cloudflare abhängig sind, unterstreichen ihre Unabhängigkeit. Für viele Unternehmen ist dies von entscheidender Bedeutung: Lieferanten diversifizieren und Risiken reduzieren Technisches und kaufmännisches Fachwissen ist zur Voraussetzung geworden.

Beispiele und Anwendungsfälle

Im täglichen Gebrauch funktioniert Z.AI gut als Assistent für Inhalt beantworten und erläutern technische oder allgemeine Texte schreiben und bearbeiten (Artikel, interne Notizen, E-Mails) und als Unterstützung bei der Entwicklung (Generierung, Debugging und Erläuterung von Code, Vorschlag von Tests, Vorschläge für Refaktorierungen).

Es eignet sich auch für den internen Support: die Umwandlung von Dokumenten in Antworten im Stil einer Wissensdatenbank, die Erstellung von Managementzusammenfassungen von Berichten oder die Vorbereitung von Kurzfassungen und FAQs Für Teams ohne technische Vorkenntnisse. Der Agentenmodus hilft dabei, Schritte zu verketten, sodass Sie einfache Prozesse ohne aufwändige Programmierung automatisieren können.

Als praktisches Beispiel sei eine Aufgabenstellung der Art „Erstelle ein interaktives Dashboard Dies zeigt die Zunahme des Windes an den Küsten Andalusiens“, und es wurden nützliche Ergebnisse für die Prototypenentwicklung visualisiert. Diese Art von Schnelltest dient der Kalibrierung der wahrgenommene Qualität und Geschwindigkeit vor der Integration des Tools in die Produktion.

Z.AI positioniert sich als vielseitiger Assistent, der sofortigen kostenlosen Zugriff kombiniert High-End-GLM-ModelleEs bietet Agentenfunktionen und eine direkte Schnittstelle zu APIs für Teams. Wenn Sie Wert auf Kosten, Leistung und technologische Freiheit legen, sollten Sie es unbedingt in Betracht ziehen; messen Sie von Anfang an und entscheiden Sie sich für die Lösung, die Ihren tatsächlichen Bedürfnissen am besten entspricht.

Leidenschaftlicher Autor über die Welt der Bytes und der Technologie im Allgemeinen. Ich liebe es, mein Wissen durch Schreiben zu teilen, und genau das werde ich in diesem Blog tun und Ihnen die interessantesten Dinge über Gadgets, Software, Hardware, technologische Trends und mehr zeigen. Mein Ziel ist es, Ihnen dabei zu helfen, sich auf einfache und unterhaltsame Weise in der digitalen Welt zurechtzufinden.