- GAIA führt LLM lokal aus auf Windows mit Hybrid-NPU+iGPU-Unterstützung auf Ryzen AI.

- Verwenden Sie Lemonade SDK und RAG (LlamaIndex) für kontextualisierte und genaue Antworten.

- Zwei Installationsprogramme: Hybrid (Ryzen AI 300) und generisch mit Ollama für jeden PC.

La künstliche Intelligenz Die generative Technologie erlebt derzeit einen Boom und damit ist auch die Notwendigkeit, große Sprachmodelle zu Hause auszuführen, sprunghaft angestiegen. In diesem Zusammenhang AMD GAIA scheint ein einfacher Weg zu sein, LLM lokal ausführen, ohne auf die Cloud angewiesen zu sein und die Privatsphäre Ihrer Daten zu stärken. Dieser Open-Source-Vorschlag ist für Windows konzipiert, funktioniert auf allgemeinen Computern und, wenn vorhanden Hardware Ryzen AI nutzt die NPU und sogar die iGPU, um die Inferenz zu beschleunigen.

Wenn Sie sich Sorgen darüber machen, was Sie an externe Server senden, oder wenn Sie das Warten satt haben, wird Ihnen dieses Projekt wie himmlische Musik vorkommen, denn GAIA bietet geringere Latenz, bessere Kontrolle und hochoptimierte Leistung in portátiles mit AMD Ryzen AI 300 SerieDarüber hinaus stützt es sich auf das Lemonade SDK, um einen mit der Lemonade-API kompatiblen Webdienst bereitzustellen. OpenAI, integriert eine RAG-Pipeline zur Kontextualisierung von Antworten und sorgt dafür, dass die Agenten von der ersten Minute an einsatzbereit sind.

Was ist AMD GAIA und was genau bietet es?

GAIA ist eine Weiterentwicklung von Open Source-orientiert zum Installieren und Ausführen von Anwendungen Generative KI direkt auf Ihrem Windows-PC. Es ist so konzipiert, dass jeder LLMs – wie Llama-Familien und Derivate – ausführen kann, ohne eine komplexe Infrastruktur einrichten oder vertrauliche Informationen in die Cloud senden zu müssen.

Sein großer Vorteil ist, dass Nutzen Sie die Vorteile der Neural Processing Unit (NPU) der Ryzen AI voll aus Und im Hybridmodus kombiniert es diese NPU mit der integrierten GPU (iGPU), um die Last zu verteilen und die Inferenz weiter zu beschleunigen. Auf kompatiblen Maschinen liefert die Ryzen AI 300 NPU bis zu 50 TOPS, was zu reibungslosen, energieeffizienten Aufgaben in natürlicher Sprache führt.

Gleichzeitig erwägt das Projekt einen universellen Weg: ein generisches Installationsprogramm, das auf jedem Windows-PC funktioniert, unabhängig davon, ob es sich um AMD handelt oder nicht. Dieser Modus verwendet Ollama als Backend zum Ausführen der Modelle, sodass Sie GAIA auch dann ausprobieren können, wenn Ihr Computer keine dedizierte Beschleunigerhardware hat.

Um die Antworten zu bereichern, konzentriert sich GAIA auf Recovery Enhanced Generation (RAG)Dies ermöglicht das Abrufen relevanter Informationen, das Argumentieren mit zusätzlichem Kontext, die Planung und den Einsatz externer Tools in einem wirklich interaktiven Chat-Erlebnis. Das Projekt umfasst derzeit vier sofort einsatzbereite Agenten, und mit Community-Unterstützung sind weitere in Vorbereitung.

Technische Architektur: Lemonade SDK, RAG und GAIA-Komponenten

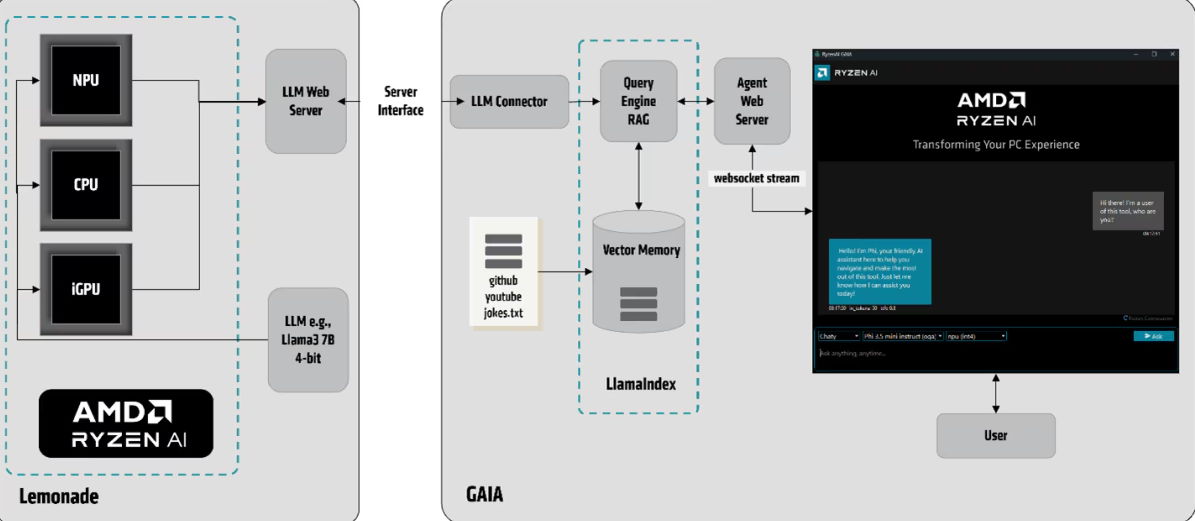

Die technische Basis basiert auf der Lemonade SDK (TurnkeyML/ONNX), das Dienstprogramme für LLM-spezifische Aufgaben bereitstellt: Eingabeaufforderung, Präzisionsmessung und Bereitstellung über mehrere Laufzeiten (z. B. Hugging Face oder ONNX Runtime GenAI API) und Hardware (CPU, iGPU und NPU).

In diesem Schema Lemonade stellt einen LLM-Webdienst mit einer OpenAI-kompatiblen REST-API bereit, und GAIA nutzt diesen Dienst, um das Erlebnis zu orchestrieren. Innerhalb von GAIA finden wir drei Schlüsselblöcke die wie angegossen zur RAG-Pipeline passen:

- LLM-Anschluss: Verbindet die NPU-Service-Web-API mit der LlamaIndex-basierten RAG-Pipeline und verwaltet Aufrufe und Eingabeaufforderungsformatierung.

- RAG-Pipeline mit LlamaIndex: Enthält die Abfrage-Engine und einen Vektorspeicher, der für die Verarbeitung und Speicherung relevanter Kontexte aus externen Quellen verantwortlich ist.

- Agent-Webserver: verbindet sich über WebSocket mit der GAIA-Schnittstelle, ermöglicht Echtzeit-Interaktion mit dem Benutzer.

Der Arbeitsablauf ist klar und erhöht die Genauigkeit: Ihre Abfrage ist vektorisiert, der relevante Kontext wird aus lokalen Indizes abgerufen, dieser Kontext wird in die LLM-Eingabeaufforderung eingefügt und schließlich Die Antwort wird gesendet von Streaming zur Benutzeroberfläche. Dadurch gelangt jede Anfrage angereichert in das Modell und verbessert die Qualität der Antworten.

Installateure und Betriebsarten

GAIA wird in zwei Varianten angeboten, passend zu Ihrer Hardware und Ihren Anforderungen: Hybridinstallateur y allgemeines InstallationsprogrammDie Idee ist, dass Sie es auf einem Laptop mit Ryzen AI der neuesten Generation oder auf einem Standard-Windows-PC verwenden können.

- Hybridmodus (Ryzen AI 300-Serie): Kombiniert NPU + iGPU für maximale Leistung und Effizienz. Bei Inferenz-Workloads Jede Einheit führt das aus, was sie am besten kann (z. B. quantisierte Operationen und bestimmte Kernel), wodurch schnellere Reaktionen und ein geringerer Stromverbrauch erreicht werden.

- Generischer Modus (jeder Windows-PC): ist der universelle Weg. Es verwendet Ollama als Backend um LLMs zu bedienen und macht es jedem leicht, GAIA ohne besondere Hardwareanforderungen zu starten.

Ein praktisches Detail: Beide Modi verwenden den von Lemonade bereitgestellten LLM-Webdienst und kommunizieren Sie mit der Anwendung über eine OpenAI-kompatible REST-API. Dies macht die Integration von GAIA in Ihre Arbeitsabläufe (oder die Migration von Legacy-Tools) unglaublich einfach.

Systemanforderungen und Kompatibilität

Für den Hybridmodus Sie benötigen einen Computer mit AMD Ryzen AI 300 Series-Prozessoren, zusätzlich zu den entsprechenden Treibern für die Radeon iGPU (z. B. 890M) und NPU. Dieser Modus ermöglicht maximale Leistung und niedrigste Latenz.

Was das Gedächtnis angeht, 16 GB RAM werden als Minimum empfohlen, wobei 32 GB ein komfortablerer Wert für die Arbeit mit langen Kontexten oder anspruchsvolleren Modellen sind. Auf Betriebssystemebene liegt der Fokus auf Windows 11 (Home/Pro), obwohl das Standardinstallationsprogramm auch mit Windows 10/11 kompatibel ist.

Wenn Sie diese Anforderungen nicht erfüllen, ist das in Ordnung: Sie können GAIA im generischen Modus installieren und experimentieren Sie mit lokalen LLMs unter Verwendung Ihrer CPU/GPU und Ollama als Backend. Der Unterschied liegt in der Leistung im Vergleich zur Hybridoption.

Schrittweise Installation

Der Startvorgang ist unkompliziert. Laden Sie das Installationsprogramm aus dem offiziellen GitHub-Repository herunter und wählen Sie die Version, die zu Ihrer Ausrüstung passt (Hybrid für Ryzen AI 300, generisch für den Rest).

Sobald Sie die Datei haben, entpacken und die .exe ausführenWenn Windows eine Sicherheitswarnung (SmartScreen) anzeigt, gehen Sie zu „Weitere Informationen“ und klicken Sie auf „Trotzdem ausführen“. Die Installation dauert in der Regel 5 bis 10 Minuten, abhängig von Ihrer Verbindung.

Wenn Sie fertig sind, werden auf Ihrem Desktop zwei Verknüpfungen angezeigt: GAIA-GUI und GAIA-CLIDer erste Lauf kann etwas länger dauern, weil die notwendigen Modelle werden heruntergeladen und Abhängigkeiten. In einigen Fällen fordert der Assistent Sie zum Herunterladen bestimmter LLMs nach einem Hugging Face-Token auf.

Wenn Sie per Konsole navigieren möchten, Öffnen Sie GAIA-CLI und führen Sie „gaia-cli -h“ aus. um die verfügbaren Optionen anzuzeigen. Die CLI bietet eine detaillierte Kontrolle über Parameter (Modell, Quantisierung, Kontext usw.) und ermöglicht Ihnen die Automatisierung von Tests oder die Integration in Skripte.

Grafische Oberfläche (GUI) und Befehlszeile (CLI)

Die GUI ist für Benutzer konzipiert, die es schnell und unkompliziert mögen: GAIA-GUI öffnen und chatten mit Agenten, laden Sie Dokumente hoch, indizieren Sie Repositories und nutzen Sie die RAG mit ein paar Klicks.

In der CLI finden Sie vollständige Flexibilität. Sie können Modelle auswählen, die Quantisierung anpassen oder Kontextgrößen definieren. explizit. Es eignet sich ideal für die Leistungsbewertung, den Vergleich von Parametern und die Orchestrierung von GAIA innerhalb von Entwicklungspipelines.

Auch danke an Der LLM-Dienst ist mit der OpenAI-API kompatibel, die Integration von GAIA in vorhandene Tools oder das Testen von Eingabeaufforderungen, die Sie bereits in anderen Diensten verwendet haben, ist eine Frage der Anpassung eines Endpunkts und wenig mehr.

Verfügbare Agenten und RAG-Technologie

Heute umfasst GAIA vier Agenten, die auf unterschiedliche Verwendungszwecke ausgerichtet sind, und das Team entwickelt es – zusammen mit der Community – weiter. Jeder Agent nutzt die RAG-Pipeline, um Kontext aus lokalen Vektorindizes abzurufen und die LLM-Reaktionsfähigkeit zu verbessern.

- Einfache Eingabeaufforderungsvervollständigung: Direkte Interaktion mit dem Modell zum Testen und Auswerten von Eingabeaufforderungen; perfekt für die Feinabstimmung vor der Bereitstellung.

- Cottages: der Konversations-Chat-Agent, der verwaltet Dialogverlauf und unterstützt eine natürlichere Konversation.

- Beschneiden: integriert YouTube-Such- und Q&A-Funktionen; kann Externe Inhalte vektorisieren und verwenden Sie es als Kontext.

- Joker: ein Witzgenerator, der humanisiert die Erfahrung und wird zum Testen von Ausgabestilen verwendet.

In Kombination mit RAG können Agenten auch externe Tools nutzen, begründen und planen Aufgaben und öffnet die Tür zu interaktiven und produktiven Arbeitsabläufen, ohne die lokale Umgebung zu verlassen.

Leistung: NPU vs. iGPU und Hybridmodus

Die Ryzen AI NPU ist so konzipiert, Inferenzlasten von IA und glänzt in Effizienz und Latenz. GAIA kann ab der Veröffentlichung der Ryzen AI 1.3-Software Folgendes bereitstellen Quantisierte LLMs im Hybridmodus, indem sowohl NPU als auch iGPU verwendet werden und jeder Komponente die Operationen zugewiesen werden, die sie am besten beherrscht.

Was haben Sie davon? Schnellere Reaktionen, geringerer Stromverbrauch und ein reibungsloses Erlebnis selbst bei schwereren Modellen oder längeren Kontexten. Und wenn Ihr Computer keine NPU hat, ist GAIA im generischen Modus immer noch nützlich, mit einer auf die verfügbare Hardware zugeschnittenen Leistung.

Vorteile der lokalen Ausführung von LLMs

Der erste große Vorteil ist die Datenschutzerklärung: Es ist nicht erforderlich, Daten an externe Server zu senden, was in sensiblen Bereichen oder beim Umgang mit vertraulichen Informationen von entscheidender Bedeutung ist.

Es hebt auch die geringe WartezeitDa man nicht auf das Netzwerk angewiesen ist, kommen die Antworten schneller und die Interaktion fühlt sich unmittelbar an, was für die Produktivität und ein gutes Benutzererlebnis entscheidend ist.

Schließlich ist die Leistung vorhersehbarer. Optimierung für NPU (und iGPU) Damit können Sie die Hardware Ihres Computers optimal nutzen und haben dabei einen geringeren Energieverbrauch und weniger Wärmeentwicklung während langer Sitzungen.

Deinstallation und Wartung

Wenn Sie GAIA deinstallieren müssen, ist der Vorgang sehr einfach. Alle Instanzen schließen (CLI und GUI) um Dateisperren zu vermeiden, bevor etwas gelöscht wird.

Dann Löschen Sie den GAIA-Ordner in AppData und löschen Sie die Modellordner, die in .Zwischenspeicher. Entfernen Sie abschließend die Verknüpfungen vom Desktop und Sie sind fertig.

Diese manuelle Methode gleicht die Tatsache aus, dass es noch kein automatisches Deinstallationsprogramm gibt. In wenigen Minuten haben Sie ein sauberes System. und ohne Spuren lokaler Modelle oder Indizes.

Anwendungsfälle und Branchen, in denen es passt

GAIA ist besonders dort interessant, wo Datenschutz im Vordergrund steht: Gesundheitswesen, Finanzwesen und Unternehmensumgebungen Sie können viel gewinnen, wenn sie KI lokal ausführen und die Abhängigkeit von Dritten verringern.

Es fügt auch Szenarien ohne stabile Verbindung hinzu: Zentren mit eingeschränkter oder keiner WLAN-Konnektivität kann KI-Workflows ausführen, ohne auf die Cloud angewiesen zu sein.

Für die Erstellung von Inhalten, den Kundenservice und interne Assistenten, Agenten mit RAG Sie liefern kontextualisierte und konsistente Antworten mit Ihren lokalen Quellen (Repositories, Dokumente, Videos usw.).

Vergleich mit anderen lokalen Lösungen

Angesichts von Alternativen wie LM Studio oder ChatRTXGAIA konzentriert sich auf die tiefe Integration mit AMD-Hardware, insbesondere Ryzen AI NPUs, und auf eine robuste RAG-Pipeline darauf ausgelegt, lokales Wissen wiederherzustellen und zu nutzen.

Darüber hinaus ist das Projekt offen und erweiterbar. Sie können Ihre eigenen Agenten und Anwendungsfälle erstellen ohne sich mit Blackboxen herumschlagen zu müssen, und die OpenAI-kompatible REST-API-Unterstützung macht die Integration mit Apps bestehenden.

Neuigkeiten und Impulse für 2025

Das Team hinter GAIA hat Verbesserungen implementiert, die die Bandbreite der Szenarien erweitern. Dazu gehören: verbesserte Unterstützung für Tensor Cores NVIDIA Dies beschleunigt die Ausführung bei der Arbeit mit GPUs dieser Marke in bestimmten Flows.

Es ist auch die Rede von Integration mit Cloud-Plattformen wie GCP und AWS um umfangreiche Arbeiten und Synchronisierungen zu erleichtern, wenn Sie lokale/Cloud-Umgebungen auf kontrollierte Weise kombinieren müssen.

Eine weitere bemerkenswerte Zeile ist die verbesserte ONNX-Unterstützung, was die Interoperabilität zwischen KI-Frameworks erhöht und den Austausch von Modellen zwischen Plattformen erleichtert. Es gibt sogar Werkzeuge zum Experimentieren mit Quanten-KIund öffnet so die Tür zu Spitzenforschung und -tests.

Lizenz, Community und Roadmap

GAIA wird vertrieben unter MIT-Lizenz und sein GitHub-Repository lädt Sie zur Zusammenarbeit ein: Melden Sie Probleme, schlagen Sie Verbesserungen vor und erstellen Sie neue Agenten, die mehr tatsächliche Anforderungen abdecken.

Am Horizont erwähnt die Roadmap mehr unterstützte Modelle und Architekturen, neue Agenten für vertikale Fälle, eine mögliche Ausweitung auf andere OS und kontinuierliche Verbesserungen der NPU-Effizienz.

GAIA vereint alles, was jeder braucht, der ein seriöses lokales Setup sucht: Datenschutz, Leistung und eine Architektur, die sich gut in Ihren Arbeitsablauf integriertWenn Sie einen Laptop der Ryzen AI 300-Serie besitzen, verschafft Ihnen der Hybridmodus einen klaren Vorteil; andernfalls können Sie mit dem generischen Modus noch heute beginnen und von dort aus weitermachen.

Leidenschaftlicher Autor über die Welt der Bytes und der Technologie im Allgemeinen. Ich liebe es, mein Wissen durch Schreiben zu teilen, und genau das werde ich in diesem Blog tun und Ihnen die interessantesten Dinge über Gadgets, Software, Hardware, technologische Trends und mehr zeigen. Mein Ziel ist es, Ihnen dabei zu helfen, sich auf einfache und unterhaltsame Weise in der digitalen Welt zurechtzufinden.