- CUDA ermöglicht Beschleunigung IA und wissenschaftliches Rechnen auf GPUs NVIDIA mit optimierten Bibliotheken und Tools.

- WSL2 in Windows 11/10 (21H2+) unterstützt CUDA mit Treiber geeignet und Docker mit GPU.

- En Linux, richten Sie den NVIDIA-Treiber und die Toolkit-Version aus (z. B. 560 + CUDA 12.6) und legen Sie PATH/LD_LIBRARY_PATH fest.

- Unterstützt PyTorch und Container; Miniconda und Optimierungen wie Swap verbessern Stabilität und Fluss.

Wenn Sie mit KI, Datenwissenschaft oder Simulationen arbeiten, ist die Installation von NVIDIA CUDA einer der Schritte, die den entscheidenden Unterschied ausmachen. GPU-Beschleunigung Es vervielfacht die Leistung und heute erkläre ich ausführlich und ohne Umschweife, wie man es sowohl unter Windows (einschließlich WSL) als auch unter nativem Linux einrichtet.

Sie sehen alles von Voraussetzungen und Vorprüfungen bis hin zur Treiberinstallation, dem CUDA-Toolkit, Tests mit PyTorch und Docker und einer Bonusfunktion zu Miniconda, Swap und Servereinstellungen. Der Leitfaden vereint Best Practices und beheben Sie häufige Fehler, damit Sie keine Zeit mit dem Offensichtlichen verschwenden.

Was ist CUDA und warum es Sie interessieren könnte

CUDA ist NVIDIAs Ökosystem für paralleles Rechnen, mit dem Sie Ihre GPU für viel mehr als nur Grafik nutzen können. Es umfasst Compiler, Bibliotheken und Tools die Workloads wie Deep Learning, wissenschaftliche Analysen oder Simulationen beschleunigen.

Versionen wie 11.8 oder 12.6 kommen mit Leistungsverbesserungen, Unterstützung für Hardware reciente, fein abgestimmtes Speichermanagement und hochentwickelte Integration mit Frameworks wie TensorFlow und PyTorch. Das Ergebnis: höhere Geschwindigkeit und Stabilität für anspruchsvolle Projekte.

Zusätzlich zu den High-Level-Bibliotheken orchestriert die CUDA-Laufzeit die Ausführung von Kerneln, verwaltet den Speicher auf der GPU und erleichtert die Skalierung Ihrer Anwendungen durch die parallele Nutzung Tausender Kerne. Für moderne KI-Workloads ist es buchstäblich die Grundlage.

Wenn Sie unter Windows entwickeln, ist ein entscheidender Vorteil, dass WSL2 ermöglicht die Verwendung von CUDA innerhalb von Linux-Distributionen wie Ubuntu oder Debian, fast nativ, mit Unterstützung für Docker und NVIDIA Container Toolkit. Es ist eine sehr leistungsstarke Option für gemischte Umgebungen.

Anforderungen und Kompatibilität

Stellen Sie vor der Installation sicher, dass Ihre Hardware und Ihr System die Anforderungen erfüllen. Sie benötigen eine NVIDIA-GPU mit Compute Capability 3.0 oder höher für CUDA 11.8 und moderner Unterstützung für neuere Versionen wie 12.6.

Unter Linux können Sie mit folgendem Befehl prüfen, ob eine GPU vorhanden ist: lspci | grep -i nvidiaWenn Sie den empfohlenen Treiber für Ubuntu ermitteln möchten, versuchen Sie Folgendes: Ubuntu-Treibergeräte. Unter Windows sehen Sie sich die Geräte-Manager unter „Grafikkarten“.

Was Systeme betrifft, wurde CUDA 11.8 weit verbreitet in Windows 10/11 64-bit und Distributionen wie Ubuntu 18.04 und 20.04 sowie RHEL/CentOS 7/8. Für WSL, Windows 11 und Windows 10 Version 21H2 oder höher unterstützen GPU-Berechnungen mit CUDA innerhalb des Linux-Subsystems.

Stellen Sie für WSL2 sicher, dass Sie über einen aktualisierten Kernel verfügen. 5.10.43.3 oder höher ist erforderlich. Sie können die Version von überprüfen Powershell mit: wsl cat /proc/version. Halten Sie außerdem Windows Update auf dem neuesten Stand (Einstellungen > Windows Update > Nach Updates suchen).

Was das Gedächtnis betrifft, ist es für Trainingsaufgaben praktisch, mindestens 8 GB RAM im System und 4 GB VRAM auf der GPU, obwohl viele Modelle deutlich mehr zu schätzen wissen. Eine x86_64-CPU und ein moderner C++-Compiler (C++14 oder höher) runden die Liste ab.

Installation unter Windows 11/10 mit WSL2

Die richtige Reihenfolge vermeidet Kopfschmerzen: Zuerst WSL aktivieren und Linux installieren, dann die NVIDIA-Treiber für Windowsund innerhalb von WSL das CUDA Toolkit sowie Ihre KI-Bibliotheken. Optional können Sie am Ende Docker Desktop hinzufügen.

1) Aktivieren Sie WSL von PowerShell mit Administratorberechtigungen: aktiviert die Funktion und starten Sie neu, wenn Sie dazu aufgefordert werden.

Enable-WindowsOptionalFeature -Online -FeatureName Microsoft-Windows-Subsystem-Linux

2) Aktualisieren Sie den WSL-Kernel von PowerShell auf die neueste Version: wsl –aktualisierenInstallieren Sie anschließend Ihre bevorzugte Distribution (z. B. Ubuntu 22.04 LTS):

wsl --install -d Ubuntu-22.04

3) Öffnen Sie die neu installierte Ubuntu-Anwendung, aktualisieren Sie Indizes und Pakete und installieren Sie grundlegende Dienstprogramme. Halten Sie das System auf dem neuesten Stand reduziert Folgeausfälle.

sudo apt update && sudo apt -y upgrade

4) Installieren Sie in Ubuntu (WSL) Python pip und das CUDA Toolkit aus den offiziellen Repos. GPU-Treiber sind in WSL nicht installiert im Linux-Kernel, diese gehen in Windows.

sudo apt -y install python3-pip nvidia-cuda-toolkit

5) Fügen Sie den Pfad zu Ihren Benutzerskripten zu Ihrem PATH hinzu, um Probleme beim Ausführen von mit pip installierten Tools zu vermeiden. Dies beschleunigt die Nutzung von Dienstprogrammen ohne absolute Routen.

nano ~/.bashrc

# Al final añade, adaptando 'usergpu' a tu usuario

export PATH=/home/usergpu/.local/bin${PATH:+:${PATH}}

# Guarda (Ctrl+O), sal (Ctrl+X) y recarga

source ~/.bashrc

6) Installieren Sie die NVIDIA-Treiber für WSL Laden Sie unter Windows den CUDA-fähigen Treiber von der NVIDIA/Microsoft-Website herunter (GPU-Compute-Treiber für WSL). Starten Sie Windows nach der Installation gegebenenfalls neu.

7) Überprüfen Sie die Kernelversion in WSL und ob alles reagiert: wsl cat /proc/versionWenn Sie Version 5.10.43.3 oder höher verwenden, ist das großartig. Halten Sie Windows Update auf dem neuesten Stand, um WSL2-Verbesserungen zu erhalten.

8) Installieren Sie PyTorch mit CUDA-Unterstützung in Ubuntu (WSL). Der Index cu118 ist eine weit verbreitete, stabile Option. So nutzen Sie die GPU in Ihren Notebooks oder Skripten.

pip3 install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

9) Schnelltest in Python: Laden Sie PyTorch und prüfen Sie, ob CUDA verfügbar ist und wie viele GPUs es erkennt. Dies bestätigt, dass der Stapel funktioniert..

python3

>>> import torch

>>> torch.cuda.device_count()

# Ejemplo de salida: 1 (o más, según tu equipo)

>>> torch.cuda.is_available()

# Esperado: True

10) Docker mit GPU auf WSL: Installieren Sie Docker Desktop unter Windows, aktivieren Sie es und führen Sie Tests von Ubuntu WSL aus. NVIDIA Container Toolkit Es wird in WSL für Linux-ähnliche Szenarien unterstützt.

docker run --rm -it --gpus=all nvcr.io/nvidia/k8s/cuda-sample:nbody \

nbody -gpu -benchmark -numdevices=1

Wenn bei mehreren GPUs der Fehler „Nur 0 Geräte verfügbar“ angezeigt wird, besteht eine bekannte Lösung darin, jede GPU im Windows-Geräte-Manager (Grafikkarten > Aktion > Deaktivieren und dann Aktivieren). Wiederholen Sie anschließend den Test.

Native Installation unter Linux (Ubuntu/Mint und Derivate)

Unter nativem Linux ist der empfohlene Pfad: Installieren Sie die offizieller NVIDIA-Treiber, dann das CUDA Toolkit und schließlich die Konfiguration der Umgebungsvariablen. In neueren Versionen funktionieren der 560-Zweig des Treibers und CUDA 12.6 sehr gut.

1) Fügen Sie die Grafiktreiber PPA (Ubuntu) hinzu und installieren Sie den 560-Treiber. Starten Sie neu damit der Kernel das aktualisierte Modul laden kann.

sudo add-apt-repository ppa:graphics-drivers/ppa

sudo apt update

sudo apt install -y nvidia-driver-560

# Reinicia el equipo

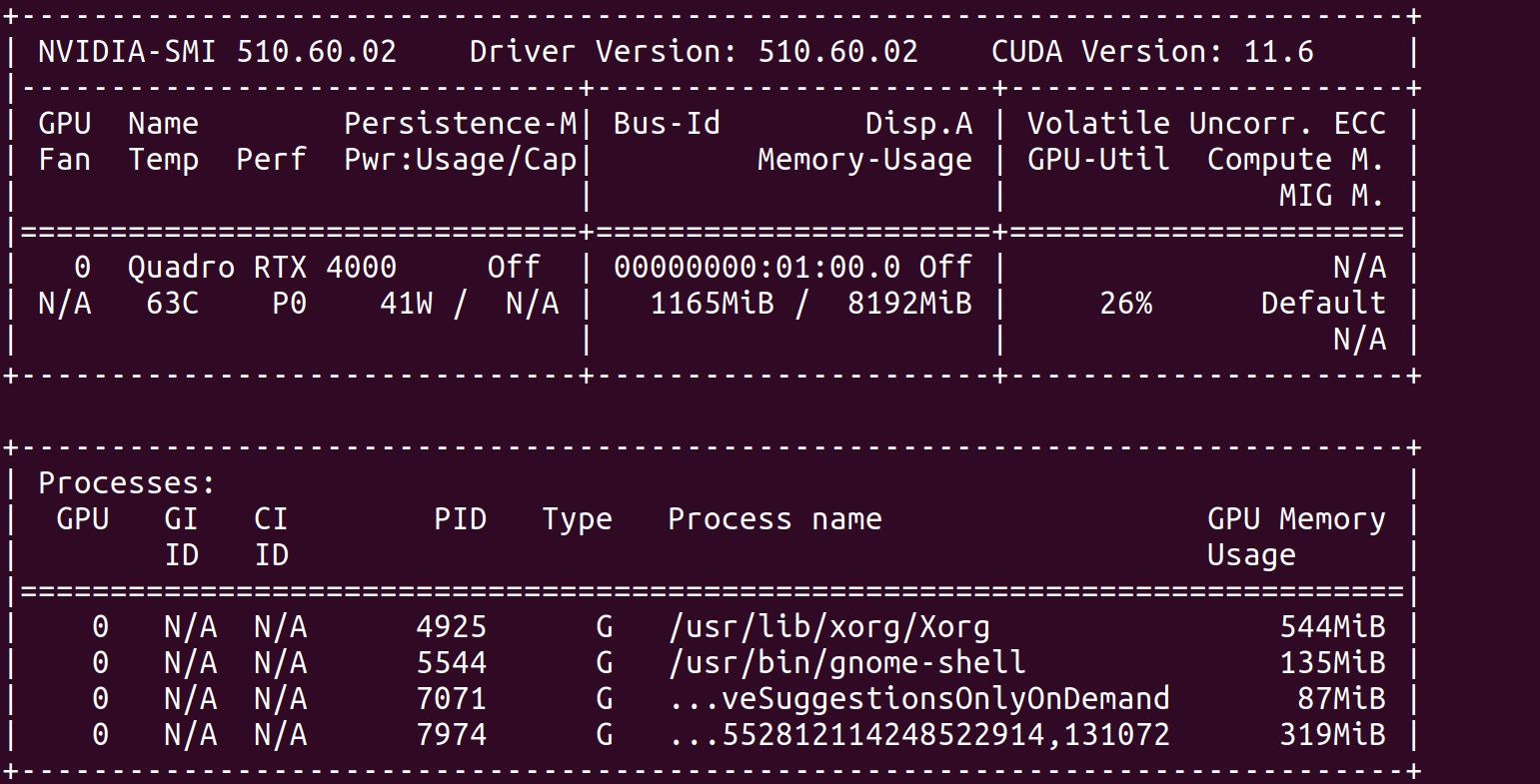

2) Überprüfen Sie mit nvidia-smi, ob der Treiber betriebsbereit ist. Es sollte Version, GPU und Speicher anzeigen bevor Sie mit CUDA fortfahren.

nvidia-smi

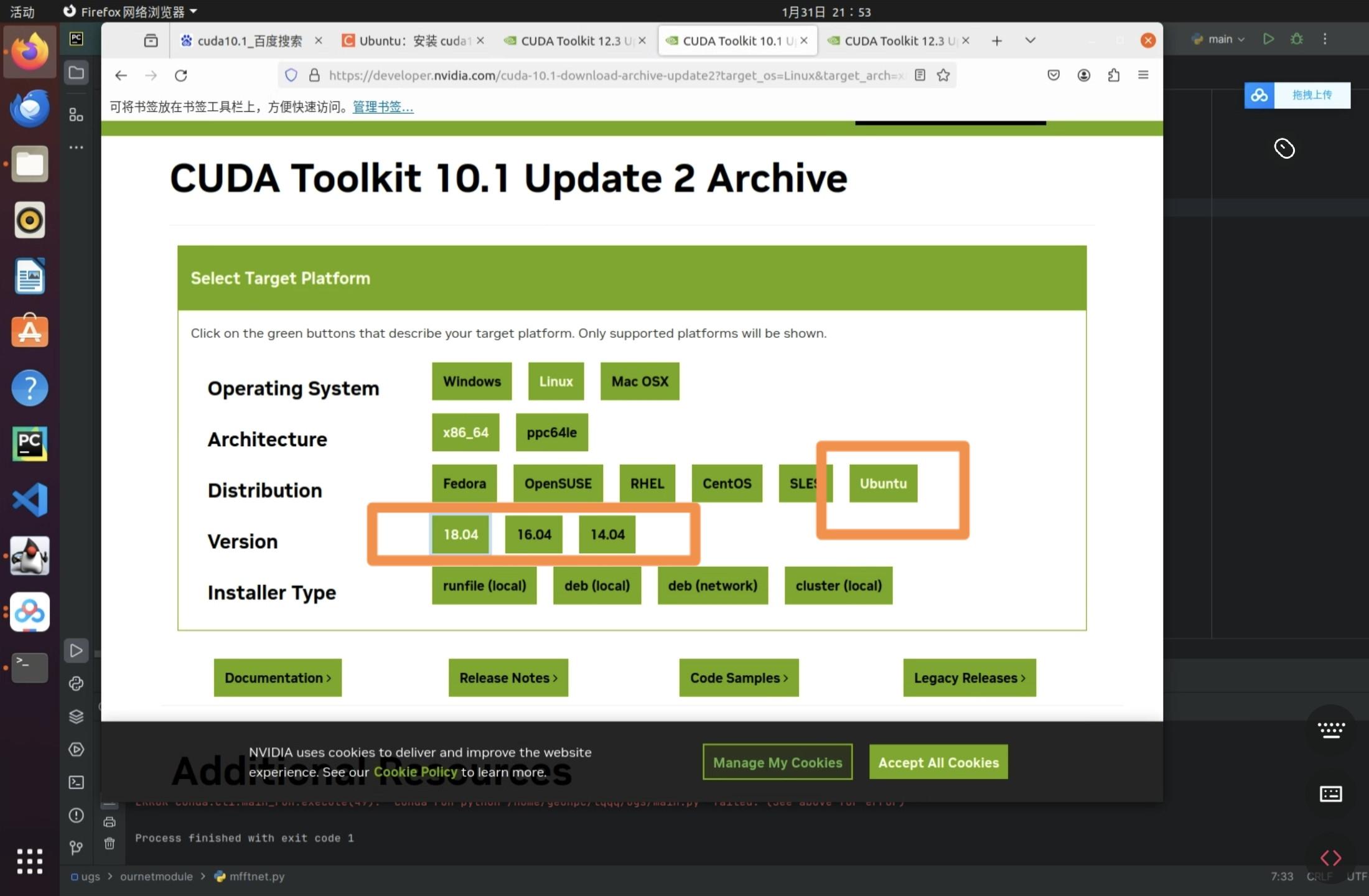

3) Installieren Sie Build-Abhängigkeiten und laden Sie das CUDA 12.6-Installationsprogramm herunter (Beispiel mit Runfile). Im Assistenten Deaktivieren Sie das Kontrollkästchen „Treiber“ wenn Sie 560 bereits installiert haben, um Konflikte zu vermeiden.

sudo apt install -y build-essential

wget https://developer.download.nvidia.com/compute/cuda/12.6.3/local_installers/cuda_12.6.3_560.35.05_linux.run

sudo sh cuda_12.6.3_560.35.05_linux.run

4) Exportieren Sie PATH und LD_LIBRARY_PATH in die installierte Version und laden Sie das Profil neu. Dies stellt sicher, dass NVCC und die Bibliotheken sind in der Sitzung verfügbar.

nano ~/.bashrc

# Añade al final (ajusta si tu ruta difiere)

export PATH=/usr/local/cuda-12.6/bin${PATH:+:${PATH}}

export LD_LIBRARY_PATH=/usr/local/cuda-12.6/lib64${LD_LIBRARY_PATH:+:${LD_LIBRARY_PATH}}

# Guarda y recarga

source ~/.bashrc

5) Überprüfen Sie die CUDA-Compilerversion. Wenn „nvcc –version“ korrekt antwortet, ist die Installation bereit für die Produktion. Ohne diesen Schritt schlagen viele Builds fehl..

nvcc --version

Zusätzliche Hinweise für andere Versionen: Wenn Sie installieren CUDA 11.8 Bei runfile ist der Vorgang ähnlich und der Pfad lautet normalerweise /usr/local/cuda-11.X. Überprüfen Sie in jedem Fall die Treiberkompatibilitätsmatrix, um die richtige Übereinstimmung zwischen CUDA-Version und Treiber zu gewährleisten.

Miniconda, PyTorch und Ökosystem

Die Verwaltung von Umgebungen mit Miniconda ist äußerst praktisch: Es isoliert Abhängigkeiten, vereinfacht Builds und ermöglicht Ihnen den Wechsel zwischen Python-Versionen. Ideal für KI und Multiprojekt-Workflows.

Installieren Minikonda unter Linux mit diesen Schritten, akzeptieren Sie die Lizenz und starten Sie den Terminal am Ende. Danach Sie sehen die aktive Basisumgebung.

wget https://repo.anaconda.com/miniconda/Miniconda3-latest-Linux-x86_64.sh

bash ./Miniconda3-latest-Linux-x86_64.sh

# Enter > Avanzar > yes > enter > yes

Für einige Grafikpakete kann es notwendig sein python3-tk auf Ubuntu/Mint-Systemen. Es ist auch nützlich, Git zur Hand zu haben.

sudo apt update -y && sudo apt install -y python3-tk git

Wenn die Umgebung bereit ist, installieren Sie PyTorch mit CUDA Stable (cu118) oder sogar Nightly, wenn Sie die neueste Leistung suchen (z. B. cu124). Wählen Sie nach Ihren Bedürfnissen von Stabilität vs. Neuheiten.

# Estable (ejemplo cu118)

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

# Nightly (ejemplo cu124)

pip install --pre torch torchvision torchaudio --index-url https://download.pytorch.org/whl/nightly/cu124

Wenn Sie mit kreativen Pipelines wie ComfyUI arbeiten, können Sie deren Repo klonen und die App starten. Um von einem anderen Computer im Netzwerk darauf zuzugreifen, verwenden Sie das Flag –listen 0.0.0.0. Es ist sehr praktisch auf Headless-Servern.

git clone https://github.com/comfyanonymous/ComfyUI

cd ComfyUI

pip install -r requirements.txt

python main.py --listen 0.0.0.0

Testen und Validieren (PyTorch und Docker)

Durch die Validierung Ihrer Installation vermeiden Sie spätere Überraschungen. Überprüfen Sie in Python, ob PyTorch die GPU erkennt, Speicher zuweisen kann und ob die Kernel fehlerfrei gestartet werden. Die beiden wichtigsten Anrufe Dies sind is_available und device_count.

python3

>>> import torch

>>> torch.cuda.is_available()

True

>>> torch.cuda.device_count()

1

Testen Sie mit Docker den NVIDIA-Beispielcontainer „nbody“. Wenn dieser mit –gpus=all funktioniert, haben Sie die Containerlaufzeit richtig konfiguriert und GPU-Sichtbarkeit von Containern.

docker run --rm -it --gpus=all nvcr.io/nvidia/k8s/cuda-sample:nbody \

nbody -gpu -benchmark -numdevices=1

Wenn Sie unter Windows+WSL den Fehler „0 Geräte“ erhalten, denken Sie an den Trick zum Deaktivieren/Aktivieren von GPUs im Geräte-Manager. Es ist ein bekanntes Problem was manchmal auf Computern mit mehreren Karten auftritt.

Vergessen Sie abschließend nicht, den CUDA-Compiler mit nvcc -V zu validieren und die Treiberinstallation mit nvidia-smi zu überprüfen. Beide Befehle muss fehlerfrei laufen.

Nützliche Optimierungen in Linux: Swap- und Servermodus

Um Abstürze aufgrund von Speichermangel bei intensiven Trainingseinheiten zu vermeiden, kann die Erweiterung der Auslagerungsdatei lebensrettend sein. Eine Größe von 32 GB bietet normalerweise Spielraum bei großen Modellen.

sudo swapon --show

sudo swapoff -a

sudo dd if=/dev/zero of=/swapfile bs=1M count=32768 status=progress

sudo chmod 600 /swapfile

sudo mkswap /swapfile

sudo swapon /swapfile

sudo swapon --show

sudo nano /etc/fstab

# Añade si no existe:

/swapfile none swap sw 0 0

Wenn Sie Linux Mint (und ähnliche auf anderen Systemen) verwenden, können Sie im Mehrbenutzermodus ohne grafische Umgebung booten, um Ressourcen, einschließlich etwas VRAM, zu sparen. Perfekt für Server oder Trainingsknoten.

sudo nano /etc/default/grub

# Cambia "quiet splash" por "text"

sudo update-grub

sudo systemctl set-default multi-user.target

# Reinicia; para volver al escritorio en sesión:

startx

Häufige Probleme und wie man sie behebt

Falsch ausgerichtete Treiber und Toolkit: Wenn Sie ein inkompatibler Treiber Bei Ihrer CUDA-Version können beim Kompilieren oder Starten von Kerneln Fehler auftreten. Konsultieren Sie die NVIDIA-Kompatibilitätstabelle und passen Sie die Versionen an.

Abhängigkeitskonflikte unter Linux: Entfernen Sie Restpakete aus früheren Installationen und verwenden Sie apt oder yum, um genaue Versionen lösen wenn das Installationsprogramm Sie dazu auffordert. Es ist sehr hilfreich, die offizielle Anleitung genau zu befolgen.

WSL ohne richtigen Kernel: prüfen wsl –aktualisieren und überprüfen Sie die Version mit „wsl cat /proc/version“. Windows Update muss auf dem neuesten Stand sein, um Subsystemverbesserungen zu erhalten.

Docker ohne GPU: Stellen Sie sicher, dass Sie es installiert haben NVIDIA Container Toolkit und Docker Desktop ist unter Windows aktiv. Probieren Sie den nbody-Container aus und überprüfen Sie die Benutzerberechtigungen, wenn etwas fehlschlägt.

PATH und Bibliotheken: Wenn nvcc oder die CUDA-Bibliotheken nicht gefunden werden, überprüfen Sie die Variablen PATH und LD_LIBRARY_PATH. Kehren Sie nach der Bearbeitung zu „source ~/.bashrc“ zurück und starten Sie die Sitzung gegebenenfalls neu.

Cloud-Alternative: sofort einsatzbereite GPU-Instanzen

Wenn Sie die Einrichtung vor Ort nicht durchführen können oder möchten, nimmt Ihnen eine Cloud-Instanz mit GPUs die Arbeit ab. Dienste mit A100, RTX 4090 oder A6000 bieten rohe Leistung und KI-fähige Vorlagen.

Auf Plattformen, die vorkonfigurierte Pods bereitstellen, können Sie Ihre Umgebung in wenigen Minuten starten, durch nutzungsbasierte Abrechnung Kosten senken und für PyTorch optimierte Bilder auswählen. Für Teams, die Modelle rotieren und sie müssen skalieren, das ist ein sehr effizienter Weg.

Mit all dem oben genannten verfügen Sie nun über die vollständige Karte: Anforderungen, Installation unter Windows mit WSL und unter nativem Linux, Schlüsselvalidierungen mit PyTorch und Docker sowie Produktivitätsextras mit Miniconda, Swap und Servermodus. Das Ziel ist, dass Sie von Null auf Training kommen keine Staus, mit einem soliden und leicht zu wartenden Stapel.

Leidenschaftlicher Autor über die Welt der Bytes und der Technologie im Allgemeinen. Ich liebe es, mein Wissen durch Schreiben zu teilen, und genau das werde ich in diesem Blog tun und Ihnen die interessantesten Dinge über Gadgets, Software, Hardware, technologische Trends und mehr zeigen. Mein Ziel ist es, Ihnen dabei zu helfen, sich auf einfache und unterhaltsame Weise in der digitalen Welt zurechtzufinden.