- La Raspberry Pi 5 s'ha consolidat com a plataforma accessible per executar models de IA lleugers i agents que coordinen serveis al núvol, amb especial focus en la privadesa i l'aïllament del sistema.

- Els models destil·lats i compactes (DeepSeek, Flama 3.2, Qwen, etc.) permeten xat, traducció i assistència de codi en maquinari modest, encara que amb clares limitacions davant dels grans LLM comercials.

- Els acceleradors dedicats com els mòduls Hailo (Hailo-8L i Hailo-10H a AI HAT+ 2) impulsen el rendiment d'inferència, habilitant visió per ordinador i LLM locals a Raspberry Pi 5 amb baixa latència.

- La combinació de models petits, maquinari dedicat i domòtica converteix Raspberry Pi en un node ideal d'IA a la vora, capaç d'interpretar ordres i automatitzar tasques sense dependre del núvol.

La intel·ligència artificial a la Raspberry Pi està vivint un moment força especial. Fins fa res, quan pensàvem a IA imaginàvem o bé un gran chatbot al núvol per subscripció, o bé un ordinador caríssim ple de GPUs per moure models enormes en local. Ara el panorama ha canviat: l?arribada d?agents com OpenClaw, els models destil·lats tipus DeepSeek i els nous acceleradors com AI HAT+ 2 han posat la petita placa al centre de la conversa.

Aquest canvi no és només una moda passatgera: la combinació de Raspberry Pi 5, models lleugers i maquinari dedicat d'IA permet executar chatbots, traductors, assistents de codi o sistemes de visió per ordinador sense dependre del núvol. Tot això amb més control sobre la seguretat, el cost i la privadesa de les dades, encara que també amb limitacions clares que convé conèixer per no emportar-se decepcions.

L'auge dels agents d'IA i el paper de Raspberry Pi

En els darrers mesos s'ha parlat molt de agents d'IA capaços d'actuar pel vostre compte, i un dels noms que més soroll ha generat és OpenClaw. A diferència d'un xatbot clàssic que només respon a missatges, un agent és un sistema que pot prendre decisions i executar accions: llançar scripts, trucar a APIs, interactuar amb serveis externs o manipular fitxers dins d'un entorn informàtic concret.

L'interessant és que aquest tipus d'agents no necessita que el “cervell” estigui a la mateixa Raspberry Pi. L'habitual és que el model gran corri al núvol, mentre que la placa funciona com a orquestrador: manté la conversa, gestiona el context de l'usuari, llança ordres al sistema i actua com a pont entre el món físic (sensors, actuadors, domòtica) i la IA remota.

Alhora, han anat apareixent configuracions pensades per a executar models més petits directament al maquinari de la Raspberry Pi. Eines com Ollama o llama.cpp permeten carregar LLM reduïts i ajustats a l'arquitectura ARM, especialment en models com Raspberry Pi 4 o 5 amb suficient memòria RAM. No és màgia: se sacrifiquen capacitats i velocitat, però per a certs usos el resultat és perfectament aprofitable.

Aquest nou escenari ha provocat fins i tot moviments al mercat financer al voltant de Raspberry Pi, amb pujades notables de les seves accions vinculades a l'entusiasme per agents d'IA accessibles. Al final, la idea que s'està consolidant és la de petits dispositius físics dedicats a executar o coordinar IA, en comptes de dependre exclusivament de grans centres de dades o ordinadors de sobretaula de gamma alta.

Seguretat, aïllament i dubtes sobre l'enfocament

Donar a un agent d'IA accés profund a un sistema no és cap broma: un agent amb permisos amplis pot llegir fitxers, moure dades, omplir formularis web o tocar serveis crítics. Des del mateix ecosistema de Raspberry Pi es remarca que això implica riscos reals, perquè aquests algorismes no són infal·libles i poden cometre errors o comportar-se de manera inesperada; per això convé seguir bones pràctiques de seguretat informàtica.

Aquí entra en joc un dels grans avantatges de la placa: utilitzar una Raspberry Pi com a entorn aïllat redueix l'impacte de possibles errors. En lloc de donar control directe al vostre ordinador principal, podeu muntar un sistema dedicat on l'agent només tingui accés als recursos estrictament necessaris. Aquest sandbox físic ajuda a contenir danys ia experimentar amb una mica més de tranquil·litat.

No tots estan convençuts que aquest enfocament sigui la panacea. Mitjans especialitzats han assenyalat que la Raspberry Pi ha anat perdent part del seu atractiu com a opció ultrabarata, sobretot en configuracions avançades amb molta RAM. Un model de Raspberry Pi 5 amb 16 GB es pot acostar o superar els 200 dòlars, cosa que per a alguns desvirtua la idea original d'un ordinador de baix cost per a tothom.

En aquest sentit, hi ha veus escèptiques que consideren que utilitzar una Raspberry Pi com a base per a agents complexos tipus OpenClaw pot no ser la decisió ideal si el pressupost és ajustat. Entre el cost de la placa, la memòria i els possibles acceleradors de l'IA, la factura pot pujar molt i acostar-se a alternatives més potents o flexibles.

Tot i així, l'enfocament de dispositiu dedicat amb aïllament de riscos continua sent molt atractiu: qui valora la seguretat, la privadesa i l'experimentació controlada troba a la Raspberry Pi un “laboratori” perfecte on provar agents i models sense comprometre màquines de treball crítiques.

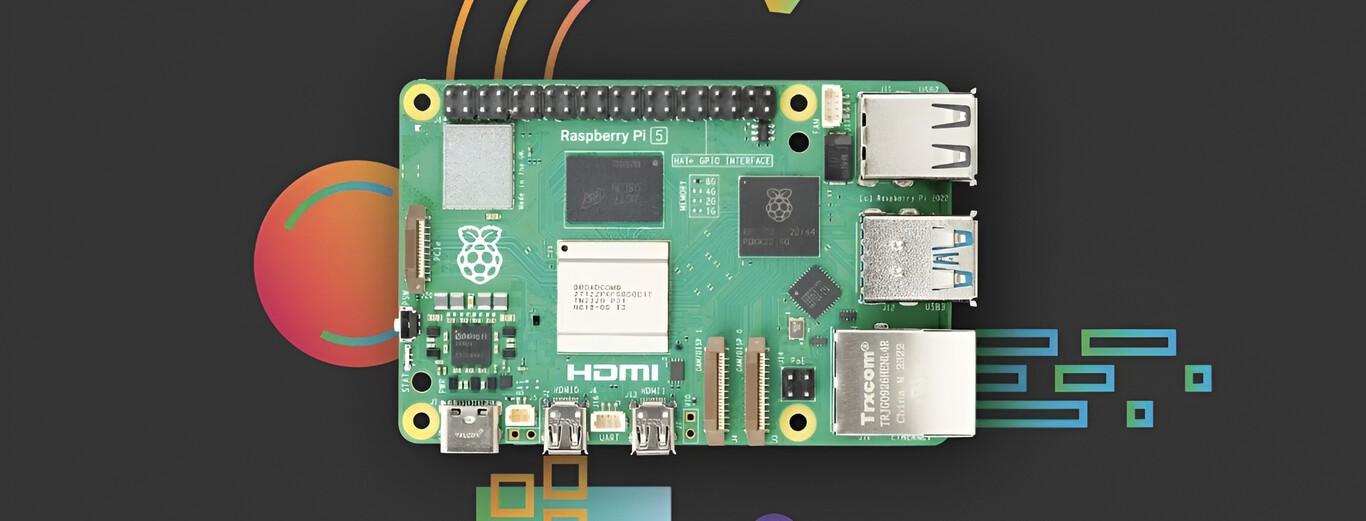

Raspberry Pi 5 com a plataforma per a models d'IA locals

Més enllà de la part d'agents, la Raspberry Pi 5 s'ha consolidat com una eina tremendament versàtil. Continua sent fantàstica per a robòtica, electrònica, domòtica o multimèdia, però el maquinari actual permet anar un pas més enllà i fer-la servir com a base per a projectes reals d'intel·ligència artificial en local.

Gràcies a la seva CPU més ràpida, les seves millores en GPU i la possibilitat de muntar configuracions amb força RAM, la Raspberry Pi 5 és capaç de moure models de IA lleugers de forma raonable. No substituirà un servidor ple de GPU, però sí que permet experimentar amb visió per ordinador, reconeixement de veu, models de llenguatge compactes o assistents específics per a tasques molt concretes.

Una estratègia habitual consisteix a apostar per models de codi obert optimitzats per a maquinari limitat. Entre els exemples que solen manejar-se hi ha Mistral 7B, algunes variants petites d'Orca o models compactes com Microsoft Phi-2, sempre que hi hagi versions adaptades i, sobretot, reduïdes amb tècniques de quantització o destil·lació per cabre en memòria.

És important entendre que aquests LLM petits no juguen a la mateixa lliga que gegants com GPT-4. Perden profunditat, context i qualitat de resposta, especialment en temes molt generals o complexos. A canvi, ofereixen latències acceptables, menor consum i l'avantatge de no dependre de connexions externes, cosa clau quan es vol que tot el processament passi dins de la pròpia placa.

Aquesta combinació converteix la Raspberry Pi 5 en una mena de Caixa de sorra ideal per aprendre, prototipar i desplegar solucions d'IA que no exigeixen un coneixement tècnic extrem ni inversions esbojarrades, sempre que es tingui molt clar què es pot esperar i què no d'aquests models reduïts.

Passos bàsics per posar en marxa IA en una Raspberry Pi 5

Per muntar un projecte que executi IA localment a la Raspberry Pi 5, és útil seguir una sèrie de passos generals. No és una recepta tancada, però sí una guia mental del que et trobaràs quan comencis a trastejar.

El primer punt és triar un model compatible amb l'arquitectura ARM i els recursos de la placa. Aquí entren en joc models com els esmentats Mistral 7B en versions molt comprimides, alguns Orca petits o Phi-2 reduïts, a més d'altres LLM de 1B a 7B paràmetres preparats per funcionar en dispositius modestos. Com més petit sigui el model, més fàcil serà moure'l, però també més limitat serà.

Després toca la part de instal·lar el programari de suport per treballar amb xarxes neuronals. Depenent del que busques, pots estirar TensorFlow Lite per a projectes de visió, PyTorch si utilitzaràs determinats repositoris o runtimes específics com Edge TPU quan vagis a tirar d'acceleradors externs. En el cas de LLM, eines com truca.cpp o Ollama faciliten molt la vida.

Un cop tens el programari, toca configurar l'entorn d'execució a la Raspberry Pi. Això implica ajustar opcions del sistema, instal·lar dependències addicionals, assegurar-se que el model està optimitzat per a ARM i, sovint, jugar amb paràmetres com la mida de context, el nivell de quantització o el nombre de fils per equilibrar rendiment i consum de memòria.

Amb tot muntat, pots passar a executar el model i començar a fer inferències. Aquí és on es veu si la combinació de maquinari-software aguanta. Hauràs de carregar dades, enviar consultes, revisar latències i veure fins a quin punt la qualitat de les respostes encaixa amb el que tenies al cap. És freqüent haver dajustar mil detalls fins que el sistema queda fi. És aconsellable revisar l'espai en disc amb eines per analitzar i netejar el teu disc.

Si el rendiment es queda curt, tens l'opció de afegir un accelerador extern per treure feina a la CPU. Dispositius com USB Coral amb Edge TPU o les noves targetes basades en xips Hailo permeten executar xarxes neuronals a molta més velocitat i amb un consum energètic contingut, cosa que canvia completament l'experiència en molts casos.

Privadesa, seguretat i avantatges de processar tot en local

Un dels arguments més potents a favor de fer servir IA en una Raspberry Pi és la possibilitat de mantenir les dades dins de la teva xarxa. Quan executes un model localment, no estàs enviant informació personal o sensible a un servidor de tercers, especialment rellevant en entorns professionals, educatius o de domòtica avançada. També convé aplicar tècniques de backup xifrat a les còpies.

Això vol dir que tens molt més control sobre qui pot accedir al que processes. Si el teu assistent local analitza documents interns, controla càmeres de seguretat o gestiona historials d'ús del teu habitatge, tot es queda a la teva infraestructura. No depens de polítiques canviants de privadesa ni de possibles bretxes en serveis externs.

En paral·lel, la Raspberry Pi funciona gairebé com un “tallafocs físic” per als teus experiments d'IA. Pots muntar un sistema separat de la teva xarxa principal, limitar l'accés a certs recursos i assegurar-te que, encara que el model cometi errors estranys o l'agent es posi massa creatiu, el dany possible estigui fitat.

Per descomptat, això no anul·la la necessitat de configurar bé permisos, usuaris i regles de xarxa. Un agent amb massa llibertat en una Pi mal protegida pot continuar sent un problema. La diferència és que, com que és un entorn dedicat i barat, és molt més senzill auditar-lo, refer-lo des de zero o fins i tot desconnectar-lo físicament si alguna cosa se'n va de mare.

En resum, per als que valoren la protecció de dades i la capacitat d'auditar tot el flux d'informació, utilitzar una Raspberry Pi com a node local de IA ofereix una tranquil·litat difícil daconseguir quan tot depèn de serveis al núvol que es gestionen des de fora de la teva organització o de la teva llar.

DeepSeek i la realitat dexecutar grans models en maquinari modest

Un altre nom que ha sacsejat el panorama és DeepSeek, en particular el model DeepSeek R1, pensat per a raonament i amb un enfocament molt ambiciós. Molts titulars han destacat que supera alguns dels models comercials més avançats i que es pot executar en local, cosa que ha alimentat la idea de tenir “un ChatGPT casolà” a qualsevol màquina.

Convé posar les coses al seu lloc: la versió completa DeepSeek R1 671B és un monstre de més de 400 GB i requereix diverses GPUs de gamma molt alta per funcionar amb soltesa. Aquesta és la variant que realment competeix amb els grans models d'OpenAI o similars, i està totalment fora de l'abast d'una Raspberry Pi o d'un PC normalet.

La gran diferència respecte a altres proveïdors tancats és que, si disposes del maquinari, pots descarregar el model, muntar-lo amb eines com Ollama i executar-lo a casa, i en molts casos necessitaràs connectar un disc extern per emmagatzemar els pesos. Però parlem de configuracions de milers d'euros, amb targetes tipus RTX 4090, A100 o equivalents de centre de dades; res a veure amb un microordinador de baix consum.

Perquè el comú dels mortals pugui jugar amb DeepSeek en màquines estàndard o en dispositius com la Raspberry Pi, es recorre a models destil·lats i reduïts. Bàsicament són versions comprimides de l'original que retenen part del comportament a canvi de perdre capacitat i coneixement. És aquí on entren variants de 14B, 7B o fins i tot 1.5B paràmetres.

La pregunta clau és quant es perd pel camí. La relació entre mida del model, memòria i qualitat de la resposta és molt evident: si el model de referència són més de 400 GB i la Wikipedia ja ocupa prop de 100 GB, no és realista esperar que una versió de poc més de 1 GB tingui tot aquest coneixement disponible de forma detallada.

Proves reals de DeepSeek a diferents dispositius

Per veure aquestes diferències a la pràctica, és útil comparar el comportament de les diferents variants de DeepSeek en maquinari variat. En una estació de treball amb una GPU RTX 3060 de 12 GB de VRAM es pot executar raonablement bé la versió de 14B paràmetres, i fins i tot forçar la de 32B tirant de RAM del sistema, encara que les velocitats cauen de forma notable.

Si es prova la versió al núvol de DeepSeek, sense limitacions de maquinari locals, el model gran funciona amb soltesa i demostra clarament per què competeix amb els gegants del sector. La diferència es nota tant en la velocitat com en la coherència de les respostes i la capacitat per manejar instruccions complexes.

Quan baixa al terreny d'una Raspberry Pi amb 8 GB de RAM, l'escenari canvia radicalment. En aquest cas, el model més gran que es pot arribar a executar de manera funcional és el de 7B paràmetres, i així i tot la velocitat se situa al voltant d'1 token per segon. Això, per mantenir una conversa fluida, es fa gairebé insofrible.

En avaluar la qualitat de les respostes, es veu encara més clara la diferència. Davant d'una pregunta de coneixement general senzill, com qui és un personatge molt conegut d'una sèrie popular, el model de 14B encerta, mentre que el de 7B comença a donar respostes estranyes. El de 1.5B directament ofereix resultats que recorden més un text inventat sense base sòlida.

Amb consultes més genèriques es repeteix el patró: les variants petites tendeixen a donar respostes rares, incompletes o clarament errònies. És lògic: en reduir tant la mida del model, es retalla brutalment la seva capacitat de representació i la seva “memòria” implícita del món, de manera que no se li pot exigir que es comporti com un model topall de gamma.

Per què serveixen realment els models destil·lats a Raspberry Pi

Tot i aquestes limitacions, els models destil·lats i compactes tenen usos molt interessants en dispositius com la Raspberry Pi. No estan pensats per substituir els grans chatbots generalistes, sinó per resoldre tasques ben acotades on la creativitat i el coneixement enciclopèdic no són el punt principal.

Un dels camps on funcionen raonablement bé és a ajuda matemàtica bàsica i revisió de codi. Per detectar errors simples en scripts, proposar petites funcions o suggerir millores en trossos de codi Python, un model de 7B o 14B sol donar respostes útils sempre que no se li demani una cosa extremadament específica o rebuscada.

També poden ser molt útils per generar i corregir fragments de codi aplicats a domòtica, automatització o petits projectes. Per exemple, un model de 14B pot proposar una automatització per a Home Assistant amb certa coherència, mentre que la versió de 1.5B tendirà a inventar-se parts o oferir alguna cosa que no compila ni té sentit.

On fallen de manera sistemàtica és a preguntes de cultura general, dades factuals detallades o tasques que exigeixen molt de context. A més, el sentit de l'humor i la capacitat per mantenir converses llargues i naturals brillen per la seva absència fins i tot en models relativament grans, per la qual cosa no són la millor opció per fer-los servir com a “amics virtuals”.

Un exemple curiós és demanar-los que generin una pàgina web complexa, com una landing per vendre un curs. Tots els models poden produir una estructura HTML funcional, però com més destil·lada i petita és la variant, més simple, lletja i pobra en contingut resulta la web generada, perdent detalls i matisos pel camí.

En definitiva, els models petits muntats en una Raspberry Pi són ideals per assistir en tasques tècniques acotades, automatització domèstica, petits assistents de desenvolupament o classificació lleugera de dades, però no per substituir un servei al núvol d'última generació quan el que vols és un assistent general polivalent.

Raspberry Pi, domòtica i intel·ligència artificial lleugera

Una de les aplicacions més prometedores de la IA a Raspberry Pi és la domòtica intel·ligent amb models lleugers. La idea és fer servir la placa com a cervell local que interpreta ordres, connecta amb sensors i actuadors, i pren decisions senzilles sense necessitat d'enviar res al núvol.

Per exemple, es pot muntar un sistema on un petit model de llenguatge s'encarrega d'entendre ordres de veu, incloent passos de preprocessament com netejar el soroll del micròfon, del tipus “abaixa la persiana del saló quan el sol doni de cara” o “encén la calefacció només si hi ha algú a casa i la temperatura baixa de cert llindar”. El model no necessita saber qui és un personatge històric ni escriure poesia: només ha de traduir peticions a accions concretes.

Amb aquest enfocament, fins i tot un LLM de 1.5B o 3B paràmetres pot tenir sentit, perquè la seva funció no és donar respostes brillants, sinó mapejar llenguatge natural a ordres estructurades. Si s'entrena o s'ajusta específicament per a aquest domini (domòtica, sensors, rutines), els resultats poden ser sorprenentment bons per com és de lleuger el sistema.

Aquest tipus de solucions permet crear cases intel·ligents molt més respectuoses amb la privadesa, on ni les ordres de veu ni els patrons dús de dispositius surten de la xarxa local. A més, en no dependre de serveis externs, evita que tot deixi de funcionar perquè un proveïdor canvia d'API, cau un servidor o decideix tancar el servei.

Tot i que encara queda molt per polir i provar, el potencial de combinar models petits amb plataformes domòtiques com Home Assistant o sistemes propis a Raspberry Pi és enorme, i tot apunta que veurem cada cop més experiments i projectes reals en aquesta línia.

Acceleradors d'IA per a Raspberry Pi: Hailo, AI HAT+ i altres mòduls

Per superar les limitacions de la CPU de la Raspberry Pi, han aparegut acceleradors d'IA específics que s'integren directament amb la placa. El seu objectiu és processar xarxes neuronals de manera molt més ràpida i eficient que la CPU o, en alguns casos, que una GPU convencional.

Enfront dels processadors generalistes, aquests acceleradors estan dissenyats per executar en paral·lel les operacions matemàtiques típiques de laprenentatge automàtic. Això redueix el temps d'inferència i també el consum d'energia, cosa que és clau en dispositius encastats o en situacions on no es pot permetre una gran despesa energètica continuada.

Un exemple molt estès és lús duna targeta M.2 HAT+ connectada a Raspberry Pi 5 juntament amb un mòdul M.2 2242 que integra un xip Hailo-8L. Aquest tipus de kit afegeix una unitat dedicada de processament neural que s'encarrega d'accelerar tasques de visió, detecció d'objectes o fins i tot models generatius optimitzats per a la seva arquitectura.

El xip Hailo se centra en processar operacions complexes en paral·lel amb una gran eficiència energètica. En comparació amb solucions basades només en CPU o GPU, això es tradueix en menys calor, menor necessitat de refrigeració i millor autonomia si el sistema s'alimenta per bateria, una cosa molt apreciada en projectes industrials, robòtica o sensors intel·ligents distribuïts.

Gràcies a aquests mòduls, la Raspberry Pi pot passar de ser un simple coordinador a esdevenir un node d'inferència realment capaç, executant xarxes neuronals sofisticades directament a la vora de la xarxa sense saturar la placa i mantenint una latència molt baixa.

AI HAT+ 2 i el salt a LLM locals a Raspberry Pi 5

Un dels llançaments més cridaners en aquest terreny és la Raspberry Pi AI HAT+ 2, una placa d'expansió dissenyada per a Raspberry Pi 5 que incorpora el xip Hailo-10H. Aquest coprocessador ofereix un rendiment d'inferència de prop de 40 TOPS, suficient per manejar models de IA generativa lleugera de manera local.

Amb aquest maquinari, la Raspberry Pi 5 pot executar models de llenguatge relativament compactes amb baixa latència, sense que la CPU principal es vegi saturada. El processament es delega a Hailo-10H, que s'encarrega de les operacions intensives mentre la placa gestiona la lògica de l'aplicació, l'entrada d'usuari i la integració amb altres sistemes.

Entre els models compatibles que s'han esmentat oficialment s'hi inclouen DeepSeek-R1-Distill, Truca 3.2, Qwen2.5-Coder, Qwen2.5-Instruct i Qwen2. La majoria ronden els 1.500 milions de paràmetres, mentre que Flama 3.2 es queda aproximadament en 1.000 milions, tots pensats per oferir un equilibri raonable entre capacitat i consum de recursos.

Les proves públiques mostren que aquests models es poden fer servir per tasques de xat bàsic, traducció de text, generació de fragments de codi o descripció d'escenes quan es combinen amb entrades de visió. La latència és baixa i l'experiència d'ús s'acosta molt més al que espera la gent d'una IA interactiva moderna.

Això sí, cal tenir clar que AI HAT+ 2 no permet córrer de manera local models massius com ChatGPT, Claude o els LLM més grans de Meta. Aquests sistemes tenen centenars de milers de milions o bilions de paràmetres, molt per sobre del que pot manejar de manera raonable un coprocessador d'aquest tipus en una Raspberry Pi 5.

El gran atractiu de l'AI HAT+ 2 és que, per un preu que ronda els 130 dòlars, permet convertir una Raspberry Pi 5 en una petita estació de IA local molt capaç, amb accés a un repositori d'exemples i frameworks de Hailo orientats tant a visió com a IA generativa. És una peça clau per als que vulguin anar més enllà dels models purament simbòlics i jugar realment amb xarxes neuronals modernes a la vora.

El panorama que s'està dibuixant al voltant de la intel·ligència artificial a Raspberry Pi és força potent: entre agents que usen el núvol, models lleugers en local, acceleradors dedicats i noves plaques com AI HAT+ 2, la petita placa ha esdevingut un laboratori ideal per explorar com serà la IA distribuïda en dispositius quotidians, sempre que s'assumeixin les limitacions de potència i es dissenyin els projectes amb cap.

Redactor apassionat del món dels bytes i la tecnologia en general. M'encanta compartir els meus coneixements a través de l'escriptura, i això és el que faré en aquest bloc, mostrar tot el més interessant sobre gadgets, programari, maquinari, tendències tecnològiques, i més. El meu objectiu és ajudar-te a navegar pel món digital de forma senzilla i entretinguda.